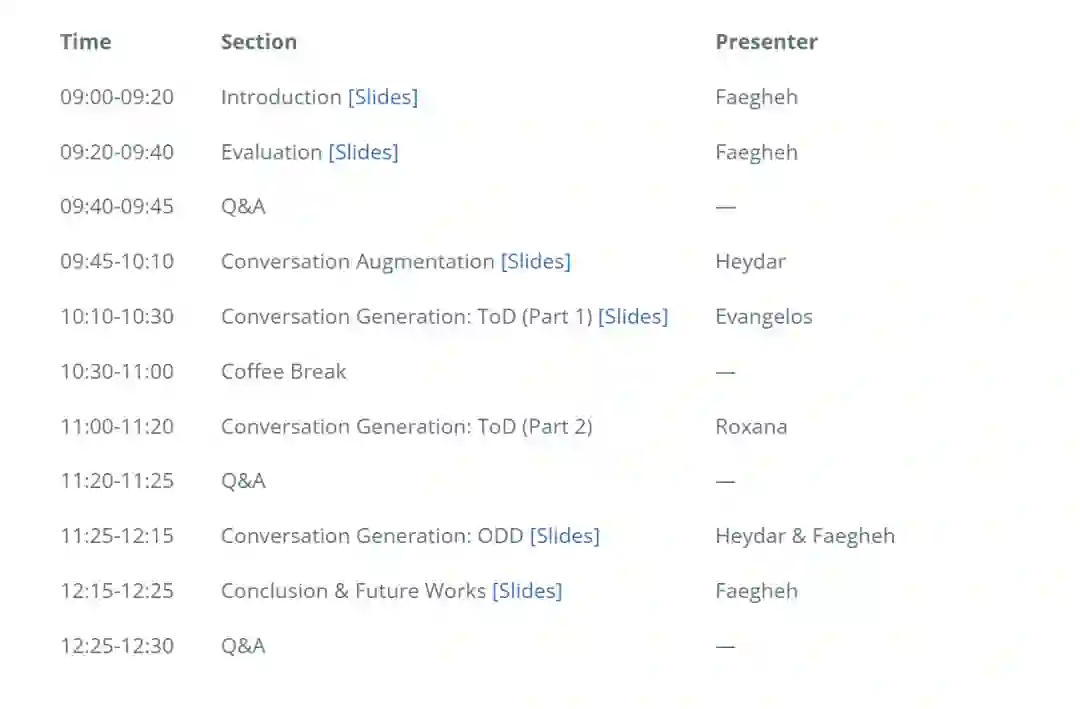

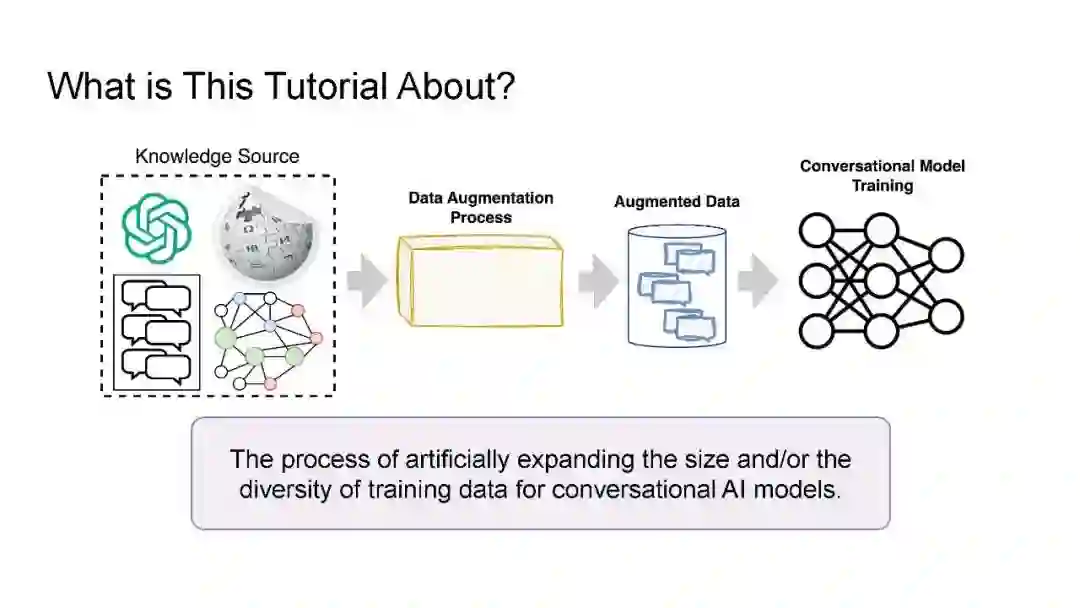

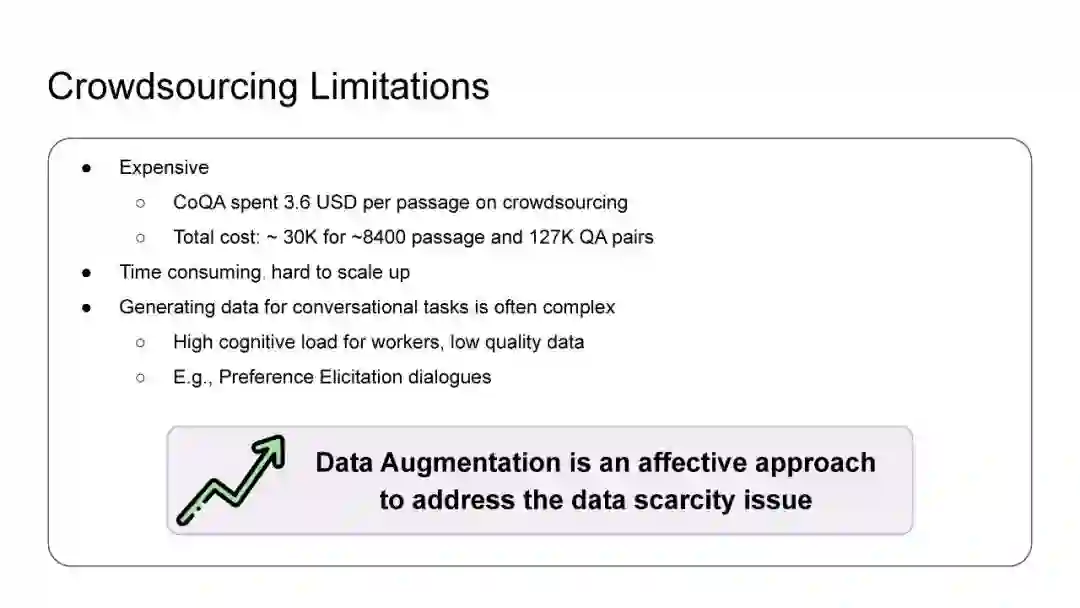

对话系统的进步已经革命性地改变了信息获取方式,超越了单一查询的局限性。然而,开发对话系统需要大量训练数据,这在资源匮乏的领域和语言中是一个挑战。传统的数据收集方法如众包是劳动密集型和耗时的,因此在这种情况下效率不高。数据增强(DA)是一种有效的方法,可以减轻对话系统中数据稀缺的问题。这个教程提供了一个全面且最新的数据增强方法综述,在对话系统背景下。它突出了最近在对话增强、开放领域和任务导向对话生成方面的进展,以及评估这些模型的不同范式。我们还讨论了当前的挑战和未来的方向,以帮助研究人员和从业者在这一领域进一步推进。 目录内容:

讲者:

成为VIP会员查看完整内容

相关内容

Arxiv

224+阅读 · 2023年4月7日