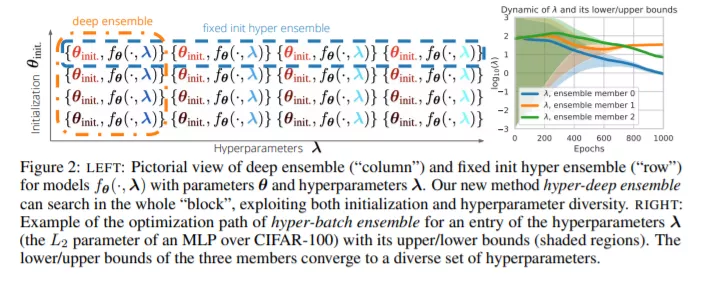

由不同的随机初始化训练的神经网络权重集合,被称为深度集合,实现了最先进的精度和校准。最近引入的批量集成提供了一个更有效的参数替换。在本文中,我们不仅设计了权值,而且设计了超参数,以改善这两种情况下的技术状况。为了获得不依赖预算的最佳性能,我们提出了超深集合,这是一个简单的过程,涉及对不同超参数的随机搜索,它们本身在多个随机初始化中分层。其强大的性能突出的好处,结合模型的重量和超参数多样性。在批量集成和自调优网络的基础上,进一步提出了参数高效的超批量集成。该方法的计算和内存成本明显低于典型的集成。在图像分类任务上,通过MLP、LeNet和Wide ResNet 28-10架构,我们的方法在深度和批处理集成上都有所改进。

https://www.zhuanzhi.ai/paper/e7ca9fa3f26bba7844c576a522f29c63

成为VIP会员查看完整内容

相关内容

专知会员服务

14+阅读 · 2020年5月19日

Arxiv

0+阅读 · 2020年12月3日

Arxiv

0+阅读 · 2020年11月25日