每日论文 | 谷歌发布大型数据集Open Images V4;用深度学习辨认DeepFake假视频;增强针对对抗样本鲁棒性的方法

The Open Images Dataset V4: Unified image classification, object detection, and visual relationship detection at scale

今天,谷歌AI发布了一个名为Open Images V4的数据集,包含920万张图像,其中都经过统一的标注,可以用于图像分类、目标检测、视觉关系检测等任务。该数据集中的3000万个标签涵盖了近2万种概念,边界框大约全出了600种目标类别,37万的视觉关系标注包括了57种类别。研究人员希望这一大型、高质量、多样的Open Images V4能对其他计算机视觉任务也有所帮助。

地址:https://arxiv.org/abs/1811.00982

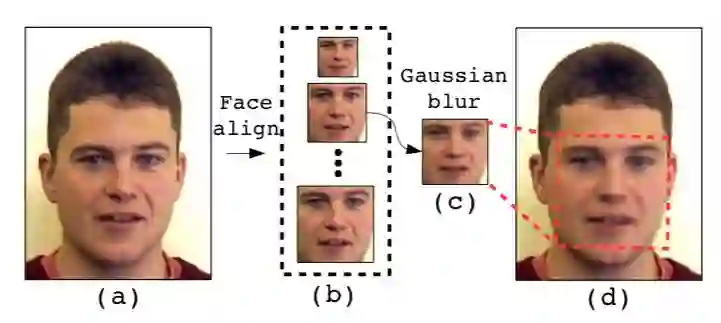

Exposing DeepFake Videos By Detecting Face Warping Artifacts

在这篇论文中,我们提出了一种新的基于深度学习的方法,可以快速分辨出哪些是AI生成的假视频(DeepFake的成果)。通过观察,我们发现DeepFake算法生成的图像分辨率都很有限,如果想和原始视频中的物体无缝衔接,就要对图片进行拉伸修改,这样就能生成明显的伪造痕迹,所以我们用卷积神经网络捕捉这些痕迹。

地址:https://arxiv.org/abs/1811.00656

Improving Adversarial Robustness by Encouraging Discriminative Features

深度神经网络在很多识别任务中都取得了不错的成绩,但是它们在分布之外的对抗样本上表现得很差,即精心设计过的输入,会导致模型的错误行为,可能会有安全隐患。在这篇论文中,我们通过添加一个中心损失,让神经网络分类器学习更加明显的特征,结果在MNIST、CIFAR-10和CIFAR-100上都取得了不错的成果。

地址:https://arxiv.org/abs/1811.00621

星标论智,每天获取最新资讯

登录查看更多

相关内容

Arxiv

6+阅读 · 2018年7月19日