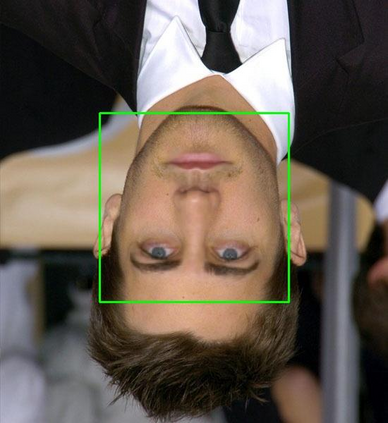

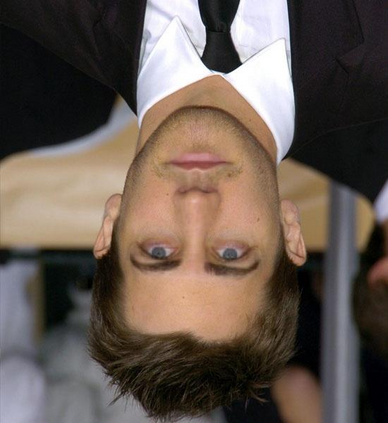

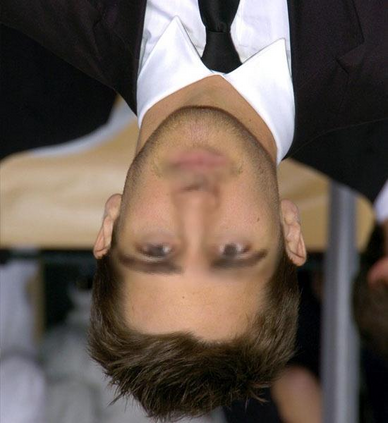

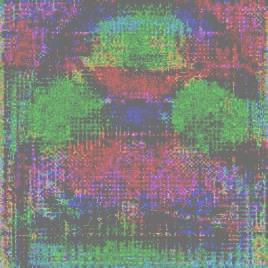

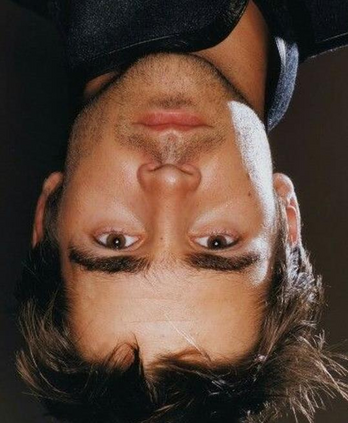

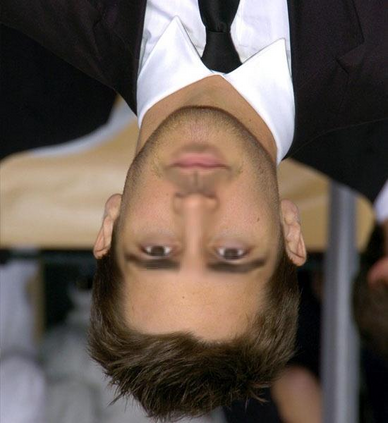

DeepFake face swapping presents a significant threat to online security and social media, which can replace the source face in an arbitrary photo/video with the target face of an entirely different person. In order to prevent this fraud, some researchers have begun to study the adversarial methods against DeepFake or face manipulation. However, existing works focus on the white-box setting or the black-box setting driven by abundant queries, which severely limits the practical application of these methods. To tackle this problem, we introduce a practical adversarial attack that does not require any queries to the facial image forgery model. Our method is built on a substitute model persuing for face reconstruction and then transfers adversarial examples from the substitute model directly to inaccessible black-box DeepFake models. Specially, we propose the Transferable Cycle Adversary Generative Adversarial Network (TCA-GAN) to construct the adversarial perturbation for disrupting unknown DeepFake systems. We also present a novel post-regularization module for enhancing the transferability of generated adversarial examples. To comprehensively measure the effectiveness of our approaches, we construct a challenging benchmark of DeepFake adversarial attacks for future development. Extensive experiments impressively show that the proposed adversarial attack method makes the visual quality of DeepFake face images plummet so that they are easier to be detected by humans and algorithms. Moreover, we demonstrate that the proposed algorithm can be generalized to offer face image protection against various face translation methods.

翻译:深面脸交换对在线安全和社交媒体构成了重大威胁,对在线安全和社交媒体构成了重大威胁,这可以将源面以任意的图片/视频代替源面,以完全不同的人为对象。为了防止这一欺诈,一些研究人员已开始研究对抗深面假称或面对面操纵的对抗方法。然而,现有的工作重点是白箱设置或由大量查询驱动的黑箱设置或黑箱设置,这严重限制了这些方法的实际应用。为了解决这一问题,我们引入了一种实际的对抗性攻击,这不需要对面部图像假冒模型进行任何查询。我们的方法建立在面部重建的替代模型上,然后将替代模型的对抗性例子直接转移到无法进入的黑盒深面法模型。特别是,我们提议采用可转移周期性循环的Genement Adversarial网络(TCA-GAN),以构建干扰未知的Deepfake系统所需的对抗性干扰。我们还提出了一个新的后正规化模块,用于加强面部面部面面面部模拟示例。为了全面衡量我们的方法的有效性,我们构建了一个具有挑战性的深面面面面面面面面面面面面法性攻击基准,我们构建了一个具有挑战性的反向未来发展的视觉质量的图像测试。