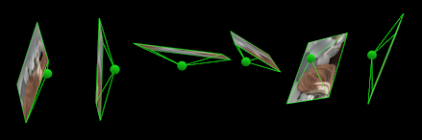

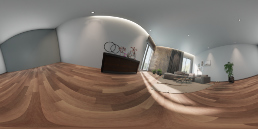

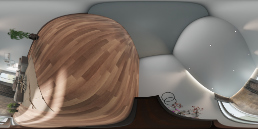

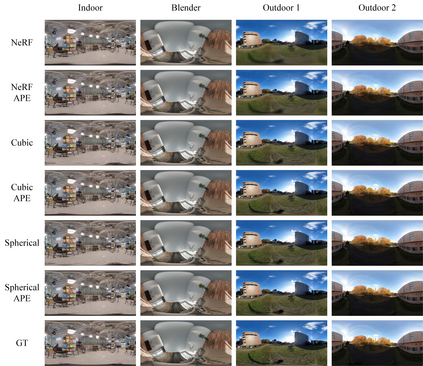

This paper proposes a method to reconstruct the neural radiance field with equirectangular omnidirectional images. Implicit neural scene representation with a radiance field can reconstruct the 3D shape of a scene continuously within a limited spatial area. However, training a fully implicit representation on commercial PC hardware requires a lot of time and computing resources (15 $\sim$ 20 hours per scene). Therefore, we propose a method to accelerate this process significantly (20 $\sim$ 40 minutes per scene). Instead of using a fully implicit representation of rays for radiance field reconstruction, we adopt feature voxels that contain density and color features in tensors. Considering omnidirectional equirectangular input and the camera layout, we use spherical voxelization for representation instead of cubic representation. Our voxelization method could balance the reconstruction quality of the inner scene and outer scene. In addition, we adopt the axis-aligned positional encoding method on the color features to increase the total image quality. Our method achieves satisfying empirical performance on synthetic datasets with random camera poses. Moreover, we test our method with real scenes which contain complex geometries and also achieve state-of-the-art performance. Our code and complete dataset will be released at the same time as the paper publication.

翻译:本文建议一种方法来重建神经光亮场, 使用光度场重建使用完全隐含的射线代表( 20美元, 每场40分钟) 。 我们采用含有密度和颜色特征的显微镜, 以光度场重建使用显微镜显示隐含神经光亮场。 使用光度显示不透明神经场景的外观显示, 可以持续在有限的空间区内重建场景的三维形状。 但是, 培训商业PC硬件完全隐含的显示功能需要大量的时间和计算资源( 每场15美元, 每场20小时)。 因此, 我们提出一个方法来大大加快这一过程( 每场15美元, 每场20美元 美元 ) 。 我们的方法不是在光度场重建中使用完全隐含的射线代表, 而是采用含有密度和颜色特征特征的显像体。 此外, 我们用光谱的光谱输入和摄像头来测试我们的方法, 将包含复杂地理和外景的图像, 我们用真实的图像来测试我们的方法。