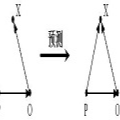

Conventional Supervised Learning approaches focus on the mapping from input features to output labels. After training, the learnt models alone are adapted onto testing features to predict testing labels in isolation, with training data wasted and their associations ignored. To take full advantage of the vast number of training data and their associations, we propose a novel learning paradigm called Memory-Associated Differential (MAD) Learning. We first introduce an additional component called Memory to memorize all the training data. Then we learn the differences of labels as well as the associations of features in the combination of a differential equation and some sampling methods. Finally, in the evaluating phase, we predict unknown labels by inferencing from the memorized facts plus the learnt differences and associations in a geometrically meaningful manner. We gently build this theory in unary situations and apply it on Image Recognition, then extend it into Link Prediction as a binary situation, in which our method outperforms strong state-of-the-art baselines on ogbl-ddi dataset.

翻译:常规监督学习方法侧重于从输入特征到输出标签的绘图。 培训后, 仅学习的模型就被调整为测试特征, 以预测孤立的标签, 培训数据被浪费, 他们的协会被忽略。 为了充分利用大量的培训数据及其协会, 我们提出一个新的学习模式, 称为记忆- 联合差异学习( MAD) 。 我们首先引入一个名为记忆的附加元素, 以记住所有培训数据 。 然后我们学习了标签的差异, 以及不同方程式和一些抽样方法组合中特征的关联。 最后, 在评估阶段, 我们通过从记忆化事实推算出未知的标签, 加上以具有几何意义的方式所学的差别和关联 。 我们轻轻地构建了这个理论, 并将其应用到图像识别上, 然后将它扩展到链接中, 将它作为一种二元情况, 我们的方法超越了 ogbl- ddi 数据集 的强大状态- 基线 。