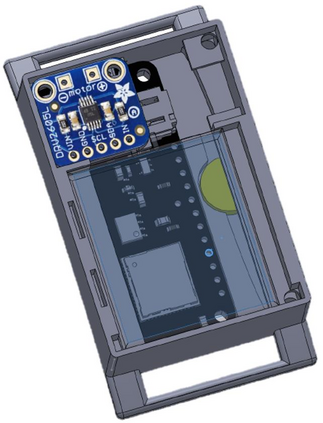

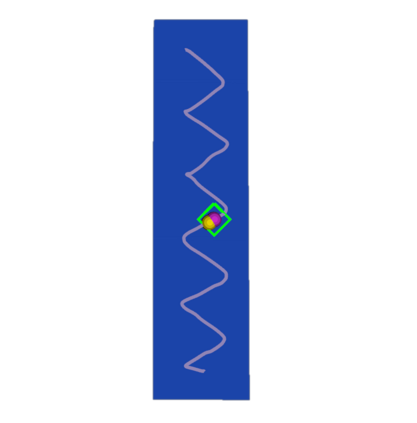

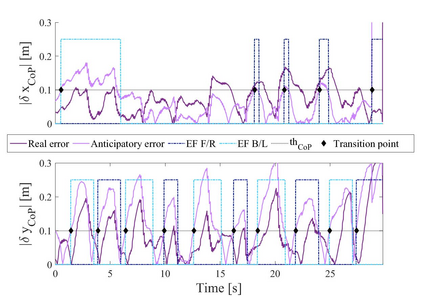

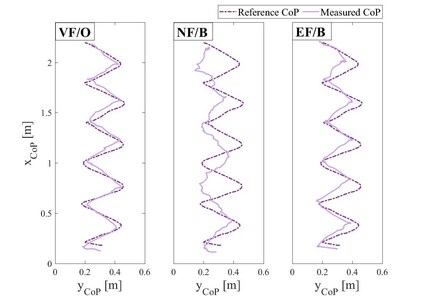

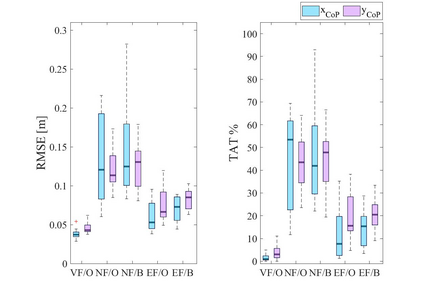

Balance and gait disorders are the second leading cause of falls, which, along with consequent injuries, are reported as major public health problems all over the world. For patients who do not require mechanical support, vibrotactile feedback interfaces have proven to be a successful approach in restoring balance. Most of the existing strategies assess trunk or head tilt and velocity or plantar forces, and are limited to the analysis of stance. On the other hand, central to balance control is the need to maintain the body's centre of pressure (CoP) within feasible limits of the support polygon (SP), as in standing, or on track to a new SP, as in walking. Hence, this paper proposes an exploratory study to investigate whether vibrotactile feedback can be employed to lead human CoP during walking. The ErgoTac-Belt vibrotactile device is introduced to instruct the users about the direction to take, both in the antero-posterior and medio-lateral axes. An anticipatory strategy is adopted here, to give the users enough time to react to the stimuli. Experiments on ten healthy subjects demonstrated the promising capability of the proposed device to guide the users' CoP along a predefined reference path, with similar performance as the one achieved with visual feedback. Future developments will investigate our strategy and device in guiding the CoP of elderly or individuals with vestibular impairments, who may not be aware of or, able to figure out, a safe and ergonomic CoP path.

翻译:平衡和动作障碍是下降的第二大原因,与随之而来的伤害一起,被报告为世界各地主要的公共健康问题。对于不需要机械支持的病人来说,振动活性反馈界面被证明是恢复平衡的成功方法。大多数现有战略评估了树干或头倾斜和速度或计划力,并局限于对姿态的分析。另一方面,平衡控制的核心是需要在支持多边形(SP)的可行限度内维持身体的压力中心(CoP),如在站立或行走时,使用户有足够的时间对新的SP(SP)作出反应。因此,本文件提议进行一项探索性研究,以调查是否使用振动性反应反馈来引导人类的 CoP 步态。ErgoTac-Belt 振动动动装置被引入了向用户提供方向的指令,无论是在前台和中轴中,都可以让用户有足够的时间来对新的SP进行响应。在10个健康主题上进行实验,可以预见到我们之前的Copreficial 战略的发展, 将展示我们所实现的Cocial 方向, 和Cocial areal developal areal view vial view view vidududududududududu view