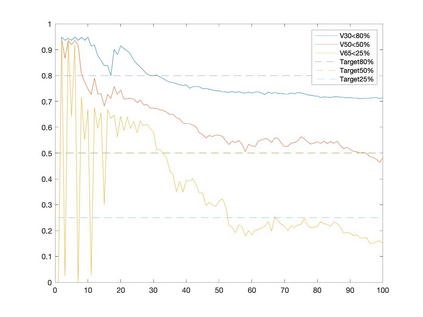

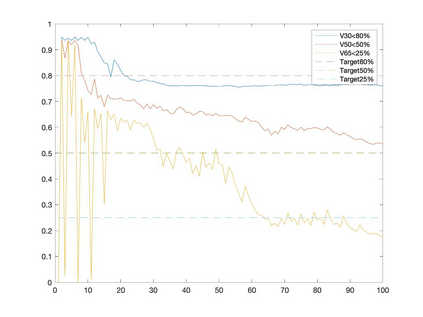

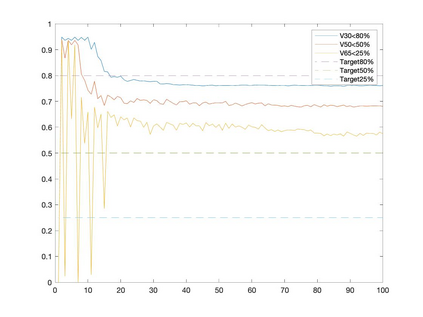

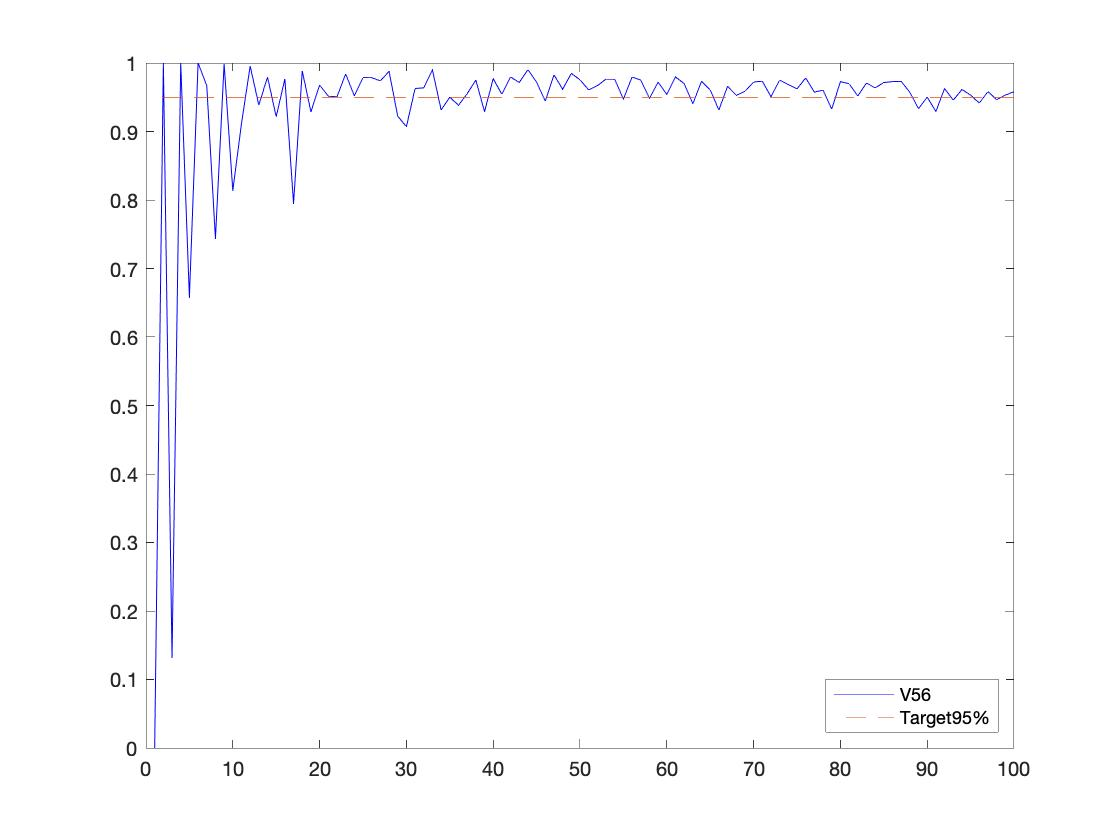

Conditional gradient methods have attracted much attention in both machine learning and optimization communities recently. These simple methods can guarantee the generation of sparse solutions. In addition, without the computation of full gradients, they can handle huge-scale problems sometimes even with an exponentially increasing number of decision variables. This paper aims to significantly expand the application areas of these methods by presenting new conditional gradient methods for solving convex optimization problems with general affine and nonlinear constraints. More specifically, we first present a new constraint extrapolated condition gradient (CoexCG) method that can achieve an ${\cal O}(1/\epsilon^2)$ iteration complexity for both smooth and structured nonsmooth function constrained convex optimization. We further develop novel variants of CoexCG, namely constraint extrapolated and dual regularized conditional gradient (CoexDurCG) methods, that can achieve similar iteration complexity to CoexCG but allow adaptive selection for algorithmic parameters. We illustrate the effectiveness of these methods for solving an important class of radiation therapy treatment planning problems arising from healthcare industry. To the best of our knowledge, all the algorithmic schemes and their complexity results are new in the area of projection-free methods.

翻译:条件梯度方法最近在机器学习和优化社区引起许多注意。这些简单方法可以保证产生稀有的解决方案。此外,不计算完整的梯度,它们有时甚至随着决定变量的成倍增长而处理巨大的问题。本文件的目的是通过提出新的有条件梯度方法,通过提供新的有条件梯度方法,解决具有一般偏角和非线性限制的锥形优化问题,大大扩大这些方法的应用领域。更具体地说,我们首先提出了一种新的限制外推条件梯度(CoexCG)方法,该方法可以实现美元/cal O}(1/\ epsilon ⁇ 2),而光滑和结构化的非moz函数的迭代复杂度都制约了convex优化。我们进一步开发了CoexCG的新的变体,即限制外推法和双重固定的有条件梯度(CoexDurCG)方法,这可以实现与CoexCG的相近的迭代复杂性,但允许对算法参数进行适应性选择。我们说明了这些方法在解决保健工业产生的重要辐射疗法治疗规划问题方面的有效性。我们最了解的是,所有算法方法及其复杂程度。