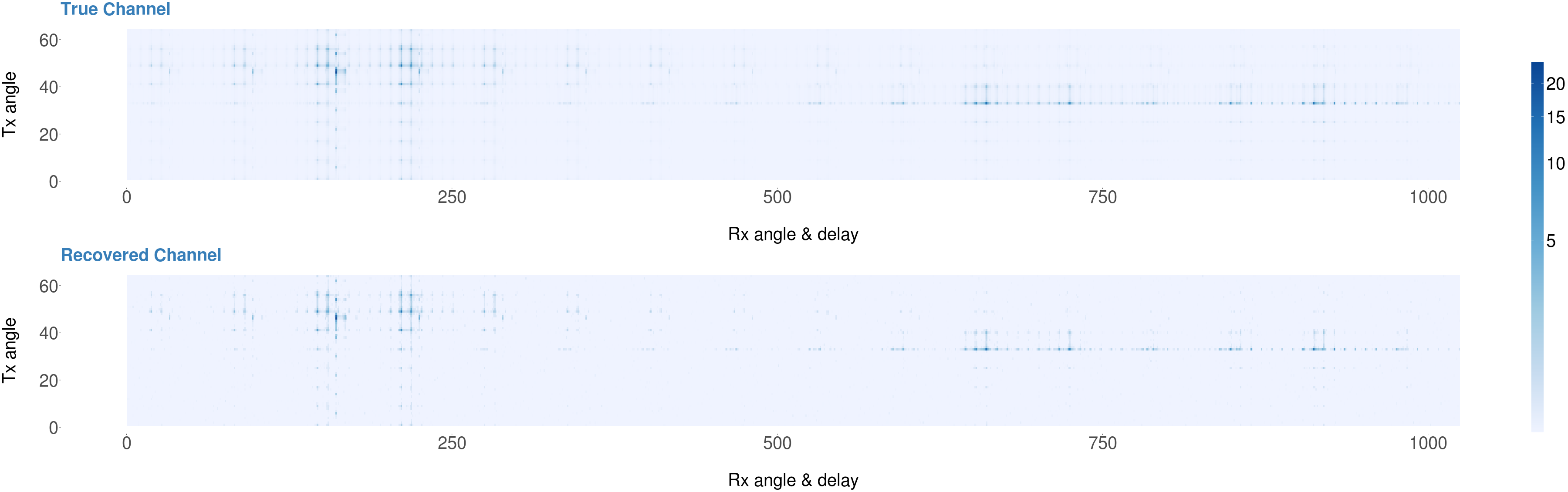

In order to reduce hardware complexity and power consumption, massive multiple-input multiple-output (MIMO) systems employ low-resolution analog-to-digital converters (ADCs) to acquire quantized measurements $\boldsymbol y$. This poses new challenges to the channel estimation problem, and the sparse prior on the channel coefficient vector $\boldsymbol x$ in the angle domain is often used to compensate for the information lost during quantization. By interpreting the sparse prior from a probabilistic perspective, we can assume $\boldsymbol x$ follows certain sparse prior distribution and recover it using approximate message passing (AMP). However, the distribution parameters are unknown in practice and need to be estimated. Due to the increased computational complexity in the quantization noise model, previous works either use an approximated noise model or manually tune the noise distribution parameters. In this paper, we treat both signals and parameters as random variables and recover them jointly within the AMP framework. The proposed approach leads to a much simpler parameter estimation method, allowing us to work with the quantization noise model directly. Experimental results show that the proposed approach achieves state-of-the-art performance under various noise levels and does not require parameter tuning, making it a practical and maintenance-free approach for channel estimation.

翻译:为了减少硬件的复杂性和电力消耗量,大型多投入多产出(MIMO)系统采用低分辨率模拟数字转换器(ADCs)获取量化测量值$\boldsymbol y$。这给频道估计问题带来了新的挑战,在角域中,频道系数矢量矢量 $\boldsymbol x$的稀疏程度通常被用来补偿在四分化过程中丢失的信息。从概率学的角度来解释先前的稀疏程度,我们可以假定$\boldsymbol x$遵循某些稀疏的先前分配方法,并利用近似信息传递(AMP)进行回收。然而,分配参数在实践中并不为人所知,需要估算。由于对频道噪音模型的计算复杂性增加,以前的工作要么使用近似噪音模型,要么手工调和噪音分布参数。在AMP框架内,我们将信号和参数视为随机变量,并共同回收。拟议的方法导致一种简单得多的参数估计方法,让我们能够直接使用定量噪音模型(AMP)进行工作。实验性观测结果显示,在节流度评估方法下,要求达到一种不直接进行实际的状态。