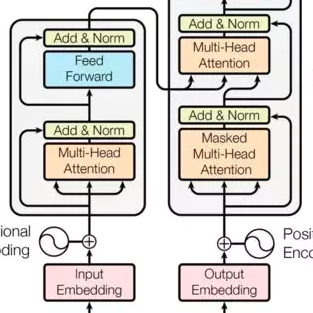

With the development of deep learning (DL), natural language processing (NLP) makes it possible for us to analyze and understand a large amount of language texts. Accordingly, we can achieve a semantic communication in terms of joint semantic source and channel coding over a noisy channel with the help of NLP. However, the existing method to realize this goal is to use a fixed transformer of NLP while ignoring the difference of semantic information contained in each sentence. To solve this problem, we propose a new semantic communication system based on Universal Transformer. Compared with the traditional transformer, an adaptive circulation mechanism is introduced in the Universal Transformer. Through the introduction of the circulation mechanism, the new semantic communication system can be more flexible to transmit sentences with different semantic information, and achieve better end-to-end performance under various channel conditions.

翻译:随着深入学习(DL)的发展,自然语言处理(NLP)使我们有可能分析和理解大量语言文本,因此,我们可以在NLP的帮助下,通过联合语义源和在噪音频道的频道编码实现语义交流。然而,实现这一目标的现有方法是使用NLP固定变压器,同时忽略每句话所含语义信息的差异。为了解决这一问题,我们提议了一个新的语义交流系统,该系统以通用变压器为基础。与传统的变压器相比,在通用变压器中引入了适应性循环机制。通过引入循环机制,新的语义通信系统可以更加灵活地以不同的语义信息传输句,并在不同的频道条件下实现更好的端对端性功能。