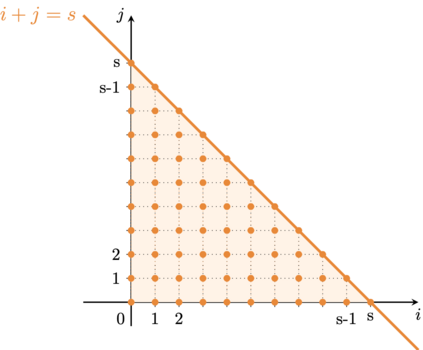

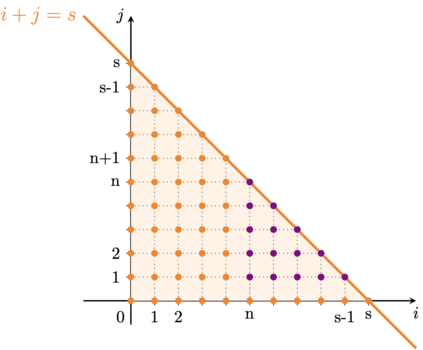

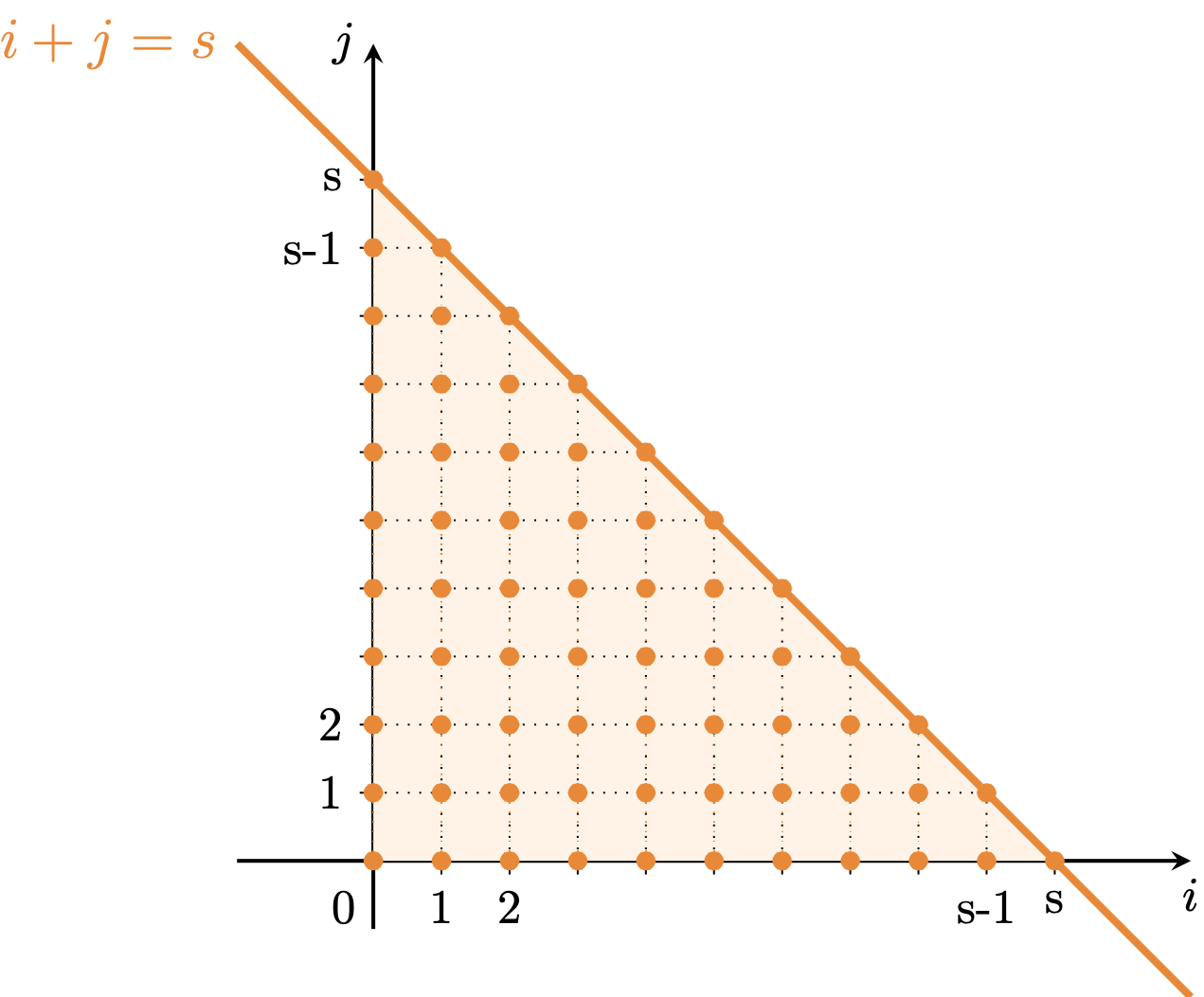

Many decisions involve choosing an uncertain course of actions in deep and wide decision trees, as when we plan to visit an exotic country for vacation. In these cases, exhaustive search for the best sequence of actions is not tractable due to the large number of possibilities and limited time or computational resources available to make the decision. Therefore, planning agents need to balance breadth (exploring many actions at each level of the tree) and depth (exploring many levels in the tree) to allocate optimally their finite search capacity. We provide efficient analytical solutions and numerical analysis to the problem of allocating finite sampling capacity in one shot to large decision trees. We find that in general the optimal policy is to allocate few samples per level so that deep levels can be reached, thus favoring depth over breadth search. In contrast, in poor environments and at low capacity, it is best to broadly sample branches at the cost of not sampling deeply, although this policy is marginally better than deep allocations. Our results provide a theoretical foundation for the optimality of deep imagination for planning and show that it is a generally valid heuristic that could have evolved from the finite constraints of cognitive systems.

翻译:许多决定涉及在深海和宽阔的决策树上选择不确定的行动方针,就像我们计划访问一个奇特的度假国家时那样。在这些情况下,全面寻找最佳的行动顺序是无法做到的,因为有许多可能性和有限的时间或计算资源可供作出决定。因此,规划人员需要平衡宽度(在树的每个层次上探索许多行动)和深度(在树的许多层次上探索许多行动)和深度(在树的很多层次上探索许多行动),以最佳的方式分配其有限的搜索能力。我们为将一针中有限的采样能力分配给大型决策树的问题提供了有效的分析解决办法和数字分析。我们发现,总体而言,最佳政策是分配少量的样本,以便达到深度,从而有利于深度搜索。相比之下,在恶劣的环境和低容量的情况下,最好是以不深入采样的成本广泛采样分支,尽管这一政策比深度分配要好得多。我们的结果为规划的深刻想象力的最佳性提供了理论基础,并表明,从认知系统的有限限制中可以演变出一种普遍有效的超自然现象。