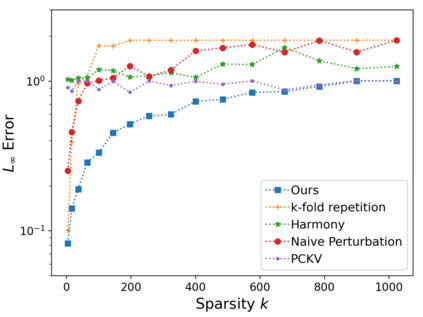

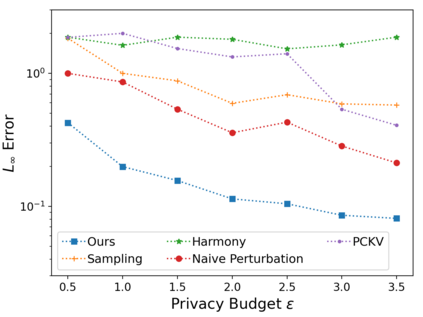

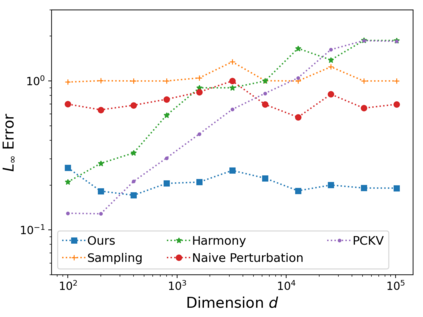

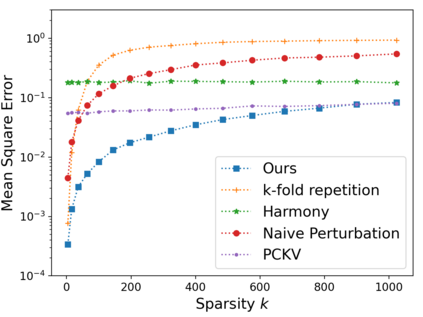

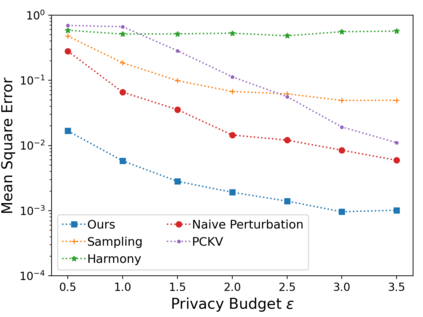

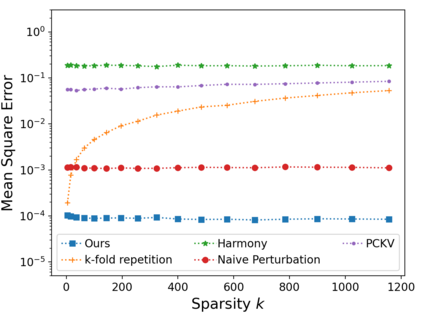

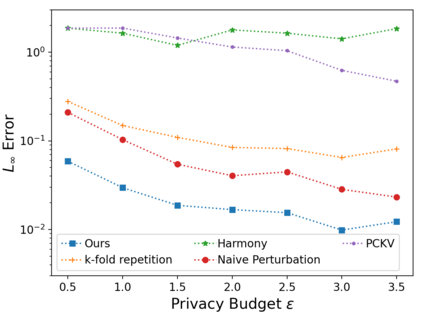

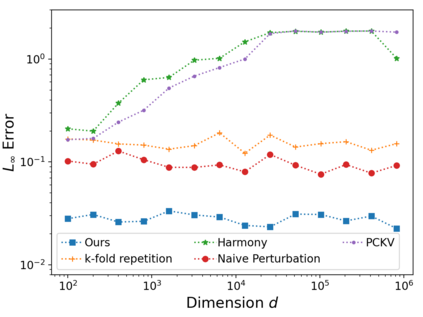

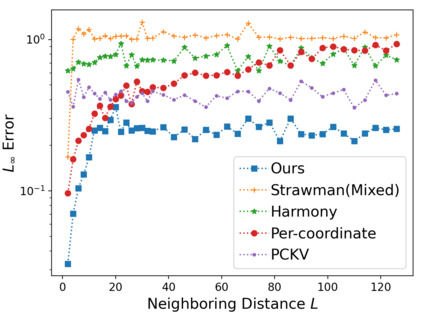

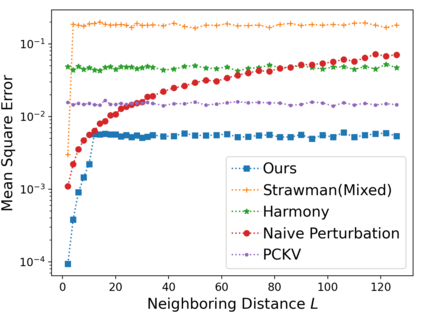

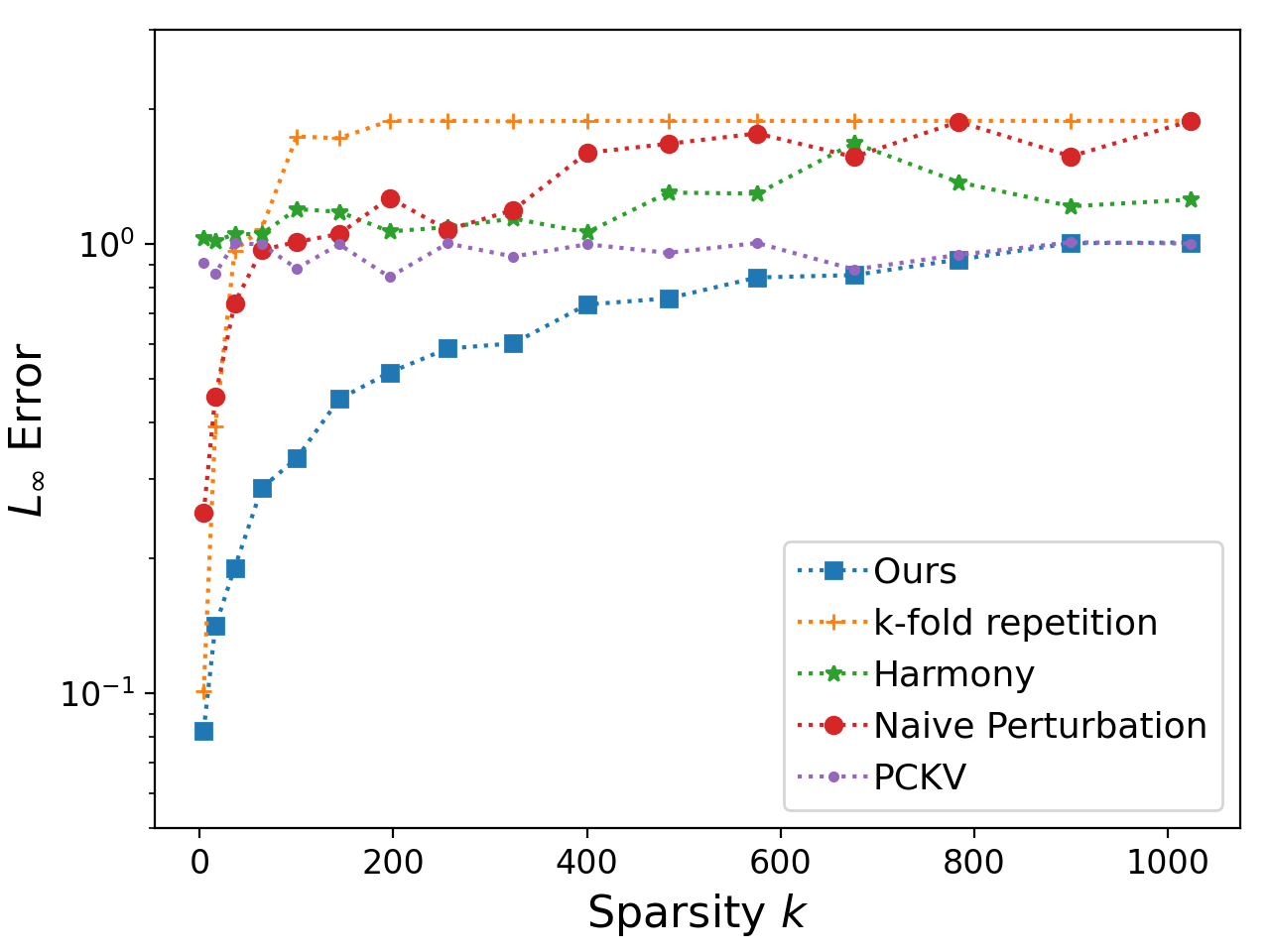

Vector mean estimation is a central primitive in federated analytics. In vector mean estimation, each user $i \in [n]$ holds a real-valued vector $v_i\in [-1, 1]^d$, and a server wants to Not only so, we would like to protect each individual user's privacy. In this paper, we consider the $k$-sparse version of the vector mean estimation problem, that is, suppose that each user's vector has at most $k$ non-zero coordinates in its $d$-dimensional vector, and moreover, $k \ll d$. In practice, since the universe size $d$ can be very large (e.g., the space of all possible URLs), we would like the per-user communication to be succinct, i.e., independent of or (poly-)logarithmic in the universe size. In this paper, we are the first to show matching upper- and lower-bounds for the $k$-sparse vector mean estimation problem under local differential privacy. Specifically, we construct new mechanisms that achieve asymptotically optimal error as well as succinct communication, either under user-level-LDP or event-level-LDP. We implement our algorithms and evaluate them on synthetic as well as real-world datasets. Our experiments show that we can often achieve one or two orders of magnitude reduction in error in comparison with prior works under typical choices of parameters, while incurring insignificant communication cost.

翻译:矢量平均值估算是联合分析中的核心原始值。 在矢量平均值估算中,每个用户 $ $ $ $ $ $ 以 [, [ 1, 1] 美元, 一个服务器想要不仅保护每个用户的隐私, 我们还希望保护每个用户的隐私。 在本文中, 我们认为矢量平均估算问题的偏差版本是 $-k$ 偏差的, 也就是说, 假设每个用户的矢量在美元- 维向量的矢量中, 最多为 $- 美元- 非 零 坐标, 此外, $ k = 美元 美元 美元 。 实际上, 由于宇宙的值参数值可能非常大( 例如, 所有可能的 URL 空间), 并且服务器不仅如此, 我们还希望每个用户的通信简洁, 也就是独立于或( poly) logicalth) 的矢量问题。 在本文中, 我们首先显示 $- 美元- sparent 矢量矢量矢量矢量 的坐标是 在地方差异隐私下的估算问题 。 。 。 具体地, 我们在 的通信级 中建新的机制中, 在 之前的逻辑- 或 一级, 我们的逻辑级的逻辑级的逻辑级级级级级级级级级级级的 中, 显示我们 的逻辑级级级级级级级级的 的 的 或 的 级级级级级级级 显示我们 的 的 的 的 的 级级级级级程 级程 的 的 级程 级程 级程 级程 级程 级程 级程 级程 级程 级程, 级程 级程 级程 级程 级程 级程 级程 级程 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级程 级程 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级 级次 级 级 级 级 级 级 级 级 级