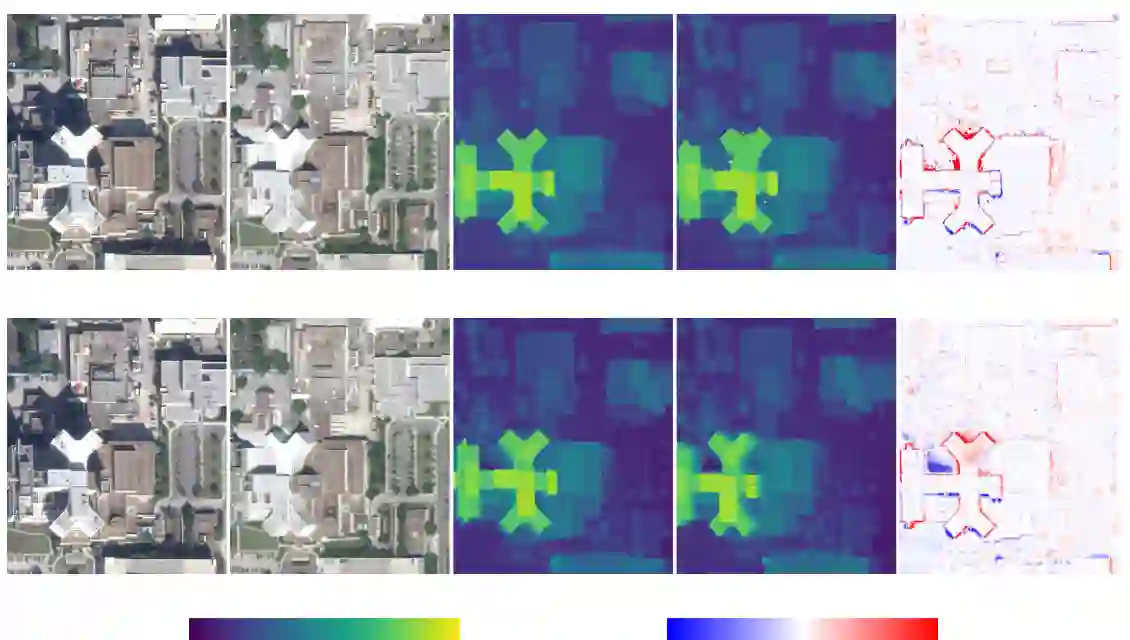

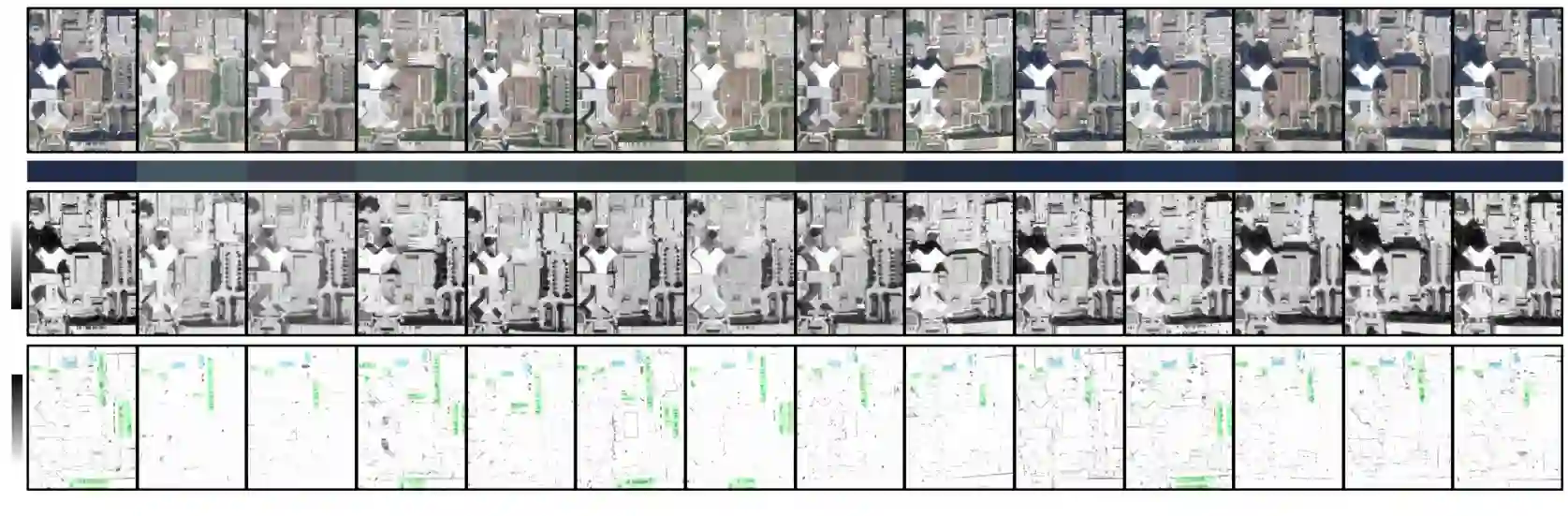

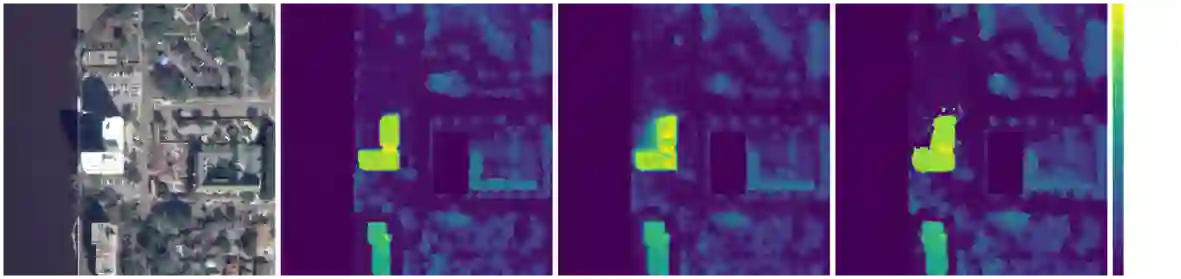

We introduce the Satellite Neural Radiance Field (Sat-NeRF), a new end-to-end model for learning multi-view satellite photogrammetry in the wild. Sat-NeRF combines some of the latest trends in neural rendering with native satellite camera models, represented by rational polynomial coefficient (RPC) functions. The proposed method renders new views and infers surface models of similar quality to those obtained with traditional state-of-the-art stereo pipelines. Multi-date images exhibit significant changes in appearance, mainly due to varying shadows and transient objects (cars, vegetation). Robustness to these challenges is achieved by a shadow-aware irradiance model and uncertainty weighting to deal with transient phenomena that cannot be explained by the position of the sun. We evaluate Sat-NeRF using WorldView-3 images from different locations and stress the advantages of applying a bundle adjustment to the satellite camera models prior to training. This boosts the network performance and can optionally be used to extract additional cues for depth supervision.

翻译:我们引入了卫星神经辐射场(Sat-NERF),这是在野外学习多视卫星摄影测量的一个新的端到端模型。Sat-NERF将神经成像的一些最新趋势与以理性多元系数(RPC)功能为代表的本地卫星照相机模型结合起来。拟议方法提供了与传统先进立体管道获得的相近质量的新观点和推断表层模型。多日期图像在外观上出现了重大变化,主要由于阴影和瞬时物体(汽车、植被)不同。通过一种阴影觉察辐照模型和不确定性来应对那些无法用太阳位置解释的瞬变现象,可以实现这些挑战的强健性。我们利用不同地点的世界展望-3图像对Sat-NERF进行评估,并强调在培训之前对卫星摄影机模型进行捆绑调整的好处。这提高了网络的性能,并且可以选用其他提示来进行深度监督。