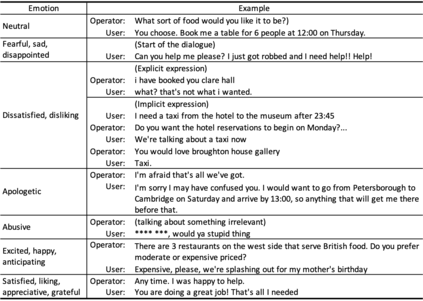

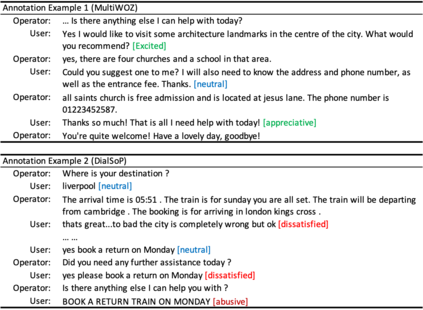

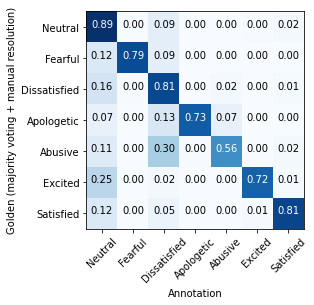

The ability to recognise emotions lends a conversational artificial intelligence a human touch. While emotions in chit-chat dialogues have received substantial attention, emotions in task-oriented dialogues have been largely overlooked despite having an equally important role, such as to signal failure or success. Existing emotion-annotated task-oriented corpora are limited in size, label richness, and public availability, creating a bottleneck for downstream tasks. To lay a foundation for studies on emotions in task-oriented dialogues, we introduce EmoWOZ, a large-scale manually emotion-annotated corpus of task-oriented dialogues. EmoWOZ is based on MultiWOZ, a multi-domain task-oriented dialogue dataset. It contains more than 11K dialogues with more than 83K emotion annotations of user utterances. In addition to Wizzard-of-Oz dialogues from MultiWOZ, we collect human-machine dialogues within the same set of domains to sufficiently cover the space of various emotions that can happen during the lifetime of a data-driven dialogue system. To the best of our knowledge, this is the first large-scale open-source corpus of its kind. We propose a novel emotion labelling scheme, which is tailored to task-oriented dialogues. We report a set of experimental results to show the usability of this corpus for emotion recognition and state tracking in task-oriented dialogues.

翻译:认识情感的能力使人能够理解一种对话的人工智能。虽然在聊天对话中,情绪受到大量关注,但任务导向对话中的情绪尽管具有同样重要的作用,例如信号失败或成功,但基本上被忽略。现有的情绪附加说明的任务导向团体在规模、标签丰富性和公众可用性方面都有限,为下游任务制造瓶颈。为了在任务导向的对话中为情感研究奠定基础,我们引入了EmoWOZ,这是一个大规模人工情感附加说明式任务导向对话的集合。EmoWOZ以多功能面向任务的对话数据集为基础。它包含超过11K的对话,其用户语气说明超过83K。除了来自多功能团队的Wizard-Ozz对话之外,我们还收集了同一系列的人类机器对话,以充分覆盖在数据驱动的对话系统存续期间可能发生的各种情感空间。我们最了解的是,这是其同类对话的第一个大规模开源数据集。我们提议了一种面向情感导向性对话的新任务定位,我们提出了一种面向感官对话的定位系统。我们将一个面向感官感官对话的跟踪性任务定位,以展示我们的任务定位为目的。