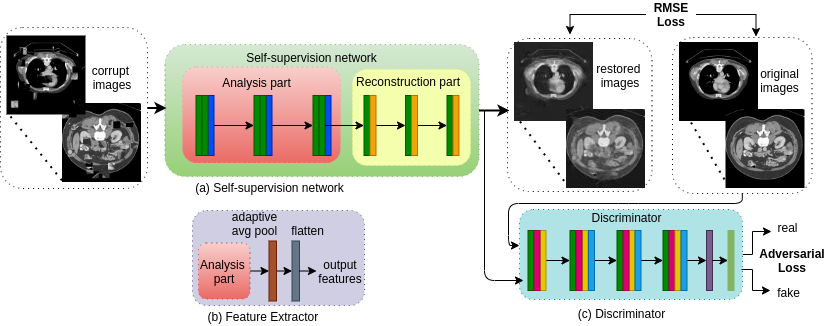

Non-alcoholic fatty liver disease (NAFLD) is one of the most common causes of chronic liver diseases (CLD) which can progress to liver cancer. The severity and treatment of NAFLD is determined by NAFLD Activity Scores (NAS)and liver fibrosis stage, which are usually obtained from liver biopsy. However, biopsy is invasive in nature and involves risk of procedural complications. Current methods to predict the fibrosis and NAS scores from noninvasive CT images rely heavily on either a large annotated dataset or transfer learning using pretrained networks. However, the availability of a large annotated dataset cannot be always ensured andthere can be domain shifts when using transfer learning. In this work, we propose a self-supervised learning method to address both problems. As the NAFLD causes changes in the liver texture, we also propose to use texture encoded inputs to improve the performance of the model. Given a relatively small dataset with 30 patients, we employ a self-supervised network which achieves better performance than a network trained via transfer learning. The code is publicly available at https://github.com/ananyajana/fibrosis_code.

翻译:非酒精脂肪肝病(NAFLD)是慢性肝脏疾病(CLD)的最常见病因之一,这种慢性肝脏疾病可以发展到肝癌,其严重程度和治疗方式由NAFLD活动分数和肝纤维化阶段确定,通常从肝脏活性检查中得来,但是,生物检查具有侵入性质,并涉及程序并发症的风险。目前预测纤维化和NAS从非侵入性CT图像中得分的方法主要依靠的是大型附加说明的数据集,或利用预先培训的网络进行转移学习。然而,无法始终确保提供大型附加说明的数据集,在使用转移学习时可以进行域变换。在这项工作中,我们提出了一种自我监督的学习方法来解决这两个问题。由于NAFLD造成肝质素变化,我们还提议使用文字编码输入来改进模型的性能。鉴于30名病人的数据集相对较小,我们使用自封的网络,其性能比通过转移学习训练的网络要好。在httpsbrofor_gian_aganbus.com上公开提供代码。