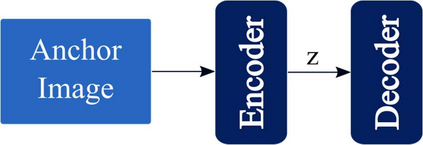

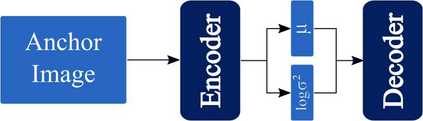

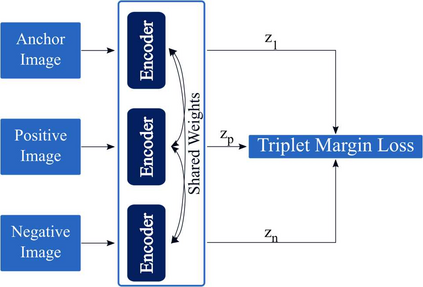

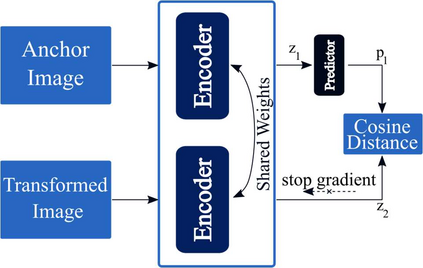

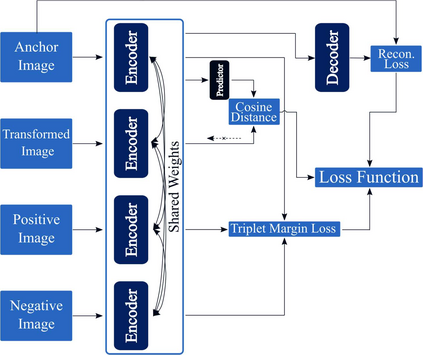

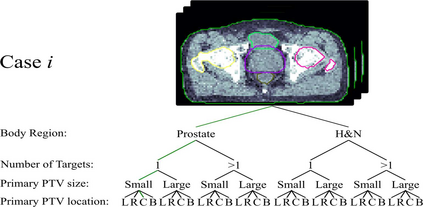

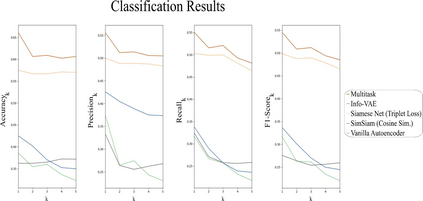

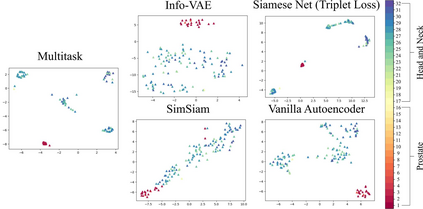

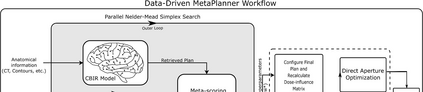

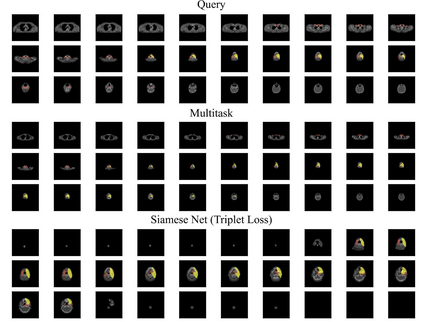

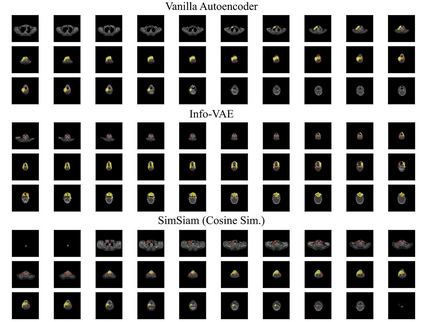

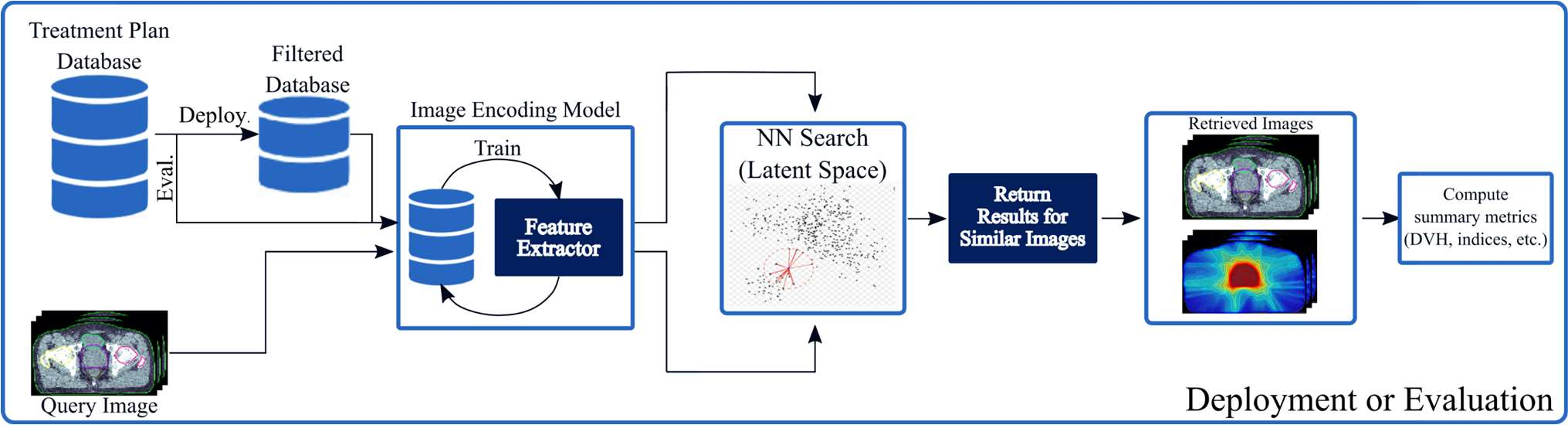

Objective: Knowledge based planning (KBP) typically involves training an end-to-end deep learning model to predict dose distributions. However, training end-to-end methods may be associated with practical limitations due to the limited size of medical datasets that are often used. To address these limitations, we propose a content based image retrieval (CBIR) method for retrieving dose distributions of previously planned patients based on anatomical similarity. Approach: Our proposed CBIR method trains a representation model that produces latent space embeddings of a patient's anatomical information. The latent space embeddings of new patients are then compared against those of previous patients in a database for image retrieval of dose distributions. All source code for this project is available on github. Main Results: The retrieval performance of various CBIR methods is evaluated on a dataset consisting of both publicly available plans and clinical plans from our institution. This study compares various encoding methods, ranging from simple autoencoders to more recent Siamese networks like SimSiam, and the best performance was observed for the multitask Siamese network. Significance: Applying CBIR to inform subsequent treatment planning potentially addresses many limitations associated with end-to-end KBP. Our current results demonstrate that excellent image retrieval performance can be obtained through slight changes to previously developed Siamese networks. We hope to integrate CBIR into automated planning workflow in future works, potentially through methods like the MetaPlanner framework.

翻译:目标:基于知识的规划(KBP)通常涉及培训一个端到端深学习模型,以预测剂量分布。然而,由于经常使用的医疗数据集数量有限,培训端到端方法可能与实际限制相联系。为解决这些限制,我们提出一个基于内容的图像检索(CBIR)方法,用于在解剖相似性的基础上检索先前计划病人的剂量分布。方法:我们提议的CBIR方法培训一个代表模型,该模型产生一种潜在的空间嵌入病人解剖信息。然后,将新病人的潜在空间嵌入与以前病人在图像剂量分布检索数据库中的空间相比较。该项目的所有源代码都可以在 guthub上查阅。主要结果:根据一个数据集,包括我们机构的公开计划和临床计划。这项研究将各种编码方法进行比较,从简单的自动解析器到较近的SimSiaimSiam这样的Siam网络,以及观察到的多个多塔·西亚内流框架的最佳运行状态,然后将Siame-riend 网络的图像整合结果进行比较。