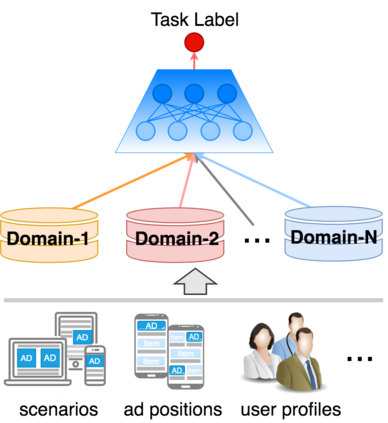

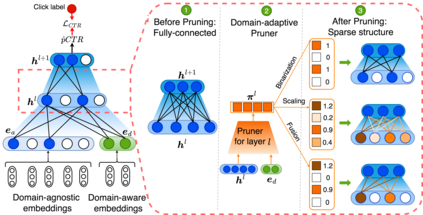

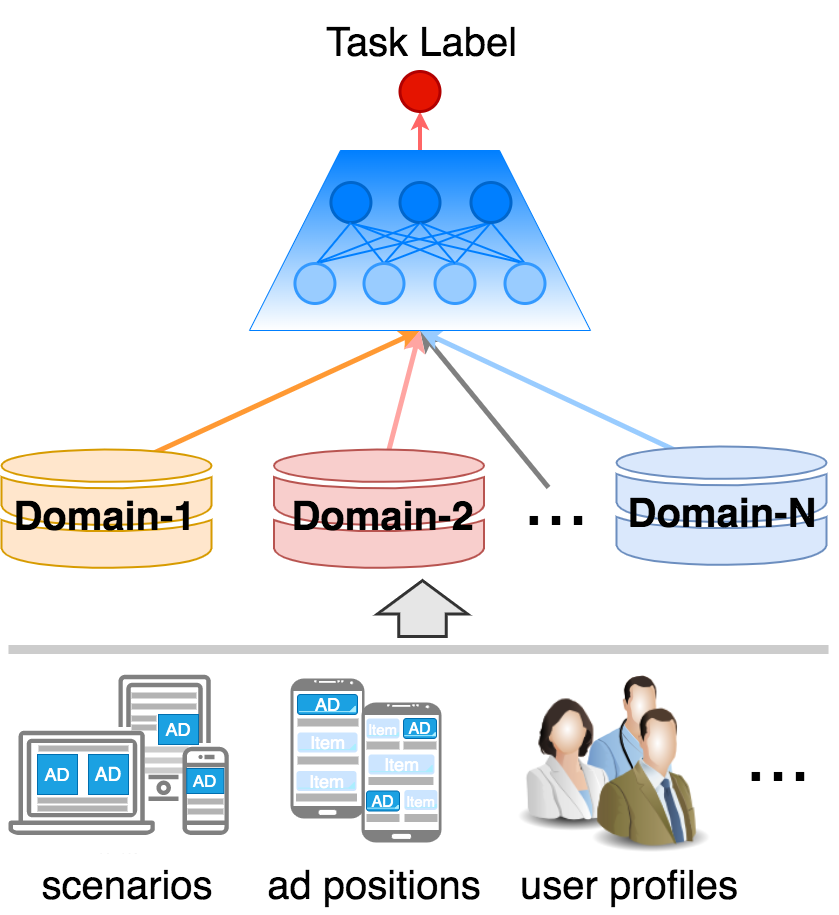

Click-through rate (CTR) prediction is a fundamental technique in recommendation and advertising systems. Recent studies have proved that learning a unified model to serve multiple domains is effective to improve the overall performance. However, it is still challenging to improve generalization across domains under limited training data, and hard to deploy current solutions due to their computational complexity. In this paper, we propose a simple yet effective framework AdaSparse for multi-domain CTR prediction, which learns adaptively sparse structure for each domain, achieving better generalization across domains with lower computational cost. In AdaSparse, we introduce domain-aware neuron-level weighting factors to measure the importance of neurons, with that for each domain our model can prune redundant neurons to improve generalization. We further add flexible sparsity regularizations to control the sparsity ratio of learned structures. Offline and online experiments show that AdaSparse outperforms previous multi-domain CTR models significantly.

翻译:点击率( CTR) 预测是建议和广告系统的一项基本技术。 最近的研究表明, 学习一个统一的模型为多个领域服务对于提高总体性能是有效的。 然而, 在有限的培训数据下, 改进对各领域的通用化, 以及由于计算的复杂性而难以部署当前解决方案, 仍然是个挑战。 在本文中, 我们提出了一个简单而有效的框架 AdaSparse, 用于多域 CTR 预测, 它为每个领域学习适应性分散的结构, 以较低的计算成本更好地实现跨域的通用化。 在 AdaSparse 中, 我们引入了域内觉神经元的加权系数, 以衡量神经元的重要性, 而对于每个领域, 我们的模型可以模拟冗余神经元, 来改进一般化。 我们进一步添加灵活的宽度规范, 以控制所学结构的宽度比例。 离线和在线实验显示, AdaSparse 显著地超越了以前的多域 CTR 模型 。