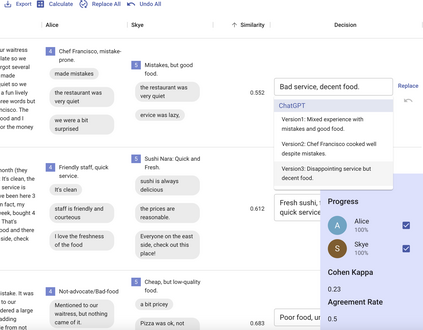

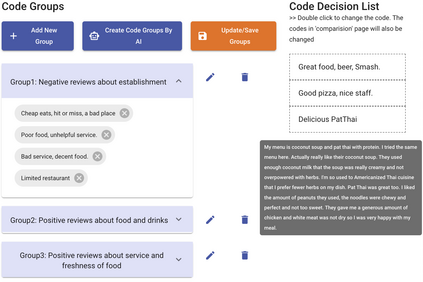

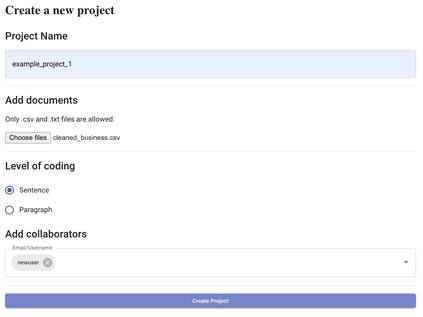

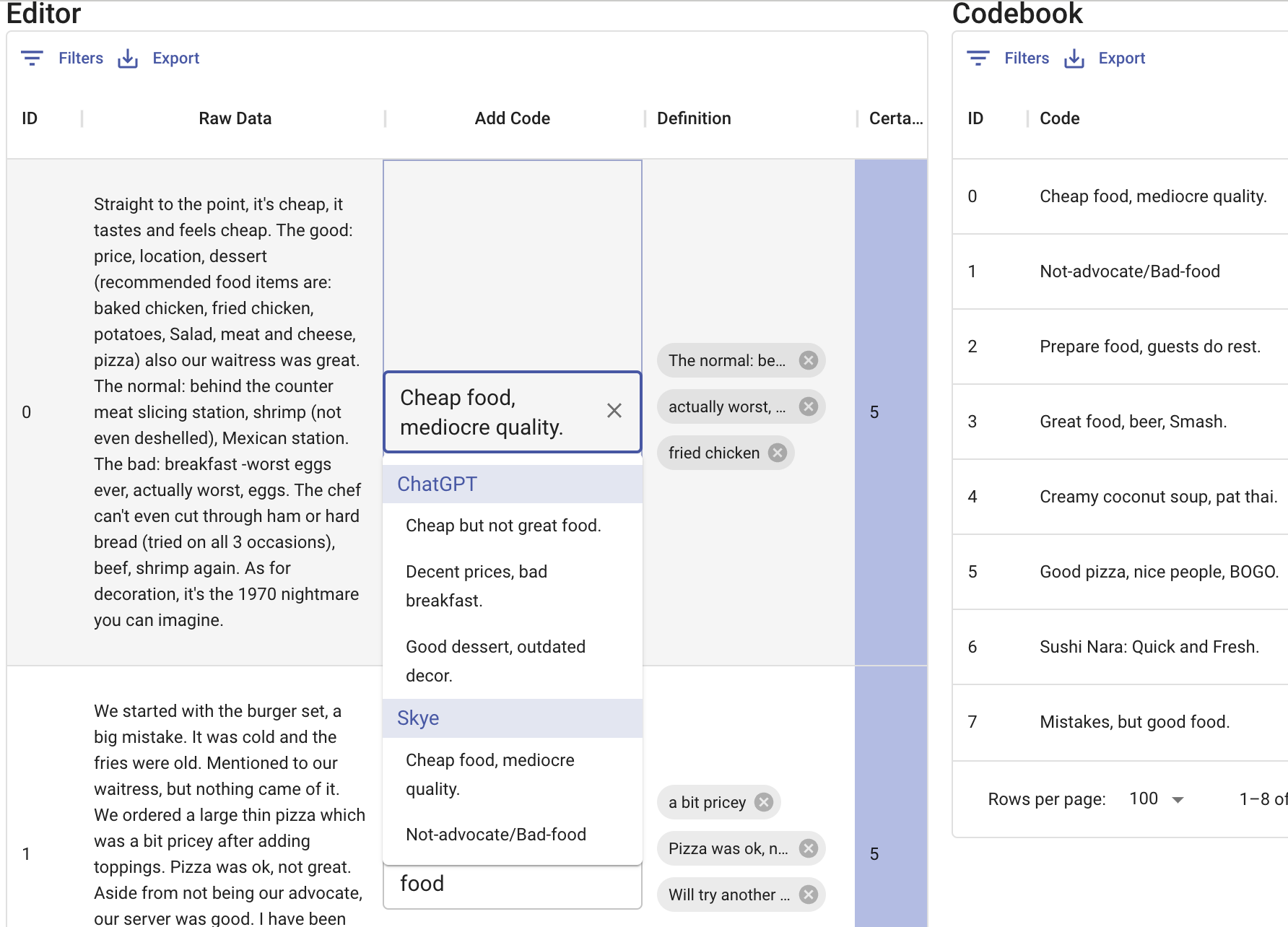

The Collaborative Qualitative Analysis (CQA) process can be time-consuming and resource-intensive, requiring multiple discussions among team members to refine codes and ideas before reaching a consensus. To address these challenges, we introduce CollabCoder, a system leveraging Large Language Models (LLMs) to support three CQA stages: independent open coding, iterative discussions, and the development of a final codebook. In the independent open coding phase, CollabCoder provides AI-generated code suggestions on demand, and allows users to record coding decision-making information (e.g. keywords and certainty) as support for the process. During the discussion phase, CollabCoder helps to build mutual understanding and productive discussion by sharing coding decision-making information with the team. It also helps to quickly identify agreements and disagreements through quantitative metrics, in order to build a final consensus. During the code grouping phase, CollabCoder employs a top-down approach for primary code group recommendations, reducing the cognitive burden of generating the final codebook. An evaluation involving 16 users confirmed the usability and effectiveness of CollabCoder and offered empirical insights into the LLMs' roles in CQA.

翻译:协同定性分析(CQA)的过程可能耗时,耗费资源,需要团队成员多次讨论才能在达成共识之前改进代码和思想。为解决这些挑战,我们引入了 CollabCoder,这是一个基于大语言模型(LLM)的系统,支持三个CQA阶段:独立的开放式编码,迭代讨论和开发最终代码簿。在独立的开放编码阶段,CollabCoder根据需要提供人工智能生成的代码建议,并允许用户记录编码决策信息(例如关键字和确定性)作为支持过程。在讨论阶段,CollabCoder通过与团队共享编码决策信息,帮助建立相互理解和生产性的讨论。它还通过定量度量帮助快速确定协议和不协议,以建立最终的共识。在代码分组阶段,CollabCoder采用自上而下的方法进行主要代码组建议,从而减轻了生成最终代码簿的认知负担。涉及16名用户的评估证实了CollabCoder的可用性和有效性,并提供了LLM在CQA中的实证见解。