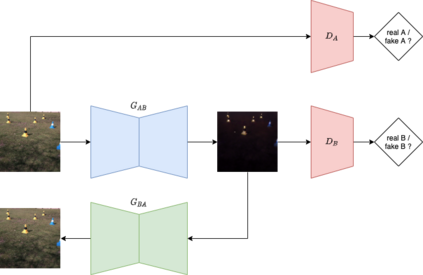

In an autonomous driving system, perception - identification of features and objects from the environment - is crucial. In autonomous racing, high speeds and small margins demand rapid and accurate detection systems. During the race, the weather can change abruptly, causing significant degradation in perception, resulting in ineffective manoeuvres. In order to improve detection in adverse weather, deep-learning-based models typically require extensive datasets captured in such conditions - the collection of which is a tedious, laborious, and costly process. However, recent developments in CycleGAN architectures allow the synthesis of highly realistic scenes in multiple weather conditions. To this end, we introduce an approach of using synthesised adverse condition datasets in autonomous racing (generated using CycleGAN) to improve the performance of four out of five state-of-the-art detectors by an average of 42.7 and 4.4 mAP percentage points in the presence of night-time conditions and droplets, respectively. Furthermore, we present a comparative analysis of five object detectors - identifying the optimal pairing of detector and training data for use during autonomous racing in challenging conditions.

翻译:在一个自主的驱动系统中,感知——确定环境的特征和物体——是至关重要的。在自主赛中,高速和小边距要求快速和准确的探测系统。在赛跑中,天气会突然变化,导致感知严重退化,导致低效的动作。为了改进对不利天气的探测,深学习模型通常要求在这种条件下收集大量数据集,收集数据的过程既乏味、繁琐又昂贵。然而,循环GAN结构的最近发展使得在多种天气条件下能够合成高度现实的场景。为此,我们采用了一种在自主赛中使用综合不良状态数据集(使用CyelGAN生成)的方法,在夜间条件和滴条件下,分别平均用42.7和4.4 mAP百分点改进5个最先进的探测器中的4个探测器的性能。此外,我们对5个物体探测器进行了比较分析——确定最佳的探测器和培训数据配对,供在具有挑战的条件下自动赛跑时使用。