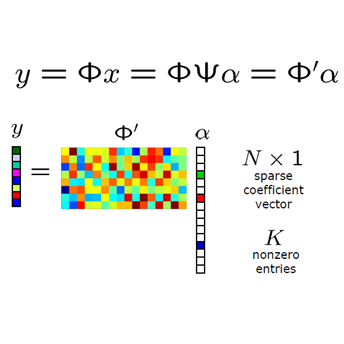

This work theoretically studies the problem of estimating a structured high-dimensional signal $x_0 \in \mathbb{R}^n$ from noisy $1$-bit Gaussian measurements. Our recovery approach is based on a simple convex program which uses the hinge loss function as data fidelity term. While such a risk minimization strategy is very natural to learn binary output models, such as in classification, its capacity to estimate a specific signal vector is largely unexplored. A major difficulty is that the hinge loss is just piecewise linear, so that its "curvature energy" is concentrated in a single point. This is substantially different from other popular loss functions considered in signal estimation, e.g., the square or logistic loss, which are at least locally strongly convex. It is therefore somewhat unexpected that we can still prove very similar types of recovery guarantees for the hinge loss estimator, even in the presence of strong noise. More specifically, our non-asymptotic error bounds show that stable and robust reconstruction of $x_0$ can be achieved with the optimal oversampling rate $O(m^{-1/2})$ in terms of the number of measurements $m$. Moreover, we permit a wide class of structural assumptions on the ground truth signal, in the sense that $x_0$ can belong to an arbitrary bounded convex set $K \subset \mathbb{R}^n$. The proofs of our main results rely on some recent advances in statistical learning theory due to Mendelson. In particular, we invoke an adapted version of Mendelson's small ball method that allows us to establish a quadratic lower bound on the error of the first order Taylor approximation of the empirical hinge loss function.

翻译:这项工作从理论上研究估算一个结构化高维信号$x_0=in \mathbb{R ⁇ }R ⁇ n$的问题。 我们的回收方法基于简单的 convex 程序, 该程序使用断层损失函数作为数据忠实性术语。 虽然这种风险最小化战略非常自然地可以学习二进制输出模型, 例如分类, 其估算特定信号矢量的能力基本上没有被探索。 一个主要困难在于, 断层损失只是片断线性, 因此它的“ 精度能量” 集中在一个单一点。 这与在信号估算中考虑的其他流行损失函数有很大不同, 例如, 平方或后勤损失, 至少在本地非常强烈的 convex 术语中使用断层损失函数。 因此, 有一点有点出乎意料的是, 我们仍然可以证明, 即使存在强烈的噪音, 更具体的非随机误差, 我们的美元=0的最小值重建可以实现。