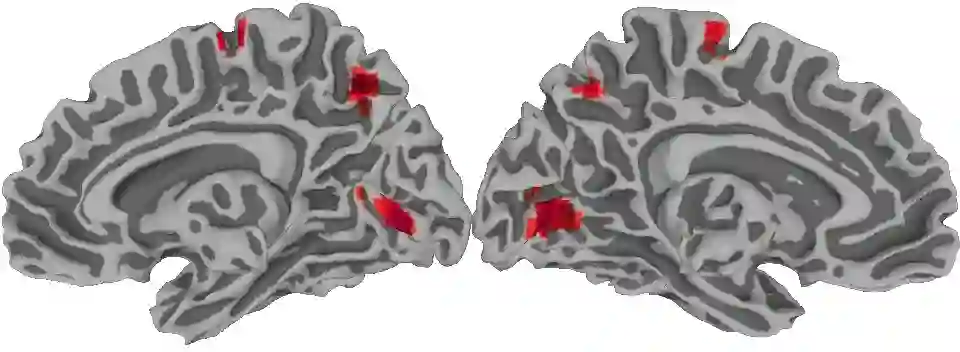

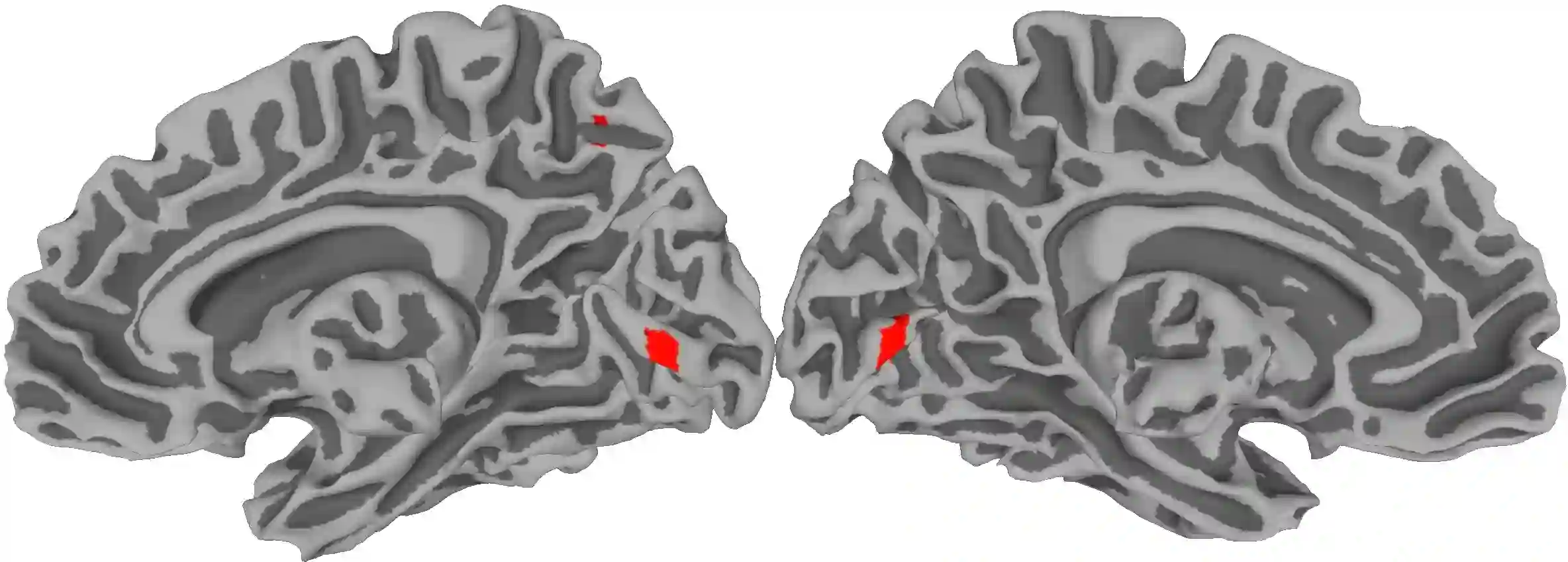

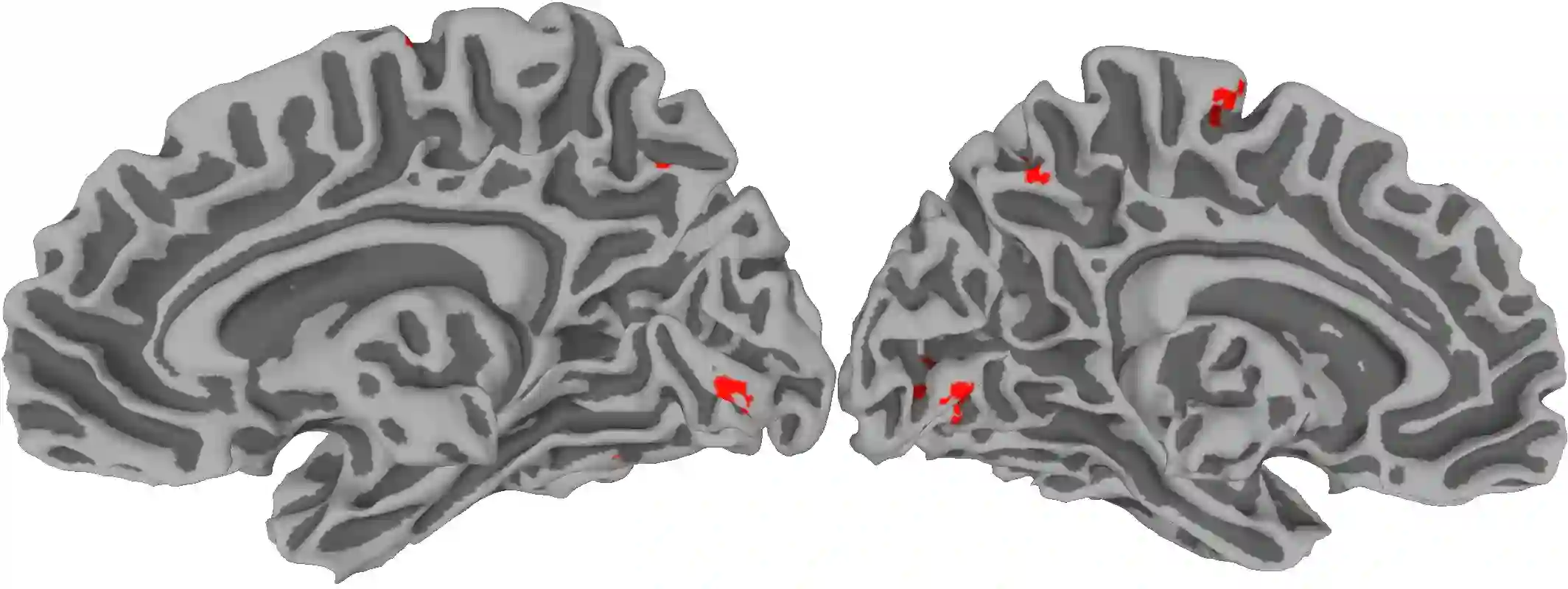

Functional Magnetic Resonance Imaging (fMRI) maps cerebral activation in response to stimuli but this activation is often difficult to detect, especially in low-signal contexts and single-subject studies. Accurate activation detection can be guided by the fact that very few voxels are, in reality, truly activated and that these voxels are spatially localized, but it is challenging to incorporate both these facts. We address these twin challenges to single-subject and low-signal fMRI by developing a computationally feasible and methodologically sound model-based approach, implemented in the R package MixfMRI, that bounds the a priori expected proportion of activated voxels while also incorporating spatial context. An added benefit of our methodology is the ability to distinguish voxels and regions having different intensities of activation. Our suggested approach is evaluated in realistic two- and three-dimensional simulation experiments as well as on multiple datasets. Finally, the value of our suggested approach in low-signal and single-subject fMRI studies is illustrated on a sports imagination experiment that is often used to detect awareness and improve treatment in patients in persistent vegetative state (PVS). Our ability to reliably distinguish activation in this experiment potentially opens the door to the adoption of fMRI as a clinical tool for the improved treatment and therapy of PVS survivors and other patients.

翻译:功能磁共振成像(fMRI)映射响应刺激性的大脑激活,但这种激活往往难以检测,特别是在低信号背景和单一主题研究中。精确的激活检测可以以这一事实为指导,即很少的氧化物在现实中真正被激活,而且这些氧化物在空间上是局部的,但将这两个事实都包含在内是具有挑战性的。我们通过在R包MixfMRI中实施一种计算上可行、方法上健全的模型模型基础方法来应对单子和低信号FMRI的双重挑战。R包MixfMRI将活性氧化物的预期比例捆绑在一起,同时结合空间环境。我们方法的另一个好处是能够区分不同的氧化物和活性强度不同的区域。我们所建议的方法在现实的二维和三维模拟实验实验中以及在多个数据集中进行评估。最后,我们在低信号和单一主题的FMRI研究中建议的方法的价值在体育想象力实验中得到了说明,该实验经常用来检测了解和提升临床治疗能力,从而改进我们长期临床治疗病人的可靠性,从而改进了这种实验工具。