![]()

![]()

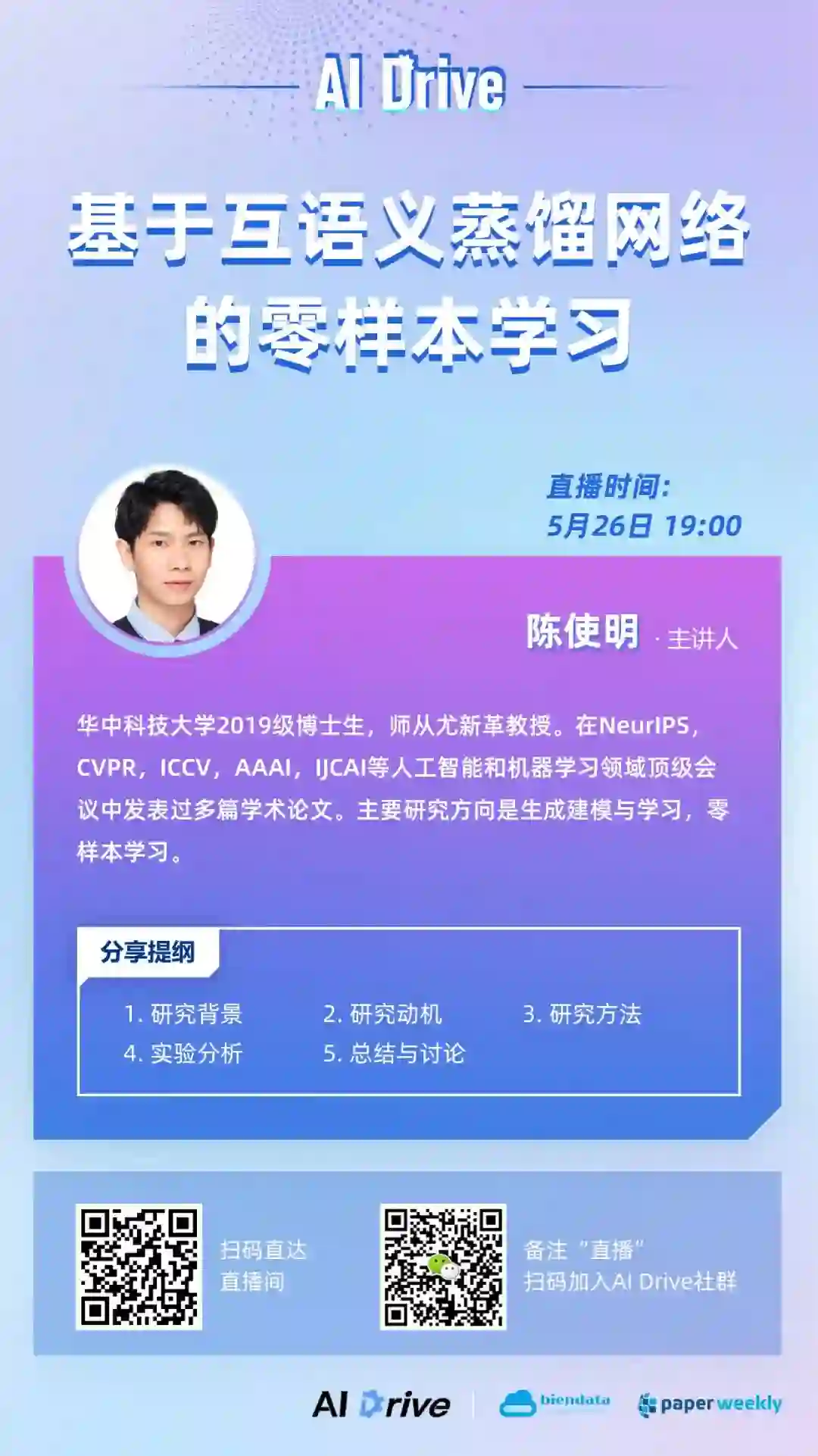

本期 AI Drive,我们邀请到华中科技大学在读博士生陈使明,为大家在线解读其发表在 CVPR 2022 的最新研究成果。本次报告的主题为

「基于互语义蒸馏网络的零样本学习」

。对本期主题感兴趣的小伙伴,5 月 26 日(本周四)晚 7 点,我们准时相约 PaperWeekly 直播间。

直播信息

零样本学习(Zero-shot Learning, ZSL)旨在通过运用已学到的已知类知识去认知未知类知识。当前的零样本学习方法 1)简单地将图像的全局特征与其关联的语义向量对齐,或 2)利用单向注意机制学习有限的潜在语义表示,无法有效地挖掘视觉特征和属性特征之间的潜在语义知识(如属性语义)。

为了解决上述问题,我们提出了一种

互语义蒸馏网络(MSDN)

,该网络逐步蒸馏视觉和属性特征之间的内在语义表示。MSDN 包含一个属性→视觉的注意力子网络(A→V)学习基于属性的视觉特征,以及视觉→属性注意子网络(V→A)学习基于视觉的属性特征。通过进一步引入语义蒸馏损失促使两个注意子网络能够在训练过程中相互协作学习和教导,从而实现特征的语义蒸馏。我们提出的 MSDN 在多个标准数据集 (i.e., CUB, SUN, AWA2) 上均取得显著效果。

MSDN: Mutually Semantic Distillation Network for Zero-Shot Learning

收录会议:

论文链接:

https://arxiv.org/abs/2203.03137

代码链接:

https://github.com/shiming-chen/MSDN

演讲提纲

嘉宾介绍

陈使明 / 华中科技大学博士生

陈使明,华中科技大学 2019 级博士生,师从尤新革教授。他在 NeurIPS, CVPR, ICCV, AAAI, IJCAI 等人工智能和机器学习领域顶级会议中发表过多篇学术论文。他的主要研究方向是生成建模与学习,零样本学习。个人主页:https://shiming-chen.github.io/

直播地址

本次直播将在 AI Drive 直播间进行,

扫描下方海报二维码

即可免费观看。

https://live.bilibili.com/h5/21887724

![]()

合作伙伴

![]()

![]()

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

![]()