论文题目:Counterfactual VQA: A Cause-Effect Look at Language Bias

作者:牛玉磊,汤凯华,张含望,卢志武,华先胜,文继荣

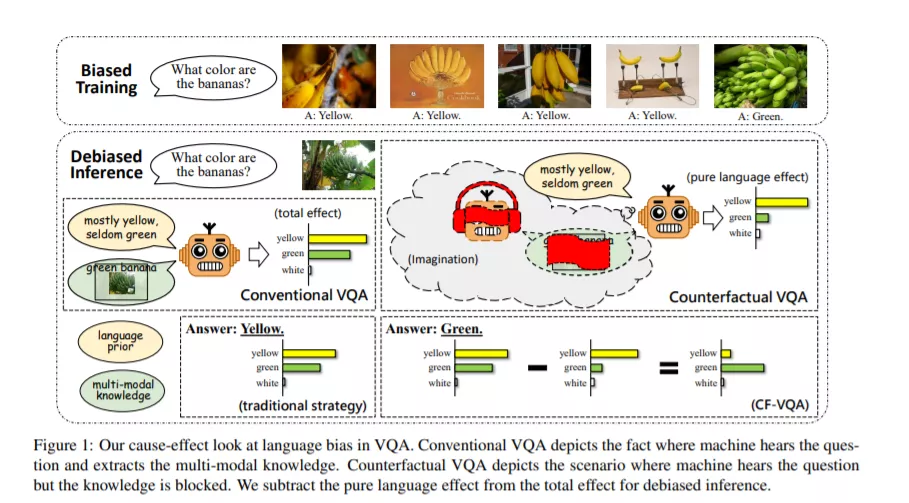

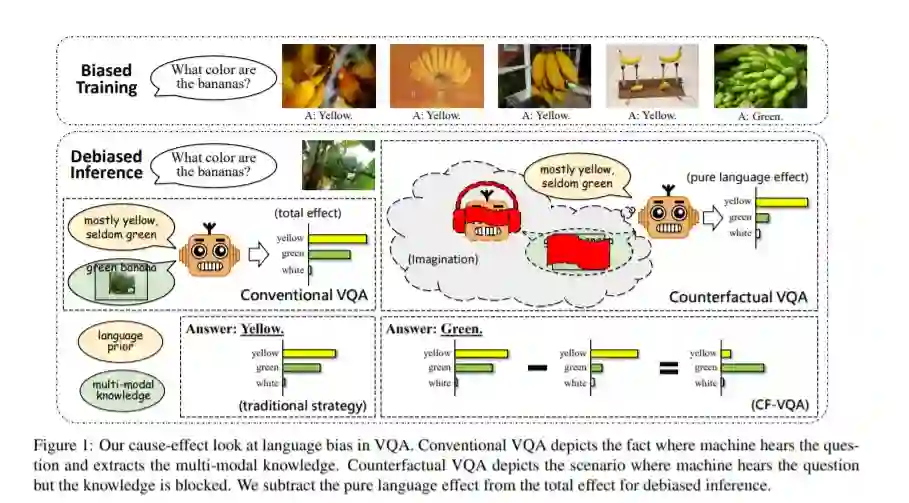

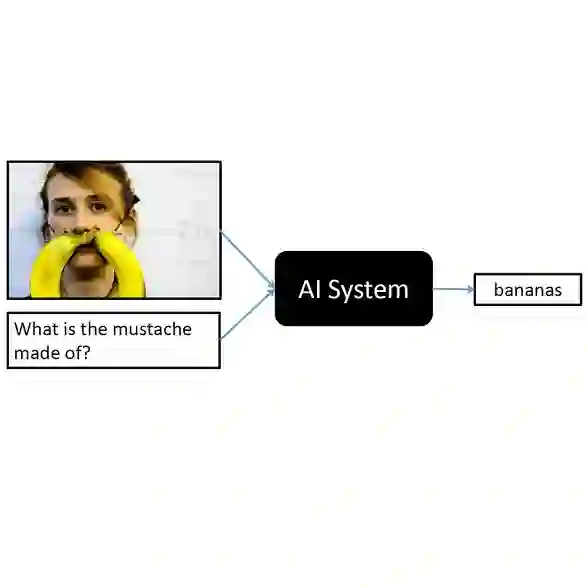

论文概述:近期研究发现,视觉问答模型在训练过程中会倾向于探索数据中的语言偏差,并依赖语言偏差进行推理和作答。这一倾向使得视觉问答模型未能充分地从视觉和语言两个模态中学习多模态知识,进而做出错误的回答。本文研究如何将视觉问答任务中的语言偏差进行捕获并去除。本文从因果推理的视角出发,提出了一种全新的基于反事实推断的视觉问答框架。反事实推断框架将语言偏差建模为问题对答案的直接因果效应,并通过从总体因果效应中减去语言的直接效应的方式去除语言偏差。实验证明反事实推断框架能够有效地克服语言偏差的影响,并具有良好的泛化性和鲁棒性。此外,本文从因果推理的角度为部分相关工作提供了理论解释。

https://www.zhuanzhi.ai/paper/f473e5b1a4c67df978867288e72d73f6

成为VIP会员查看完整内容