【CVPR2022】三元组对比学习的视觉-语言预训练

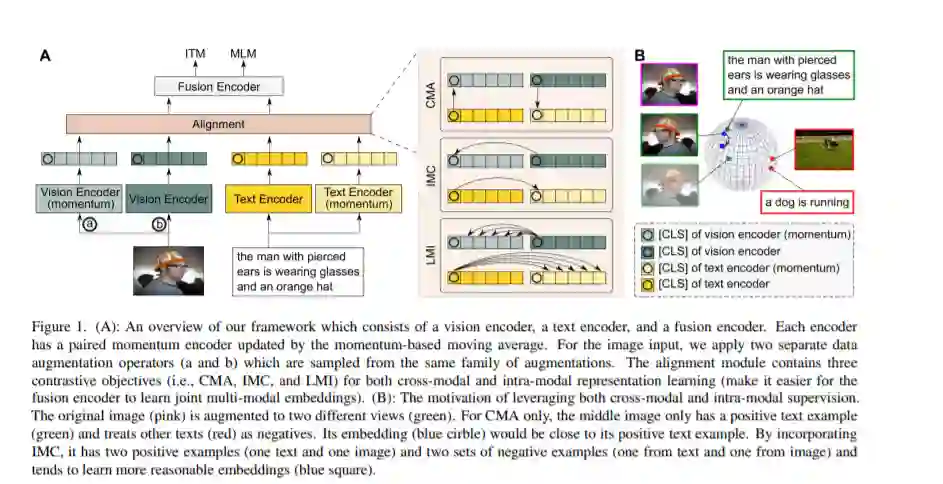

视觉语言表征学习在很大程度上受益于图像-文本的对比损失(例如InfoNCE损失)。这种对齐策略的成功是由于它能够最大化图像与匹配文本之间的互信息(MI)。然而,简单地执行跨模态对齐(CMA)忽略了每个模态中的数据潜力,这可能导致表示的退化。例如,尽管基于CMA的模型能够将图像-文本对在嵌入空间中紧密地映射在一起,但它们不能确保来自相同模态的相似输入保持在一起。当训练前的数据有噪声时,这个问题会变得更糟。在本文中,我们提出了利用跨模态和内模态自监督的三重对比学习(TCL)来进行视觉语言预训练。除了CMA之外,TCL还引入了一个模态内对比目标,以在表示学习中提供互补的好处。为了利用来自图像和文本输入的局部和结构信息,TCL进一步最大化了图像/文本局部区域和它们的全局摘要之间的平均MI。据我们所知,我们的工作是第一个考虑到局部结构信息的多模态表示学习。实验评估表明,我们的方法在各种常见的下游视觉语言任务,如图像-文本检索和视觉问题回答上具有竞争力,达到了最新的技术水平。

https://www.zhuanzhi.ai/paper/12af4807da28b56ef7ef66423f27cce9

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“TCLP” 就可以获取《【CVPR2022】三元组对比学习的视觉-语言预训练》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年4月19日

Arxiv

15+阅读 · 2021年5月19日