【学界】比无所不能的DIP更强大的图像恢复方法:DeepRED

来源:机器之心

此前,深度图像先验(DIP)被证明可以在不用学习的情况下解决图像去噪、去水印、超分辨率问题。但这一方法与最先进的替代方法相比,效果并不理想。本文基于 DIP 和去噪正则化(RED)概念,提出了 DeepRED 方法。它将两者结合,获得了非常有效的结果。

成像中的逆问题(inverse problem)是基于给定的损坏程度 y 对未知图像 x 的恢复。由于逆问题往往是病态(ill-posed)的,因此恢复过程成功的关键是正则化的选择。作为稳定逆向退化的图像先验,正则化将结果导向更合理的图像。

Ulyanov[13,14] 等人最近的工作为逆问题与深度学习的融合做出了特殊贡献。本文提出了深度图像先验(DIP)方法,这是一种在逆问题中处理正则化任务的新策略。与大多数早期的方法不同,DIP 建议使用深度网络本身作为逆问题的正则化工具,而不是采用监督的方法。

更具体点来说,DIP 移除了显式正则化,取而代之的是假设未知图像 x 是来自学习到的网络的生成图。当 DIP 与损坏图像的网络参数相匹配时,就可以根据要处理的图像进行调整。研究人员对这项研究的极大兴趣是源于一个绝妙的想法,即隐式地使用网络的架构来获得恢复图像 x 的正则化效果。

虽然 DIP 已经被证明十分有效,并在去噪、去水印、图像修复、超分辨率等多个成像逆问题中获得成功,但它的效果远没有达到当前最佳水平。因此研究人员提出通过返回显式正则化为 DIP 提供额外提升的想法,以便丰富隐式正则化,从而更好地恢复图像。

那应该从如此多的正则化方法中选择哪种呢?有趣的是,《Image restoration using total variation regularized deep image prior》中最近提出了对额外正则化的需求,它使用 Total-Variation 改善了修复结果。

在本文中,研究人员建议引入最近的去噪正规化概念 (RED)[17],并将它与 DIP 融合。RED 的特别吸引力在于它优于其它许多正则化方案,并且依赖现有的去噪算法来定义正则化项。本研究的一个特殊挑战是找到训练新的复合目标 DIP + RED 的方法,同时避免去噪函数的显式求导。

这些都是通过使用交替方向乘子法 (ADMM)[18] 实现的,它有一个额外的优势:相对于所采用的停止规则,它有一个稳定的恢复。这个方案被称为 DeepRED,经过图像去噪、单张图像超分辨率和图像去模糊方面的测试,RED 显示出明显优势。结果表明,无论是相对于 [17] 中的自然 RED 或 DIP 本身,所有结果都得到了显著改善。事实上,尽管 DeepRED 是一种无监督的方法,但它更接近于逆问题的监督求解器。

论文 :DeepRED: Deep Image Prior Powered by RED

论文链接:https://arxiv.org/abs/1903.10176

多年来,研究人员使用各种策略、工具和理论对成像中的逆问题进行了广泛研究。最近,这一领域受到了深度学习技术的巨大影响。Ulyanov 等人的深度图像先验(DIP)研究就是其中之一。DIP 为逆问题的正则化提供了一种新方法。尽管 DIP 已被证明是有效的,但与最先进的替代方法相比,它的效果并不理想。

在这项工作中,研究人员的目标是通过添加一个显式先验来增强 DIP,这丰富了整体正则化效果,从而可以更好地恢复图像。更具体地说,研究人员建议引入去噪正则化(RED)的概念,它利用现有的降噪器来正则化逆问题。本文的研究展示了如何将两者(DeepRED)合并到高效的恢复过程中,同时避免区分所选的降噪器,并产生非常有效的结果,这在几个已测试的逆问题中得到了证明。

DeepRED 方案

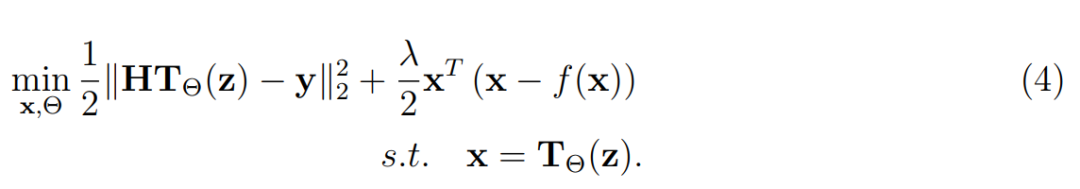

将 DIP 和 RED 合并,目标函数变为:

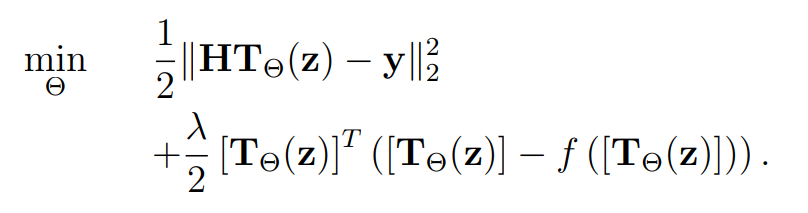

注意,要避免使用 x,并定义关于未知数 Θ的整体优化。这需要求解:

虽然这看起来很简单,但实际上行不通。因为在 T 上反向传播需要对去噪函数 f(·) 求导。对于大多数降噪器来说,这是一项必须避免的艰巨任务。如上所述,在适当条件下,RED 可以避免这种直接求导,研究人员想利用的也是它这个特性。

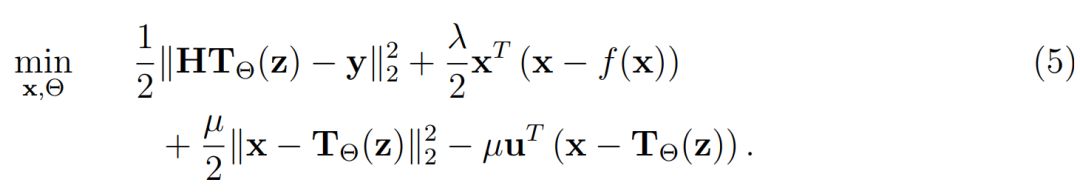

解决这一问题的方法是采用交替方向乘子法 [18]。从等式 (4) 开始,利用增广拉格朗日乘子法 (AL) 将约束项转化为惩罚项。

在这个表达式中,u 代表等式约束集合的拉格朗日乘子向量,而µ是被选择的自由参数。

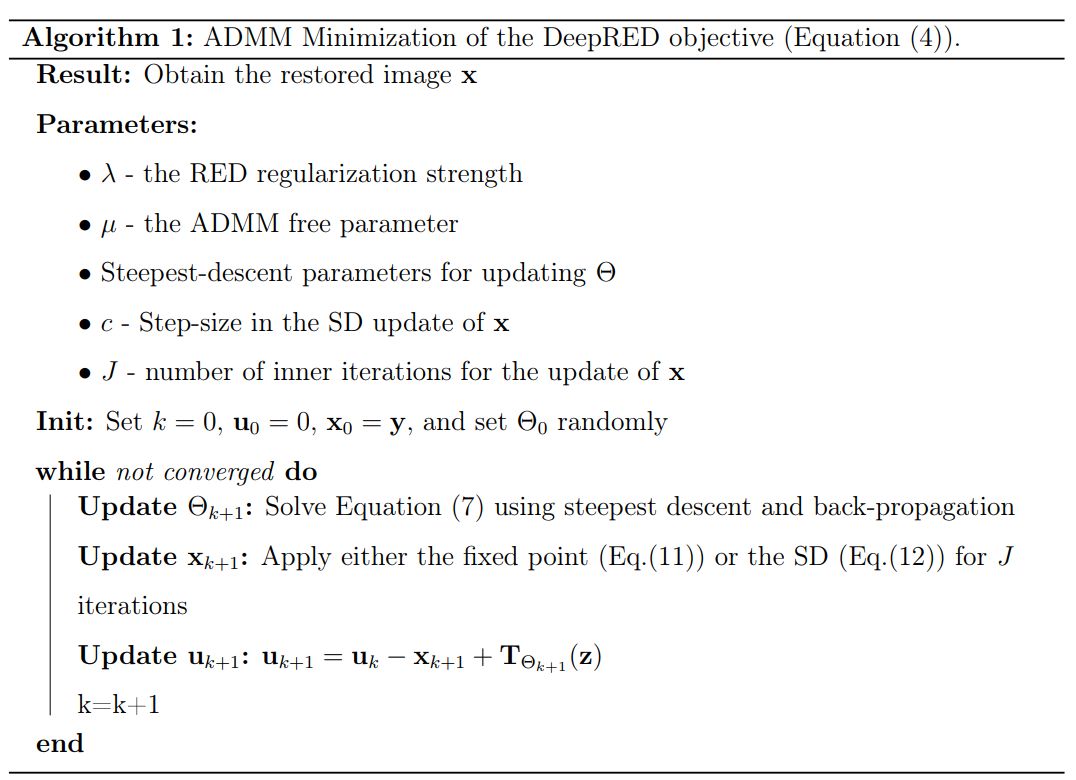

ADMM 算法相当于此表达式中三个未知数——Θ、x 和 u 的顺序更新。

算法 1 总结了应用此整体算法处理 DeepRED 目标最小化的步骤。

实验结果

本文在一系列实验中测试了提出的 DeepRED 方案。下面考虑了三种应用:图像去噪和单张图像超分辨率(SISR)以及图像去模糊。

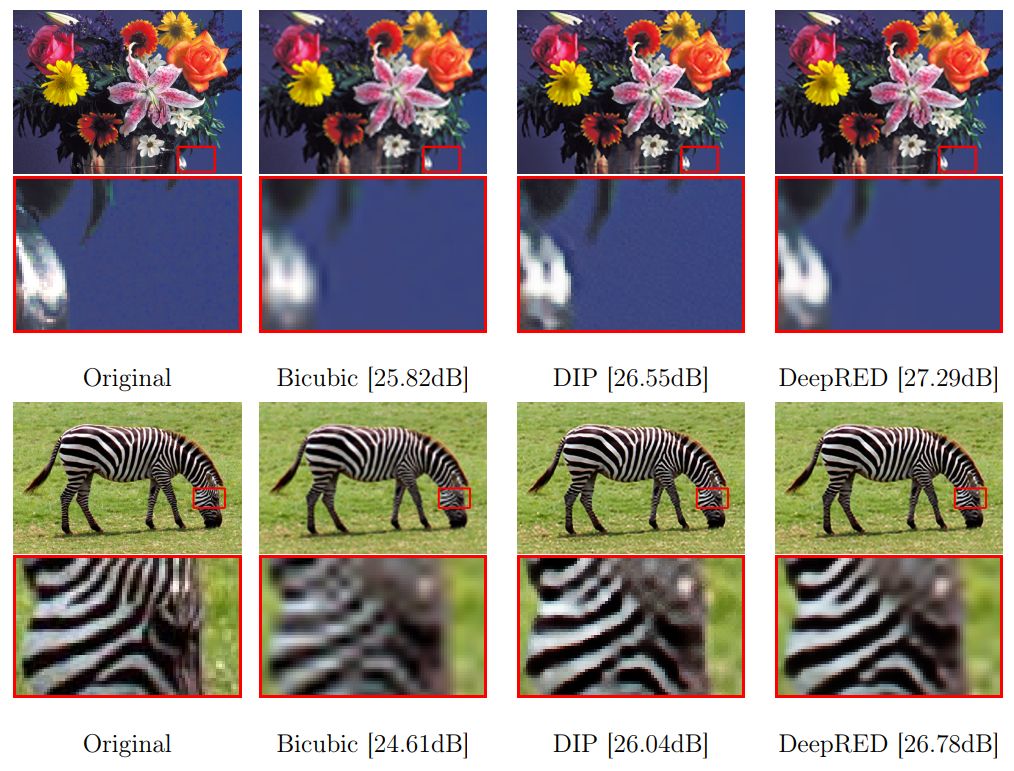

图 2 显示了从这些实验中获得的两个可视化视觉结果,以说明获得的图像恢复效果。

超分辨率结果。上两行:花朵 (Set14),比例因子 4。下两行:斑马 (Set14),比例因子 4。

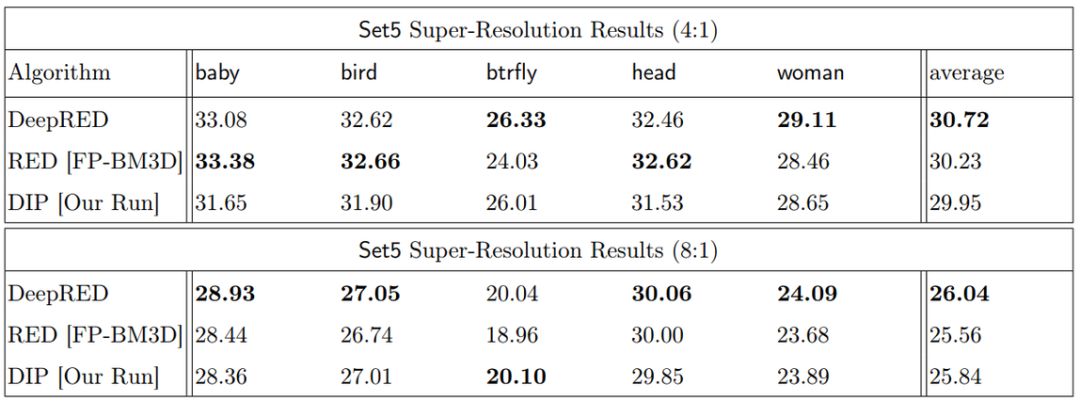

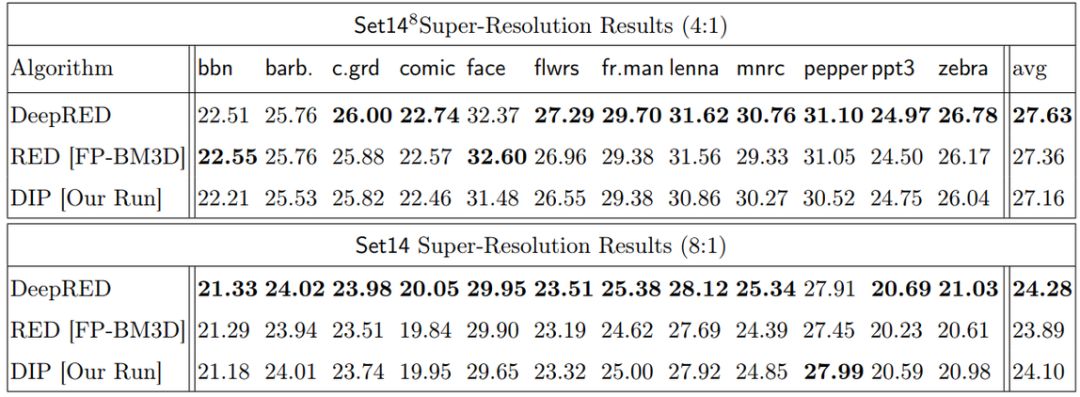

研究人员分别测试了 4 和 8 的比例因子,并将结果与 DIP [13] 和 RED [17] 在两个数据集上进行了比较。表 2 和表 3 对结果进行了总结。可以看出,RED+DIP 的效果始终优于单独使用 DIP 或 RED。

表 2:Set5 的超分辨率结果。

表 3:Set14 的超分辨率结果。

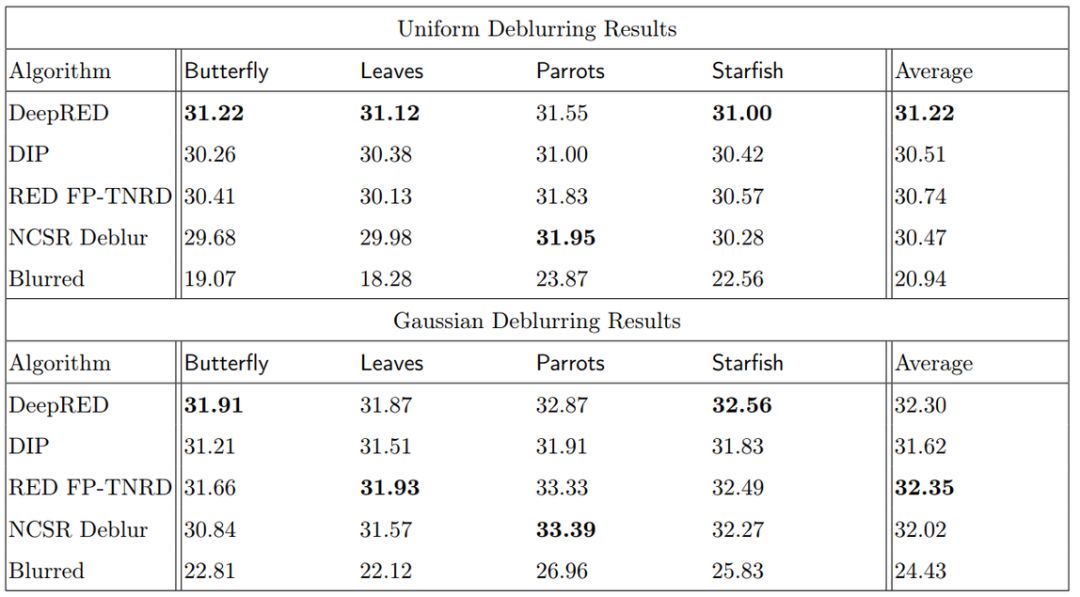

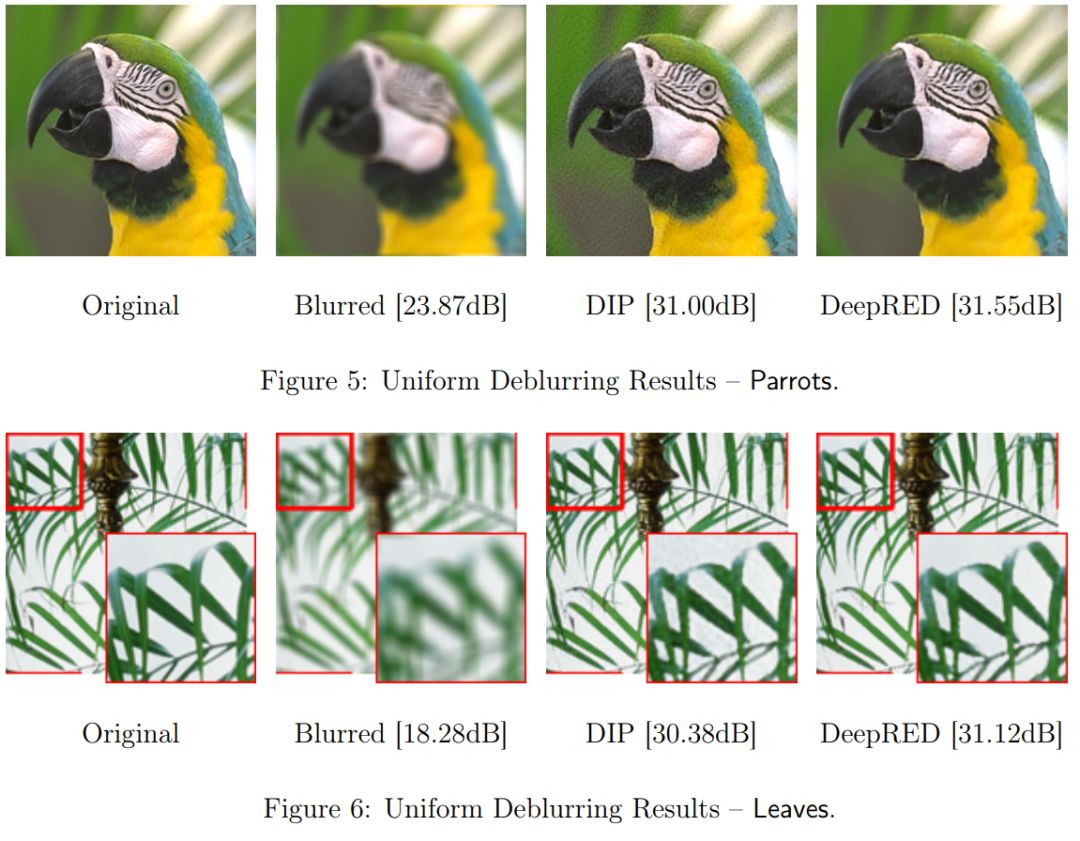

研究人员将 DeepRED 与 DIP、RED 和 NCSR Deblur 在 4 幅彩色图像上进行了比较。结果如表 5 所示。此外,图 4、图 5 和图 6 给出了该实验的三组结果,结果表明 RED 正则化效果优势明显。

表 5:图像去模糊结果

图五和图六分别是鹦鹉和树叶的图像去模糊结果比较。

☞ OpenPV平台发布在线的ParallelEye视觉任务挑战赛

☞【学界】OpenPV:中科院研究人员建立开源的平行视觉研究平台

☞【学界】ParallelEye:面向交通视觉研究构建的大规模虚拟图像集

☞【CFP】Virtual Images for Visual Artificial Intelligence

☞【最详尽的GAN介绍】王飞跃等:生成式对抗网络 GAN 的研究进展与展望

☞【智能自动化学科前沿讲习班第1期】王飞跃教授:生成式对抗网络GAN的研究进展与展望

☞【智能自动化学科前沿讲习班第1期】王坤峰副研究员:GAN与平行视觉

☞【重磅】平行将成为一种常态:从SimGAN获得CVPR 2017最佳论文奖说起

☞【学界】Ian Goodfellow等人提出对抗重编程,让神经网络执行其他任务

☞【学界】六种GAN评估指标的综合评估实验,迈向定量评估GAN的重要一步

☞【资源】T2T:利用StackGAN和ProGAN从文本生成人脸

☞【学界】 CVPR 2018最佳论文作者亲笔解读:研究视觉任务关联性的Taskonomy

☞【业界】英特尔OpenVINO™工具包为创新智能视觉提供更多可能

☞【学界】ECCV 2018: 对抗深度学习: 鱼 (模型准确性) 与熊掌 (模型鲁棒性) 能否兼得