华南理工/MSRA/百度联合提出对偶回归网络,超分辨率性能得到大幅提升!| CVPR2020

点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文授权转载自:ImageAI

每年三大视觉顶会CVPR、ICCV、ECCV都备受瞩目,今年的CVPR结果出来已经有一阵子~~

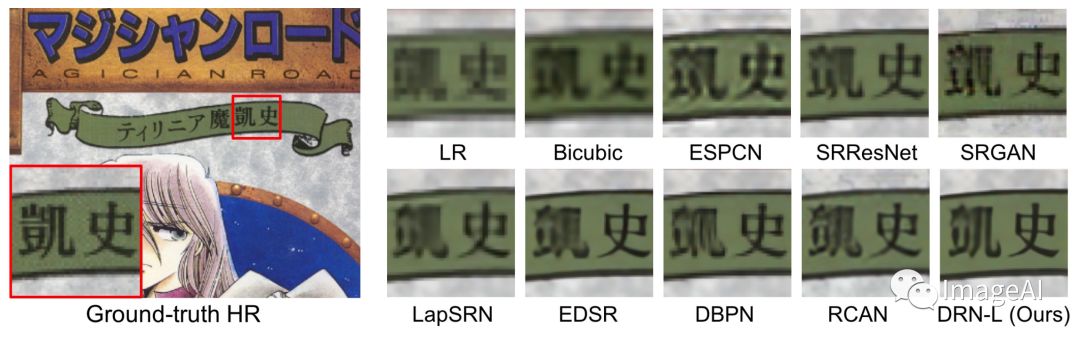

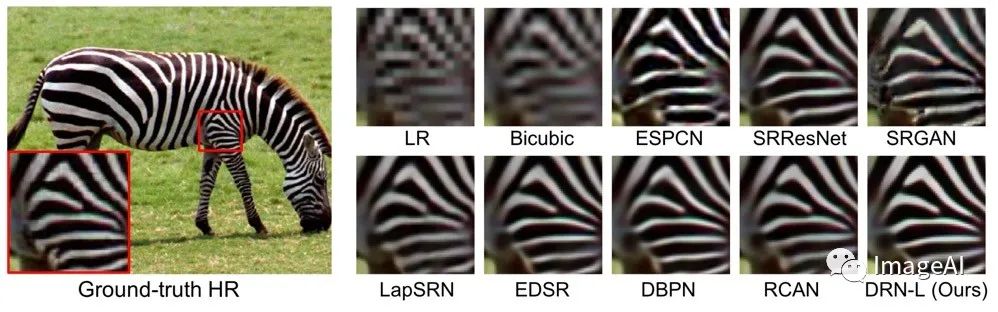

其中超分辨率领域有一篇论文备受瞩目,我们先看看结果👇👇👇:

4倍超分结果:

8倍超分结果:

效果简直是amazing啊~

接下来跟着小编来深扒一下论文是如何实现如此amazing结果的~

以往论文中的诟病

目前大部分基于神经网络的单图像超分辨率(SISR)的传统做法是利用低分辨率图像(LR)和高分辨率图像(HR)对,学习一个非线性映射函数以实现LR到HR的映射。这种做法存在两个主要的问题:

-

「问题一:」 SISR属于ill-posed问题,这就意味LR到HR的映射 存在多种可行解,导致训练到后期时 无法确定一个可行解。 -

「问题二:」 真实的LR和HR的图像对(pair)很难获取,目前大部分的data pair都是人工模拟的,例如常见的DIV2K和Flick2K数据集,这就意味模型学习到的退化核很难泛化到真实场景下, 导致模型的泛化能力低下。

本文的解决方案

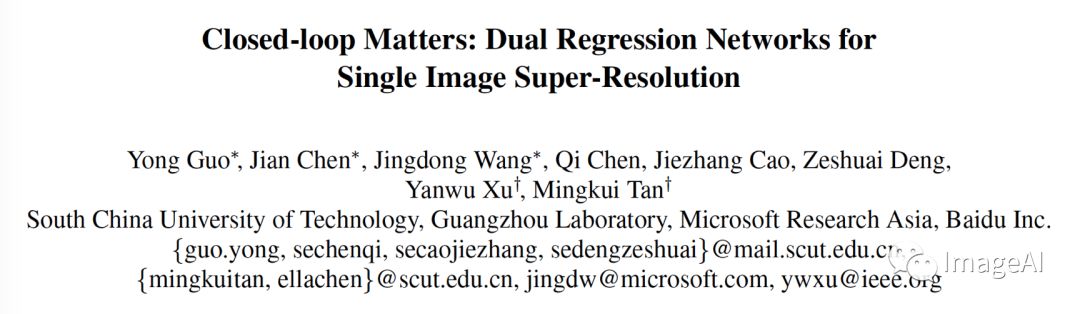

那么本文针对这两个问题,通过对偶学习(Dual Learning),建立了个由LR->HR->LR闭环对偶回归(Dual Regression)模型。

-

「针对问题一:」

LR->HR是个one to many的过程,那么同样的由HR->LR同样是个one to many的过程。通过本文中提出的闭环学习过程,从理论上理解可以通过两个过程之间的相互约束,形成近似one to one闭环。 -

「针对问题二:」

由于真实的data pair难以获取,在本文的Dual Regression Network(DRN)中,采用半监督的方式对网络进行训练。采用data pair的人工模拟对LR->HR训练的同时,利用真实的LR对LR->HR->LR的进行训练。这样可以通过真实的LR data unpair尽可能约束网络的退化核的学习过程,使得其具有一定的泛化性。

本文的超分辨率闭环对偶回归任务接下来我们对其中的一些概念进行深度解析

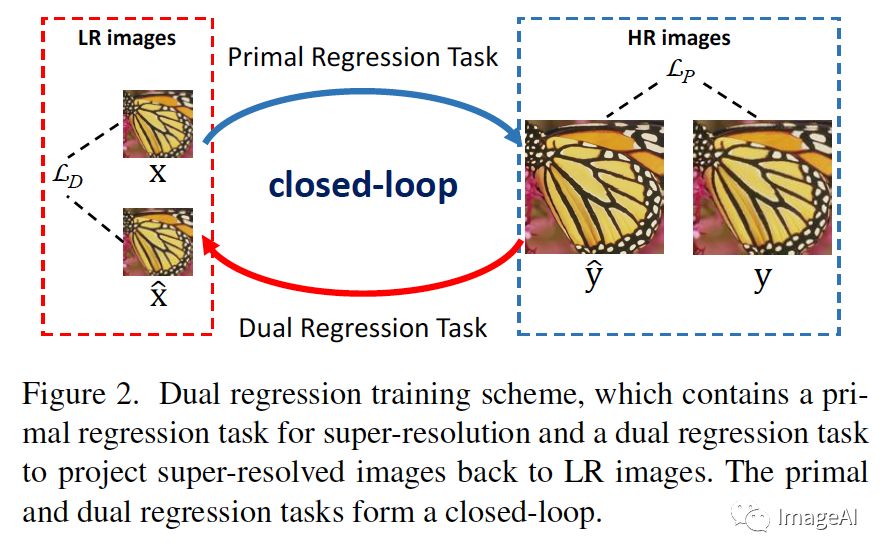

什么是对偶学习?

Dual Learning是MSRA在NLP机器翻译中提出的一种新的机器学习范式,其最关键一点在于,给定一个原始任务模型,其对偶任务的模型可以给其提供反馈;同样的,给定一个对偶任务的模型,其原始任务的模型也可以给该对偶任务的模型提供反馈;从而这两个互为对偶的任务可以相互提供反馈,相互学习、相互提高。

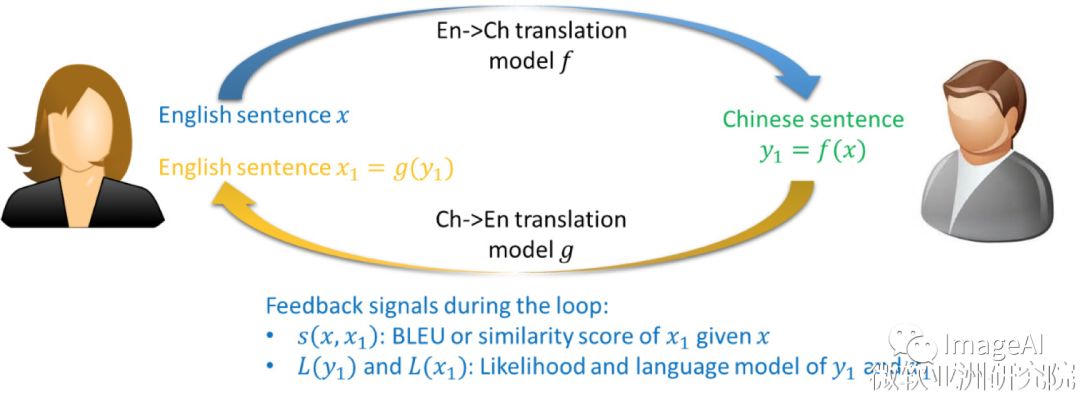

DRN的闭环模型如何定义?

DRN闭环模型整体是个U-Net like的结构,如下:

整个闭环模型可以分为两部分,图中黑色线部分为P网络,红色线部分为D网络。P网络为LR->HR的映射过程,而D网络则为P网络的对偶过程HR->LR.

DRN的损失函数如何定义?

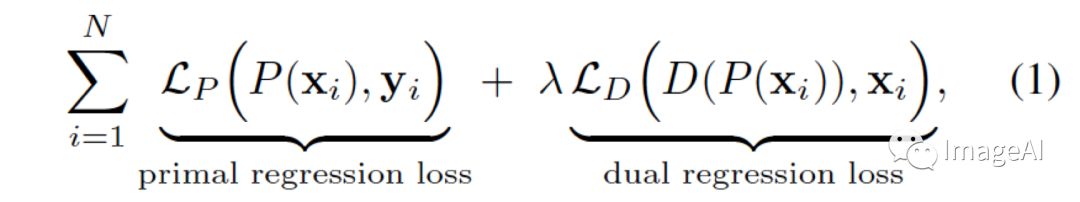

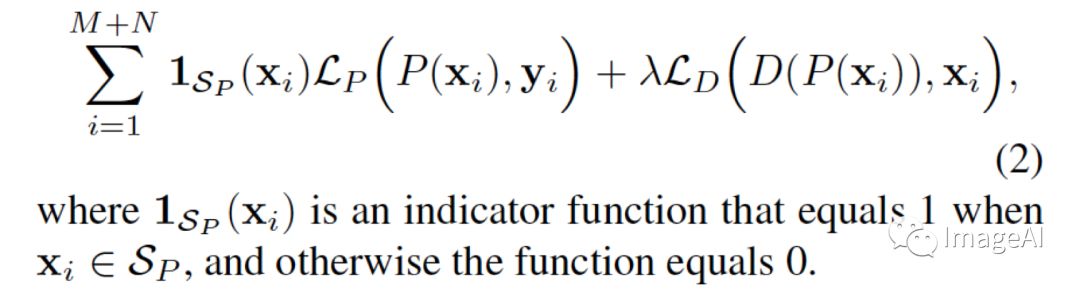

DRN网络,主要由P网络和D网络构成,两者间是个互逆的过程, 因此对于Data Pair数据,其损失函数为:

其中,每个loss均可以用L1或L2 loss,本文中使用的是L1 loss。而针对加入半监督的Data unpair数据,其损失函数则为加入了个指示函数:

Data Unpair数据如何训练?

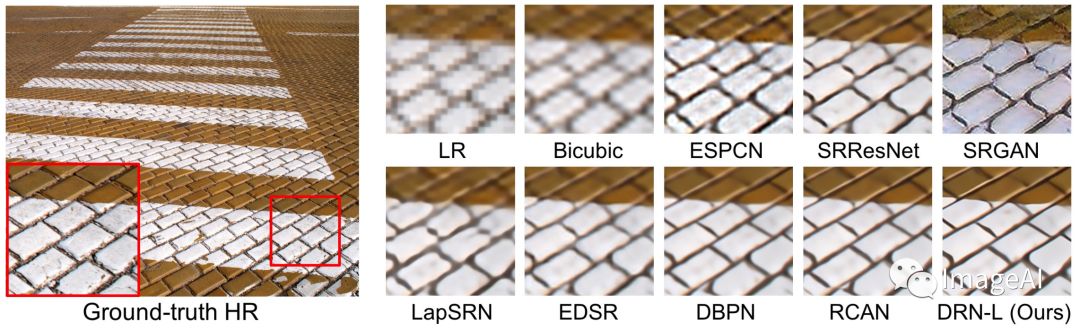

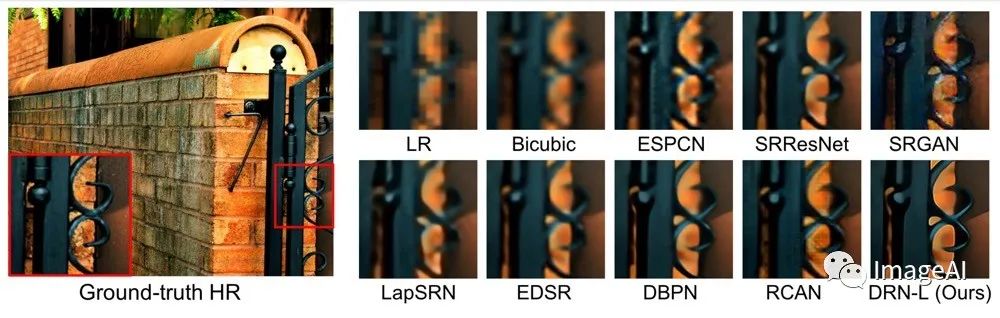

实验结果分析:

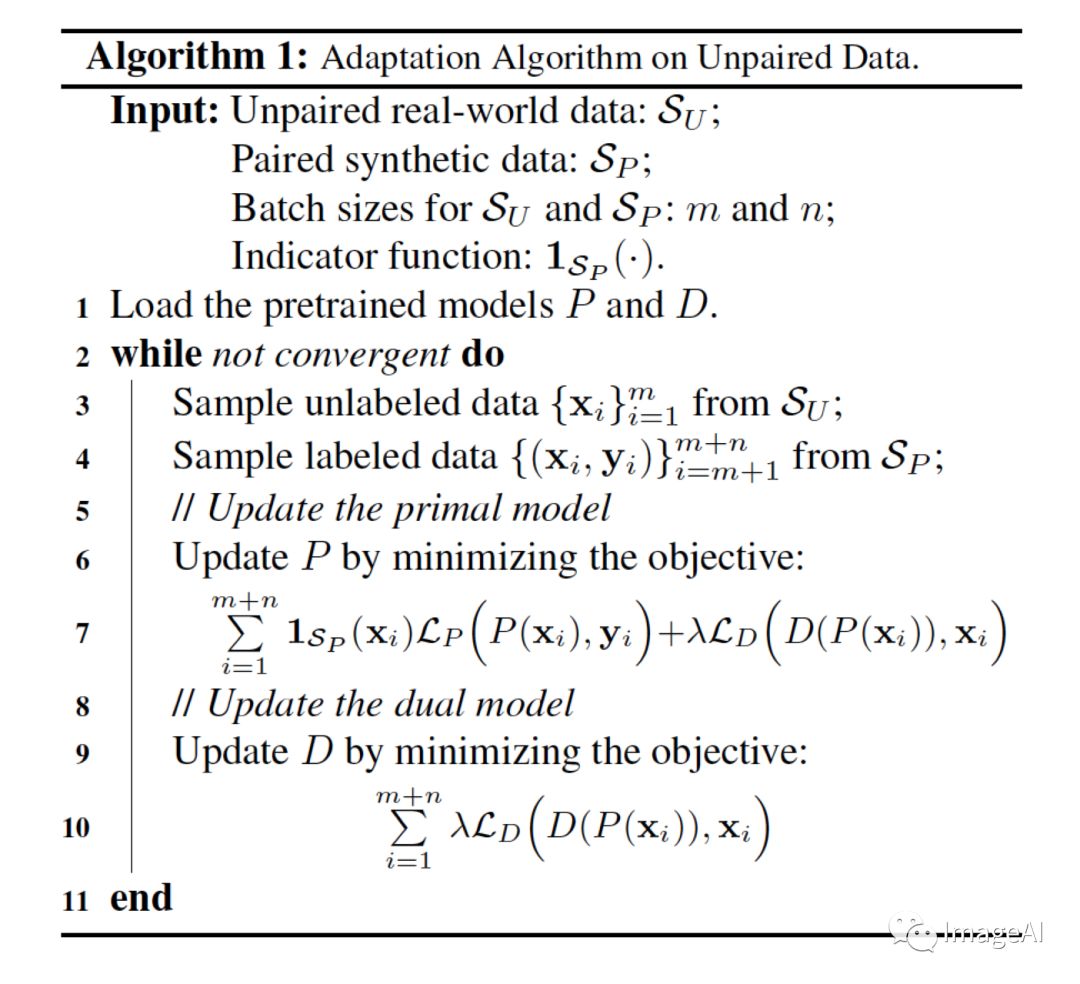

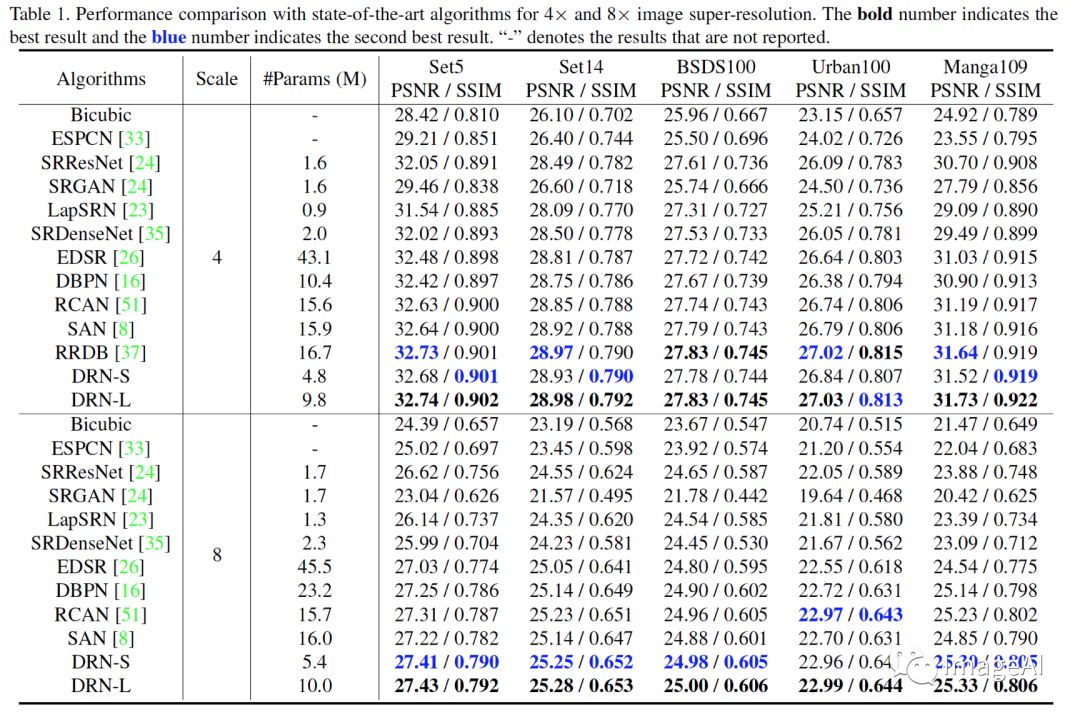

一.有监督的超分辨率的实验设置和结果:

有监督部分和目前大部分模型一样,使用的是常见的Data pair数据集DIV2K和Flick2K作为训练集,测试集为常见的SET5, SET14, BSDS100,URBAN100 和MANGA109。模型设置上,作者设置了两个不同参数量的模型,DRN-S(小模型)和DRN-L(大模型)。

从结果上看,无论是性能还是参数DRN-S和DRN-L都展示出了STOA的结果!

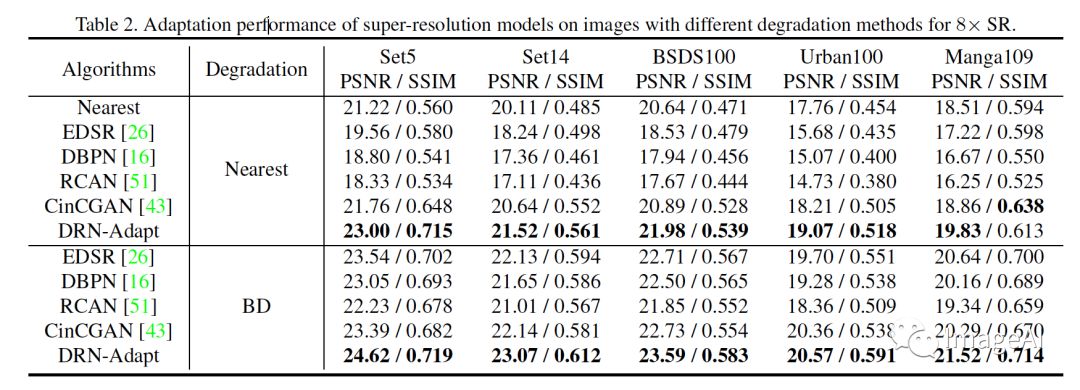

二.半监督的超分辨率的实验设置和结果:

半监督部分,data pair部分使用了DIV2K的训练集,而对于data unpiar部分,则划分成两个实验:

-

「为了定性的计算PSNR和SSIM:」data unpair则是在ImageNet中随机选取了3K张图像,并对图片使用Nearest和BD两种不同的方式采样出LR图像,将LR用于半监督训练。其结果同样非常不错。

-

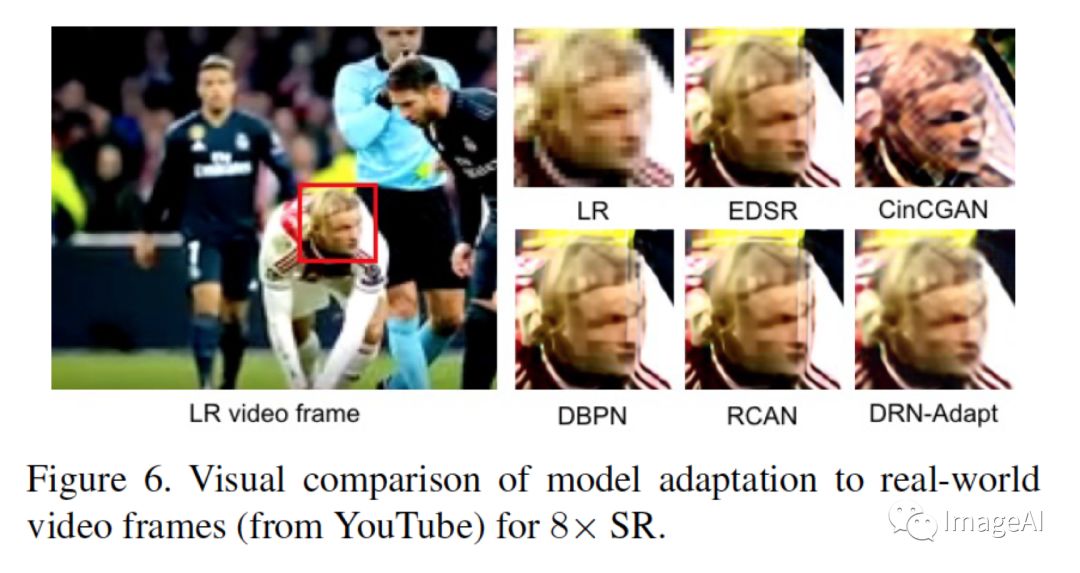

「为了实现真实图像下感性的效果:」data unpair则是来自于未知退化核的YouTube视频的3K张原始帧。由于没有GT,只能通过感性的方式进行不同方法的下恢复效果的观测。

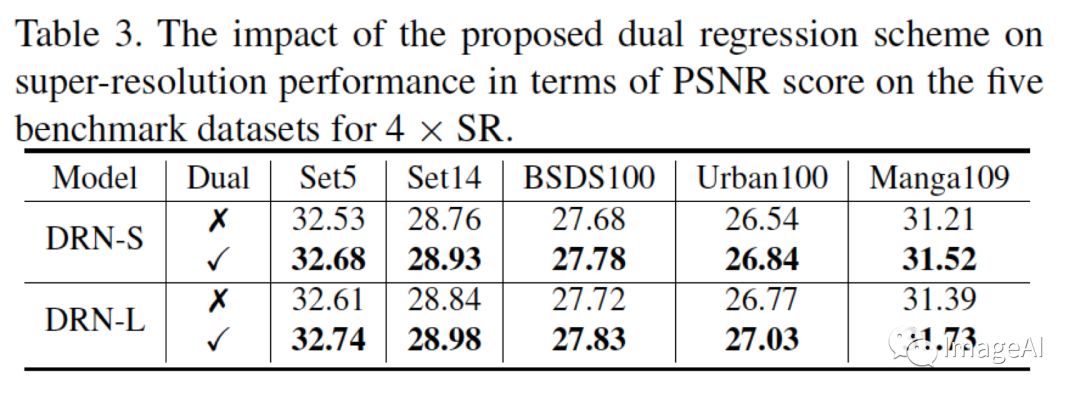

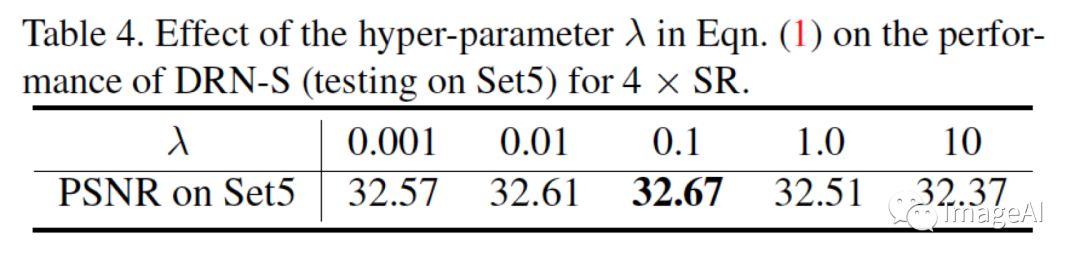

三.消融实验设置和结果:

-

「对偶学习的反馈效果到底有多好?」

作者同样进行的实验对比:

从结果上来看,使用Dual Learning的方式在测试集上提升非常显著,充分显示出了对偶学习的优势! -

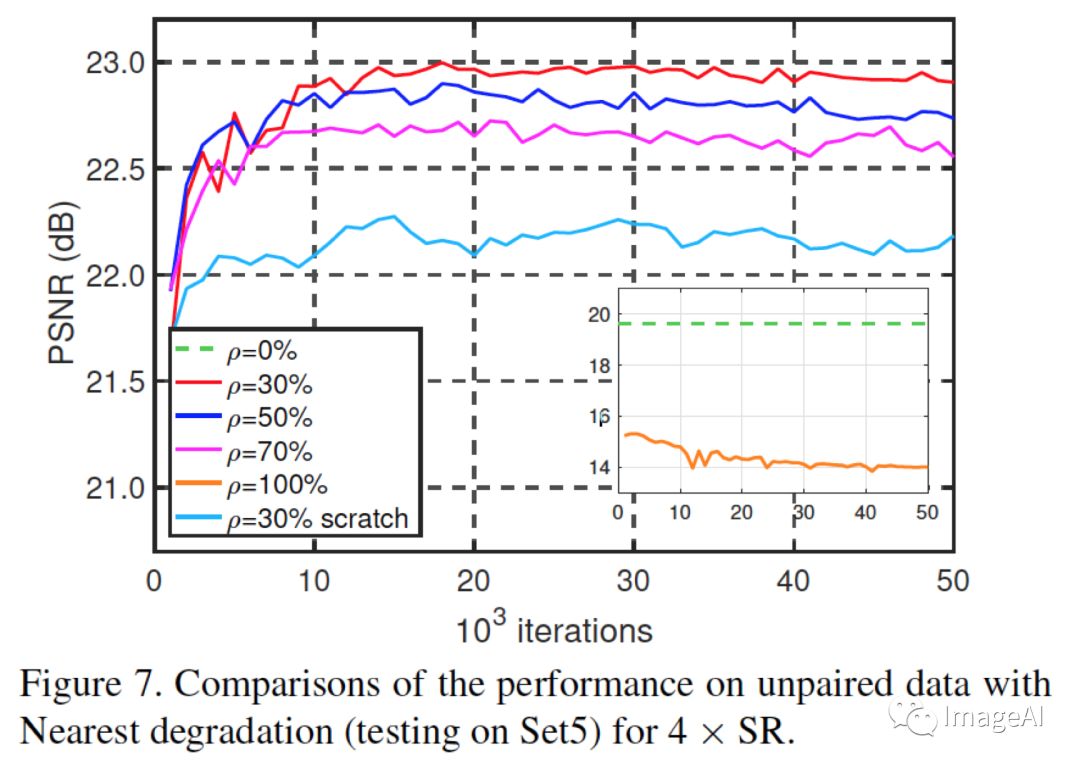

「半监督学习中,data pair数据和unpair数据比例如何划分?」

结论:unpair data占整体数据(unpair + pair)的30%能网络性能达到最优!

结语

整体而言,这是一项非常不错的工作!就我个人而言,可以说是这几年内看到的SISR文章中最让我眼前一亮的工作。这种学习范式对其他的low level vision tasks应该都是同样适用的。而其中最大的亮点,在于利用对偶任务的特点,将真实LR的半监督引入,为目前SISR普遍存在的泛化性问题提供了一种新的解决思路。即当前更多的工作是如何去盲估计出一个未知的退化核,这种盲估计通常是非常难的。而这种半监督的学习,则需要将真实的LR接纳到模型中来进行学习,因此这种半监督的方式,在真实场景下可能更多需要Online learning。

论文链接:https://arxiv.org/pdf/2003.07018.pdf

代码链接:https://github.com/guoyongcs/DRN

编辑助理:happyGirl

推荐阅读

2020年AI算法岗求职群来了(含准备攻略、面试经验、内推和学习资料等)

重磅!CVer-超分辨率SR 微信交流群已成立

扫码添加CVer助手,可申请加入CVer-超分辨率 微信交流群,目前已汇集200人!互相交流,一起进步!

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流等群。

一定要备注:研究方向+地点+学校/公司+昵称(如超分辨率+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加群

▲长按关注我们

麻烦给我一个在看!