西北大学最新《神经架构搜索NAS》2020综述综述论文,30页pdf152篇文献阐述进展、挑战与解决方案

【导读】神经架构搜索Neural Architecture Search (NAS)是深度学习研究热点。NAS旨在通过使用有限的计算资源,以尽可能少的人工干预的自动化方式设计具有最佳性能的网络架构。西北大学等学者发布了关于神经架构搜索的综述论文,对NAS进行了全面、系统的综述。

https://arxiv.org/abs/2006.02903

https://www.zhuanzhi.ai/vip/3e27a2d19cc6d4ee988b50cbea870847

深度学习在许多领域都取得了重大突破和进展。这是因为深度学习具有强大的自动表示能力。实践证明,网络结构的设计对数据的特征表示和最终的性能至关重要。为了获得良好的数据特征表示,研究人员设计了各种复杂的网络结构。然而,网络架构的设计在很大程度上依赖于研究人员的先验知识和经验。因此,一个自然的想法是尽量减少人为的干预,让算法自动设计网络的架构。因此,这需要更深入到强大的智慧。

近年来,大量相关的神经结构搜索算法(NAS)已经出现。他们对NAS算法进行了各种改进,相关研究工作复杂而丰富。为了减少初学者进行NAS相关研究的难度,对NAS进行全面系统的调查是必不可少的。之前的相关调查开始主要从NAS的基本组成部分: 搜索空间、搜索策略和评估策略对现有工作进行分类。这种分类方法比较直观,但是读者很难把握中间的挑战和标志性作品。因此,在本次综述中,我们提供了一个新的视角:首先概述最早的NAS算法的特点,总结这些早期NAS算法存在的问题,然后为后续的相关研究工作提供解决方案。并对这些工作进行了详细而全面的分析、比较和总结。最后,提出了今后可能的研究方向。

概述

深度学习已经在机器翻译[1-3]、图像识别[4,6,7]和目标检测[8-10]等许多领域展示了强大的学习能力。这主要是因为深度学习对非结构化数据具有强大的自动特征提取功能。深度学习已经将传统的手工设计特征[13,14]转变为自动提取[4,29,30]。这使得研究人员可以专注于神经结构的设计[11,12,19]。但是神经结构的设计很大程度上依赖于研究者的先验知识和经验,这使得初学者很难根据自己的实际需要对网络结构进行合理的修改。此外,人类现有的先验知识和固定的思维范式可能会在一定程度上限制新的网络架构的发现。

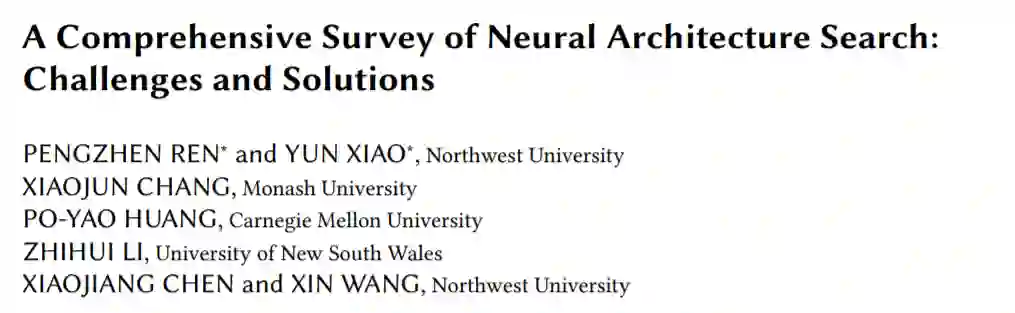

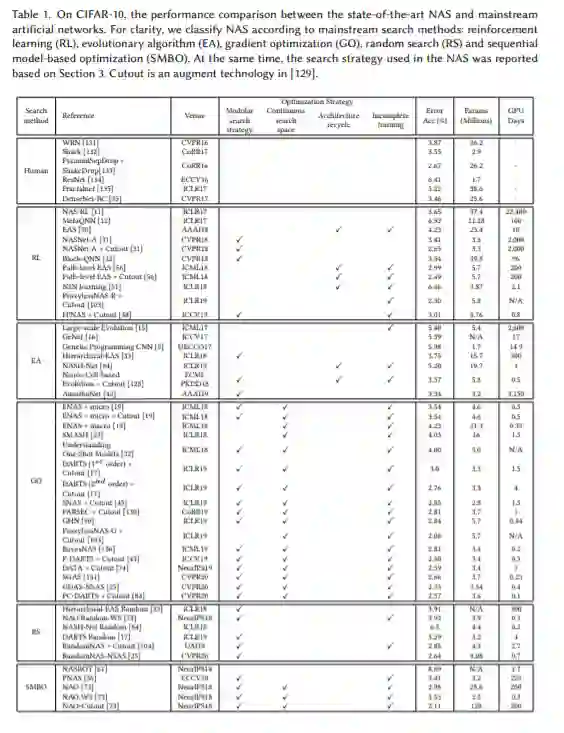

因此,神经架构搜索(NAS)应运而生。NAS旨在通过使用有限的计算资源,以尽可能少的人工干预的自动化方式设计具有最佳性能的网络架构。NAS- RL[11]和MetaQNN[12]的工作被认为是NAS的开创性工作。他们使用强化学习(RL)方法得到的网络架构在图像分类任务上达到了SOTA分类精度。说明自动化网络架构设计思想是可行的。随后,大规模演化[15]的工作再次验证了这一想法的可行性,即利用演化学习来获得类似的结果。然而,它们在各自的方法中消耗了数百天的GPU时间,甚至更多的计算资源。如此庞大的计算量对于普通研究者来说几乎是灾难性的。因此,如何减少计算量,加速网络架构的搜索[18-20,48,49,52,84,105]就出现了大量的工作。与NAS的提高搜索效率,NAS也迅速应用领域的目标检测(65、75、111、118),语义分割(63、64、120),对抗学习[53],建筑规模(114、122、124),多目标优化(39、115、125),platform-aware(28日34、103、117),数据增加(121、123)等等。另外,如何在性能和效率之间取得平衡也是需要考虑的问题[116,119]。尽管NAS相关的研究已经非常丰富,但是比较和复制NAS方法仍然很困难[127]。由于不同的NAS方法在搜索空间、超参数、技巧等方面存在很多差异,一些工作也致力于为流行的NAS方法提供一个统一的评估平台[78,126]。

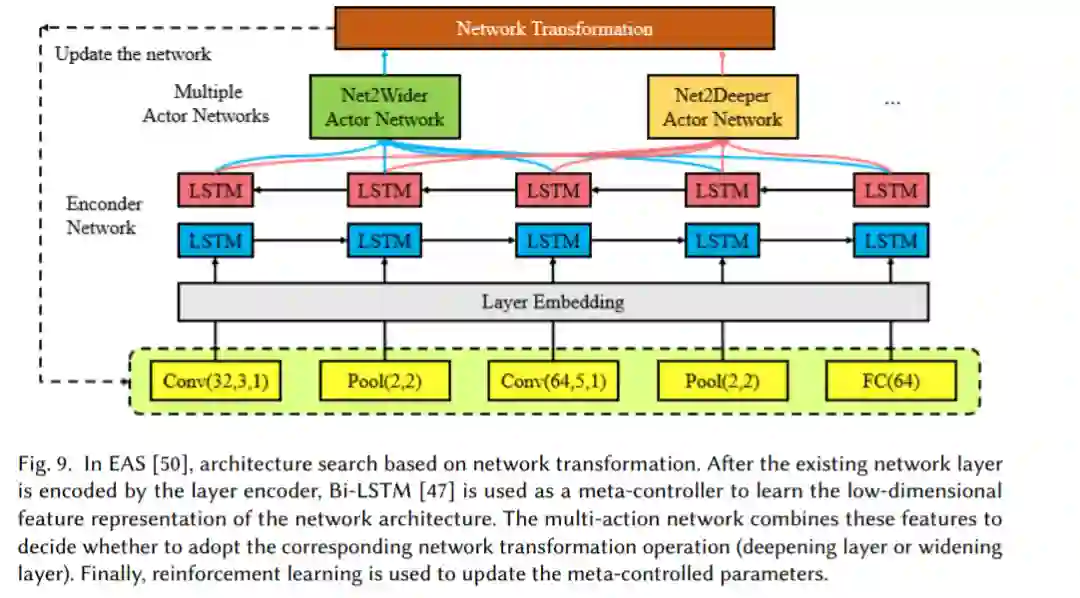

随着NAS相关研究的不断深入和快速发展,一些之前被研究者所接受的方法被新的研究证明是不完善的。很快就有了改进的解决方案。例如,早期的NAS在架构搜索阶段从无到有地训练每个候选网络架构,导致计算量激增[11,12]。ENAS[19]提出采用参数共享策略来加快架构搜索的进程。该策略避免了从头训练每个子网,但强制所有子网共享权值,从而大大减少了从大量候选网络中获得性能最佳子网的时间。由于ENAS在搜索效率上的优势,权值共享策略很快得到了大量研究者的认可[23,53,54]。不久,新的研究发现,广泛接受的权重分配策略很可能导致候选架构[24]的排名不准确。这将使NAS难以从大量候选架构中选择最优的网络架构,从而进一步降低最终搜索的网络架构的性能。随后DNA[21]将NAS的大搜索空间模块化成块,充分训练候选架构以减少权值共享带来的表示移位问题。此外,GDAS-NSAS[25]提出了一种基于新的搜索架构选择(NSAS)损失函数来解决超网络训练过程中由于权值共享而导致的多模型遗忘问题。

在快速发展的NAS研究领域中,类似的研究线索十分普遍,基于挑战和解决方案对NAS研究进行全面、系统的调研是非常有用的。以往的相关综述主要根据NAS的基本组成部分: 搜索空间、搜索策略和评估策略对现有工作进行分类[26,27]。这种分类方法比较直观,但不利于读者捕捉研究线索。因此,在本次综述查中,我们将首先总结早期NAS方法的特点和面临的挑战。基于这些挑战,我们对现有研究进行了总结和分类,以便读者能够从挑战和解决方案的角度进行一个全面和系统的概述。最后,我们将比较现有的研究成果,并提出未来可能的研究方向和一些想法。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“NAS30” 可以获取《最新《神经架构搜索NAS》2020综述综述论文,30页pdf阐述进展、挑战与解决方案》专知下载链接索引