ECCV 2020 | 小米开源Fair DARTS:消除不公平优势的 DARTS

点击上方“CVer”,选择加"星标"置顶

重磅干货,第一时间送达

本文作者:boyd

https://zhuanlan.zhihu.com/p/94136888

本文系原作者投稿,并已授权,不得擅自二次转载

更新:FairDARTS 被 ECCV‘20 接收。

小米 AutoML 组新出炉文章

论文:https://arxiv.org/abs/1911.12126

代码链接:

https://github.com/xiaomi-automl/FairDARTS

本文探讨了 DARTS 存在的两个问题:

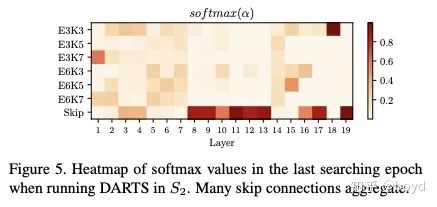

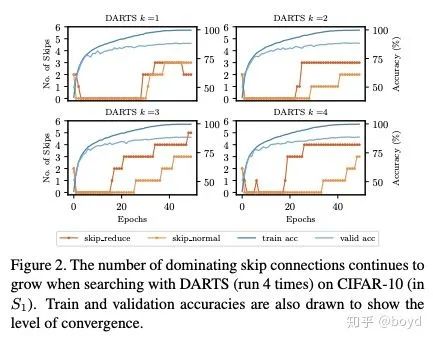

搜索过程中 skip connection 在优化后期出现过多 (Figure 2,reduction cell 中 8 条边出现了5次),

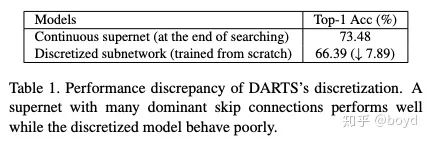

连续的结构参数离散化存在 gap (Table 1,超网在 ImageNet 上达到73.48%,离散化后full train只有 66.39%)。

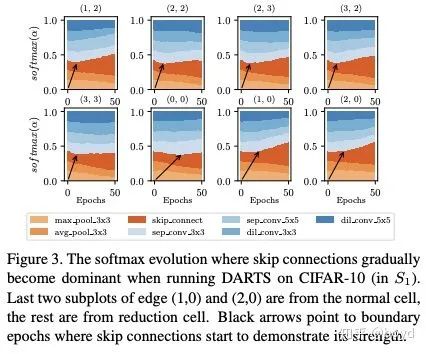

本文认为 skip 聚集出现有两个不可或缺的条件:排他竞争(两个结点之间只能选 1 个 op)、不公平优势。skip 和其他 op 形成了类 residual 结构,更利于信息传递,在进入 Figure 3 箭头所指的临界点后优势保持,保持垄断,抑制了其他 op。因此需要解决 skip 带来的 collapse,只需要打破其中任意一个条件即可。Fair DARTS 主体上采用打破排他竞争这个策略;而现有有效的解决 skip 的方法均是从第二个条件入手。对于第二个条件,Fair DARTS 论文结尾给了一个加性随机噪声实验,仍能得到不错的结果。

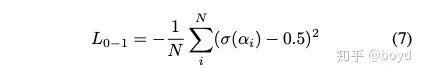

针对上述问题,本文提出两点策略,

打破排他竞争,给予每个 op 独立的结构化参数

辅助损失:0-1 loss,使结构化参数逼近0或1,缩小离散化gap

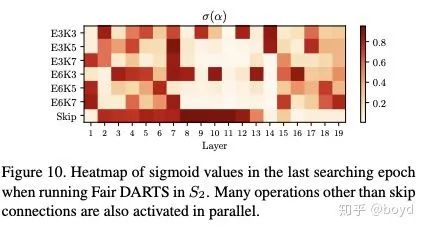

DARTS 和 FairDARTS 最终结构参数对比 (Figure 5 中 DARTS 的参数大量skip集中,FairDARTS中分布相对分散,且各 layer 中多个 op 参数都比较高),

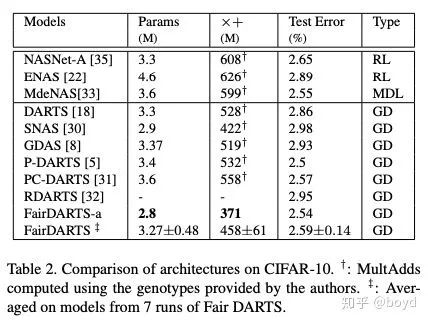

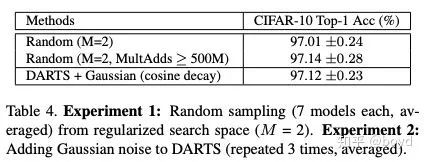

本文方法 7 次搜索结果都比较稳定(Table 2 最后一行),并在 DARTS 路线中首次出现了较小的模型 371M。

本文给了一个非公平优势的文字性定义:在优化过程中的贡献大于对最终网络的贡献(优化过程中虚报实力,实际并没那么强)。

Unfair Advantage. Suppose that choosing one operation amongst others is a competition. This competition is deemed exclusive when only one operation can be selected. An operation in an exclusive competition is said to have an unfair advantage if this advantage contributes more to competition than to the performance of a resulted network.

本文用了两个主流的 search space,在 CIFAR-10 和 ImageNet 都做了实验。

另外,根据本文的观点,限制最终 skip 的个数是很强的人为先验(Table 4中 M=2)。作为推论,干扰 skip 的优势也可以一定程度消除问题 1,即在原生 DARTS 上给 skip 的结构化参数混入高斯噪声,都取得了比较稳定的结果(两个实验均优于不稳定的原生 DARTS)。

本文的搜索、训练、验证代码也已同时公布。

欢迎大家批评指正。

【小米 AutoML 组招聘】

NAS 研究方向,校招/实习/社招均可。简历请发送至 zhangbo11@xiaomi.com

欢迎参阅小米 AutoML 组系列文章:

FairNAS: Rethinking Evaluation Fairness of Weight Sharing Neural Architecture Search arxiv.org/abs/1907.0184

MoGA: Searching Beyond MobileNetV3 arxiv.org/abs/1908.0131

ScarletNAS: Bridging the Gap Between Scalability and Fairness in Neural Architecture Search arxiv.org/abs/1908.0602

Fair DARTS: Eliminating Unfair Advantages in Differentiable Architecture Search arxiv.org/abs/1911.1212

下载

在CVer后台回复:ECCV2020,可下载论文的开源项目

重磅!CVer-论文写作与投稿交流群成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满2000+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

点赞和在看!让更多CVer看见