![]()

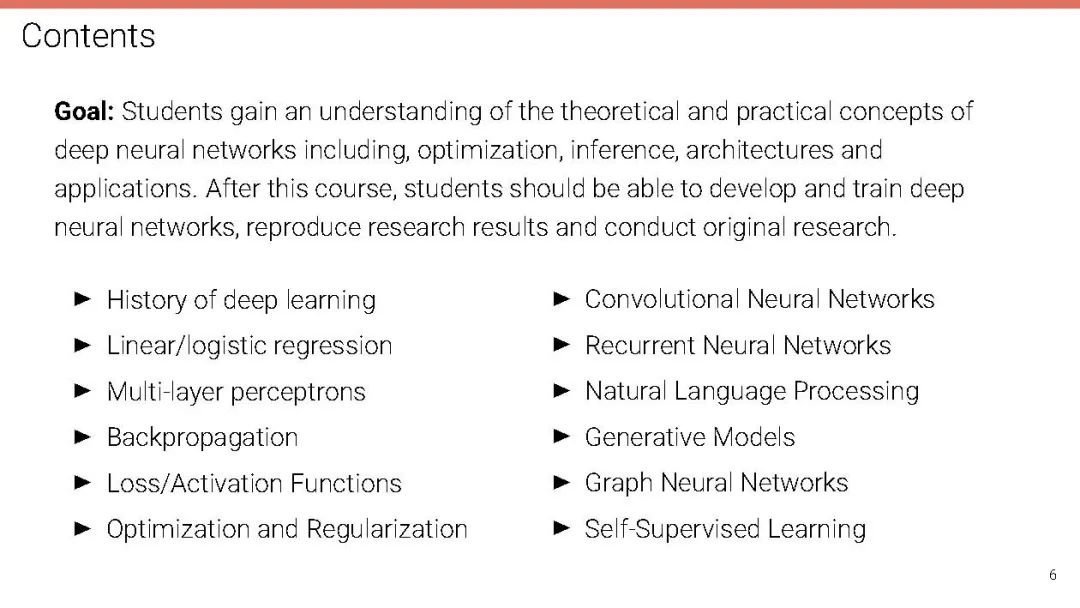

在过去的十年里,深度神经网络已经成为人工智能许多领域不可或缺的工具,包括计算机视觉、计算机图形学、自然语言处理、语音识别和机器人技术。本课程将介绍深度神经网络的理论与实践原理。在其他主题中,我们将涵盖计算图、激活函数、损失函数、训练、正则化和数据增强,以及各种基本和最先进的深度神经网络架构,包括卷积网络和图神经网络。该课程还将解决深度生成模型,如自动编码器,变分自动编码器和生成对抗网络。此外,在整个课程中,还将介绍来自不同领域的应用。本教程将通过在Python和PyTorch中实现和应用深度神经网络来加深对它们的理解。

https://uni-tuebingen.de/fakultaeten/mathematisch-naturwissenschaftliche-fakultaet/fachbereiche/informatik/lehrstuehle/autonomous-vision/lectures/deep-learning/

目录内容:

Date |

Lectures |

04.11. |

L01 - 引言 Introduction | Slides 1.1 Introduction | Video 1.2 History of Deep Learning | Video 1.3 Machine Learning Basics | Video |

11.11. |

L02 - 计算图 Computation Graphs | Slides 2.1 Logistic Regression | Video 2.2 Computation Graphs | Video 2.3 Backpropagation | Video 2.4 Educational Framework | Video |

25.11. |

L03 -深度神经网络 Deep Neural Networks | Slides 3.1 Backpropagation with Tensors | Video 3.2 The XOR Problem | Video 3.3 Multi-Layer Perceptrons | Video 3.4 Universal Approximation | Video |

02.12. |

L04 - 深度神经网络 Deep Neural Networks II | Slides 4.1 Output and Loss Functions | Video 4.2 Activation Functions | Video 4.3 Preprocessing and Initialization | Video |

09.12. |

L05 - 正则化 Regularization | Slides 5.1 Parameter Penalties | Video 5.2 Early Stopping | Video 5.3 Ensemble Methods | Video 5.4 Dropout | Video 5.5 Data Augmentation | Video |

16.12. |

L06 - 优化 Optimization | Slides

6.1 Optimization Challenges | Video 6.2 Optimization Algorithms | Video 6.3 Optimization Strategies | Video 6.4 Debugging Strategies | Video |

13.01. |

L07 - 卷积神经网络 Convolutional Neural Networks | Slides 7.1 Convolution | Video 7.2 Downsampling | Video 7.3 Upsampling | Video 7.4 Architectures | Video 7.5 Visualization | Video |

20.01. |

L08 - 序列模型 Sequence Models | Slides

8.1 Recurrent Networks | Video 8.2 Recurrent Network Applications | Video 8.3 Gated Recurrent Networks | Video 8.4 Autoregressive Models | Video |

27.01. |

L09 - 自然语言处理 Natural Language Processing | Slides 9.1 Language Models | Video 9.2 Traditional Language Models | Video 9.3 Neural Language Models | Video 9.4 Neural Machine Translation | Video |

03.02. |

L10 - 图神经网络 Graph Neural Networks | Slides 10.1 Machine Learning on Graphs | Video 10.2 Graph Convolution Filters | Video 10.3 Graph Convolution Networks | Video |

10.02. |

L11 - 自编码器 Autoencoders | Slides 11.1 Latent Variable Models | Video | Video 11.2 Principal Component Analysis | Video 11.3 Autoencoders | Video 11.4 Variational Autoencoders | Video |

24.02. |

L12 - 生成式对抗神经网络 Generative Adversarial Networks | Slides 12.1 Generative Adversarial Networks | Video 12.2 GAN Developments | Video 12.3 Research at AVG | Video |

笔记内容

![]()

引言

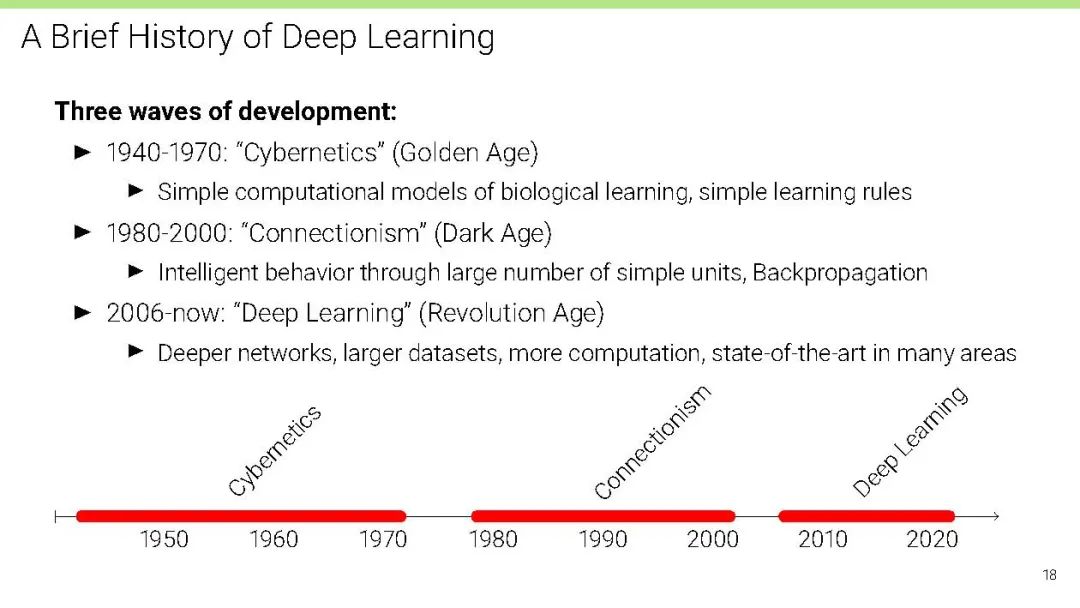

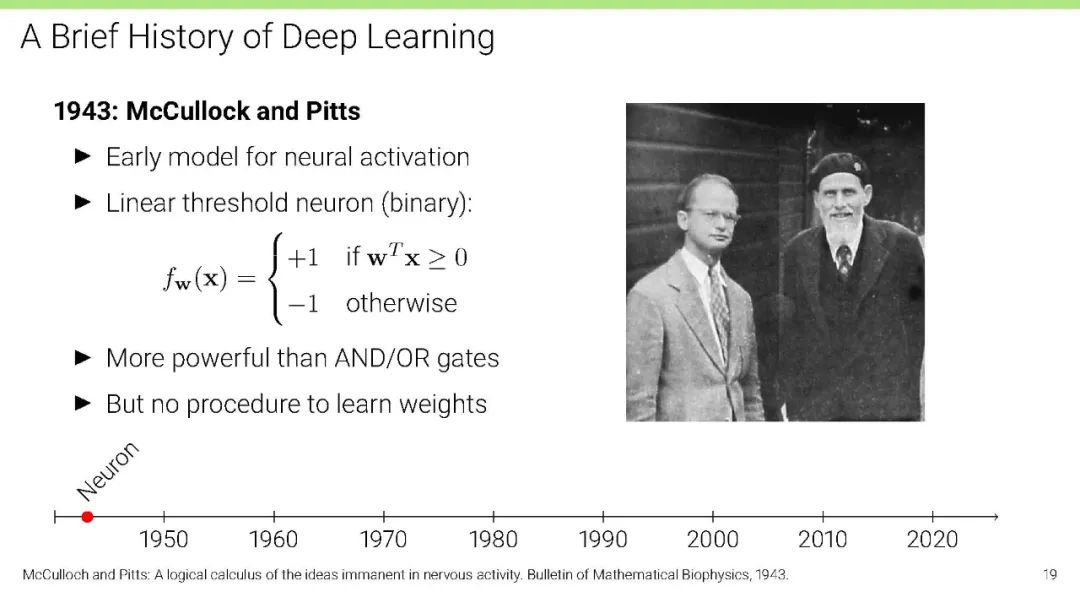

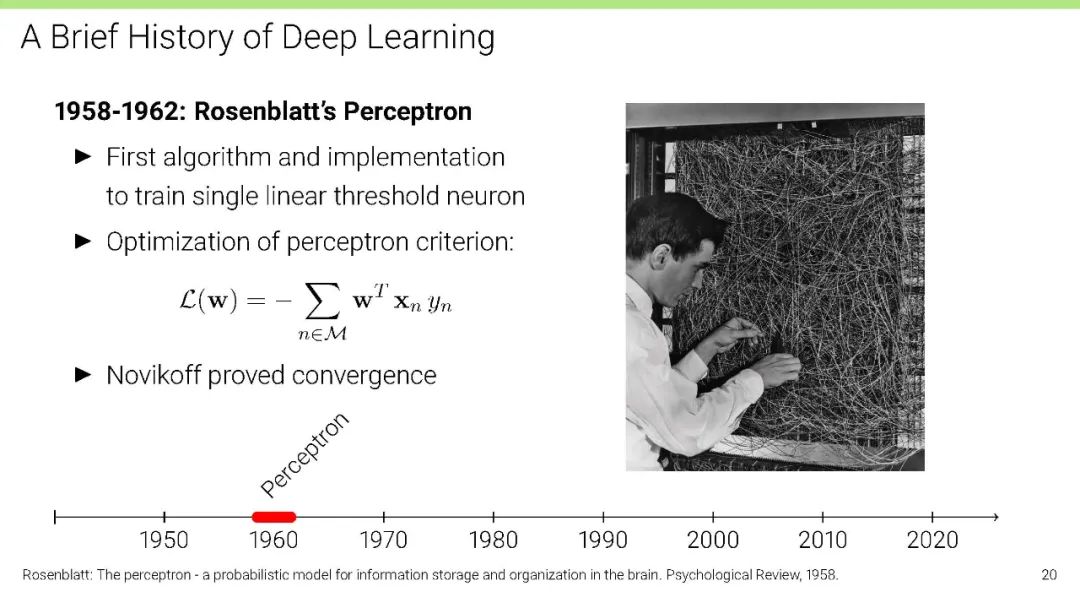

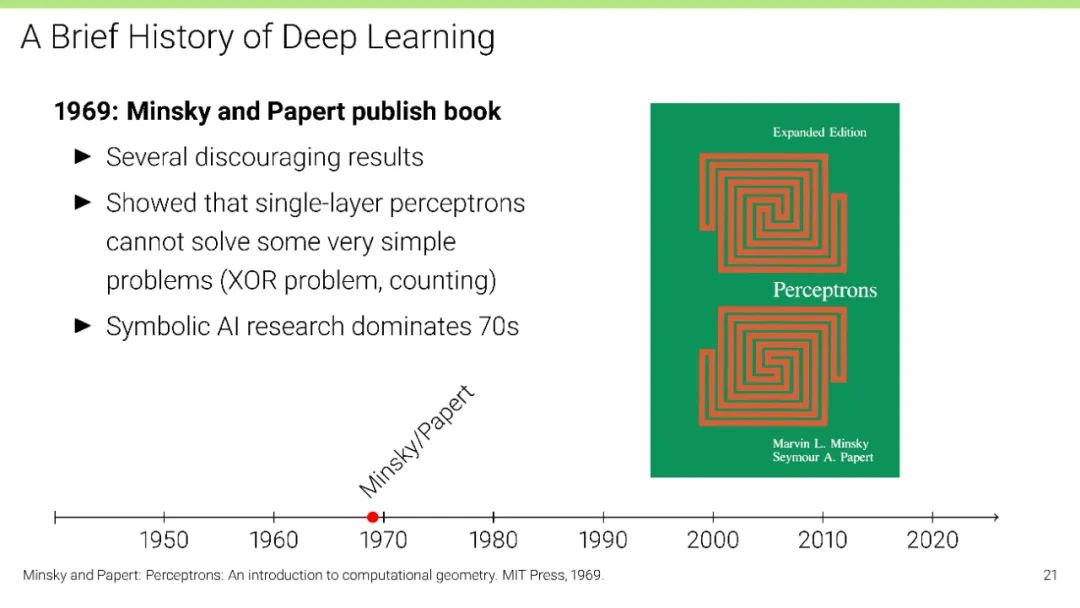

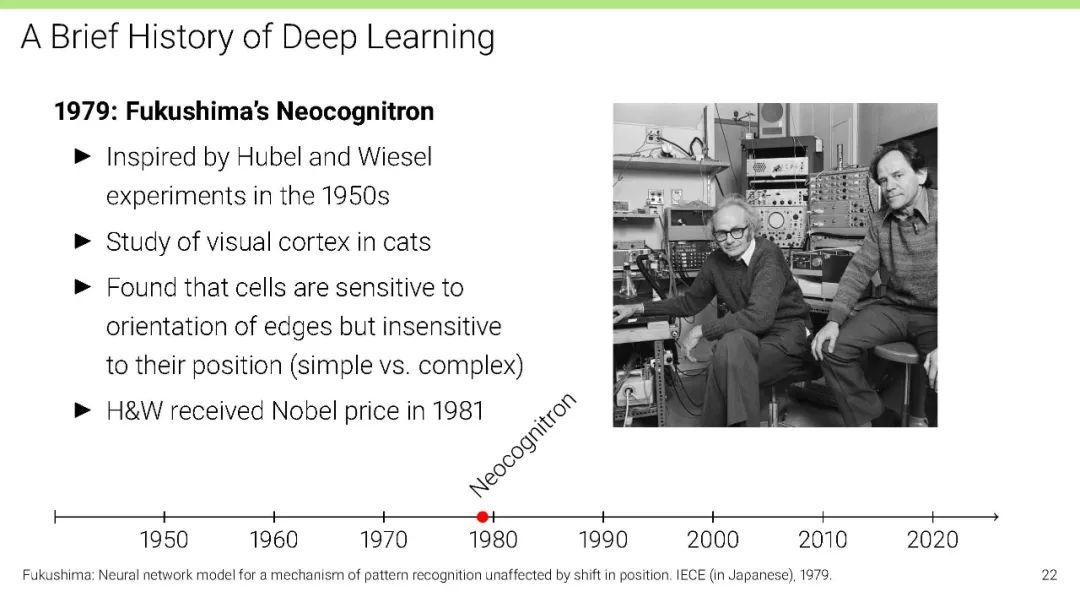

深度学习经历了三次浪潮。“深度学习”这个术语“在这些想法开始发展时并不存在”。在1940年到1970年的第一次浪潮中,深度学习被称为“控制论”。这一浪潮也被称为“黄金时代”,带来了许多伟大的发现和伟大的希望。那时,人们使用简单的大脑计算模型来模仿生物学习,学习简单的规则。这些规则可以成功地对简单模式进行分类。但人们意识到,这些简单的模型不够强大,不足以解决复杂的任务,这导致了研究的减少。在1980年至2000年的第二次浪潮中,深度学习被与连接主义联系在一起。在连接主义中,假定智能行为是通过大量的简单单元来实现的。反向传播和序列模型也已经发展。尽管这些进展非常重要,但由于缺乏算法、计算方式和数据,这些进展被其他研究领域的部署所掩盖。这就是为什么这一时期也被称为“黑暗时代”。从2006年到现在,深度学习实际上被称为“深度学习”。这可以被称为“革命时代”,在这个时代,有了更深入的网络、更大的数据集和更多的计算,深度学习正在引领最先进的结果,几乎在所有不同领域和学科的排行榜上占据主导地位。

对于下一代人工智能,我们仍然面临着一些挑战,比如自监督学习、交互式学习、准确性(例如自动驾驶)、健壮性和泛化性、归纳偏差、理解和数学、记忆和计算,以及最后但并非最不重要的伦理和法律问题。至于“人工智能的摩尔定律”是否会“继续下去”,这个问题仍然悬而未决。

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

![]()

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

专知,专业可信的人工智能知识分发

,让认知协作更快更好!欢迎注册登录专知www.zhuanzhi.ai,获取5000+AI主题干货知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程资料和与专家交流咨询!

点击“

阅读原文

”,了解使用

专知

,查看获取5000+AI主题知识资源