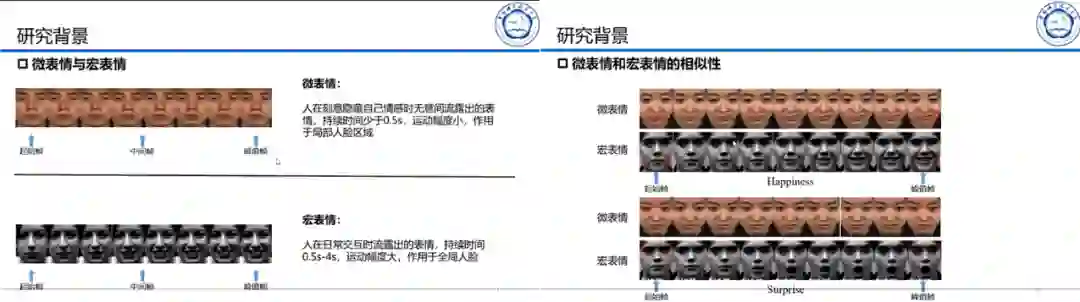

微表情是一种短暂的、微弱的、无意识的面部微表情,持续时间往往在

0.5s内,能够揭示人类试图隐藏的真实情绪。微表情识别的研究旨在让机器有足够的智能,能够从人脸视频序列中识别人类的真实情绪。然而由于微表情持续时间短、面部肌肉运动强度低,对其进行准确的表征与识别是一项极具挑战性的任务。为了促进心理学领域和计算机视觉领域针对微表情的进一步研究,

由中国图象图形学学会(CSIG)主办、CSIG机器视觉专业委员会承办,

中国科学院心理研究所的王甦菁博士组织

了

一系列云上微表情的学术活动。

![]()

第十五期云上微表情于2021年4月29日晚上7点进行,由中国科学院心理研究所王甦菁老师团队的李婧婷博士主持。此次讲座的主题为人机交互下的看脸读心:从宏表情到微表情,由来自北京科技大学谢仑教授团队的在读博士生潘航和来自中国科学技术大学王上飞教授团队的在读硕士生夏斌分别分享他们在微表情检测和微表情识别方面的工作。报告得到了微表情研究领域的广泛关注,期间有四十多位听众参加了此次讲座。

1. 基于局部双线性卷积神经网络的微表情检测方法 - 北京科技大学博士生潘航

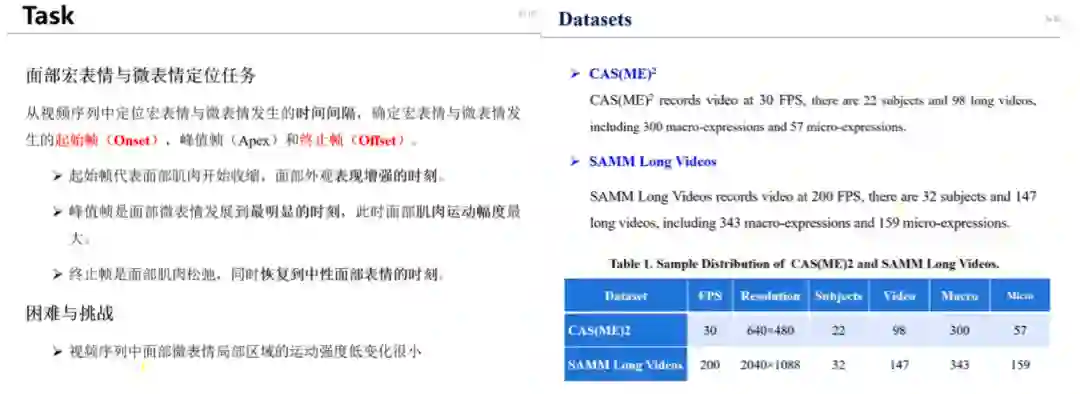

潘航首先通过宏表情和微表情的对比介绍了微表情的特点和相关应用,并对面部宏表情和微表情在视频中的检测任务和相关数据库(中国科学院心理研究所发布的

CAS(ME)2

和英国曼彻斯特城市大学发布的SAMM-Long Videos)进行了介绍。

![]()

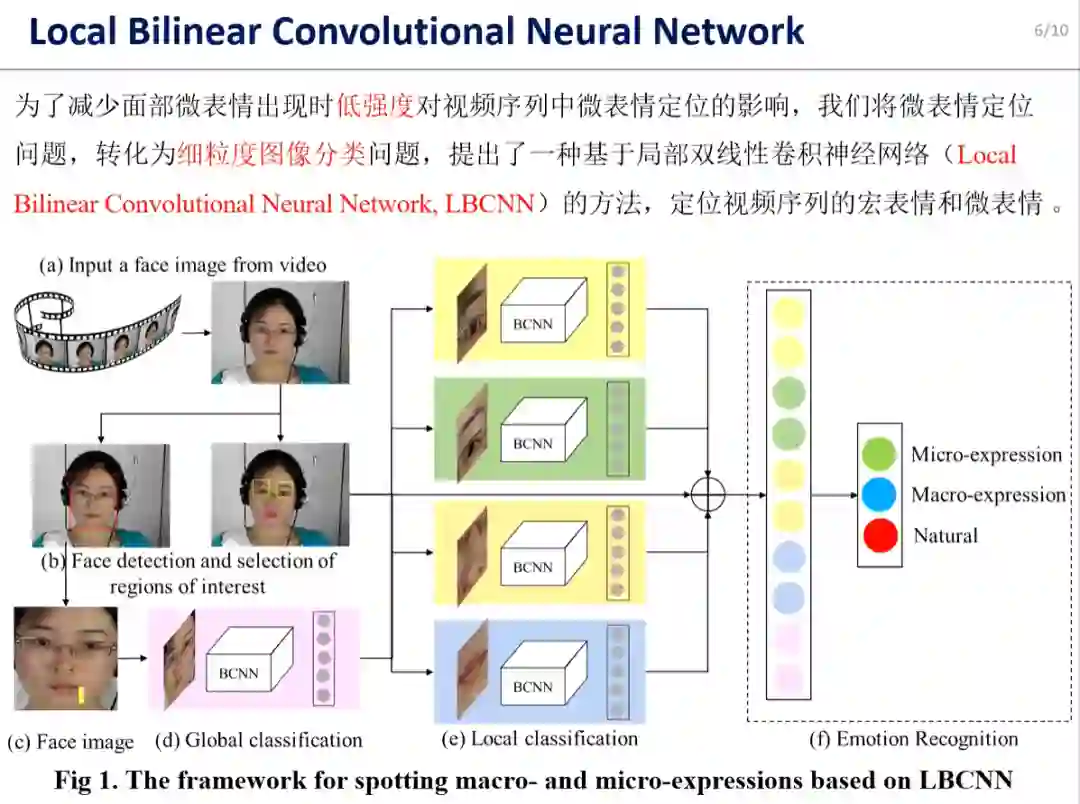

然后潘航介绍了他们提出的基于局部双线性卷积神经网络的长视频宏表情和微表情检测方法。他提出:同一个个体的宏表情和微表情的特征差异较小,但是不同个体间的表情特征差异可能较大。为了更好地学习微表情的微小局部特征,潘航将宏表情和微表情的检测问题转换为细粒度图像分类问题。下图是他们的方法框架。

![]()

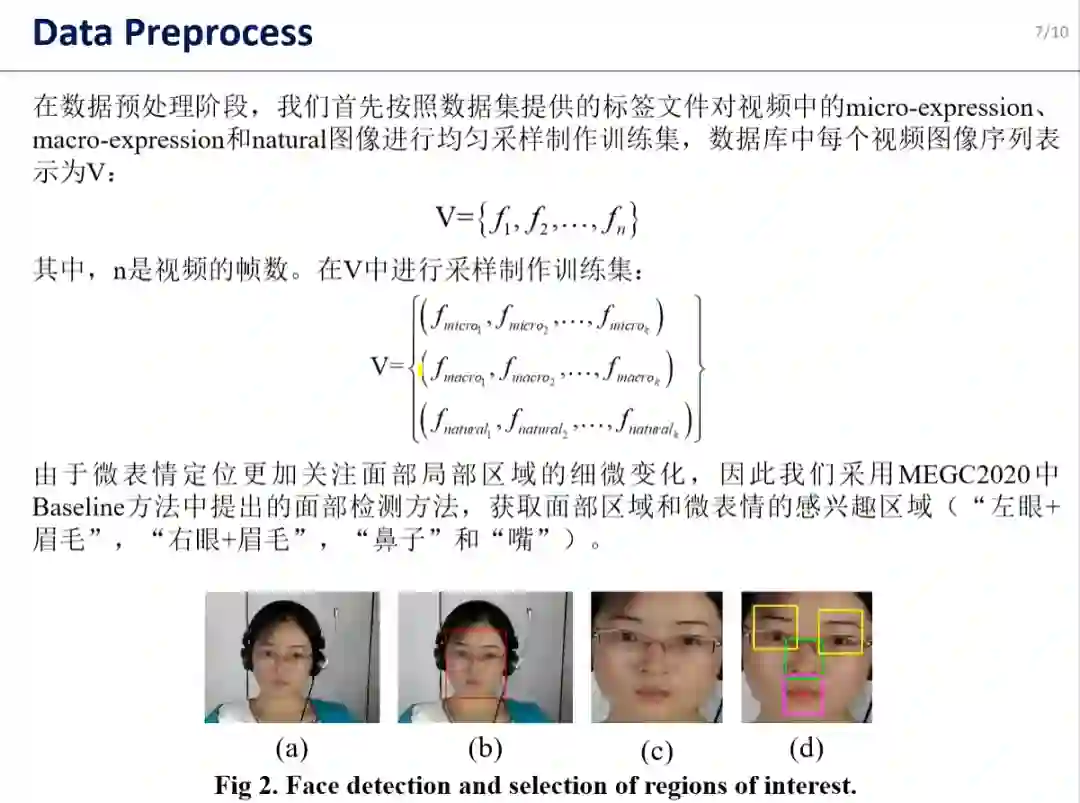

其中,在数据预处理的阶段,潘航对宏表情、微表情和中性脸在数据集中进行了均匀采样,并在人脸裁剪的基础上在人脸上选择了四个针对微表情的兴趣区域。

![]()

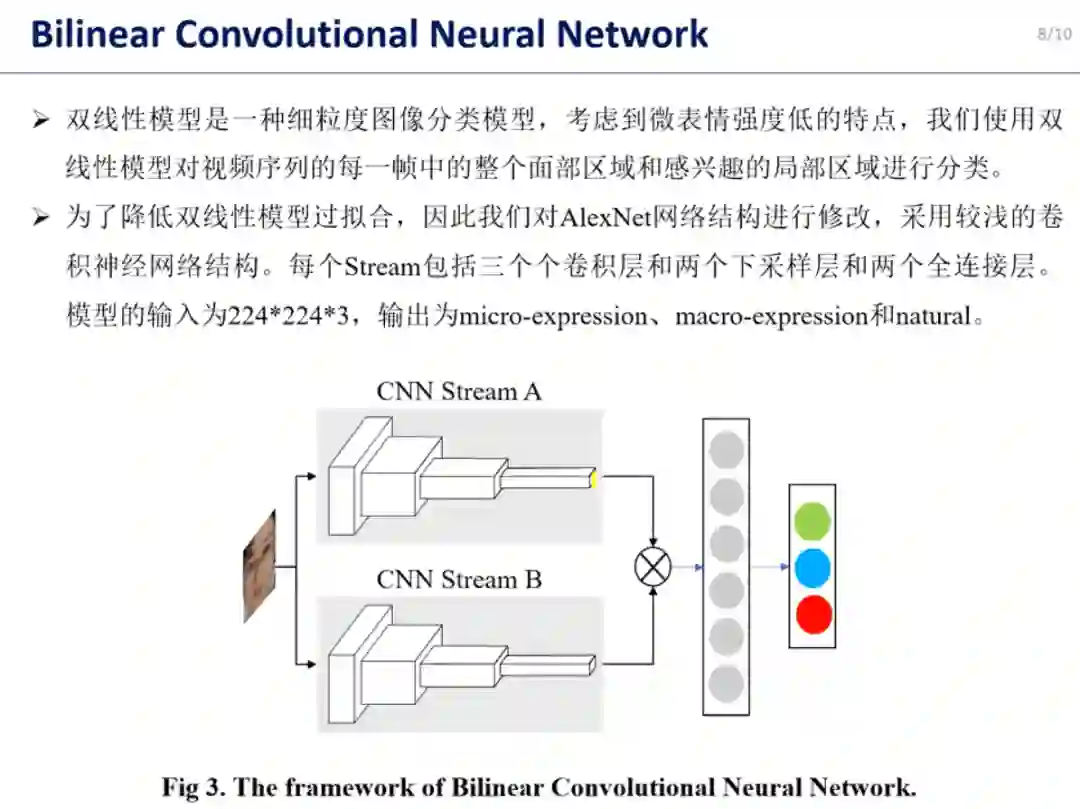

在模型训练的阶段,四个人脸兴趣区域被输入到基于AlexNet结构的双线性浅层卷积神经网络,最终通过融合得到输出结果:宏表情、微表情和中性脸。

![]()

在性能评估的部分,潘航主要介绍了微表情挑战大赛(M

EGC2020

)提出的微表情检测结果衡量方法,其中真阳性(T

P

)区间的判定需要满足检测区间和真值区间的交集除以两者的并集应当大于0

.5

。基于T

P

的定义,可以得到方法在测试集的精确率、召回率和F

1

-分数。

![]()

接下来,潘航对检测结果进行了详细分析。首先,他们提出方法的检测结果优于M

EGC2020

的基线方法。其次,潘航介绍了每个数据库中宏表情和微表情的检测性能,包括真阳和假阳数目对F

1-

分数的影响。

最后,潘航对当前检测方法存在的问题进行了总结并对未来的研究方法进行了展望,包括局部区域的特征提取、迁移学习和无监督学习方法的引入。

2. 从宏表情中学习:一个微表情识别框架 – 中国科学技术大学硕士生夏斌

同样,夏斌同学首先介绍了微表情和宏表情的定义和应用场景。由于微表情的样本量比较少并且微表情本身十分微小短暂,基于微表情数据训练的网络框架鲁棒性比较弱。与此同时,宏表情具有较强的运动强度和较长的持续时间,并且和微表情的肌肉运动有相似性。因此,如何利用大量的宏表情数据来辅助微表情识别研究,是他们研究的方向。

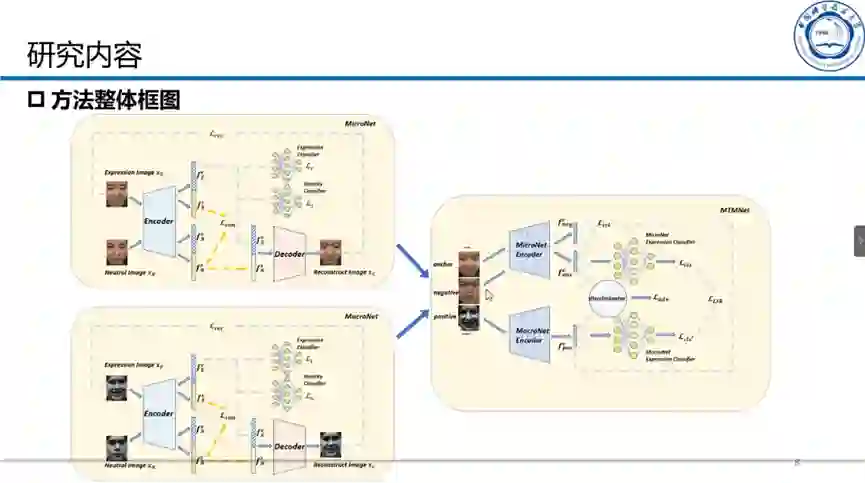

![]()

然后夏斌同学介绍了他们的方法框架,如下图所示。首先,为微表情设计了一个表情身份解缠网络(如图左上部分)。将微表情的表情图像和无表情图像输入到解缠网络,分离得到微表情样本的表情信息和身份信息,并将表情信息用于后续的分析。同理,为宏表情样本设计了一个表情身份解缠网络(如图左下部分)。然后,搭建从宏表情到微表情的迁移网络(如图右半部分),利用三元组分类(微表情图片(固定样本),同一组别的宏表情样本(正样本),不同类别的微表情图片(负样本)),通过解缠网络的编码器提取表情信息,在特征空间和标签空间中,将宏表情的信息迁移到微表情,实现微表情识别。

![]()

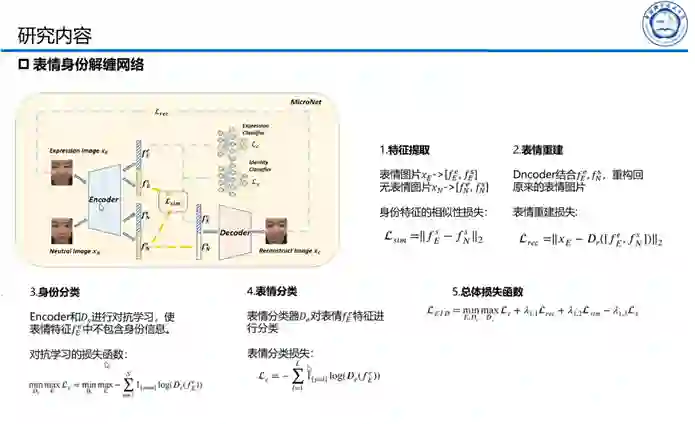

接下来,夏斌同学主要介绍了表情身份解缠网络框架图,通过一些约束,从微表情图中得到表情特征,减少身份信息对微表情信息的干扰。下图展示了解缠网络的关键步骤。

![]()

然后,夏斌同学介绍了从宏表情到微表情的迁移网络搭建的关键步骤,如下图所示。

![]()

最后,通过消融实验分析以及与其它相关工作的结果对比,夏斌同学证明了该方法提升了微表情识别的性能。

在讨论环节,听众们踊跃发言,提出了很多非常有讨论意义的问题,其中包括微表情检测方法中时域特征的提取、数据库样本差异对网络性能的影响、以及基于宏表情迁移学习的样本量等问题。

在活动的最后,讲座的主持人李婧婷博士对活动进行了总结并对第十六期

CSIG

云上微表情活动进行了大致预告。敬请继续关注!

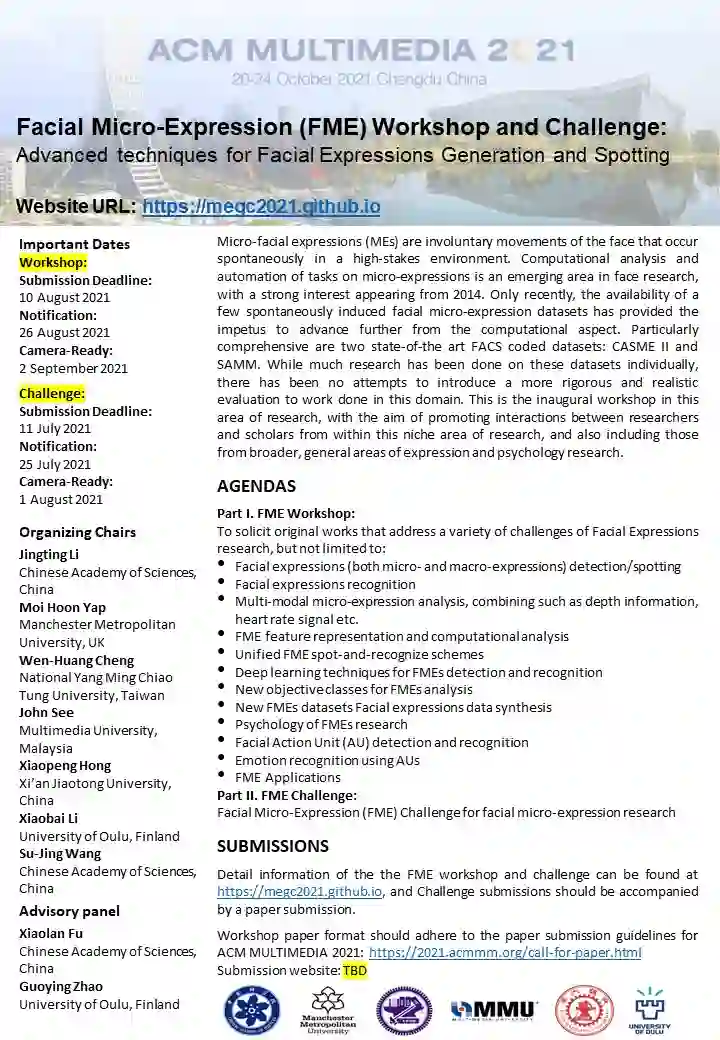

另外,李博士还介绍了将由A

CM M

ultimedia

2021

举办的微表情研讨会和挑战赛,挑战赛将分为两个任务,分别为长视频中微表情和宏观表情的检测、以及微表情生成。研讨会和挑战赛的相关细节将在网站上(http

s://megc2021.github.io

)陆续发布,欢迎大家关注。

![]()

此次讲座的回放已经发布在B站:https://www.bilibili.com/video/BV1oN411Z7jm,欢迎观看!两位同学此次分享内容的相关文献如下:

[1] Pan, H., Xie, L., & Wang, Z. (2020). Local bilinear convolutional neural network for spotting macro-and micro-expression intervals in long video sequences. In 2020 15th IEEE International Conference on Automatic Face and Gesture Recognition (FG 2020)(FG) (pp. 343-347). IEEE Computer Society.

[2] Xia, B., Wang, W., Wang, S., & Chen, E. (2020, October). Learning from Macro-expression: a Micro-expression Recognition Framework. In Proceedings of the 28th ACM International Conference on Multimedia (pp. 2936-2944).

祝大家五一劳动节快乐!