斯坦福教授ICLR演讲:图网络最新进展GraphRNN和GCPN(附PPT下载)

新智元报道

新智元报道

编辑:肖琴

【新智元导读】图网络领域的大牛、斯坦福大学Jure Leskovec教授在ICLR 2019就图深度生成模型做了演讲,阐述了图生成模型的方法和应用,并详细介绍了他的最新成果

斯坦福大学教授 Jure Leskovec 是图网络领域的专家,图表示学习方法 node2vec 和 GraphSAGE 作者之一。

Jure Leskovec

在今年 ICLR,Jure Leskovec 教授及斯坦福、MIT 的多名研究者发表论文 How Powerful Are Graph Neural Networks?(https://cs.stanford.edu/people/jure/pubs/gin-iclr19.pdf),详细阐述了图神经网络背后的原理和其强大的表征能力,认为图神经网络在因果推理方面有巨大的潜力,有望成为 AI 的下一个拐点。

参考阅读:

图神经网络将成 AI 下一拐点!MIT 斯坦福一文综述 GNN 到底有多强

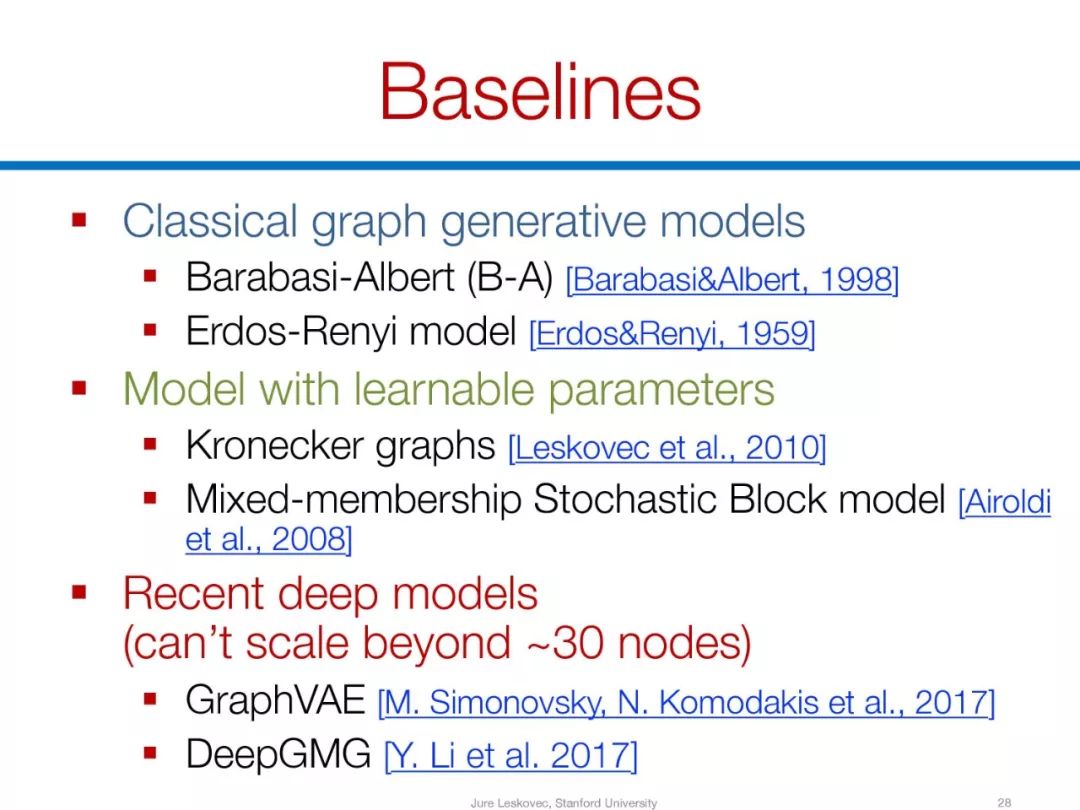

此外,在 ICLR 受邀演讲上,Jure Leskovec 教授还就图深度生成模型做了演讲。在这次演讲中,Jure 阐述了图生成模型的方法和应用,并详细介绍了他的最新成果,GraphRNN 和 Graph Convolutional Policy Network。

本文带来该演讲的 PPT。

下载链接 (或点击阅读原文下载):

http://i.stanford.edu/~jure/pub/talks2/graph_gen-iclr-may19-long.pdf

主要内容:

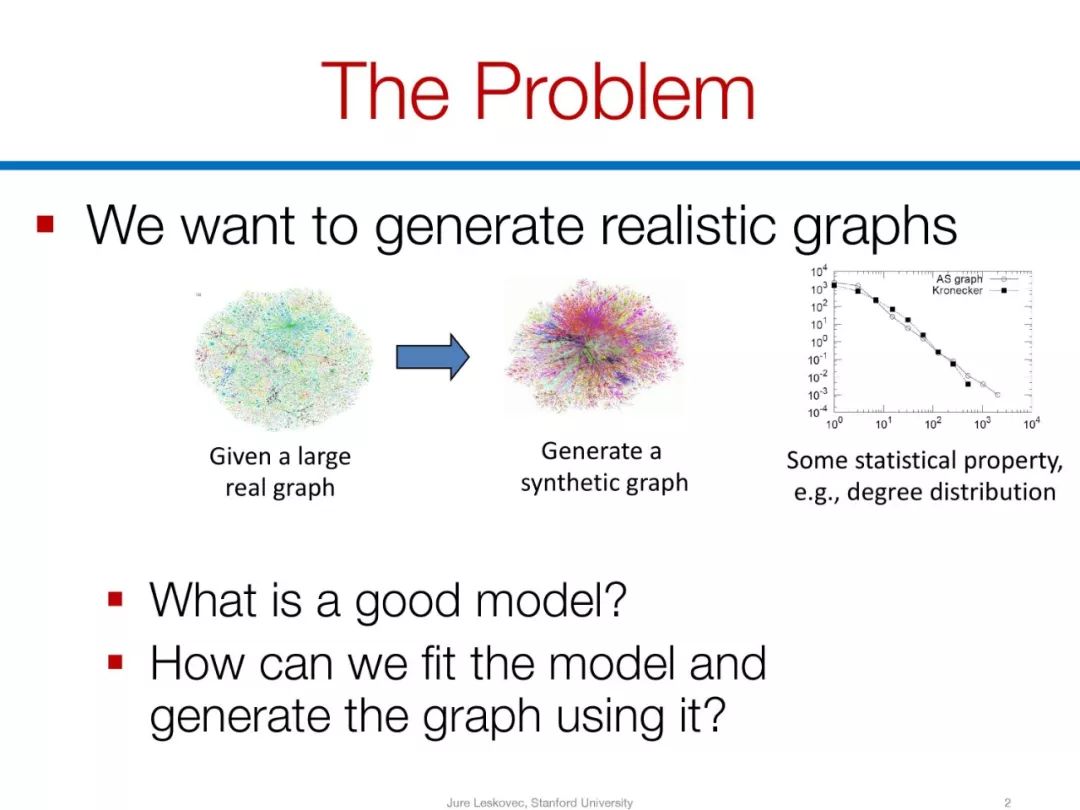

为什么图网络很重要?

图生成任务

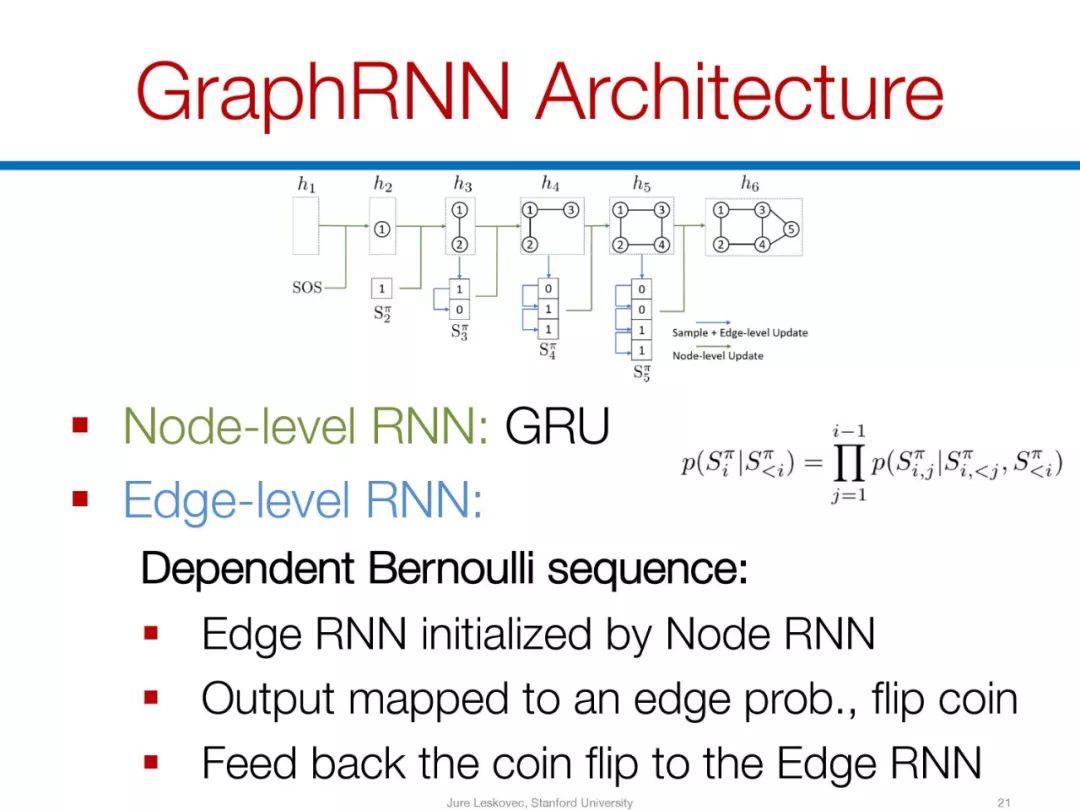

GraphRNN:RNN 的两个层次

图卷积策略网络:将图表示和强化学习结合起来

为什么图网络很重要?

为什么图网络很重要?

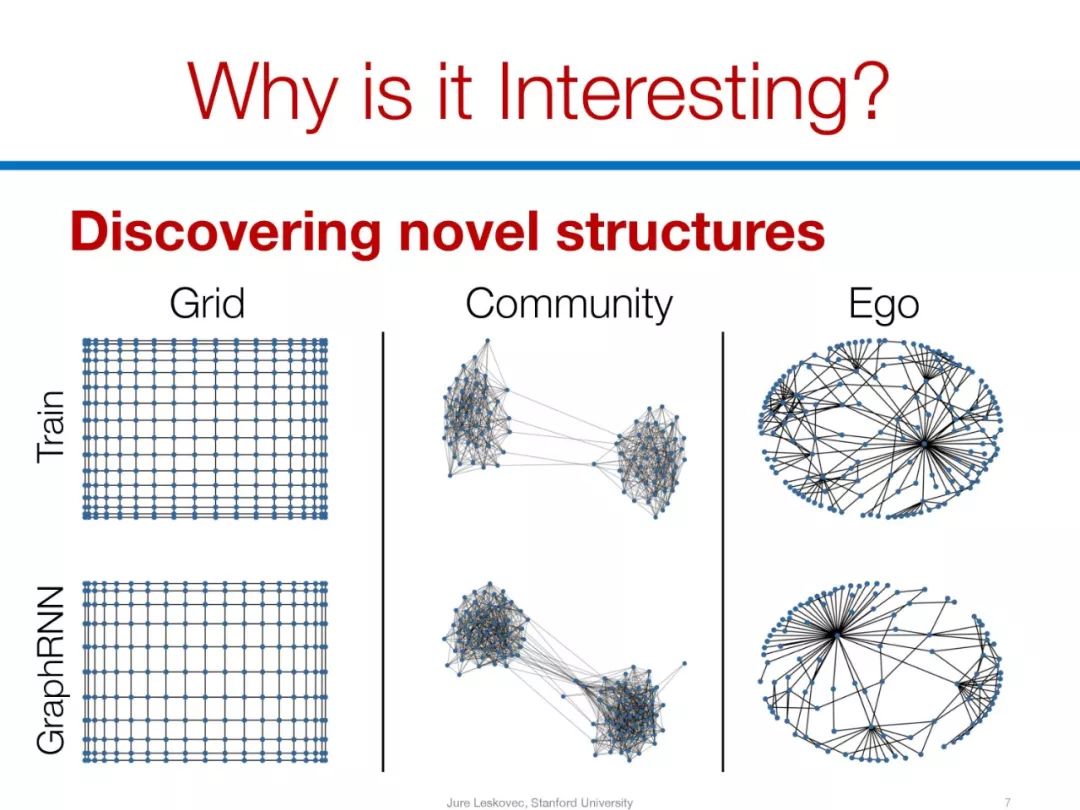

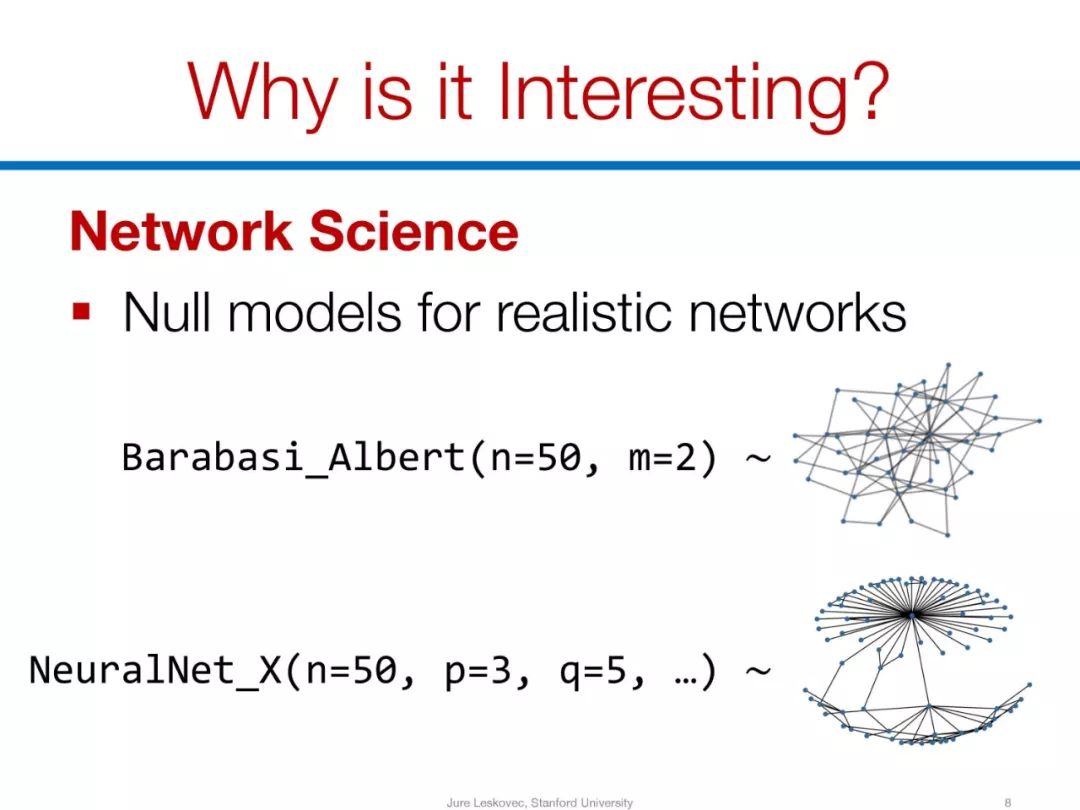

深入了解图的形成过程

异常检测 - 异常行为,进化

预测 —— 根据过去预测未来

新的图结构的模拟

图补全 - 很多图都是部分可观察的

“如果” 场景

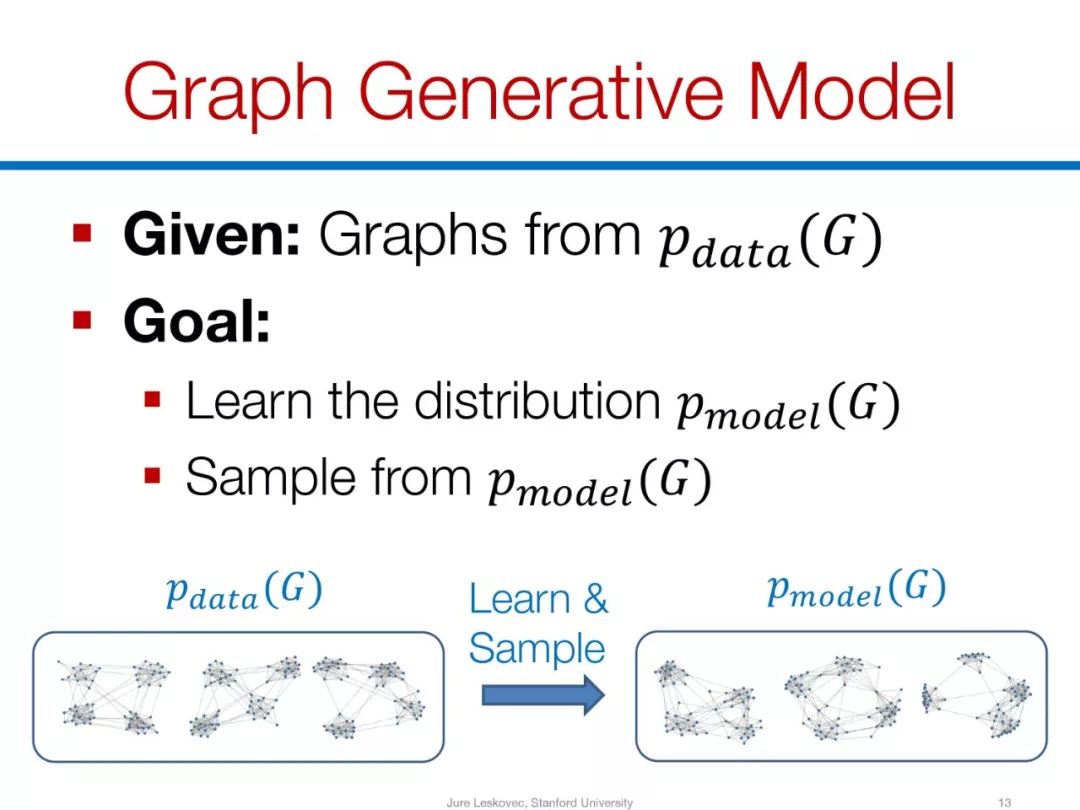

图生成任务

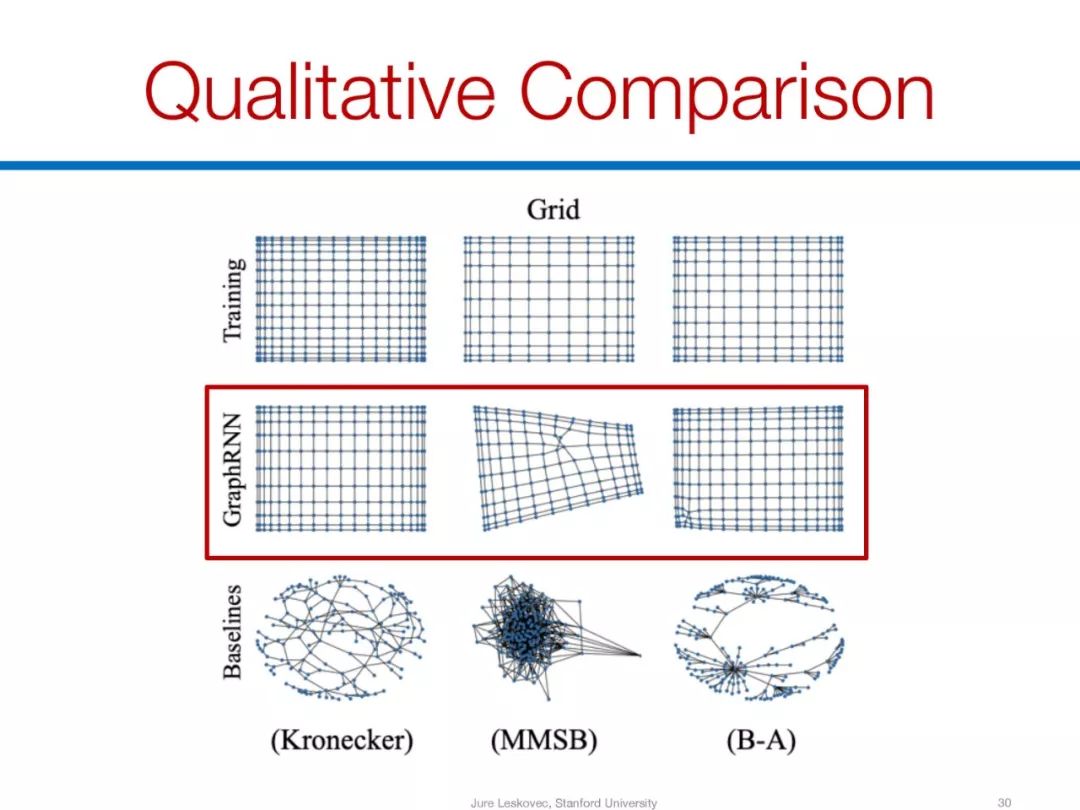

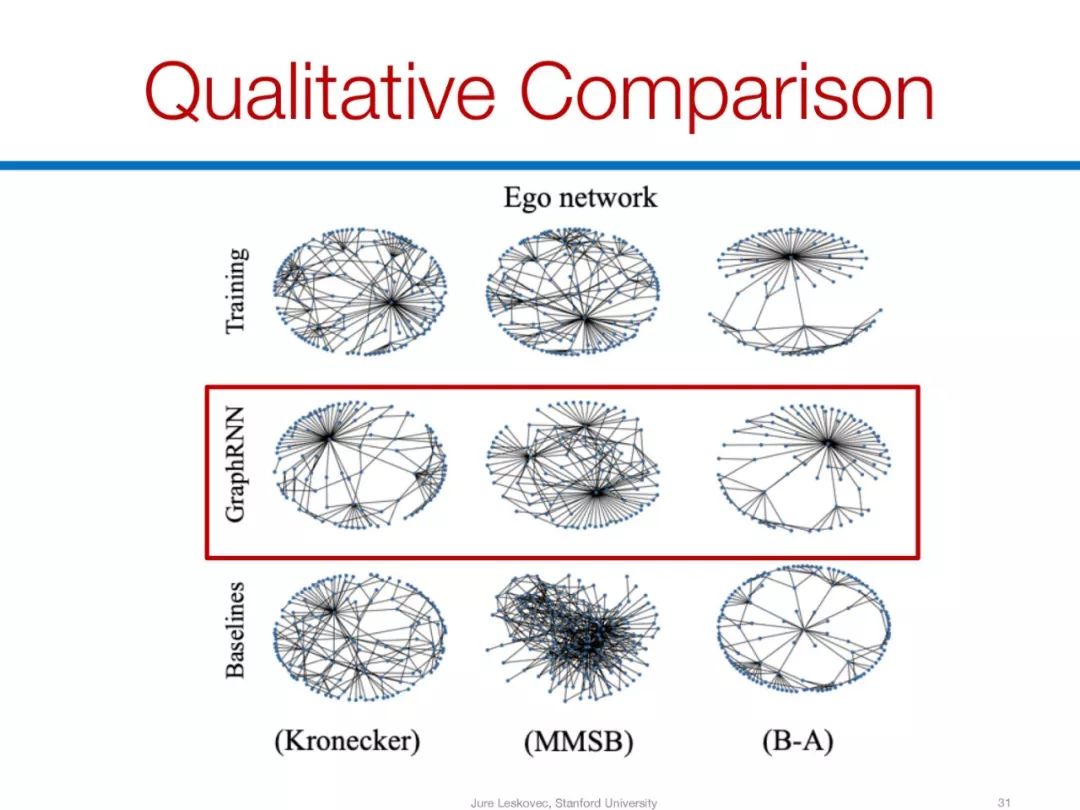

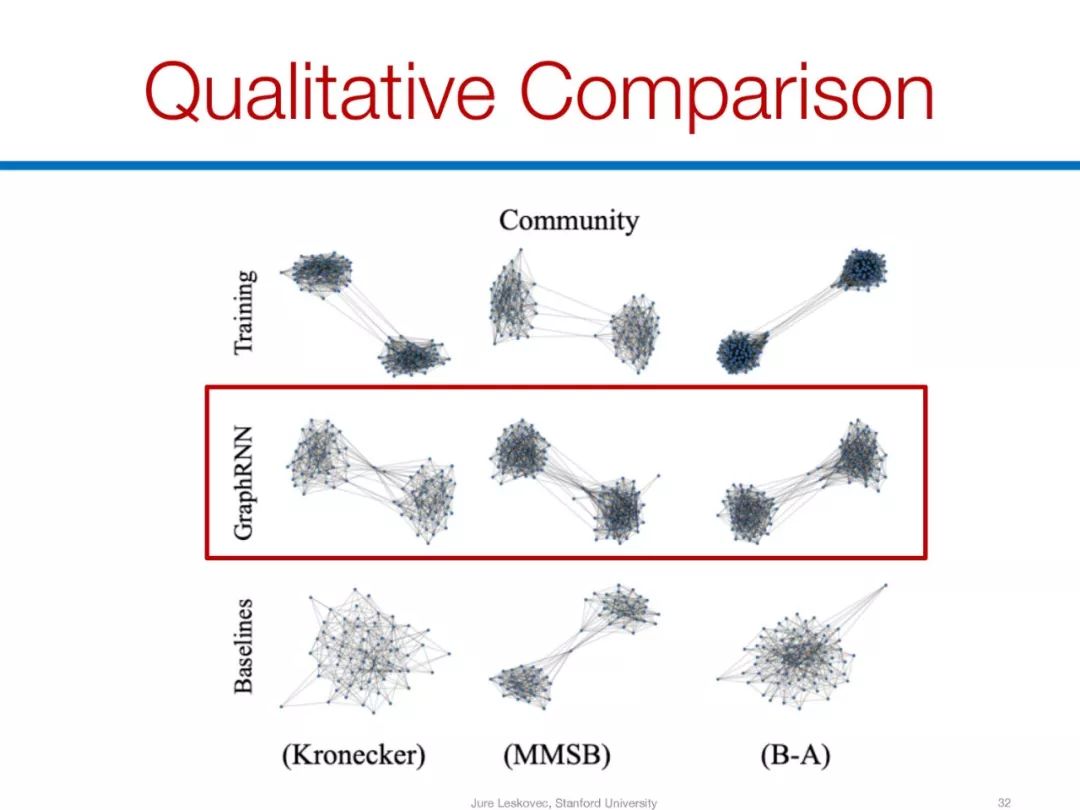

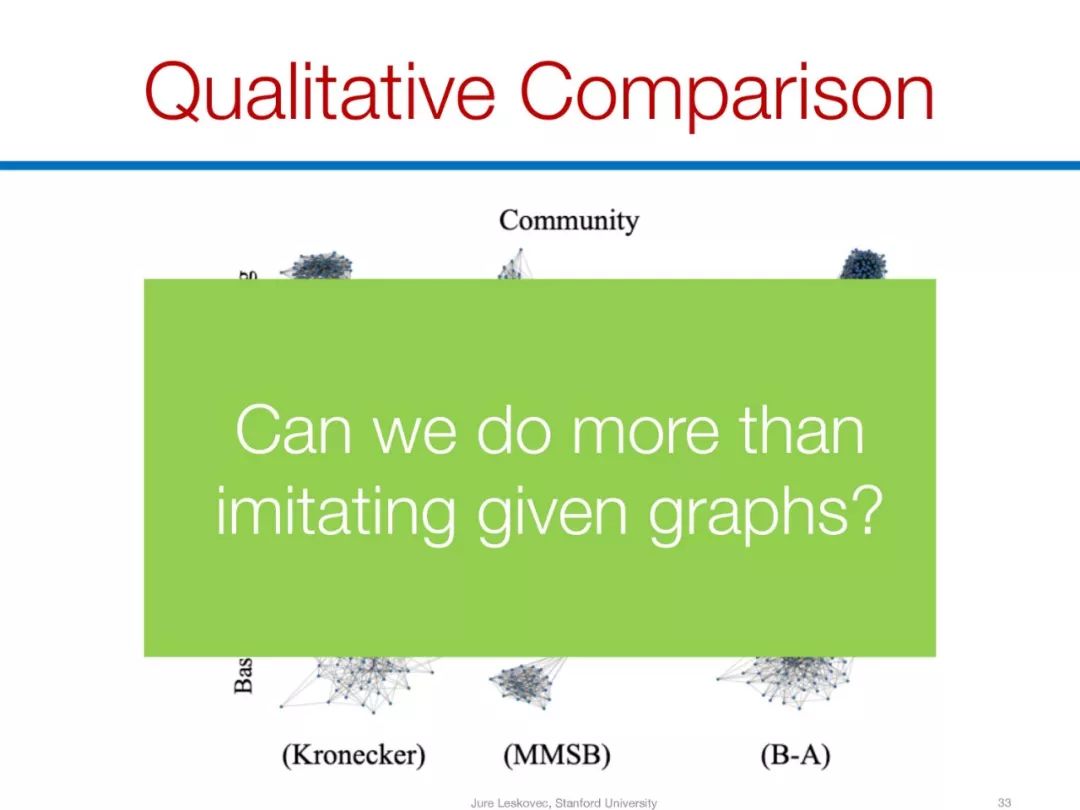

任务 1:生成逼真的图

生成与给定数据集相似的图

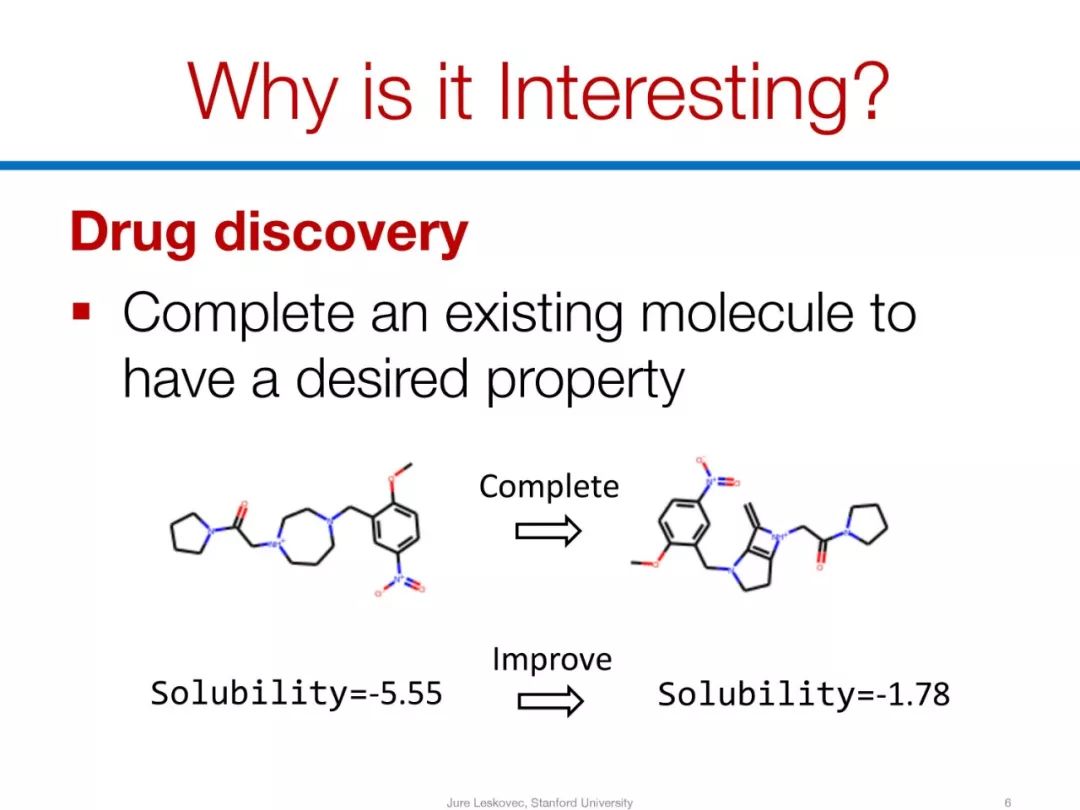

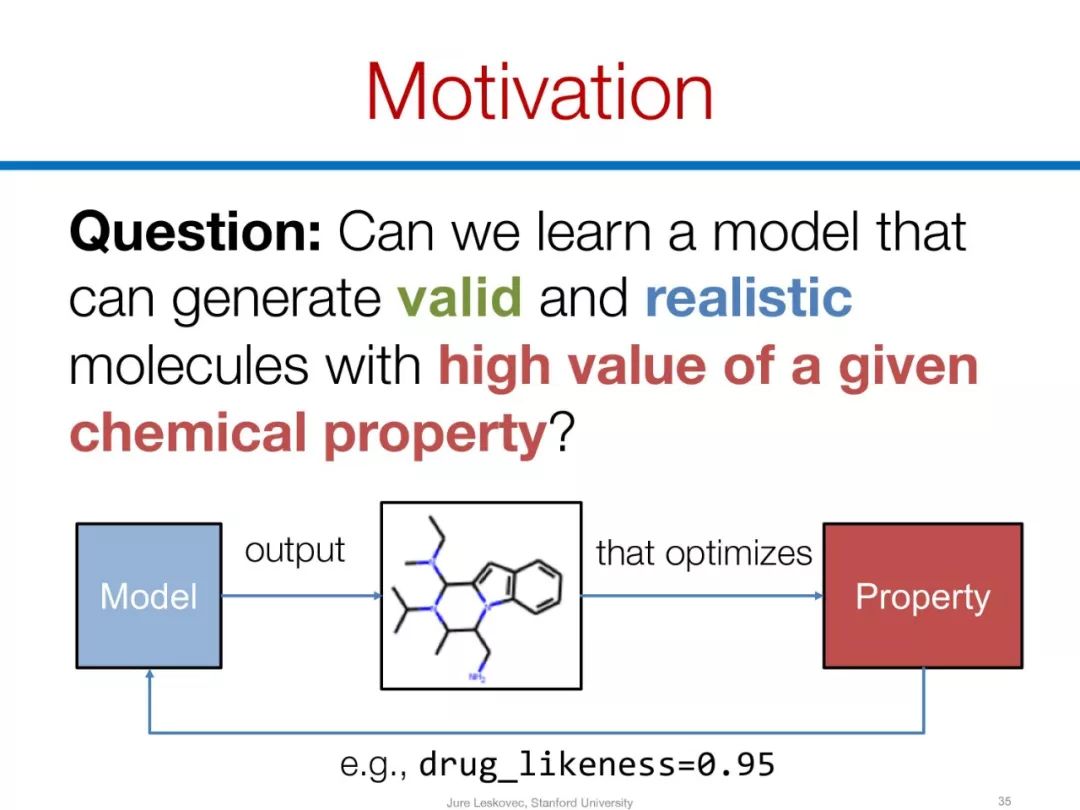

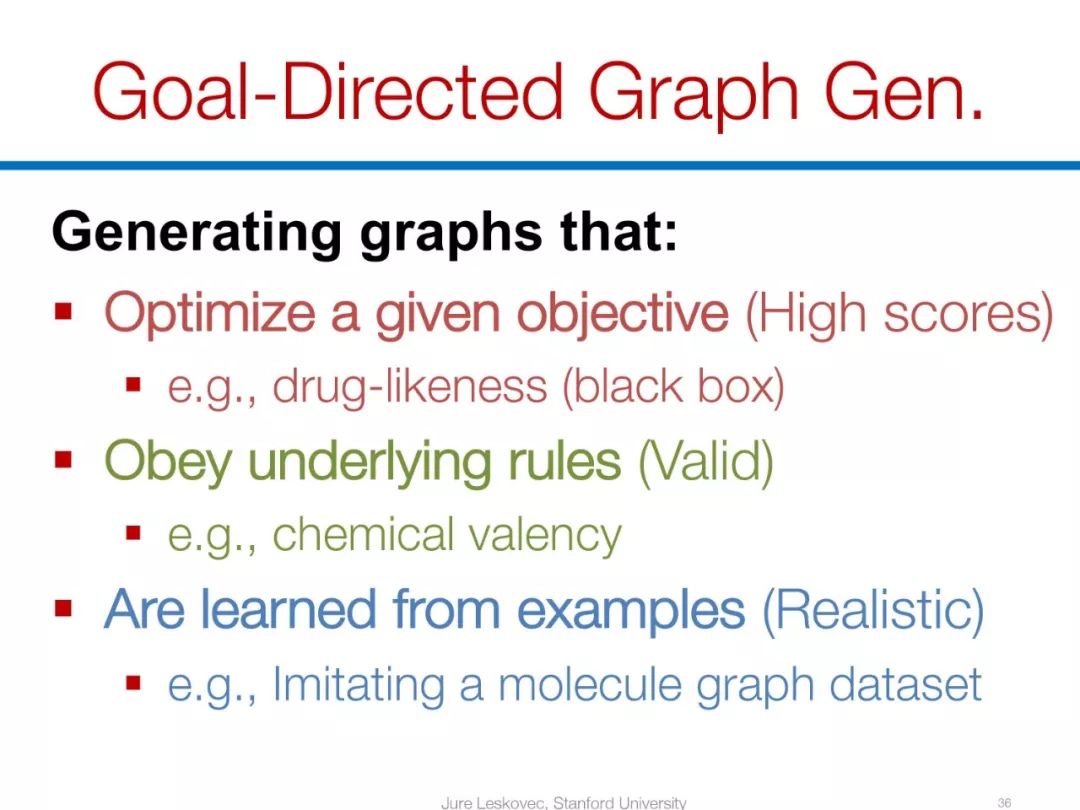

任务 2:目标导向的图生成

生成优化给定目标 / 约束的图

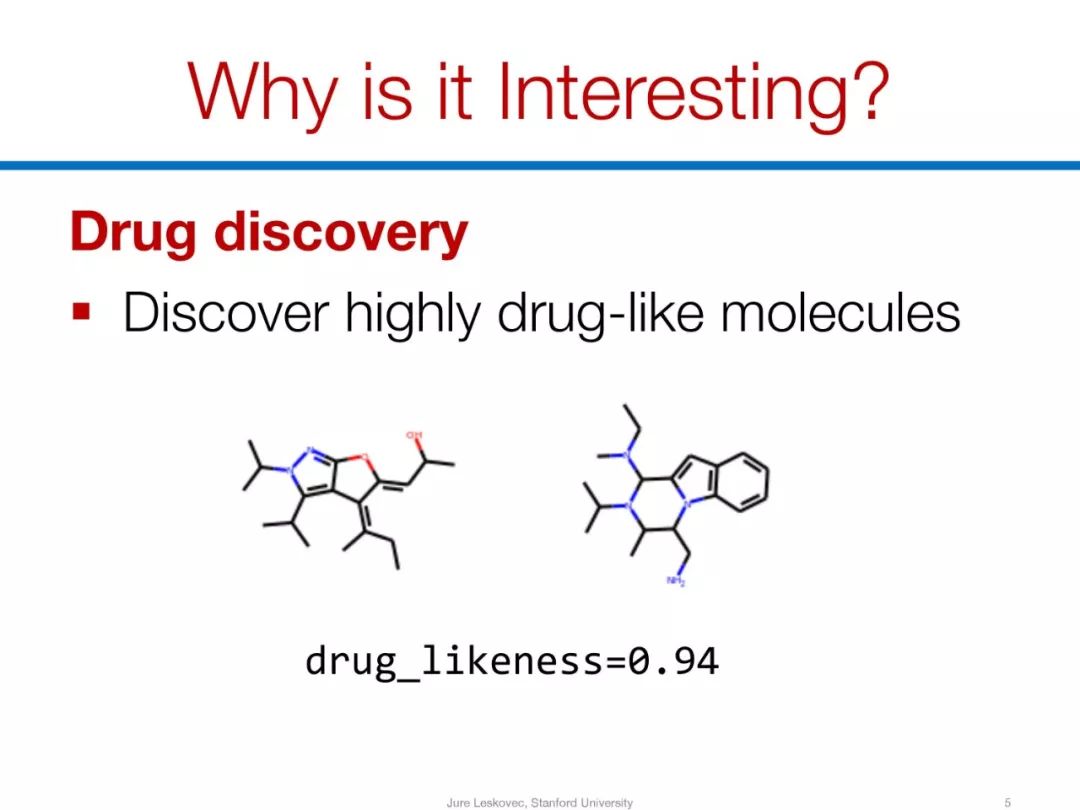

药物分子生成 / 优化

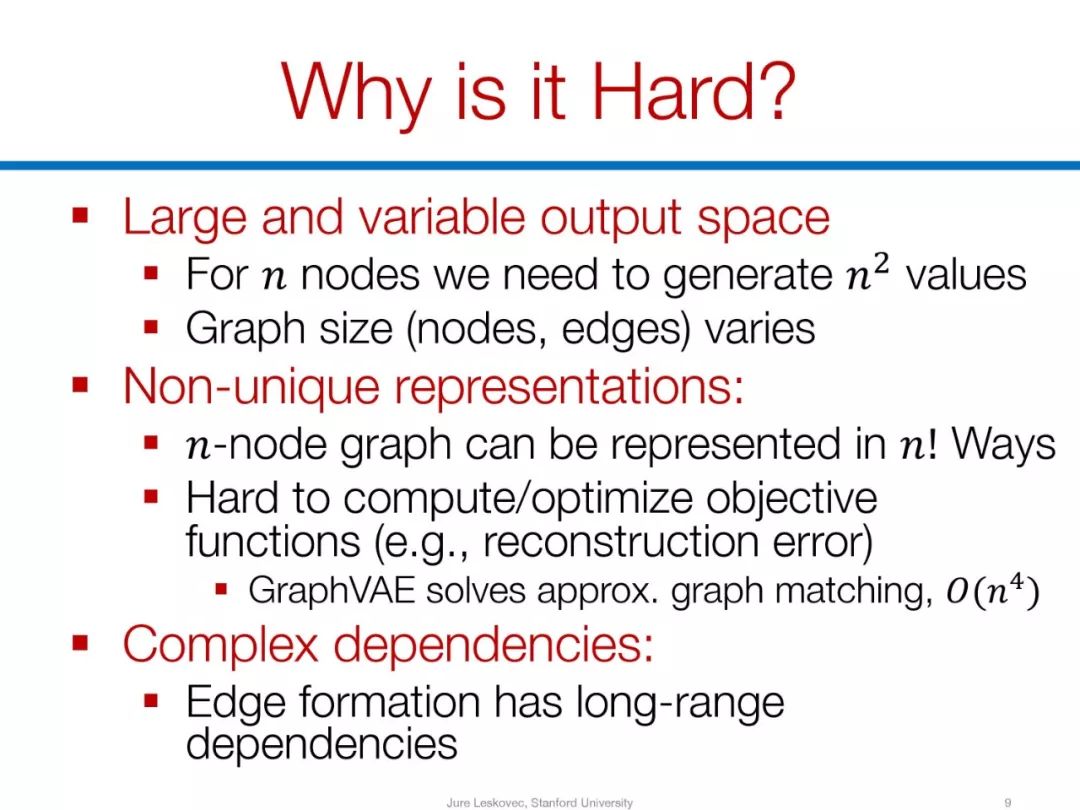

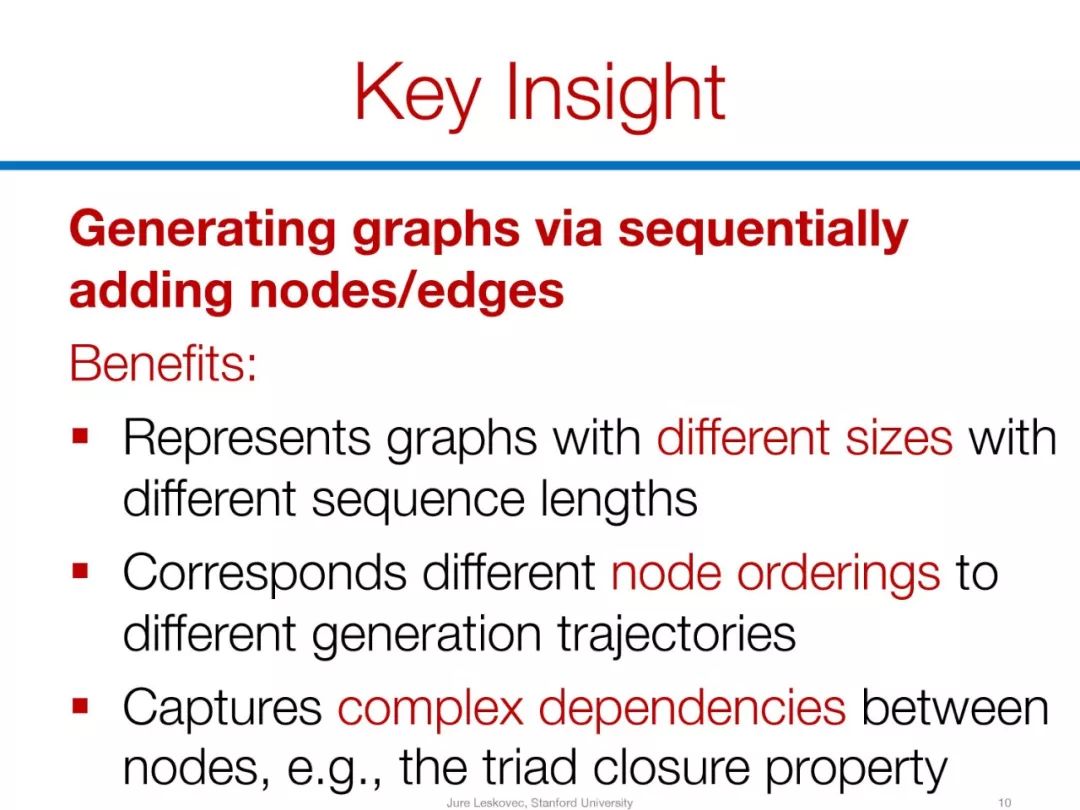

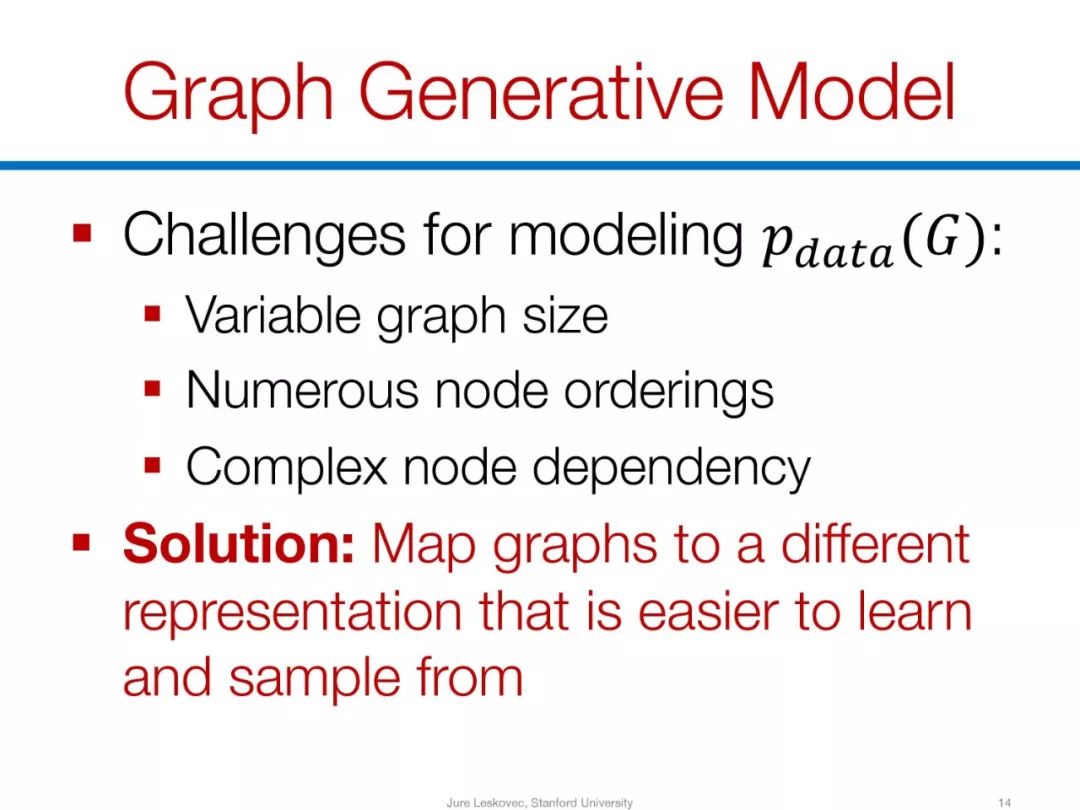

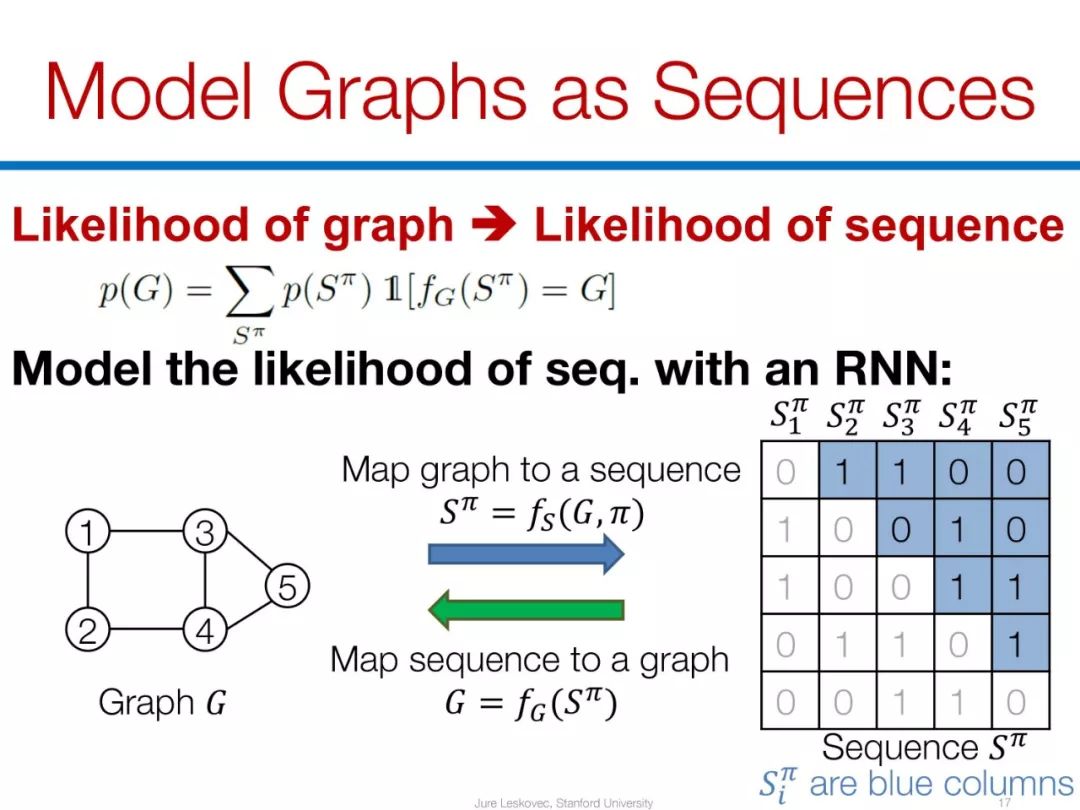

关键的见解

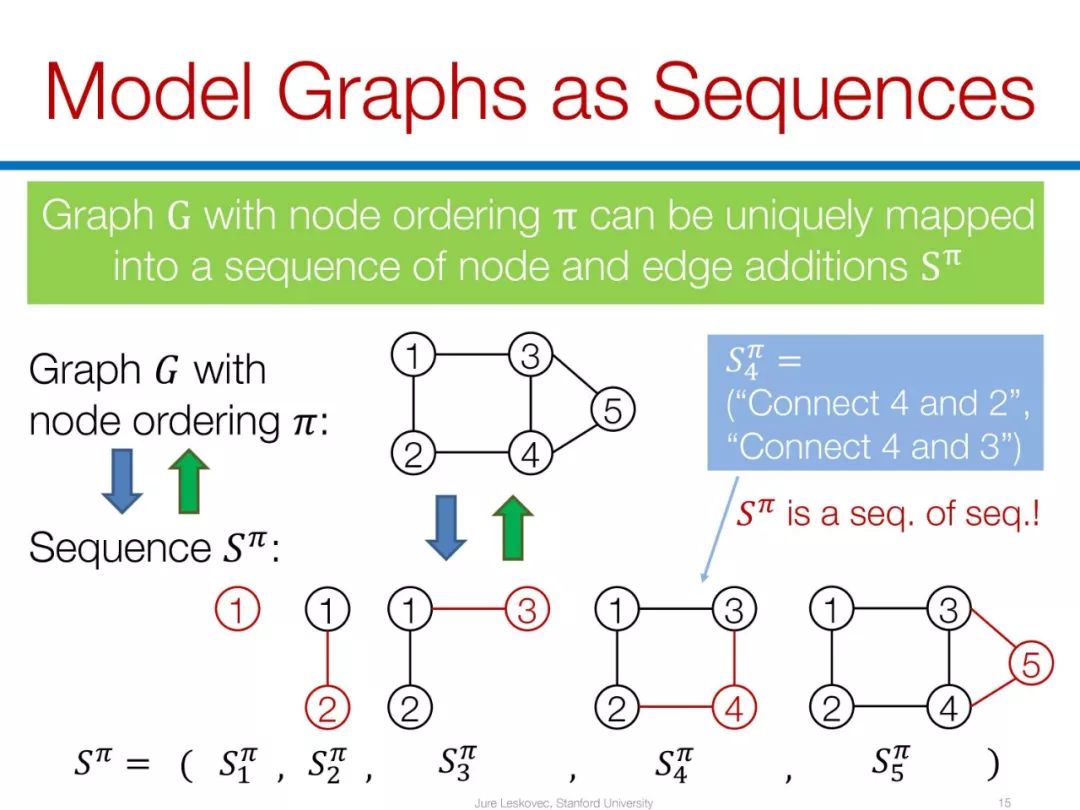

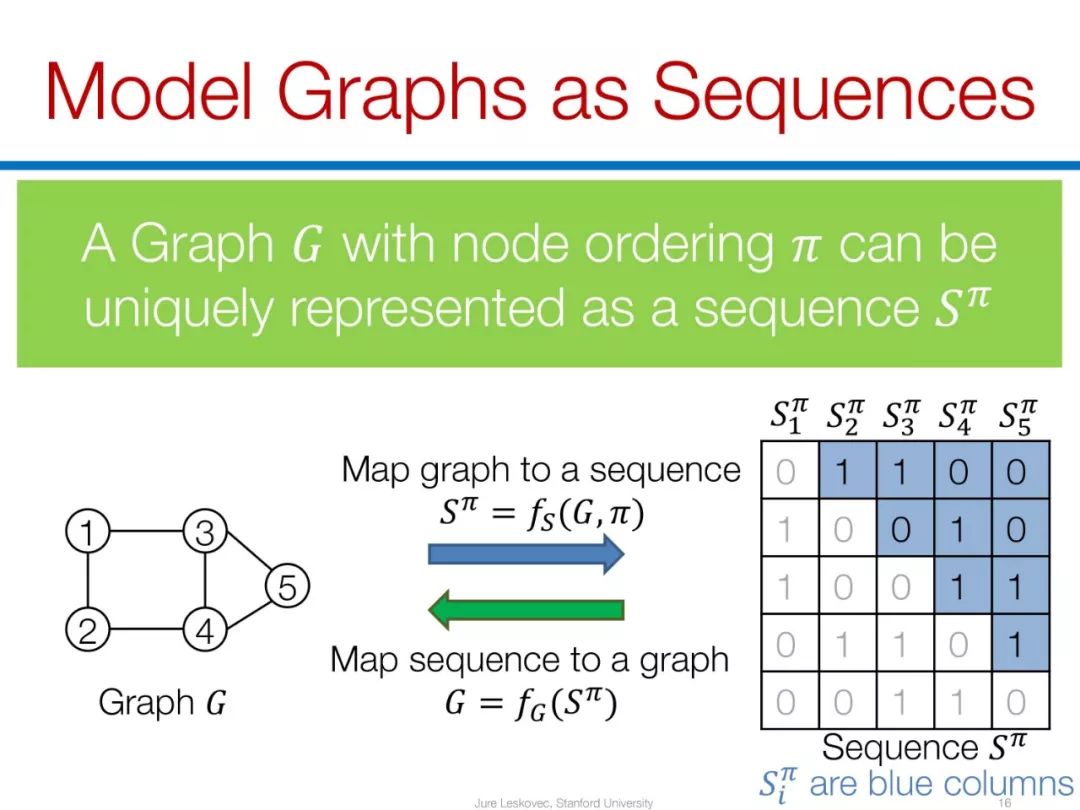

通过顺序添加节点 / 边来生成图

好处:

表示具有不同大小、不同序列长度的图

将不同的节点顺序对应于不同的生成轨迹

捕获节点之间的复杂依赖关系

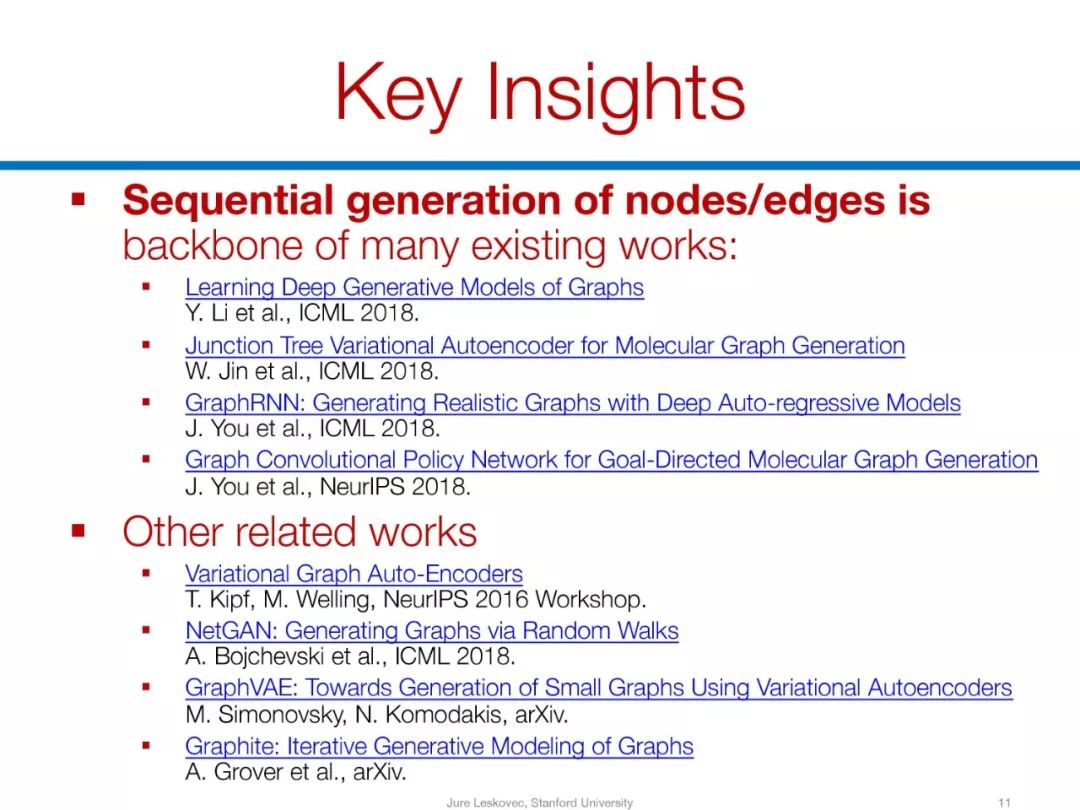

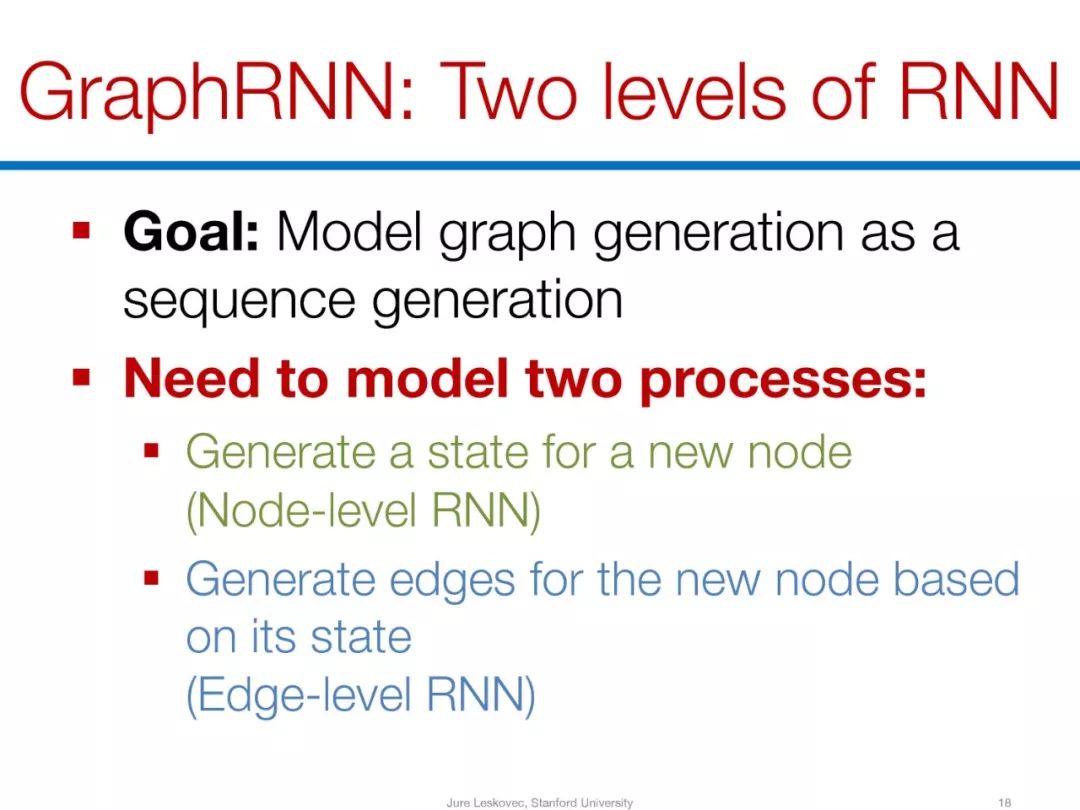

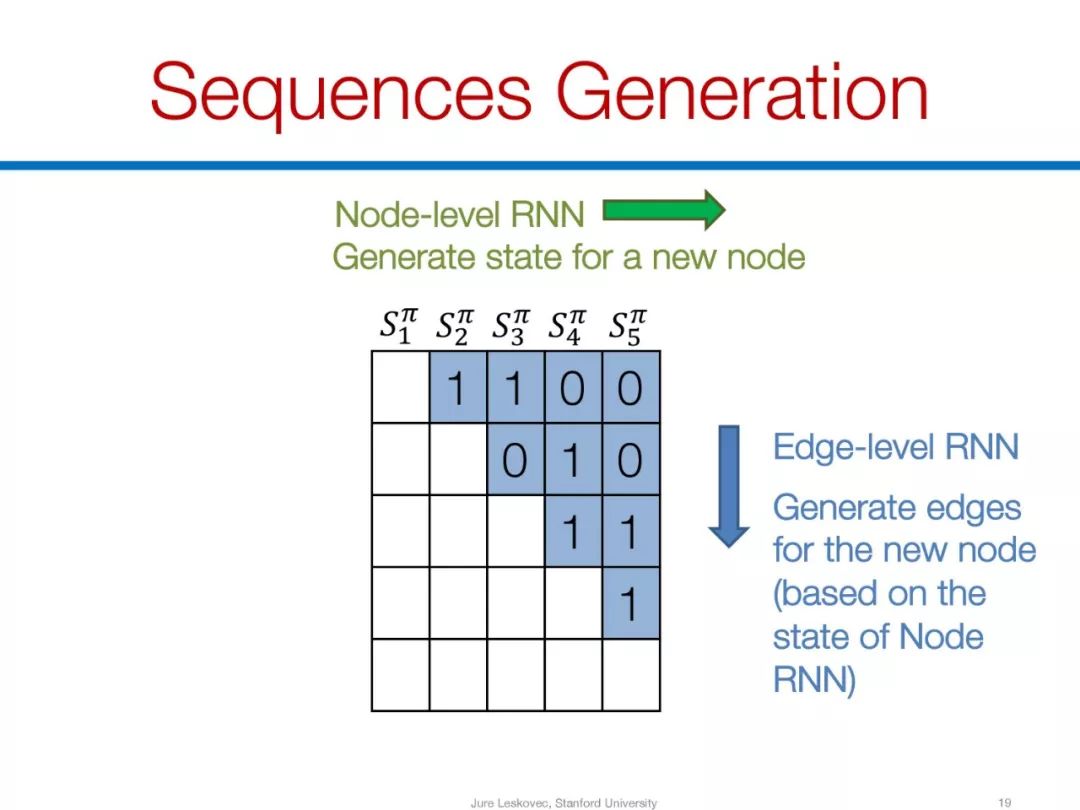

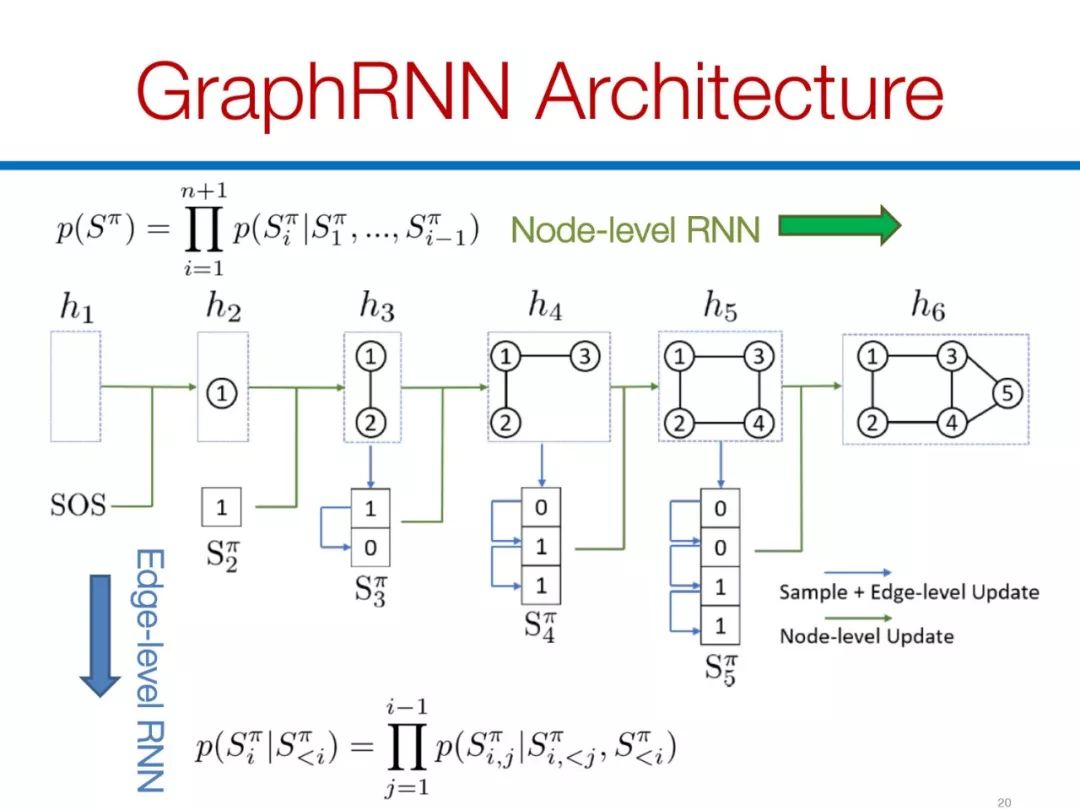

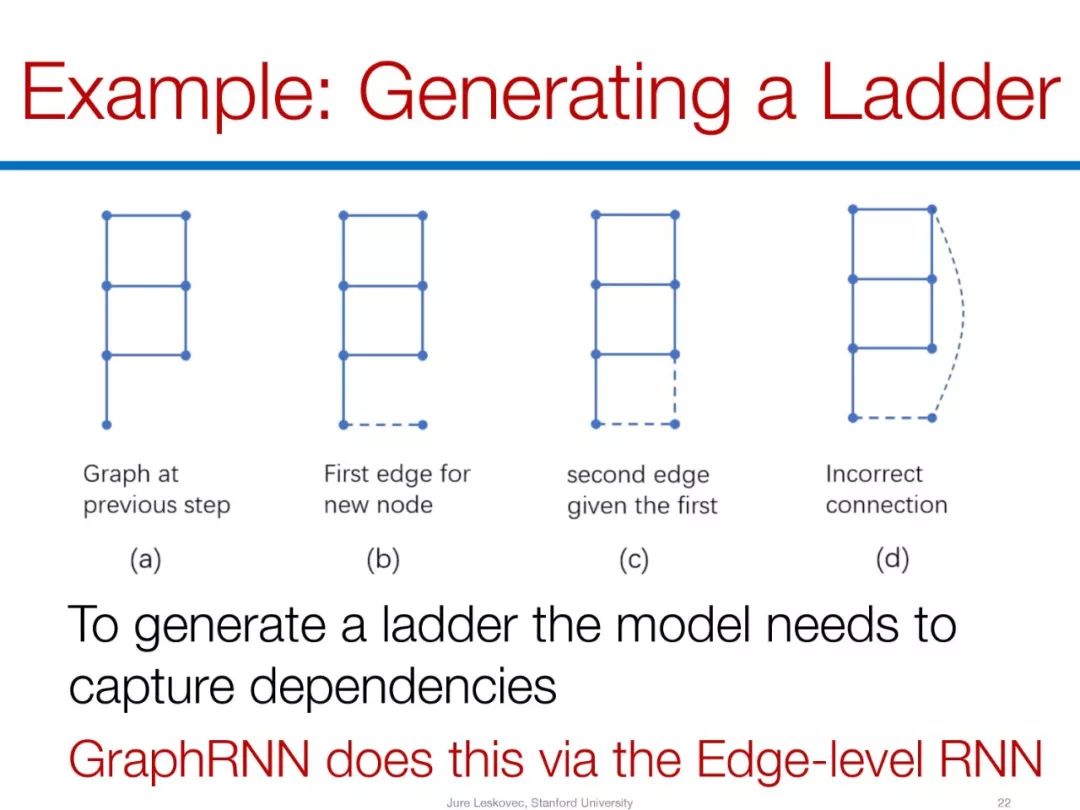

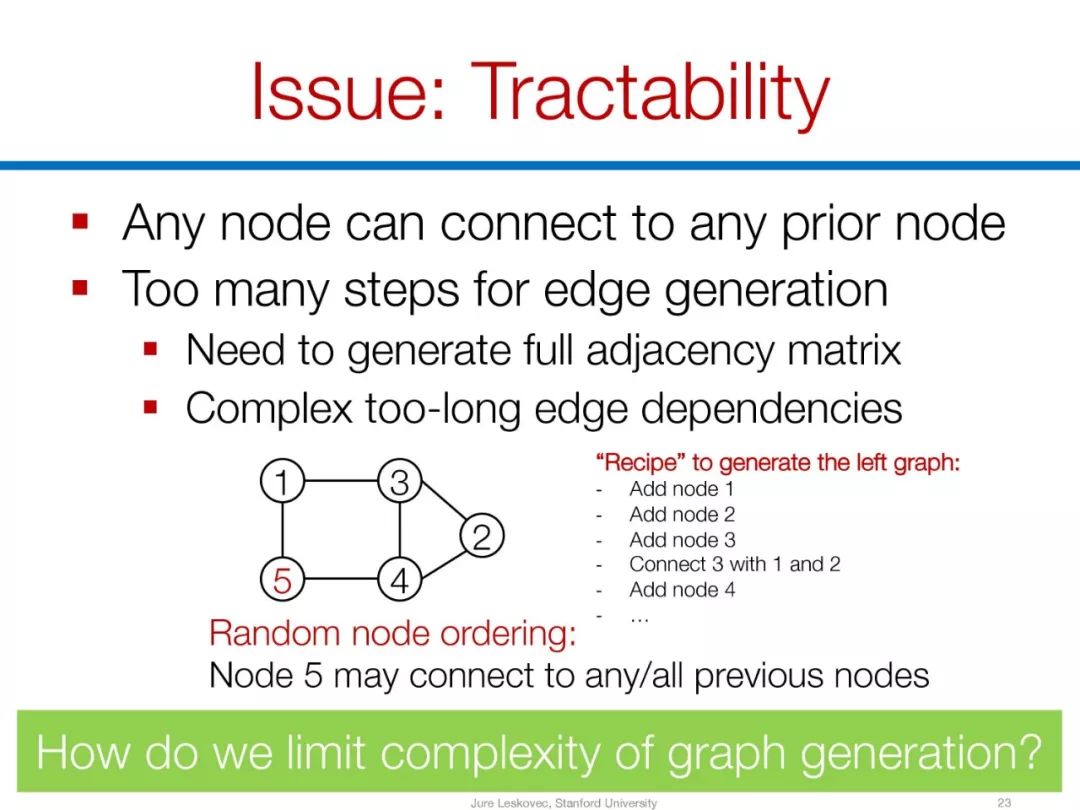

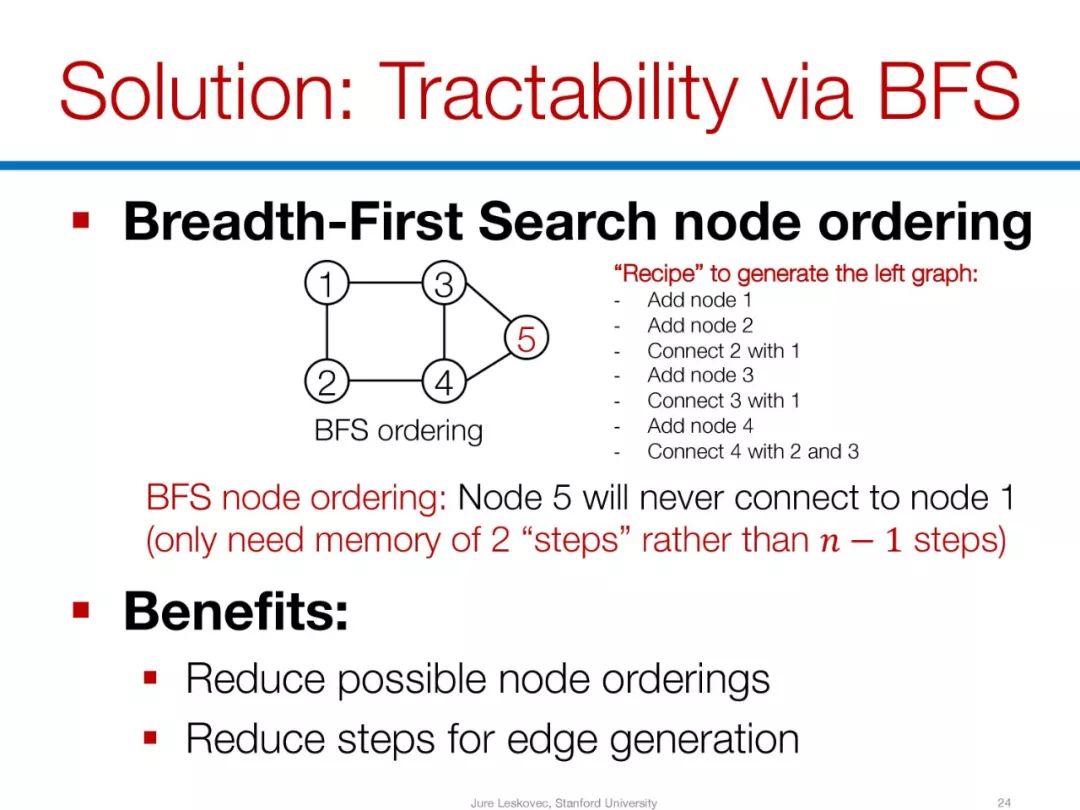

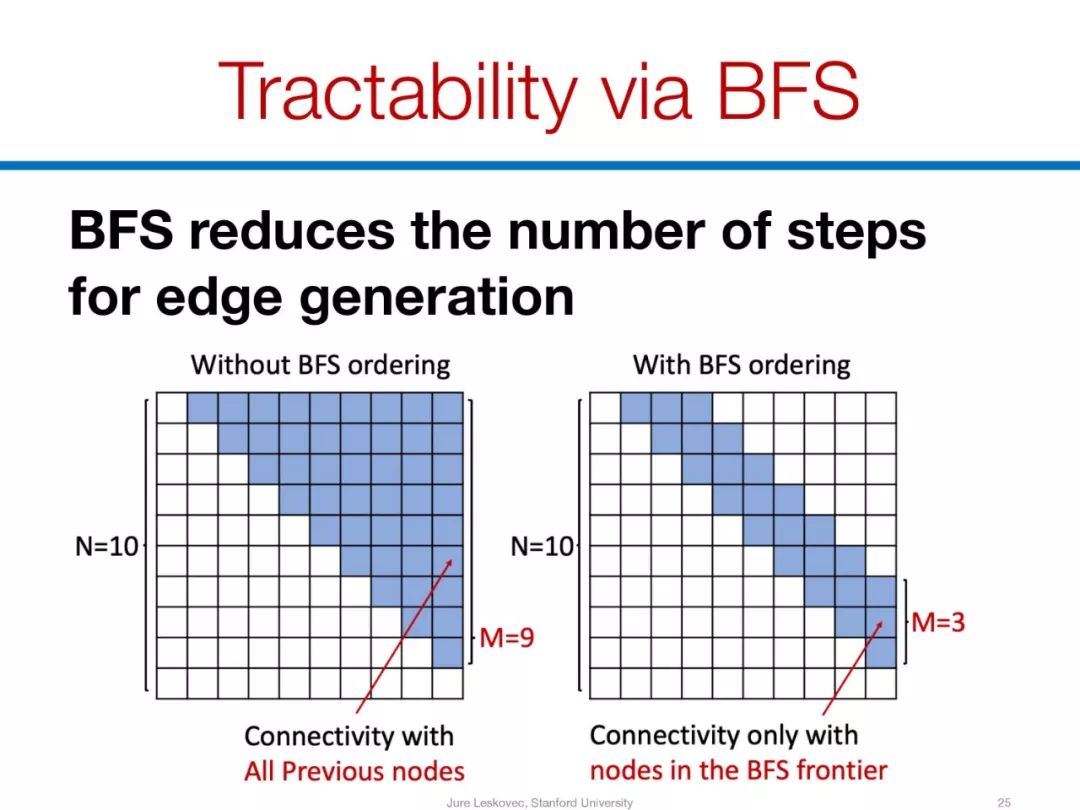

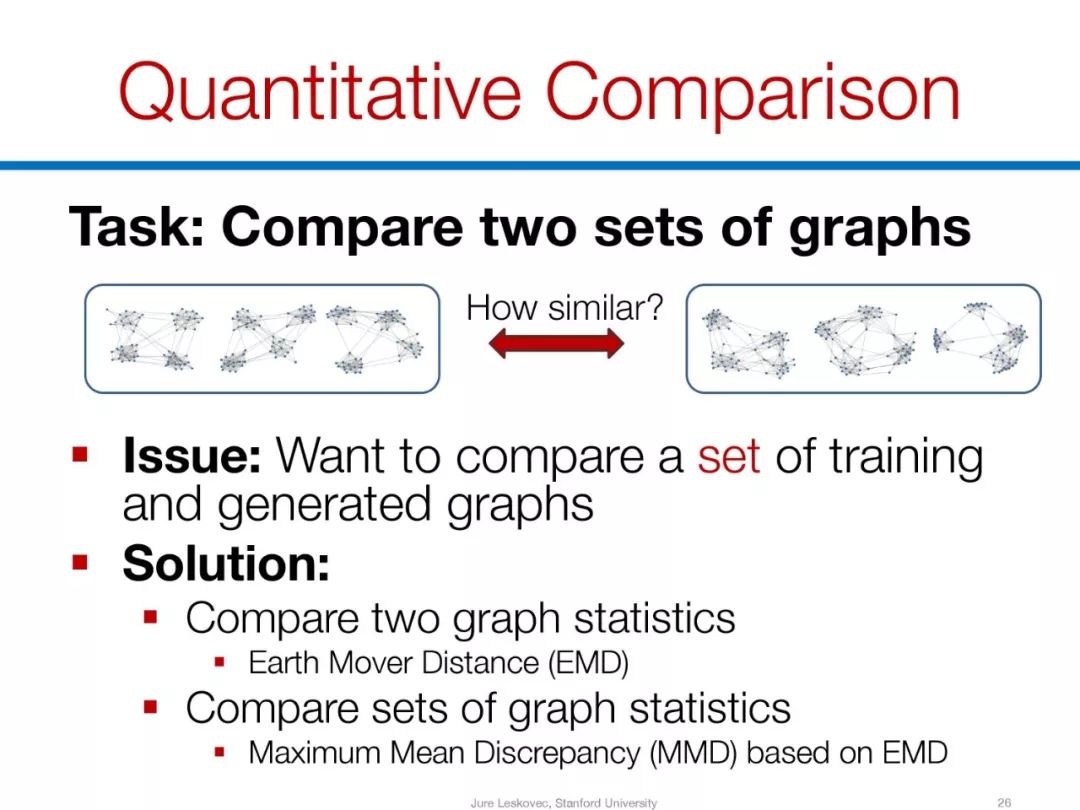

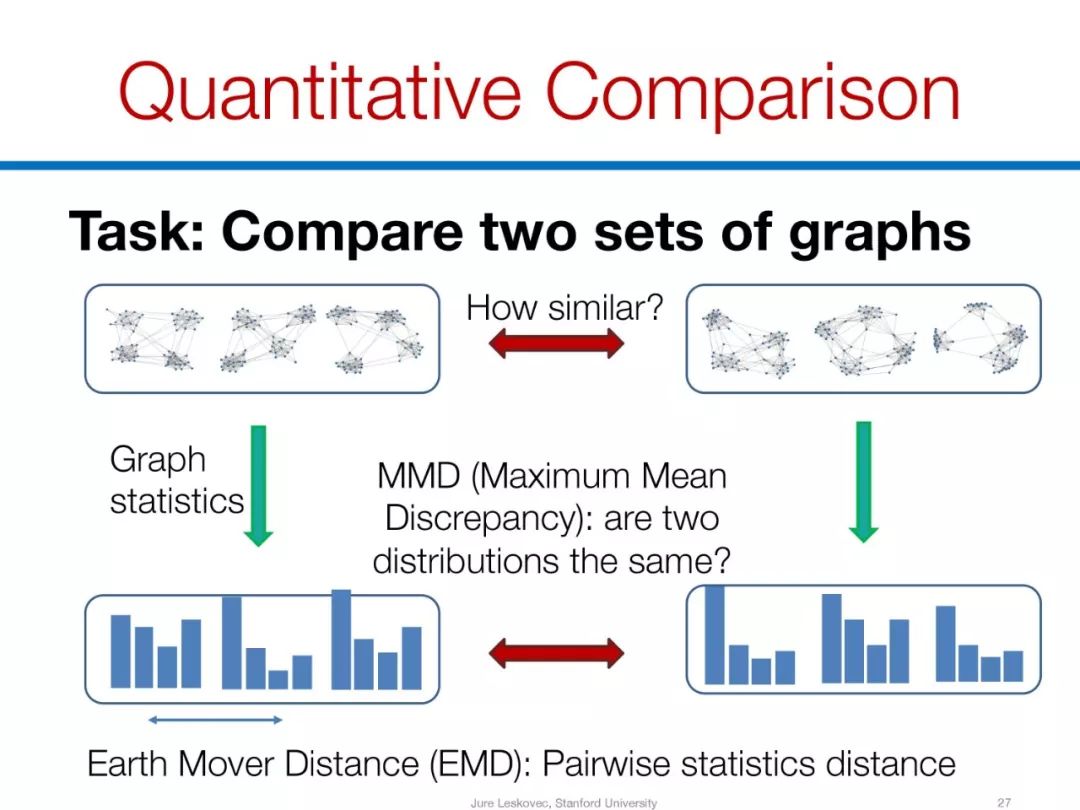

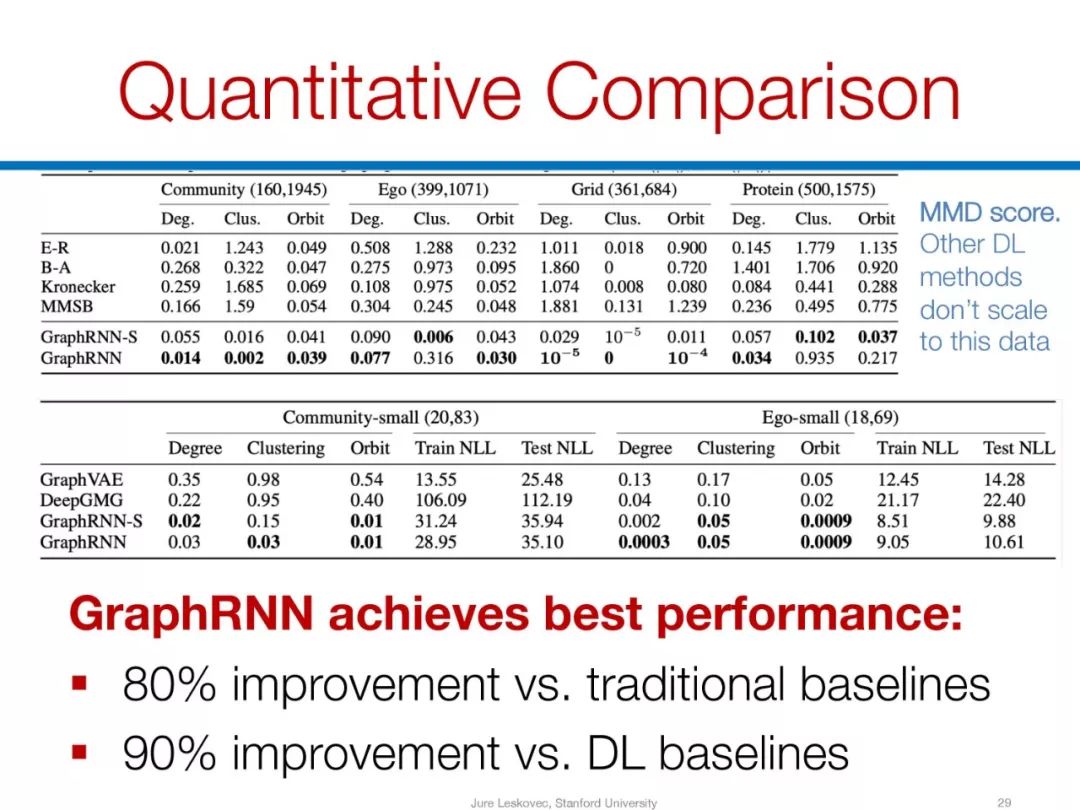

GraphRNN:RNN 的两个层次

目标:将模型图生成作为序列生成

需要对两个流程建模:

为新节点生成状态 (节 Node-level RNN)

根据新节点的状态生成新节点的边 (Edge-level RNN)

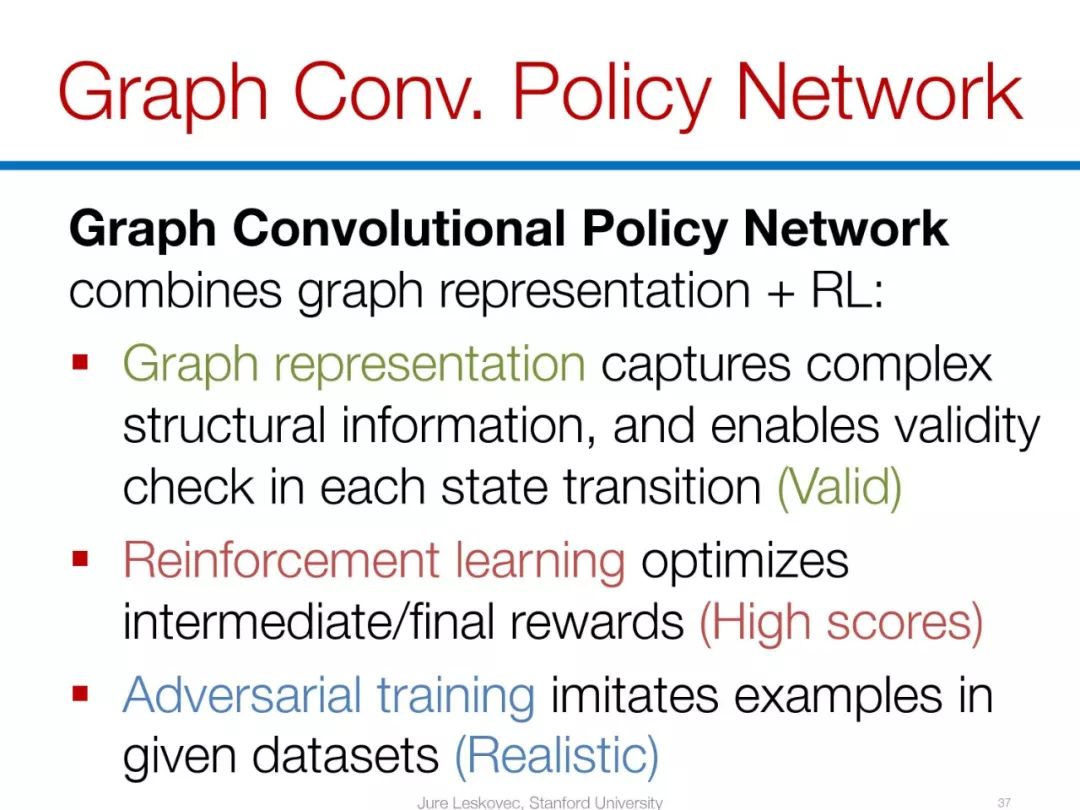

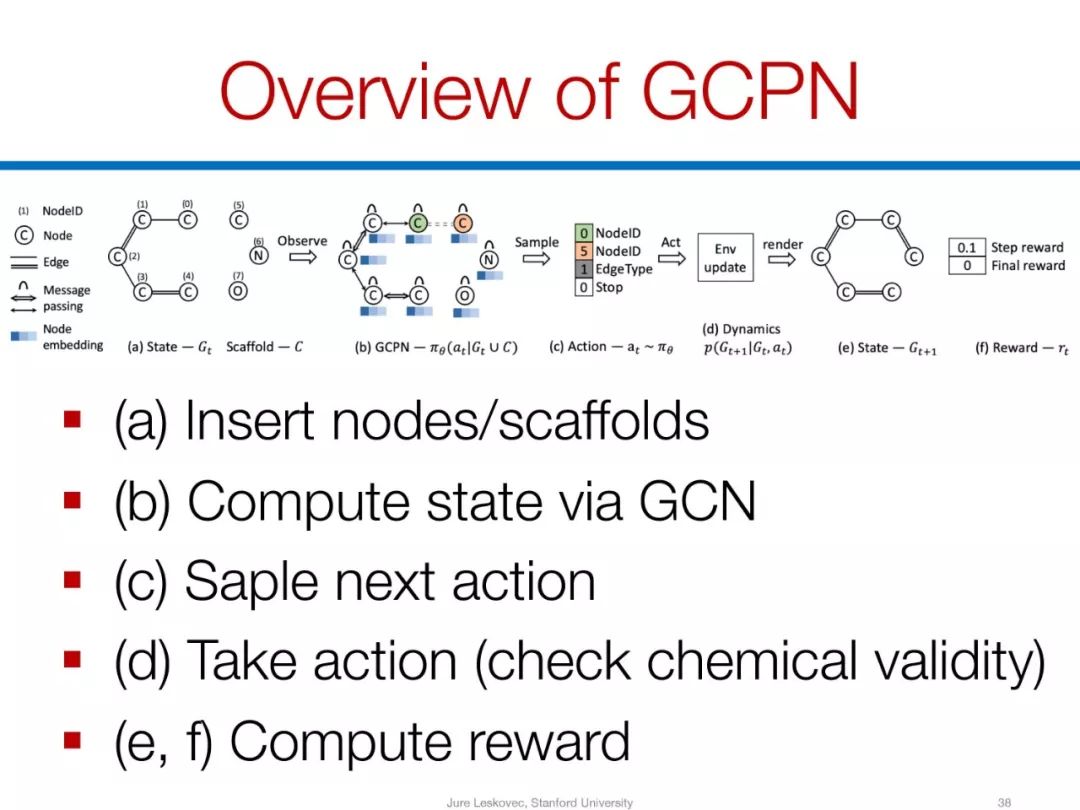

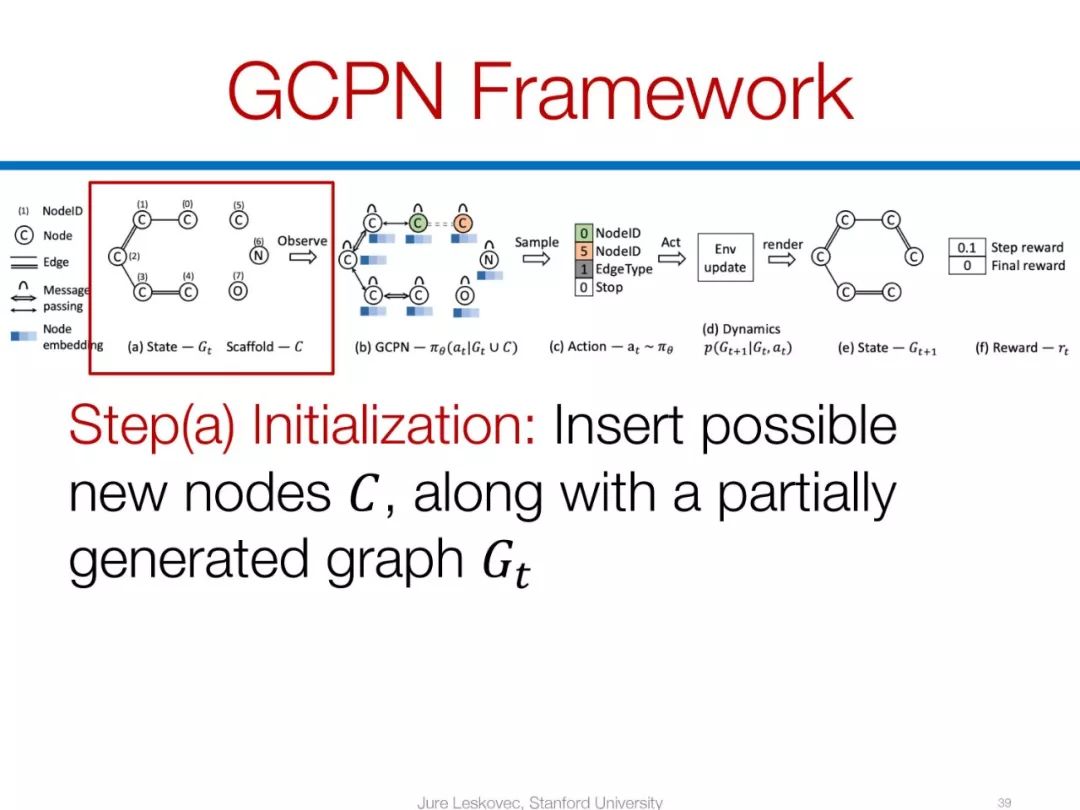

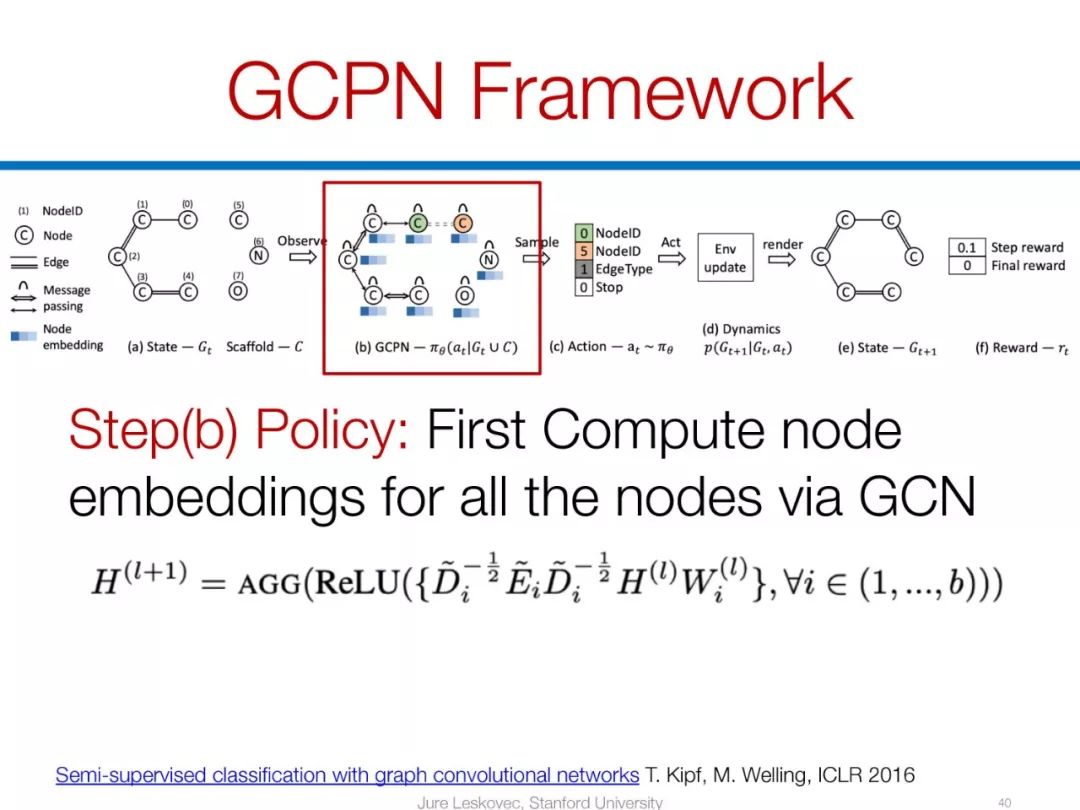

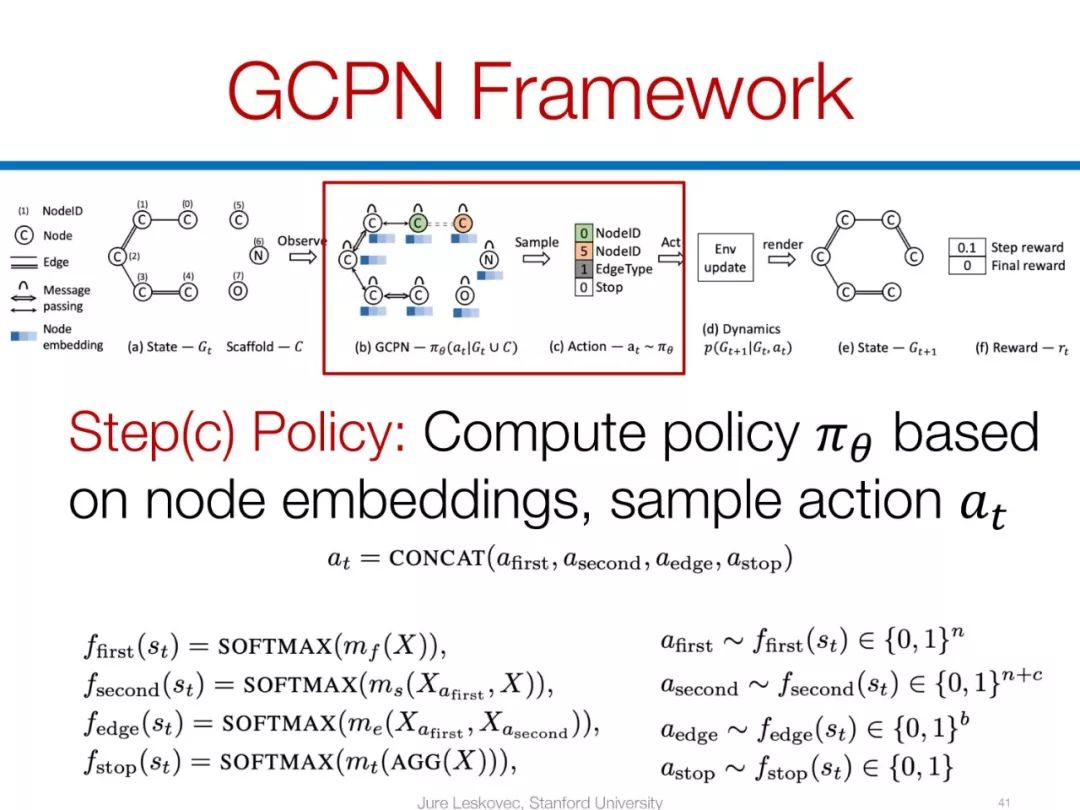

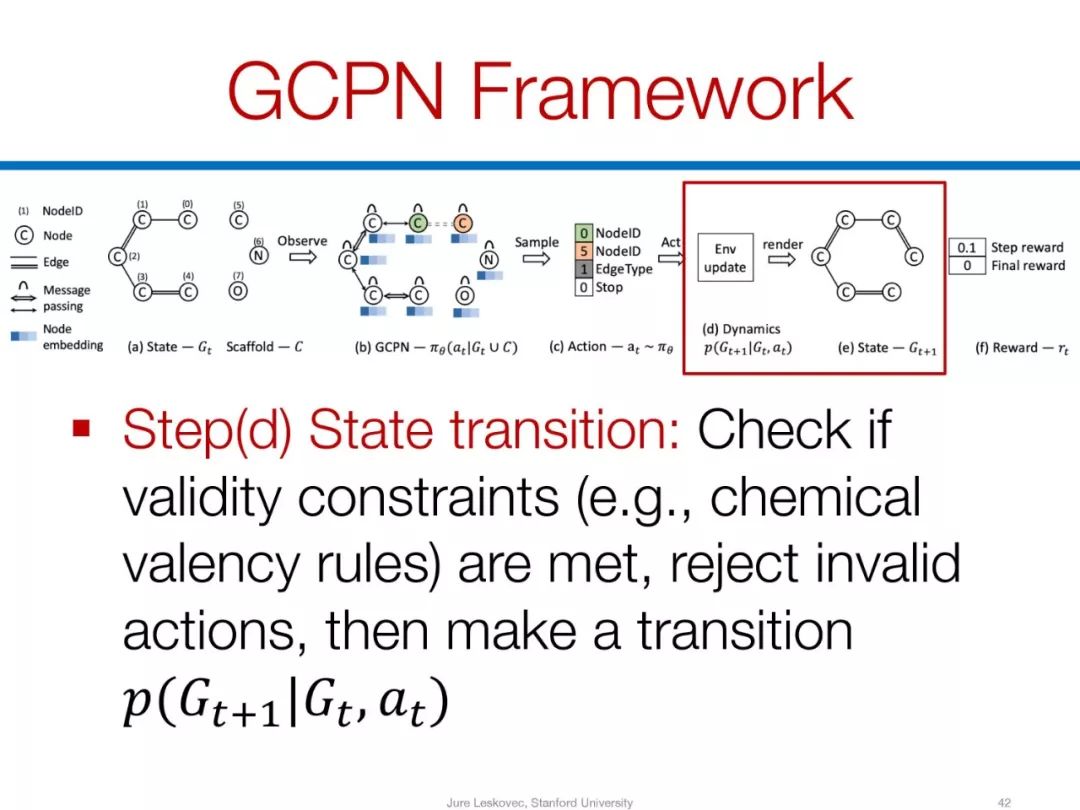

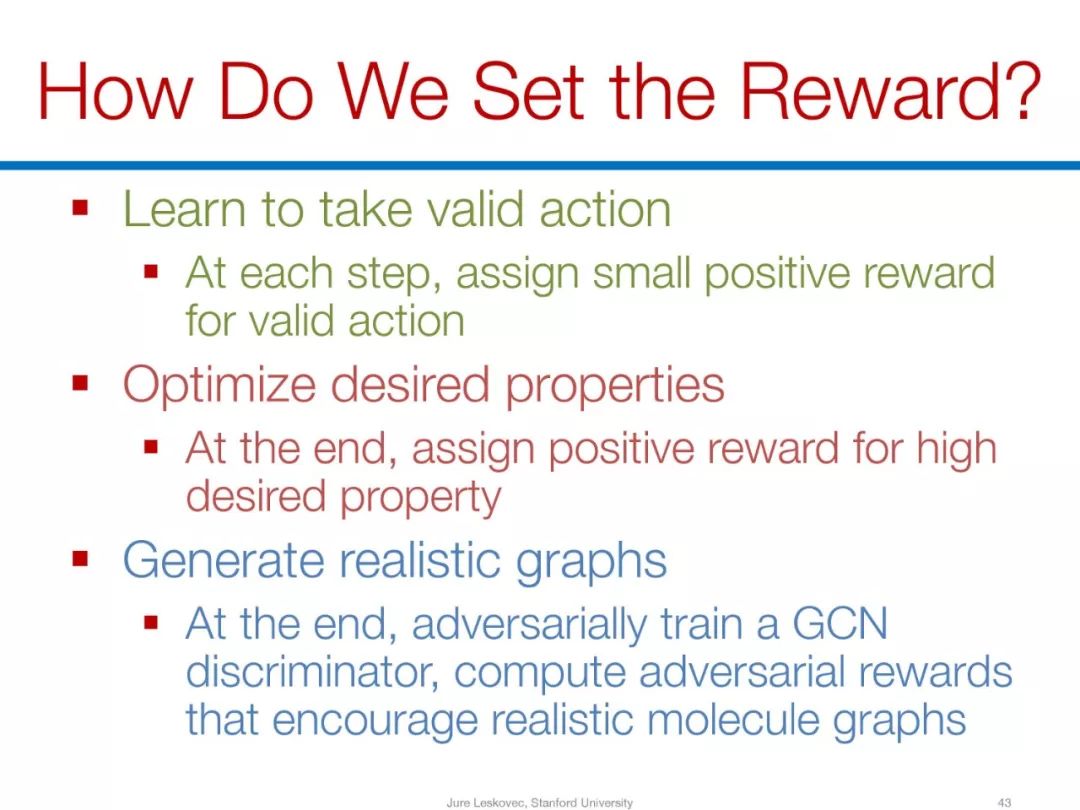

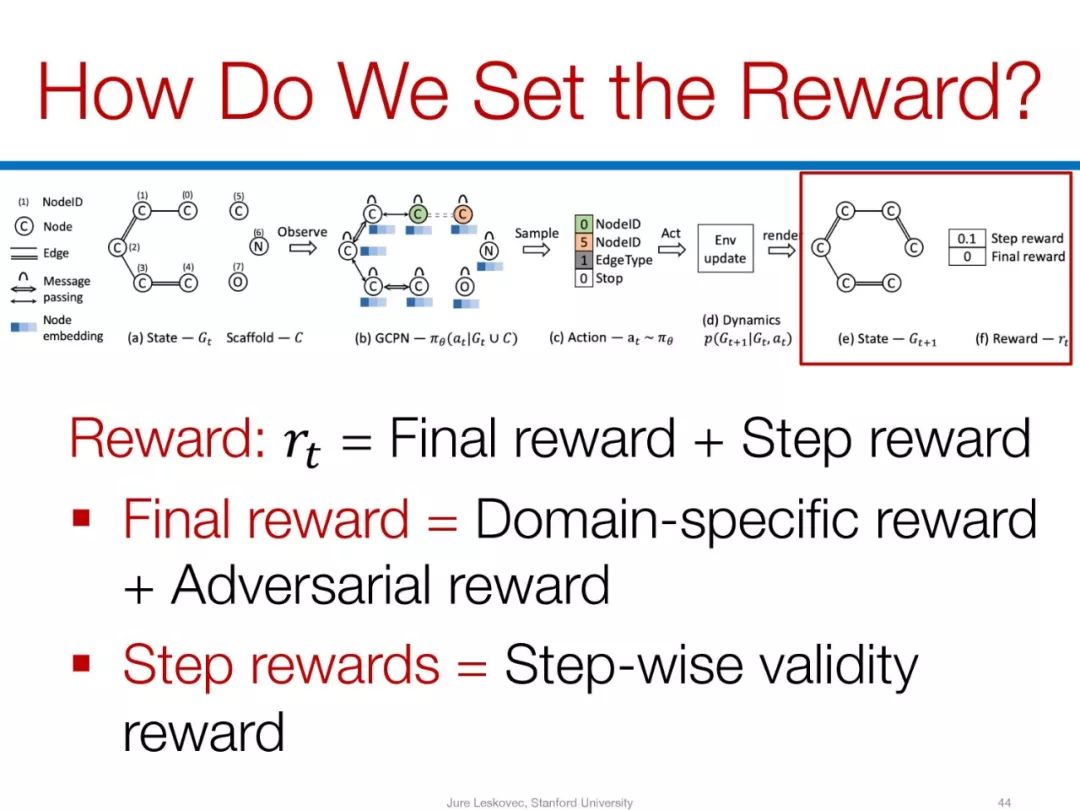

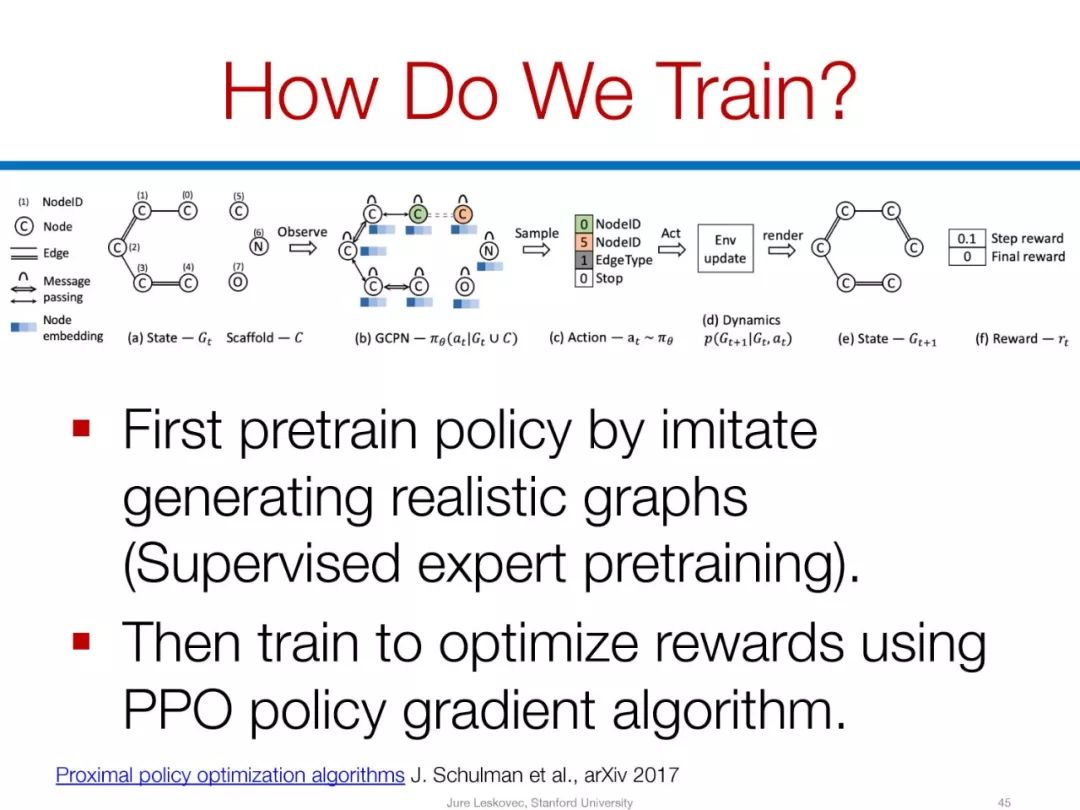

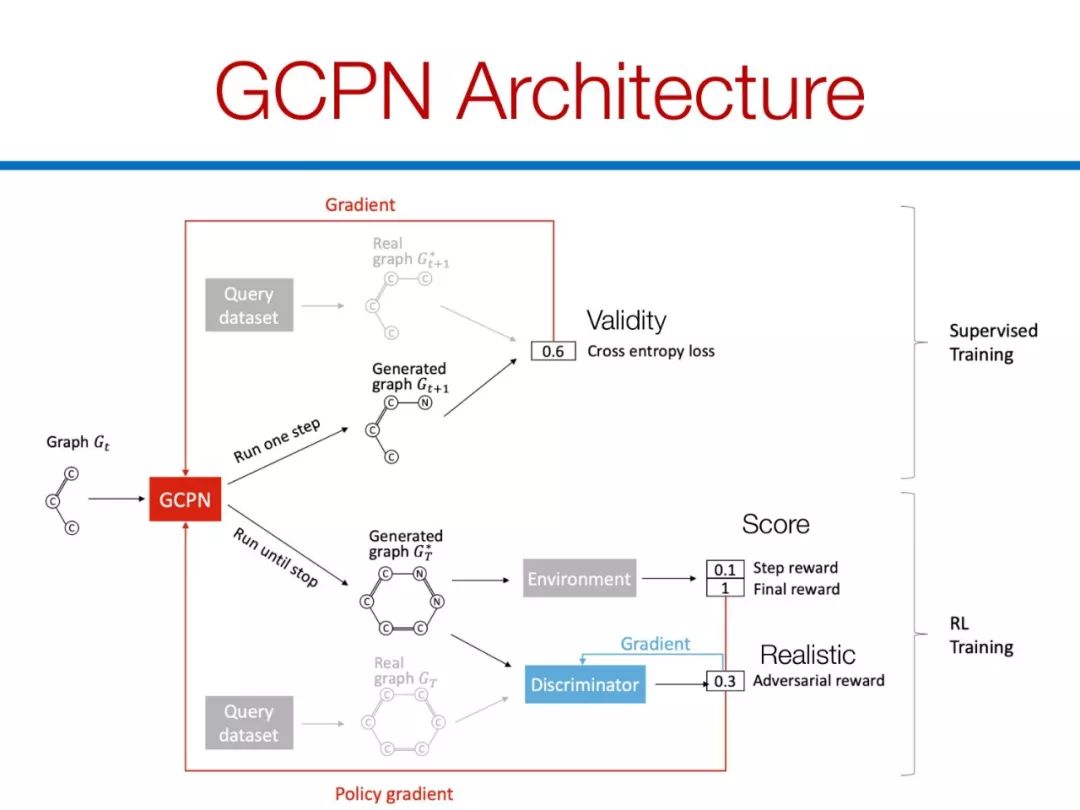

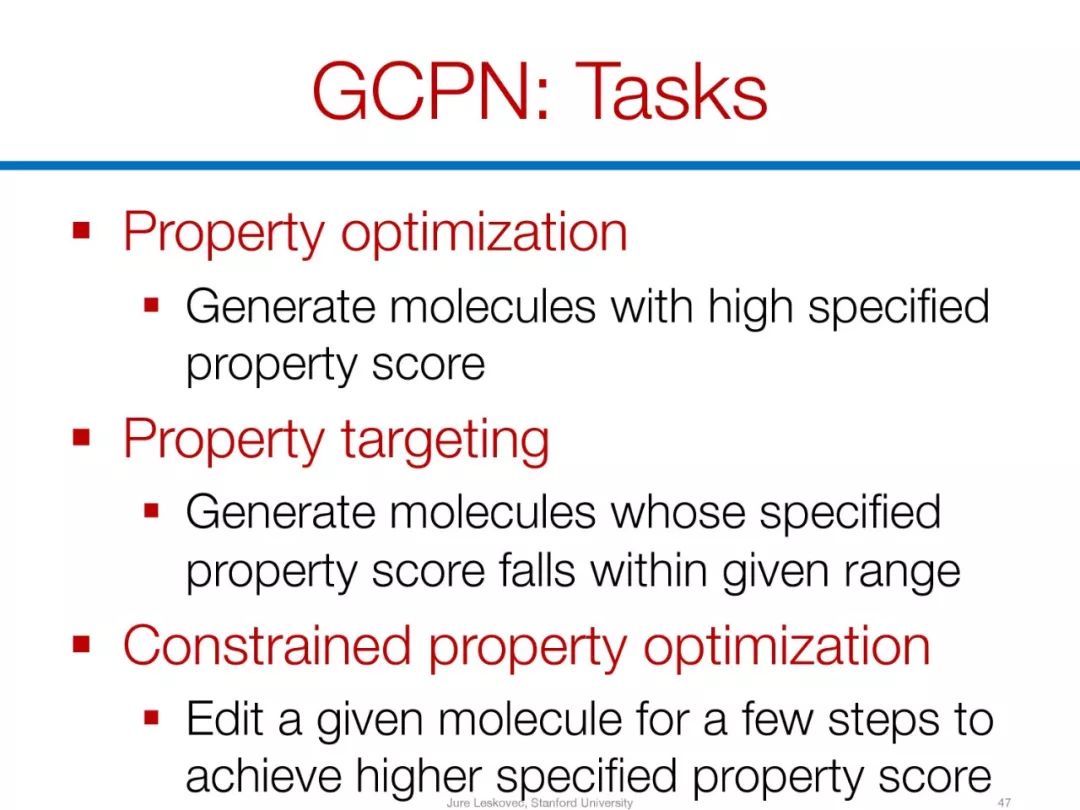

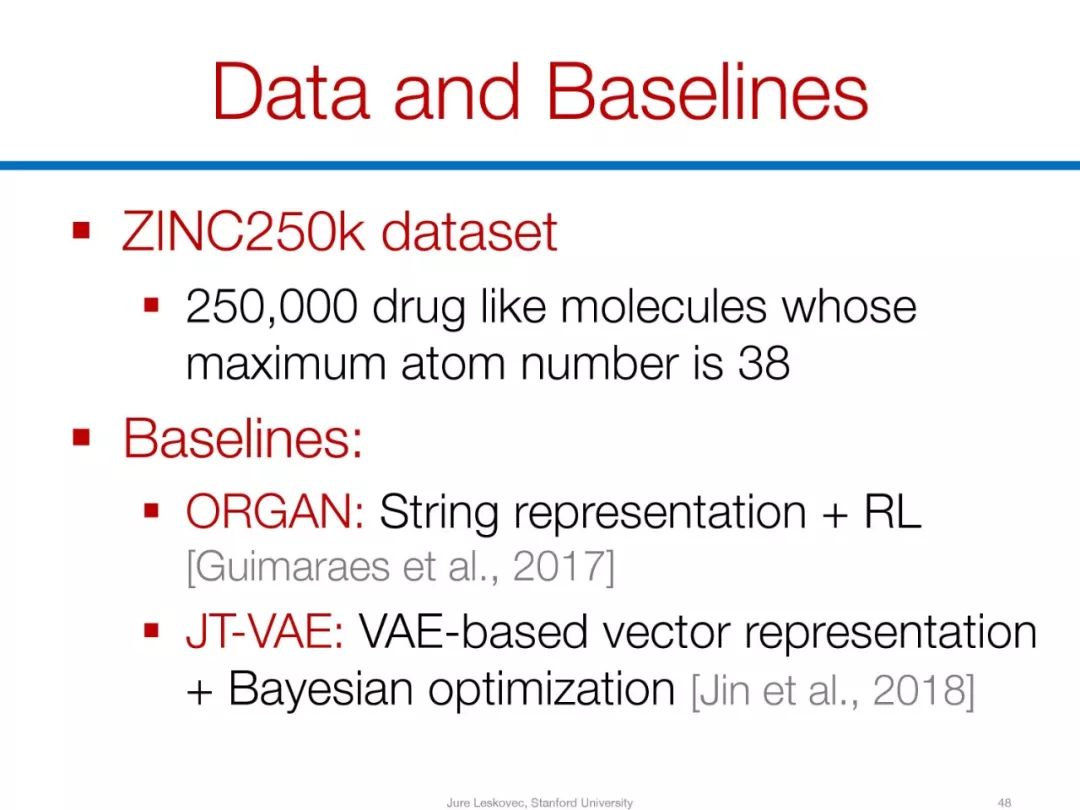

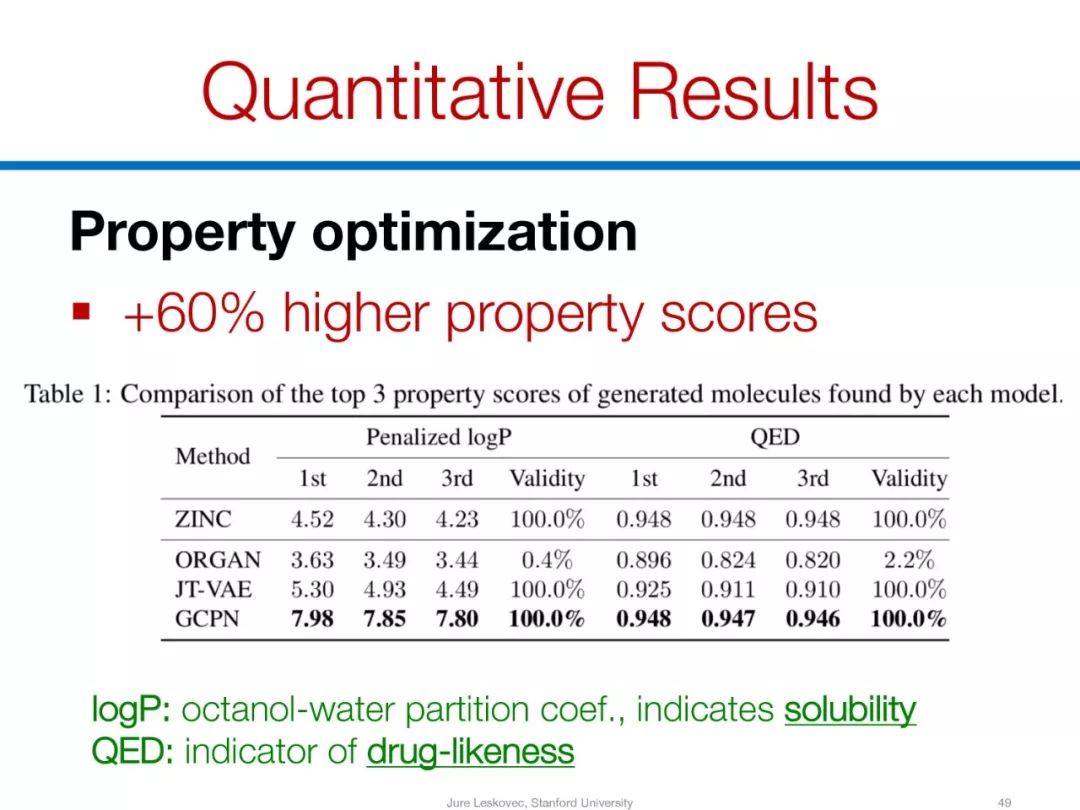

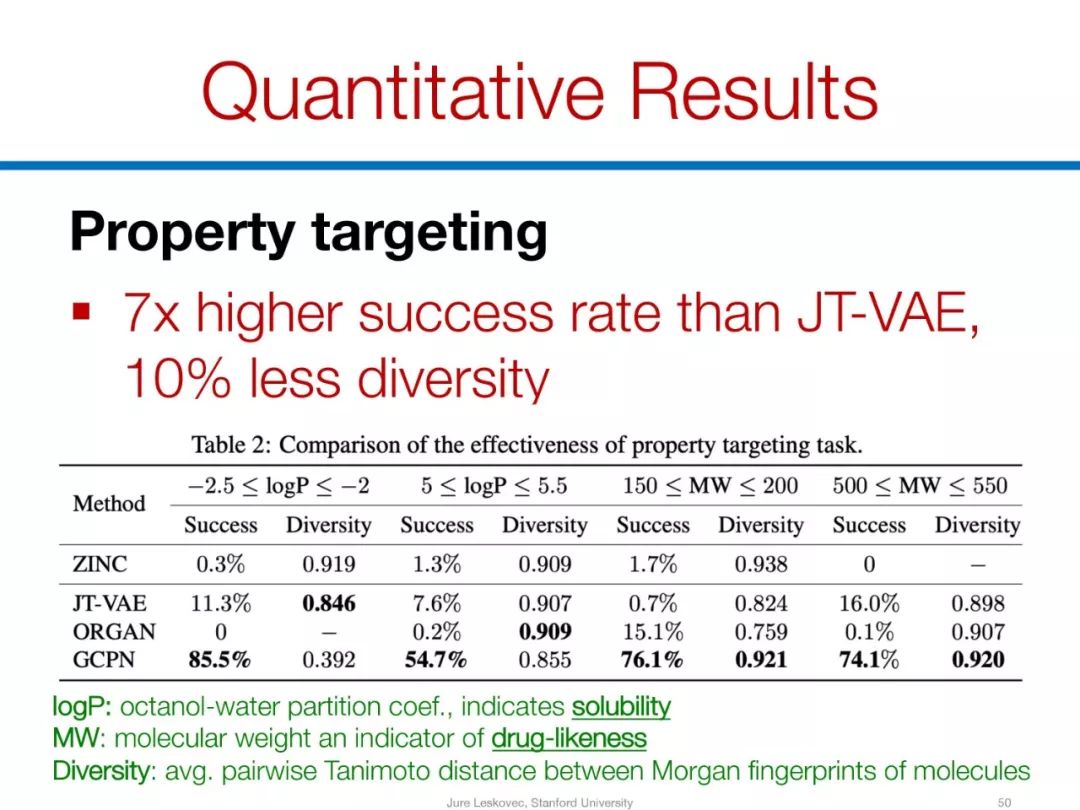

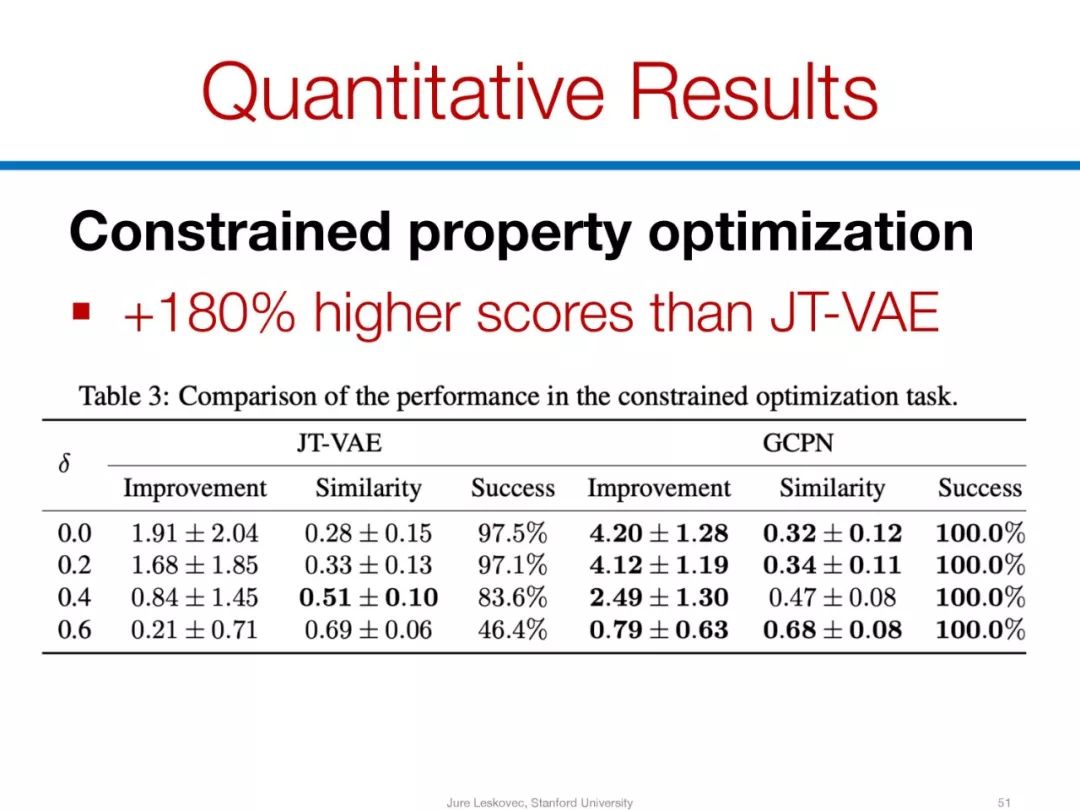

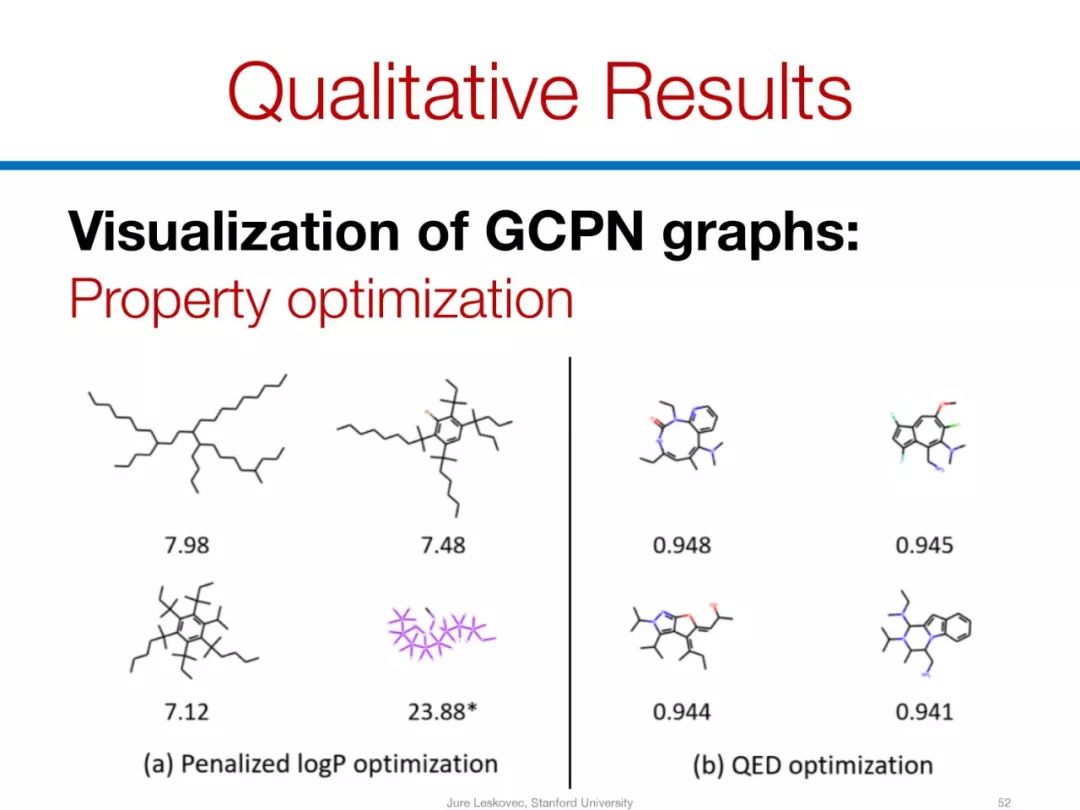

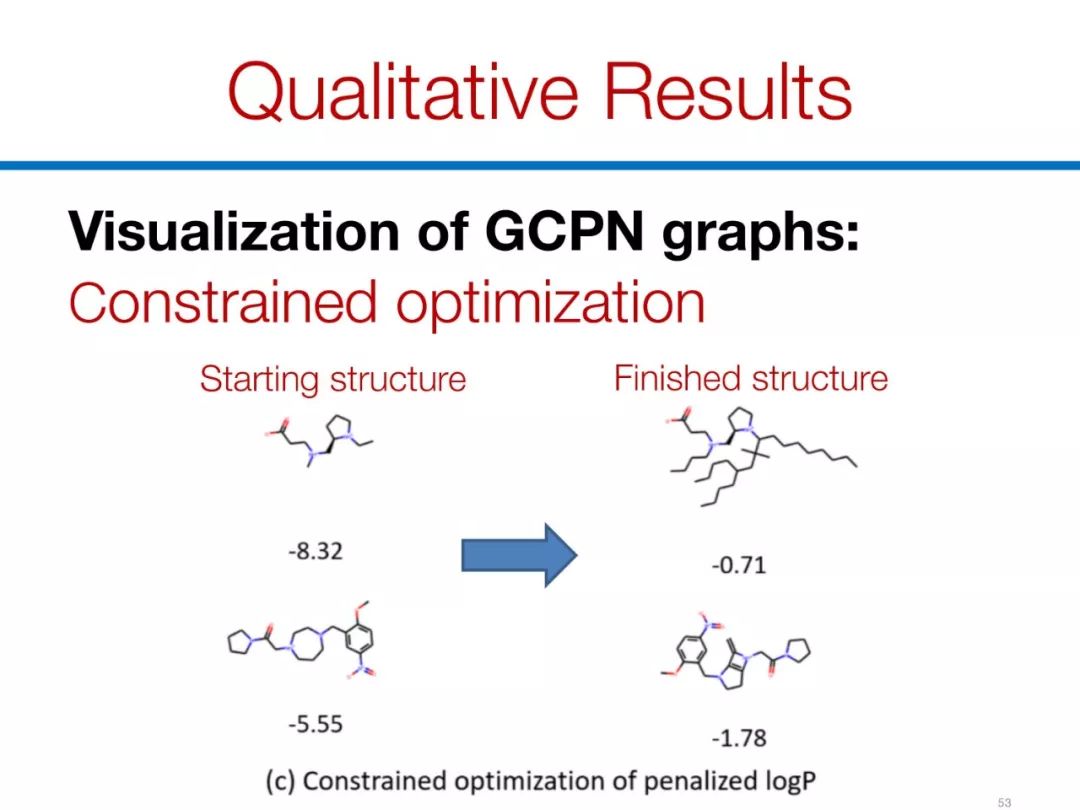

图卷积策略网络:目标导向的图生成 (GCPN)

将图表示 + RL 结合起来

图表示 (Graph representation) 捕获复杂的结构信息,并在每个状态转换中启用有效性检查 (Valid)

强化学习 (RL) 优化中间 / 最终奖励 (High scores)

对抗性训练 (Adversarial training) 模仿给定数据集中的例子 (Realistic)

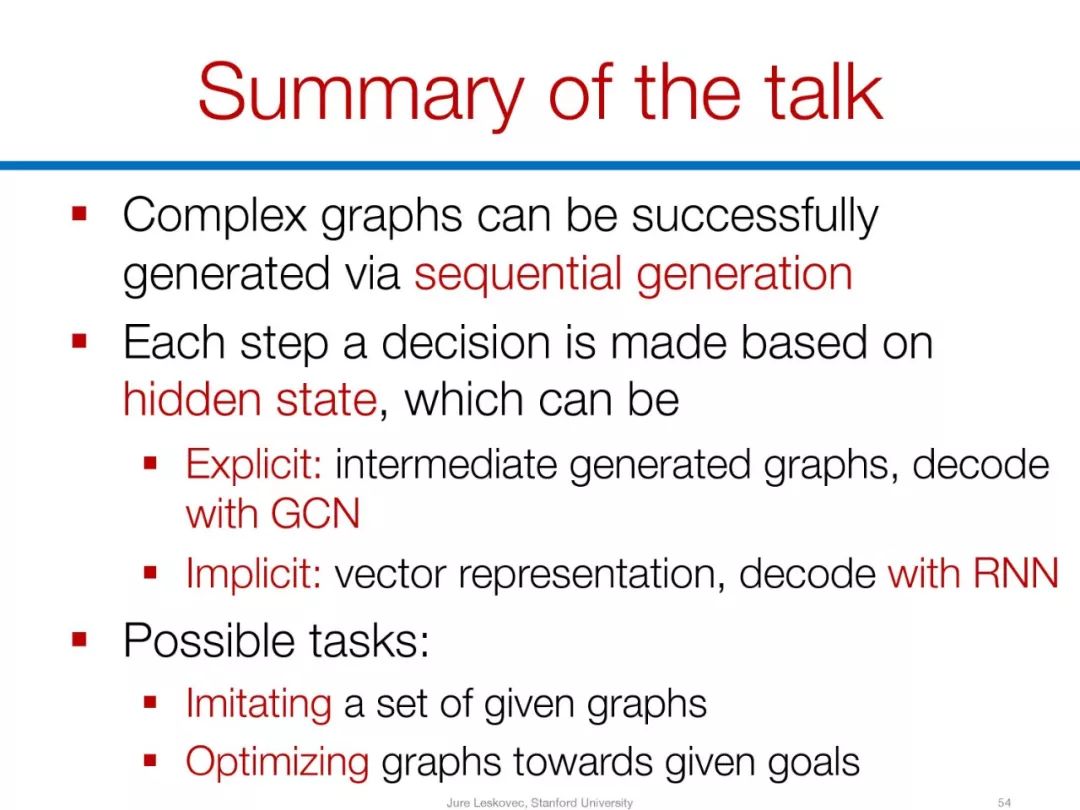

总结

通过序列生成,可以成功生成复杂的图

每一步决策都是基于隐藏状态做出的

显式:中间生成图,用 GCN 解码

隐式:向量表示,RNN 解码

任务:

模仿一组给定的图

按照既定目标优化图

新智元春季招聘开启,一起弄潮 AI 之巅!

岗位详情请戳:

【加入社群】

新智元 AI 技术 + 产业社群招募中,欢迎对 AI 技术 + 产业落地感兴趣的同学,加小助手微信号:aiera2015_2 入群;通过审核后我们将邀请进群,加入社群后务必修改群备注(姓名 - 公司 - 职位;专业群审核较严,敬请谅解)。