课程 | 12个适合机器学习入门的经典案例

古代神话中的实践者

机器学习,说简单就简单,说难还真难,对于还没入行的同学,大概最难的是如何入门机器学习?应该掌握哪些知识?看什么书最高效?如何避免绕弯?如何利用已有基础进一步提高水平?😔束手无策。

为帮助对机器学习感兴趣同学快速高效入门机器学习,AI100特邀中科院教授冒老师,为大家带来系列直播课《机器学习大咖版》,课程从零开始讲解机器学习知识,结合12个机器学习经典案例,层层递进,直通机器学习的本质及其应用。

直播时间丨10月11日起,每周三、五晚,共12节

活动丨早鸟价399元,报名从速

报名 丨戳“阅读原文”

适合人群丨在校大学生/零基础/对机器学习感兴趣想要入行的小伙伴

冒老师

中科院副教授

计算机博士,现在中科院从事科研教学工作,十余年机器学习教学经验,主持国家级科研项目3项,研究方向为机器学习、计算机视觉及多媒体处理。

在CSDN学院授课过《XGBoost从基础到实战》《机器学习之数学基础》等系列精品直播,以专业实力爆表,亲和力爆表,课程群细致认真爆表,收获一大波冒菜(冒老师粉丝专属名😄)。

第一讲

10月11日

| 课程内容 | 1. 机器学习定义; 2. 机器学习行业应用举例; 3. 机器学习任务:分类、回归、聚类、降维、半监督学习、迁移学习、强化学习; 4. 机器学习算法的组成部分:目标函数(损失函数+正则)、优化方法; 5. 模型评估和模型选择:模型复杂度、overfitting、交叉验证、超参数空间、网格搜索… |

| 案例 | 波士顿房价。 包含知识点—— 损失函数、L1/L2正则、最小二乘、梯度下降/随机梯度下降。 |

| 课程目标 | 熟悉机器学习领域的常用术语,了解机器学习在AI环境中的位置。 |

第二讲

10月13日

| 课程内容 | 1. 学习环境配置:常用软件、环境配置及机器学习库 anaconda:Python、Python科学计算包(NumPy,SciPy,Pandas)、Python数据可视化工具包(Matplotlib, seaborn)、Python机器学习库(scikit-learn) 2. 特征工程初步 3. 线性回归实现 |

| 案例 | 波士顿房价预测案例详解。 包含知识点—— 数据集探索(Pandas、seaborn); 复习模型评估和模型选择:交叉验证、网格搜索(Sklearn)。 |

课程目标 |

学会用机器学习工具包从头到尾用线性回归解决一个实际问题。 |

第三讲

10月18日

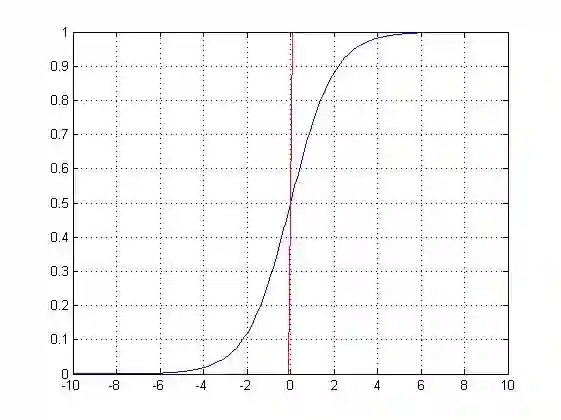

| 课程内容 | 1. 损失函数:logistic损失 2. 优化算法:IRLS(梯度下降、牛顿法)、BP算法 3. 正则化:L1/ L2 4. 复习模型评估 |

| 案例 | Otto商品分类 包含内容—— 用Logistic回归和神经网络实现Otto商品分类 |

| 课程目标 | 理解分类任算法Logistic回归和神经网络原理,复习数据集探索,并学会用sklearn用Logistic |

第四讲

10月20日

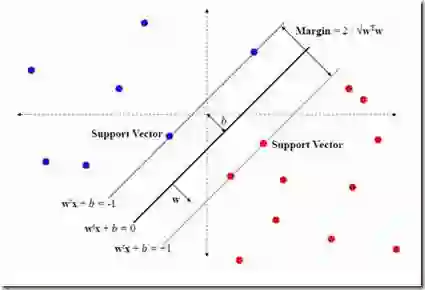

| 课程内容 | 1. 损失函数:Hingloss损失 优化算法:SOM(神经网络聚类算法)支持向量机——SMO(序列最小最优化算法 2. 正则化:L2/L1 3. 其他:最小间隔、核方法、支持向量回归 |

| 案例 | 用SVM实现Otto商品分类,重点比较SVM(不同参数正则参数和核函数)与Logistic回归 |

| 课程目标 | 学会用SVM模型分类任务 |

第五讲

10月25日

| 课程内容 | 1. 主成分分析(PCA) 2. 独立成分分析(ICA) 3. 非负矩阵分解(NFM) 4. 隐因子模型(LFM) |

| 案例 | 人脸图像特征提取: PCA、ICA、NFM LFM在推荐系统部分案例进行讲解 |

| 课程目标 | 学习用降维技术对高维特征进行降维 |

第六讲

10月27日

| 课程内容 | 1. Kmeans聚类和混合高斯模型GMM(EM算法) 2. 吸引子传播聚类算法(Affinity Propagation聚类算法) 3. Density Peak聚类算法 |

| 案例 | 1、Iris数据聚类分析:Kmeans、AP what makes Paris 2、Paris: 判别特征发现:聚类分类迭代(SVM、Kmeans) |

| 课程目标 | 学会常用的聚类算法 |

第七讲

11月1日

| 课程内容 | 1、 数据预处理 2、 特征编码:标签编码、Dummy (One hot) 编码、后验均值编码 3、 特征组合 4、 特征选择 |

| 案例 | 案例:Rent Listing Requries数据探索及特征工程 数据预处理:缺失值处理、异常值处理、数据相关性分析 数据可视化 特征编码: |

| 课程目标 | 学会数据预处理常用方法及特征编码方法 |

第八讲

11月3日

| 课程内容 | 1. 损失函数:Gini系数 2. 正则:L1/L2正则、及早停止 3. 优化:分裂 4. Bagging &随机森林 |

| 案例 | 蘑菇分类 决策树、随机森林、Logistic回归 参数调优和网格搜索 |

| 课程目标 | 学习Bagging集成思想及基于决策树的集成算法:随机森林 |

第九讲

11月8日

| 课程内容 | 1. 第一个Boosting算法:AdaBoost 2. 流行GBDT模型:xgboost、lightGBM |

| 案例 | Otto商品分类:xgboost及参数调优 |

| 课程目标 | 学会kaggle神器xgboost原理及其在实例任务上的应用 |

第十讲

11月10日

| 课程内容 | 1. 协同过滤(Collaborative filtering,CF) 2. 基于内容的过滤 3. FFM & LFM 4. 关联规则 |

| 案例 | Expedia Hotel Recommendations |

| 课程目标 | 学习推荐系统和CTR预估的基本技术 |

第十一讲

11月15日

| 课程内容 | 1、 排序学习 2、模型评估 |

| 案例 | Expedia Hotel Recommendations |

| 课程目标 | 通过实际案例学会推荐系统实现 |

第十二讲

11月17日

| 课程内容 | 1. Blending 2. Stacking |

| 案例 | Otto商品分类/Expedia Hotel Recommendations:Stacking |

| 课程目标 | 出师,准备做一只机器学习大咖 |

加入课程微信群

扫码加课程小助手,回复“大咖”,进课程讨论群一起做机器学习大咖!

登录查看更多