点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达![]()

本文转载自:机器之心 | 参与:魔王

自编码器(AE)与生成对抗网络(GAN)是复杂分布上无监督学习最具前景的两类方法,它们也经常被拿来比较。人们通常认为自编码器在图像生成上的应用范围比 GAN 窄,那么自编码器到底能不能具备与 GAN 同等的生成能力呢?这篇研究提出的新型自编码器 ALAE 可以给你答案。目前,该论文已被 CVPR 2020 会议接收。

自编码器是一种无监督方法,它通过同时学习编码器-生成器图将「生成性」和「表征性」结合起来。关于自编码器有两个疑问尚未得到解决:

最近,来自美国西弗吉尼亚大学的研究者提出一种新型自编码器 Adversarial Latent Autoencoder (ALAE),试图解决以上问题。ALAE 是一个通用架构,它能够利用近期 GAN 在训练方面的改进。研究者表示 ALAE 具备与 GAN 相当的生成能力,且能够学习解耦表征。

利用 ALAE 通用架构,该研究设计了两个自编码器:一种基于 MLP 编码器,另一种基于 StyleGAN 生成器,即 StyleALAE。

研究者对这两个架构的解耦能力进行了验证,发现 StyleALAE 不仅能够生成与 StyleGAN 生成质量相当的 1024x1024 人脸图像,在同样分辨率条件下,它还可以基于真实图像生成人脸重建和操纵结果。

研究者认为,

ALAE 是首个性能匹配甚至超过生成器架构的自编码器

。

![]()

![]()

![]()

感兴趣的读者可以自己运行 demo,不过你需要 CUDA capable GPU、v1.3.1 及以上版本的 PyTorch 和 cuda/cuDNN 驱动,详情参见 GitHub 地址。

研究者观察到每个 AE 方法都使用同样的假设:潜在空间的概率分布应与先验相关,自编码器应该与之匹配。而 StyleGAN 相关论文证明,中间潜在空间应当具备更好的解耦能力。

于是研究者通过修改原始 GAN 范式设计了一种新型 AE 架构:

允许基于数据学得的潜在分布解决耦合问题 (A),并使用对抗策略学习输出数据分布 (B),以保留 GAN 的生成能力;

为了实现 (A) 和 (B),该研究提出将 AE reciprocity 置于潜在空间中 (C),以避免使用在数据空间中运行的基于简单 l_2 范数的重建损失(对于图像空间来说它们通常是次优选择)。

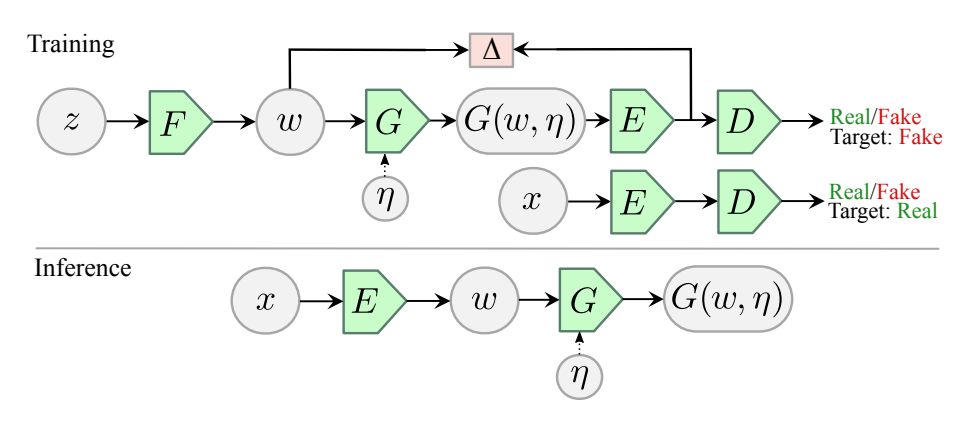

如下图 1 所示,研究者将生成器 G 和判别器 D 分别分解成两个网络:F、G 和 E、D。

![]()

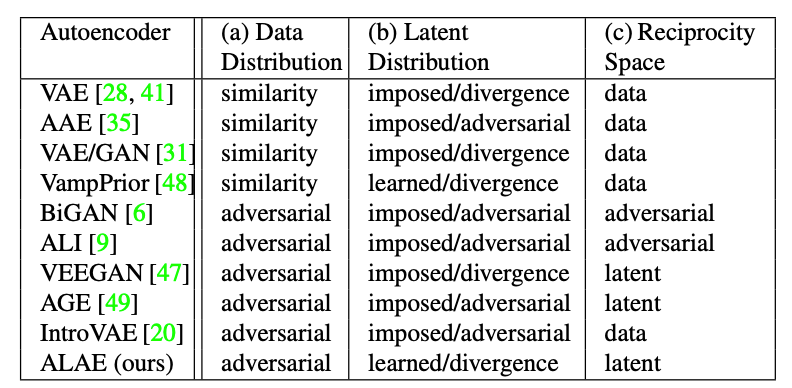

此外,研究者还展示了 ALAE 与其他自编码器的关

联,详见下表:

![]()

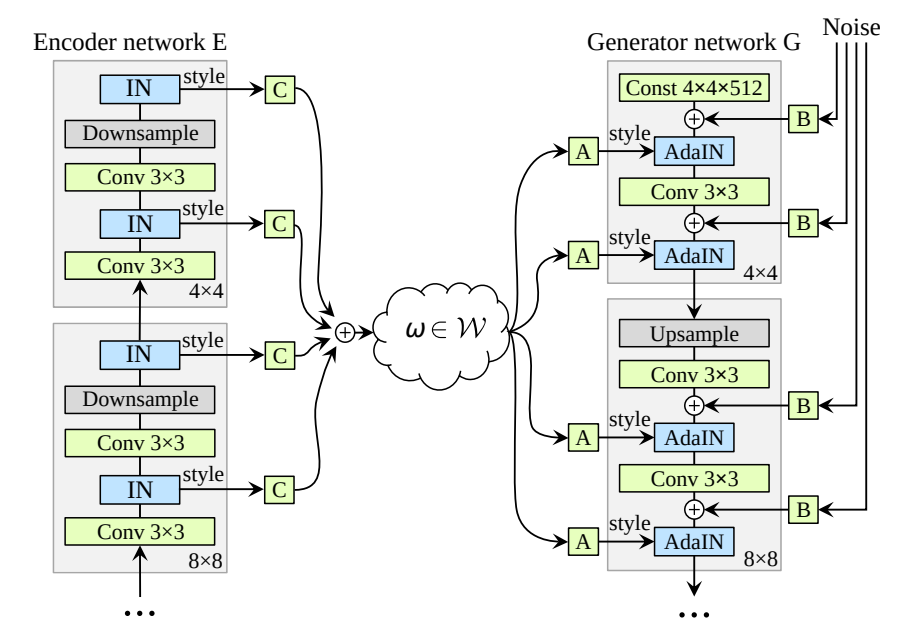

研究者使用 ALAE 构建了一个自编码器,该自编码器使用的是基于 StyleGAN 的生成器。具体架构如下图 2 所示:

![]()

图 2:StyleALAE 架构。StyleALAE 编码器中的实例归一化(IN)层用来提取多尺度风格信息,并通过可学习的多重线性映射(multilinear map)将它们组合成为一个潜在代码 w。

![]()

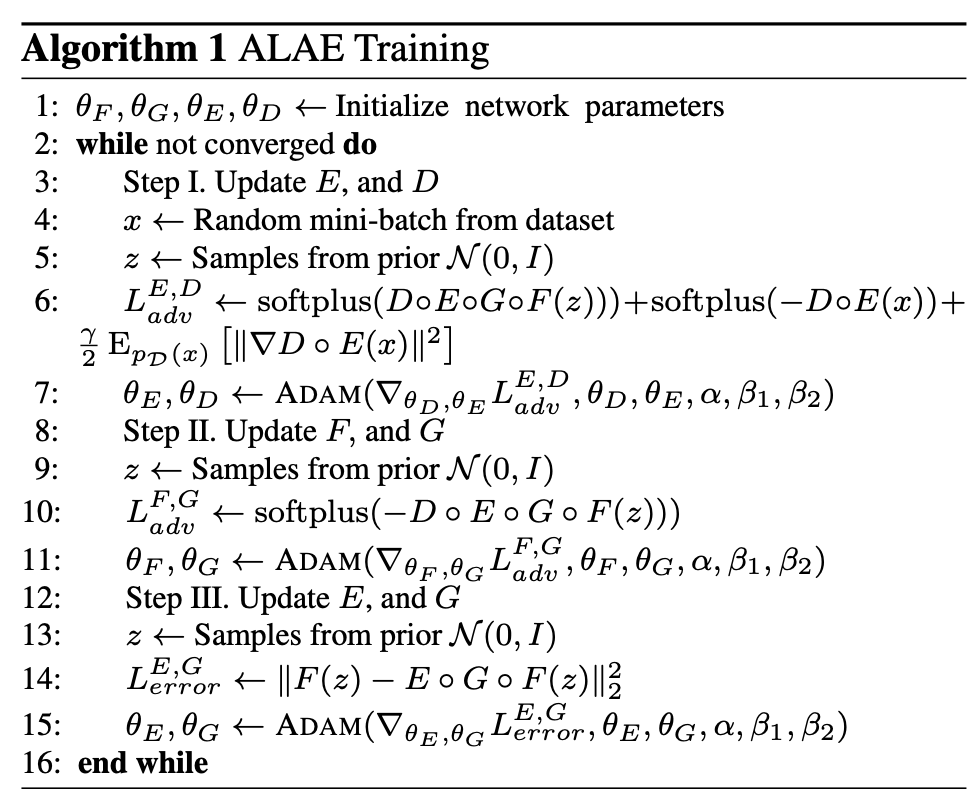

该研究在多个数据集上评估了 ALAE 的性能,实验代码和数据参见 GitHub 地址。

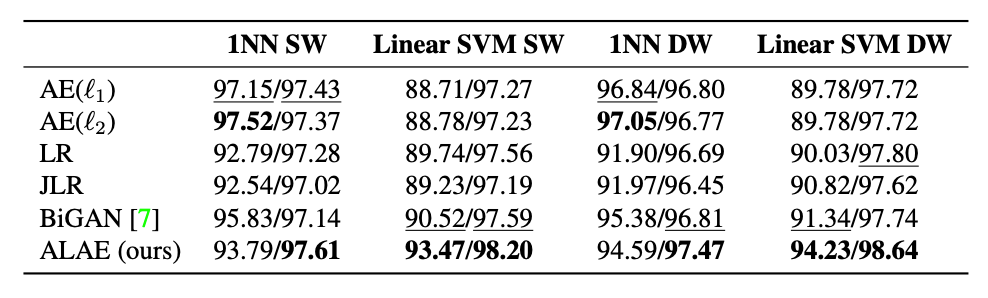

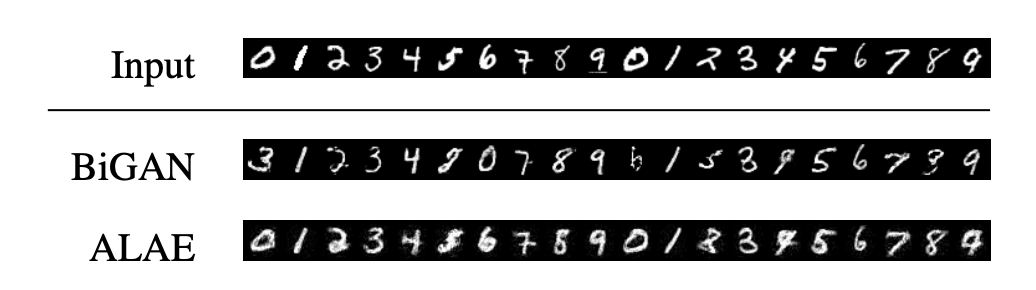

研究者使用 MNIST 数据集训练 ALAE,并使用特征表示来执行分类、重建和分析解耦能力的任务。

![]()

表 2:不同方法在 MNIST 分类任务上的性能。

![]()

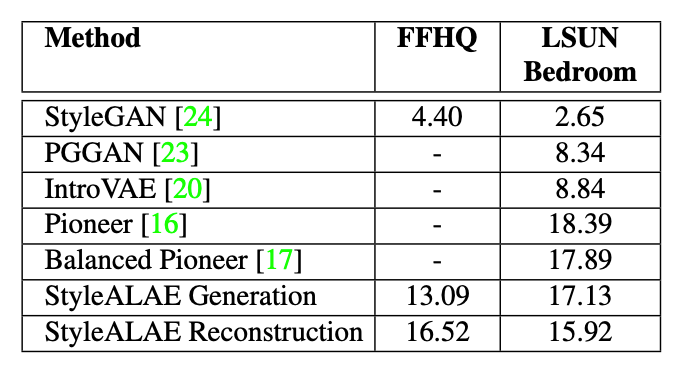

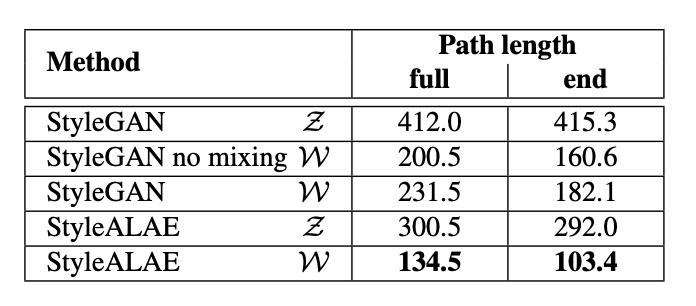

研究者在 FFHQ、LSUN 和 CelebA-HQ 数据集上评估 StyleALAE 的性能。

![]()

表 3:不同方法在 FFHQ 和 LSUN 数据集上的 FID 分数。

![]()

表 4:不同方法的感知路径长度(PPL),表示表征解耦程度。

![]()

图 5:FFHQ 重建结果。StyleALAE 对未见过的图像的 1024×1024 重建结果。

![]()

图 6:StyleALAE 的 FFHQ 生成结果(1024 × 1024 分辨率)。

![]()

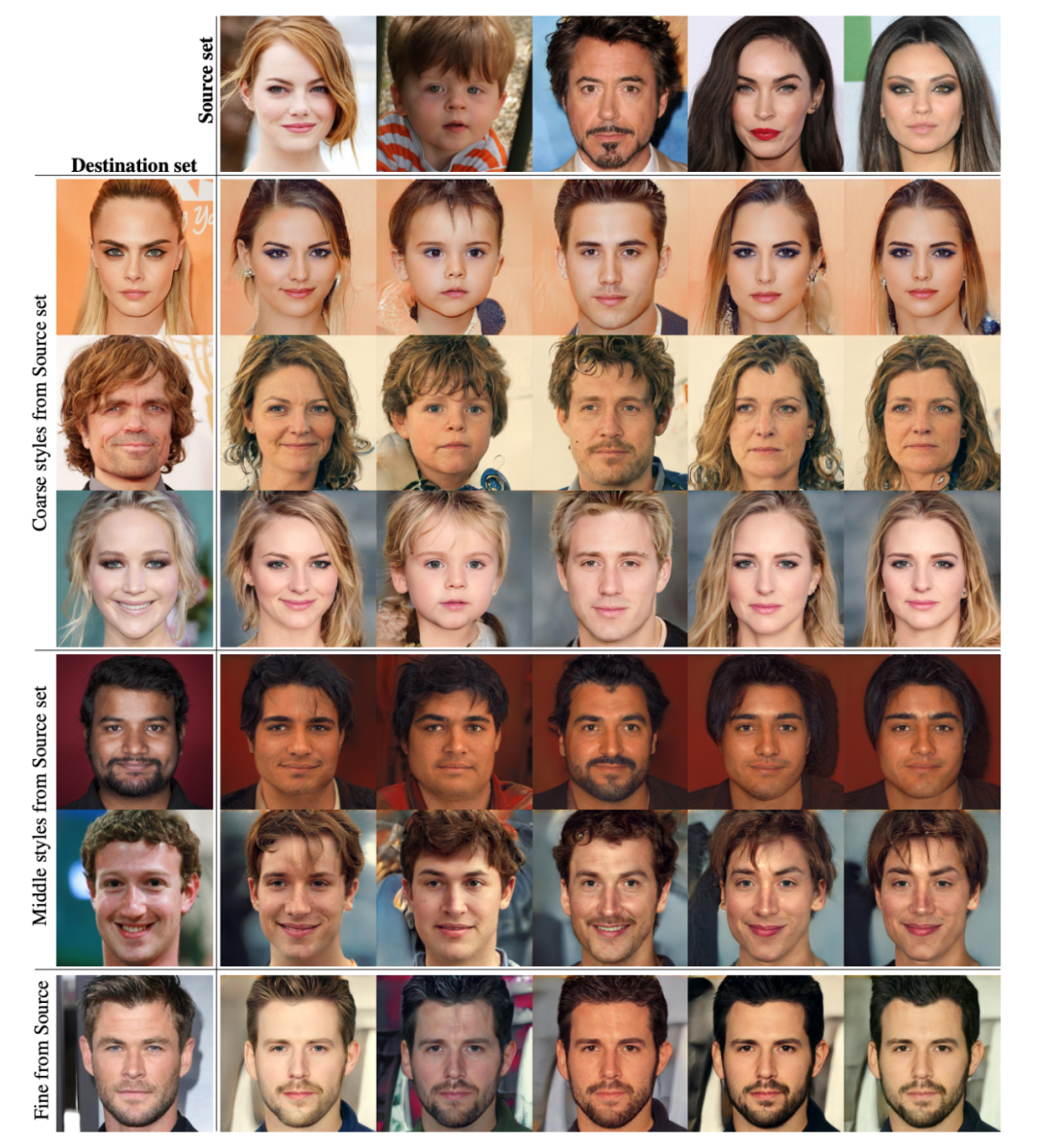

图 9:StyleALAE 的风格混合效果。「coarse styles」从 Source 图像中复制了高级特征,如姿势、大致发型和脸型,从 Destination 图像中复制了所有颜色(眸色、发色和光照);「middle styles」从 Source 图像中复制了较小型的面部特征例如发式、眼睛睁/闭,从 Destination 图像中复制了脸型;「fine styles」从 Source 图像中复制了颜色和微结构。

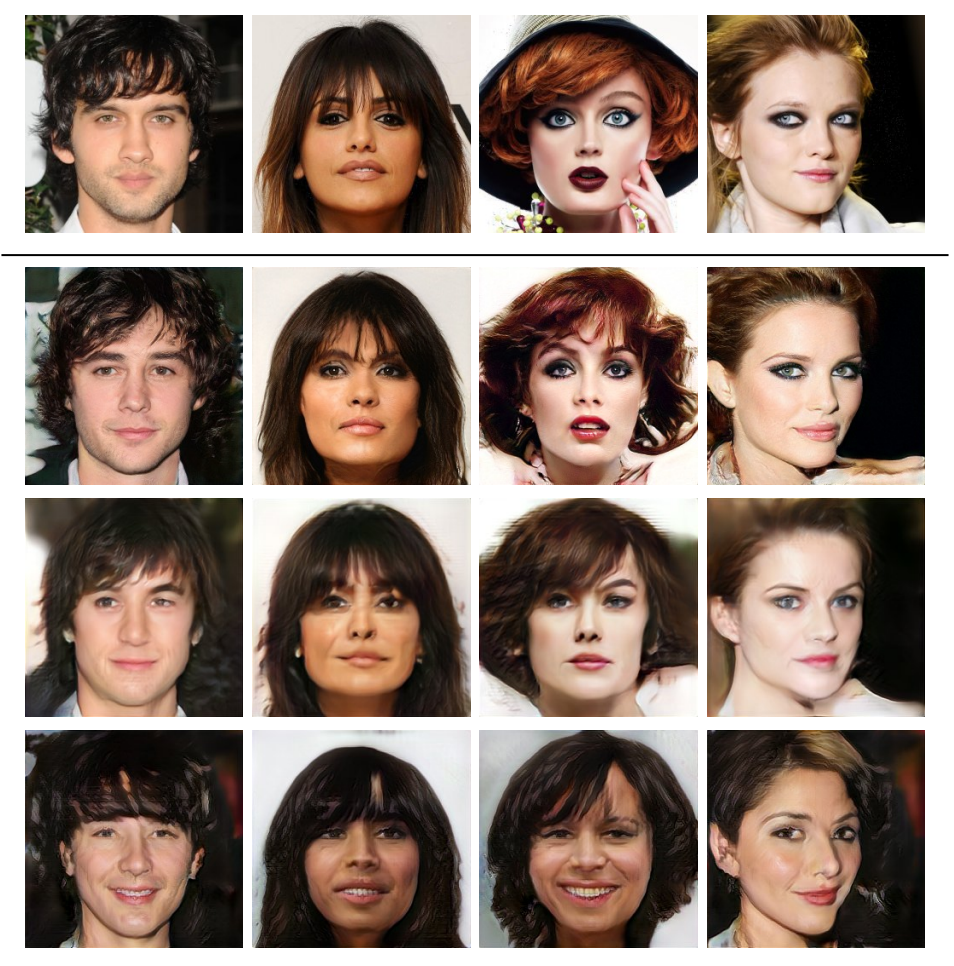

![]()

图 8:不同方法在 CelebA-HQ 数据集上的重建结果。第一行是真实图像;第二行:StyleALAE;第三行:Balanced PIONEER;第四行:PIONEER。

从图中可以看出,StyleALAE 的生成结果更加清晰,失真度也最低。

论文下载

在CVer公众号后台回复:StyleALAE,即可下载本论文

重磅!CVer-论文写作与投稿 交流群已成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满1250+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI/TIP等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

![]()

▲长按加微信群

![]()

▲长按关注CVer公众号

麻烦给我一个在看!