【学界】 极端图像压缩的生成对抗网络,可生成低码率的高质量图像

选自arXiv

作者:Eirikur Agustsson等

来源:机器之心

本文提出了一个基于生成对抗网络的极端学习图像压缩框架,能生成码率更低但视觉效果更好的图像。此外,该框架可以根据原始图像的语义标签映射,在解码图像中完全合成非主要的区域。用户调查研究证实,对于低码率,本文提出的方法明显优于最先进的方法 BPG。

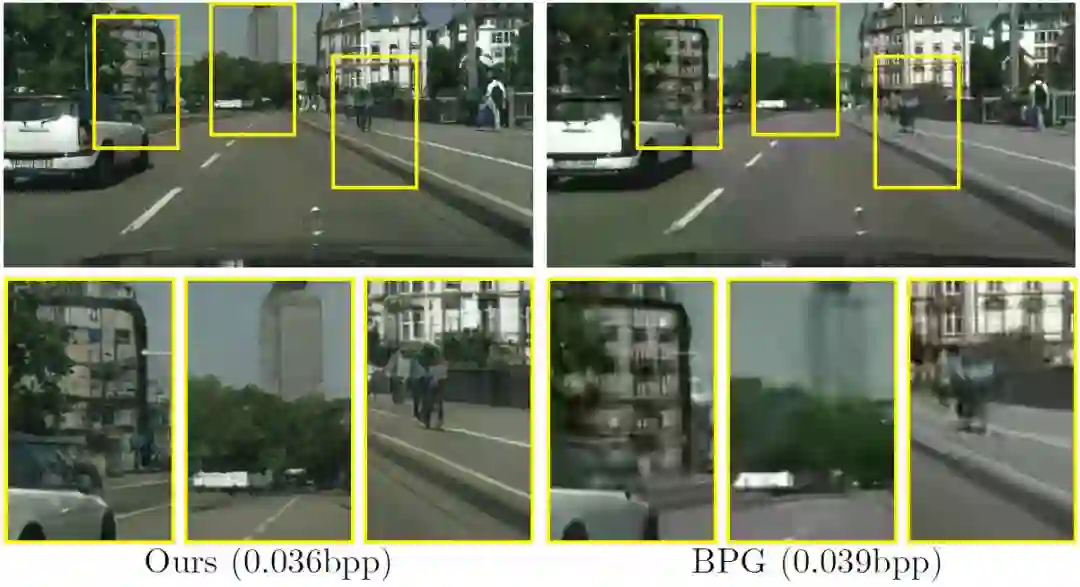

图 1:以对抗损失训练得到的全局生成压缩网络产生的图像,以及相应的 BPG 结果对比 [1]。

引言

基于深度神经网络(DNN)的图像压缩系统,简称深度压缩系统,近来已成为热门研究领域。

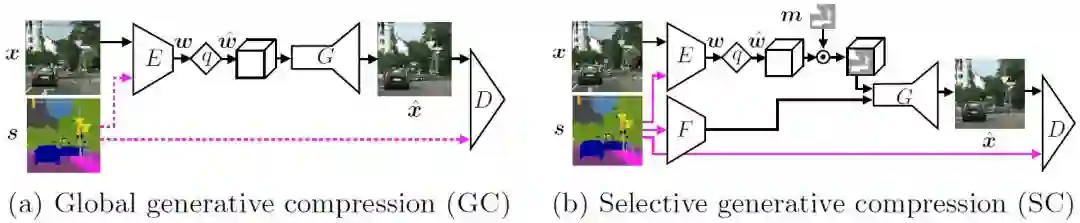

图 2:本文提出的压缩网络的结构。E 是图像 x 和可选的语义标签映射 s 的编码器。q 将潜在代码 w 量化为 w hat。G 是生成器,产生解压缩的图像 x hat,D 是用于对抗训练的判别器。对于选择生成压缩(SC),F 从 s 中提取特征,并且二次采样的热图乘以 z hat(逐点)以进行空间位分配。

这些系统在感知度量 [4-8] 上通常优于当前最佳的工程编解码器,例如 BPG [1]、WebP [2] 和 JPEG2000 [3]。除了在自然图像上可达到更高的压缩率,它们也很容易适用于特定的目标领域,如立体图像或医学图像,以从压缩表征 [9] 中直接实现高效处理和索引。但是,对于每像素低于 0.1 位(bpp)的码率,这些算法仍然会导致质量严重下降。一般来说,当码率趋向于零时,保留全部图像内容变得愈发困难,并且诸如峰值信噪比(PSNR)或多尺度结构相似性(MS-SSIM)[10] 等常用的失真度量也会失去意义,因为这些度量更关心局部(高熵)结构即纹理的保持。为了进一步改善深度图像压缩,有必要开发超越 PSNR 和 MS-SSIM 的训练目标。对抗性损失 [11] 有望实现这一目标。最近这一方法被证明可以捕获全局语义信息和局部纹理,训练出强大的生成器,从语义标签映射产生有视觉吸引力的高分辨率图像 [12,13]。

在本文中,研究者提出并研究了基于生成对抗网络(GAN)的极端图像压缩框架,其中图像的码率低于 0.1 bpp。他们提出了一个基本的 GAN 公式,用于深度图像压缩,从而生成不同程度的内容。与先前的深度图像压缩技术相比,该技术将对抗损失应用于图像补丁的伪像抑制 [6,14] 和纹理细节生成 [15] 或缩略图表征学习 [16],该框架的生成器/解码器由多尺度判别器训练,适用于全分辨率图像 [13]。

我们研究两种操作模式(对应于无条件和有条件的生成对抗网络 [11,17]),即

全局性生成压缩(GC),保留整体图像内容,同时生成不同尺度的结构,例如建筑立面上的树叶或窗户的树叶;

选择性生成压缩(SC),保留语义标签映射中完全生成图像的某些部分,同时高度保留用户定义区域的细节。

GC 的典型用例是在带宽受限的场景,其中我们需要尽可能地保留完整图像,却没有足够的空间存储原始像素,而 GC 在这里可以合成内容而不是块状/模糊斑点。SC 可以应用于视频通话场景,人们希望完全保留视频流中的人像,但视觉上令人愉悦的合成背景也能和真实背景达到同样的效果。在 GC 操作模式下,图像被转换成比特流并使用算术编码进行编码。SC 可以使用现成的语义/实例分割网络(例如 PSPNet [18] 和 Mask R-CNN [19])获得原始图像的语义/实例标签映射,并将其存储为向量图形。就编码成本而言,该框架实现了更小的独立于图像维度的计算代价;另一方面,压缩图像的大小和从语义标签映射生成的区域成比例地减小,在多数情况下也能明显降低存储成本。

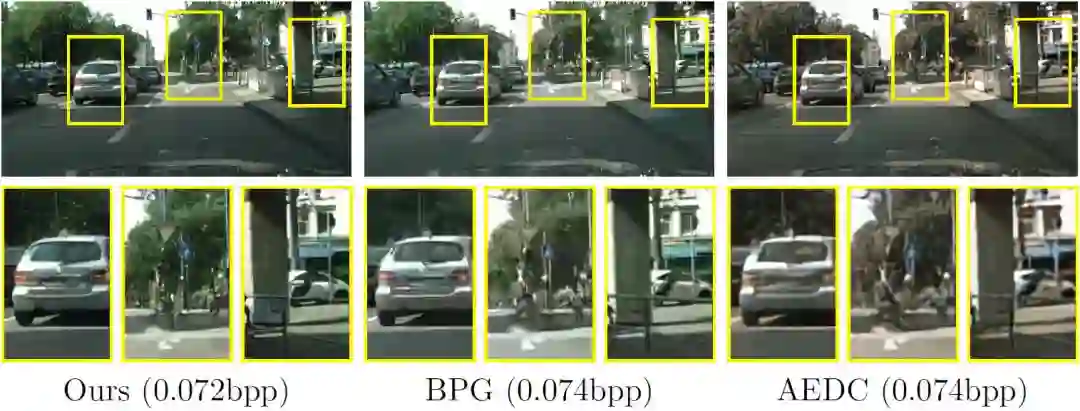

一项关于 GC 的用户综合研究表明,本文提出的压缩系统在视觉上产生了比 BPG [1](当前最先进的工程压缩算法)和最近提出的基于自编码器的深度压缩(AEDC)系统更好的结果 [8]。特别是对于 Cityscapes 数据集中的街景场景图像,即使 BPG 使用的位数超过两倍,用户也更喜欢本文提出系统生成的图像。据作者所知,在用户调查中,这是首次深度压缩方法胜过 BPG 图像的案例。在 SC 操作模式下,该系统可以将保存的图像内容与合成的内容无缝结合,即使在跨越多个目标边界的区域也是如此。通过部分生成图像内容,该系统可以实现超过 50%的码率缩减,而图像质量不会明显降低。在这两种情况下,通过原始图像和重建图像的语义标签映射之间的平均交并比(mIoU)度量的语义信息与两个基线 [1,8] 相比,保存得更完好。

图 3:由 C = 8 的 GC 网络产生的图像,以及 BPG 和 AEDC 的相应结果。

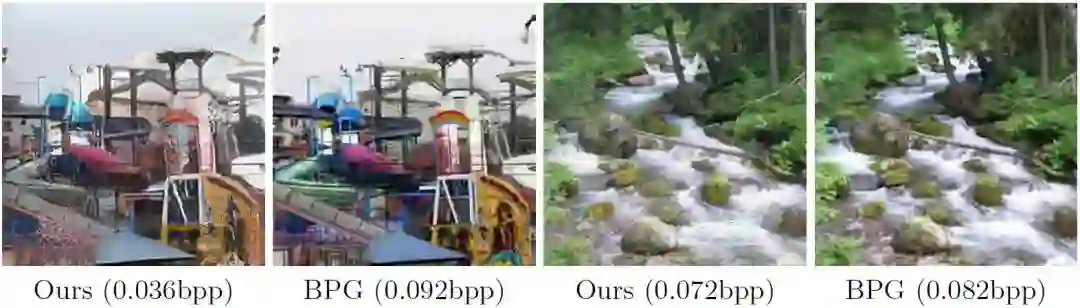

图 4:由 GC 网络(左:C = 4;右:C = 8)产生的图像示例以及 BPG 的相应结果。

图 6:原始柯达图像 13 以及用户调查中使用的解压缩版本(本文提出的),使用 C = 4 的 GC 网络生成。此外还提供了图像的解压缩 BPG、JPEG、JPEG2000 和 WebP 版本。如果编解码器无法输出低至 0.036bpp 的图像,则选择该编解码器的最低分辨率。

论文:Generative Adversarial Networks for Extreme Learned Image Compression(用于极端学习图像压缩的生成对抗网络)

论文地址:https://arxiv.org/abs/1804.02958

摘要:我们提出了一个基于生成对抗网络(GANs)的极端学习图像压缩框架,与以前的压缩方式相比,其生成的图像码率更低但视觉效果更令人满意。借助学习压缩的 GAN 公式和一个在全分辨率图像上运行的生成器/解码器,并与多尺度判别器一起训练,就可以达到这种效果。此外,我们的方法可以根据从原始图像中提取的语义标签映射,在解码图像中完全合成非主要的区域(例如街道和树),因此仅需要存储保留区域和语义标签映射。用户调查研究证实,对于低码率,我们的方法明显优于最先进的方法,与次佳方案 BPG 相比,码率节约高达 67%。

☞【学界】OpenPV:中科院研究人员建立开源的平行视觉研究平台

☞【征稿通知】IEEE IV 2018“智能车辆中的平行视觉”研讨会

☞【学界】ParallelEye:面向交通视觉研究构建的大规模虚拟图像集

☞【CFP】Virtual Images for Visual Artificial Intelligence

☞【最详尽的GAN介绍】王飞跃等:生成式对抗网络 GAN 的研究进展与展望

☞【智能自动化学科前沿讲习班第1期】王飞跃教授:生成式对抗网络GAN的研究进展与展望

☞【智能自动化学科前沿讲习班第1期】王坤峰副研究员:GAN与平行视觉

☞【重磅】平行将成为一种常态:从SimGAN获得CVPR 2017最佳论文奖说起

☞【征稿】神经计算专刊Virtual Images for Visual Artificial Intelligence

☞【学界】用AI让静图变动图:CVPR热文提出动态纹理合成新方法