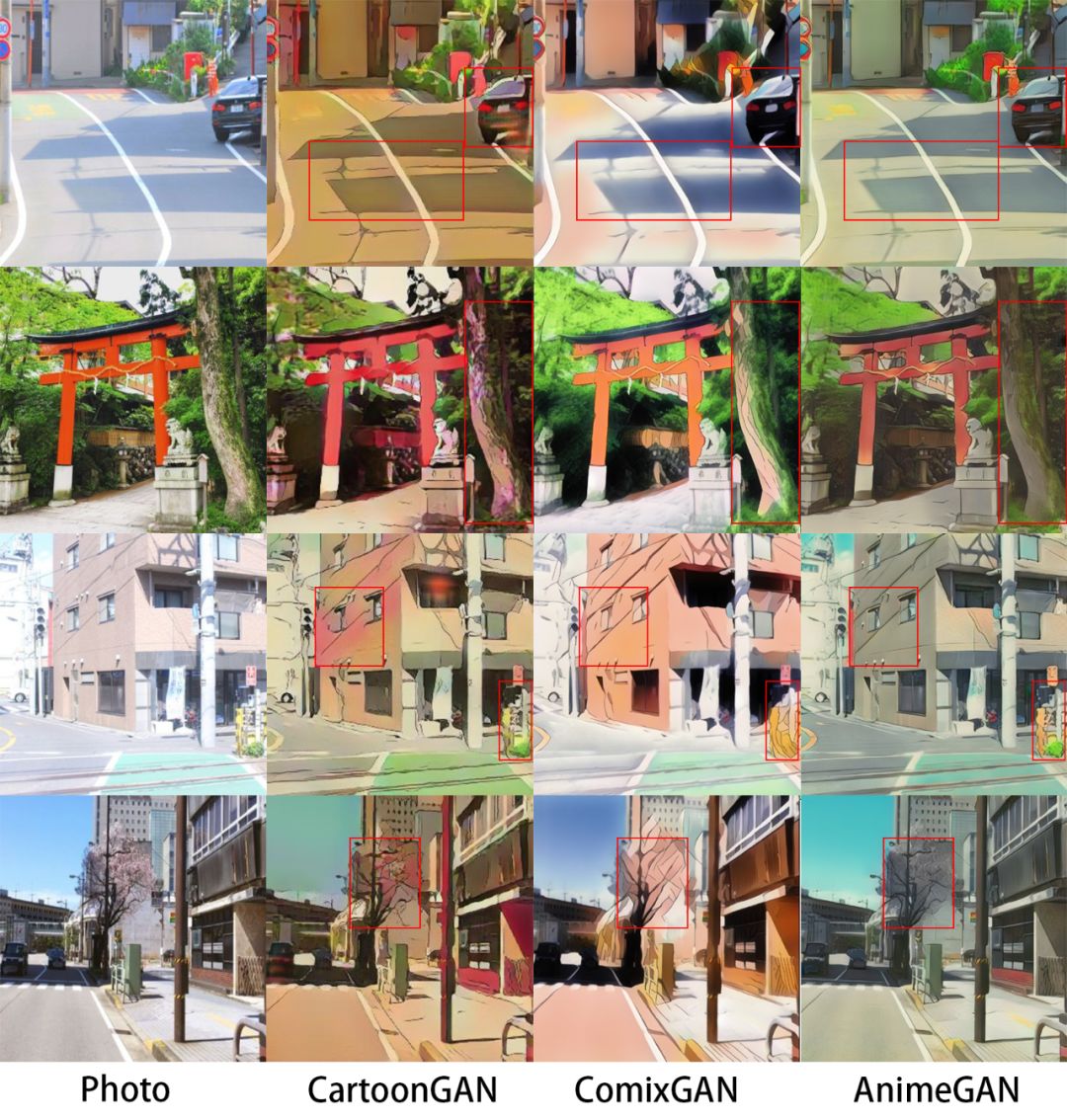

宫崎骏动画里的新垣结衣见过没?这个开源动漫生成器让你的照片秒变手绘日漫

参与:肖清、思

随手拍张照片,顺势转换为宫崎骏、新海诚等日漫大师的手绘风格作品,这个专门生成动漫图像的 GAN,实测很好用。

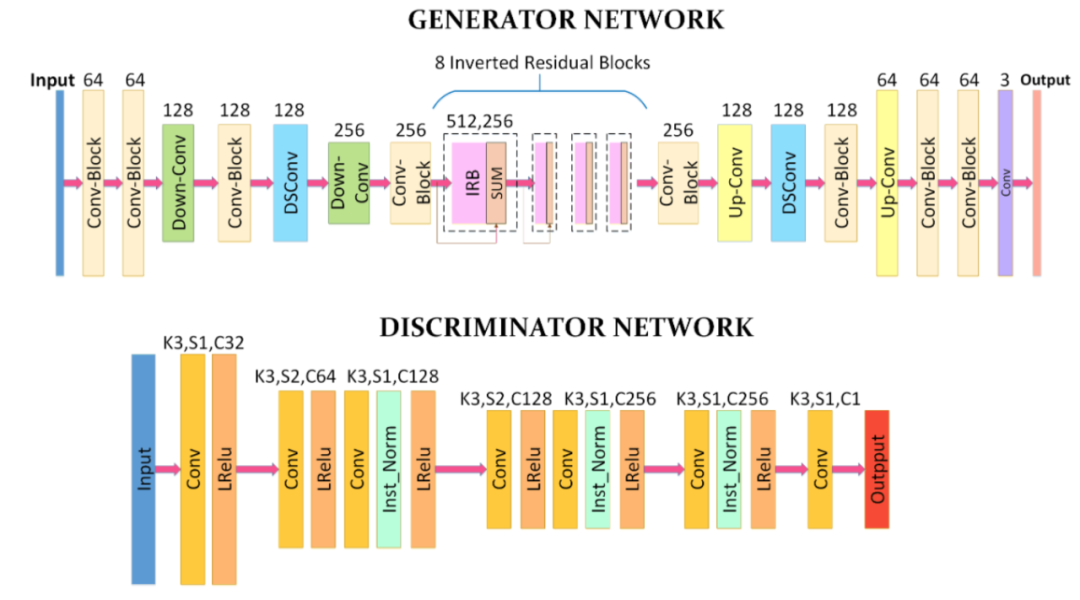

灰度风格(grayscale style)loss

灰度对抗(grayscale adversarial)loss

色彩重构(color reconstruction)loss

python 3.6.8

tensorflow-gpu 1.8

opencv

tqdm

numpy

glob

argparse

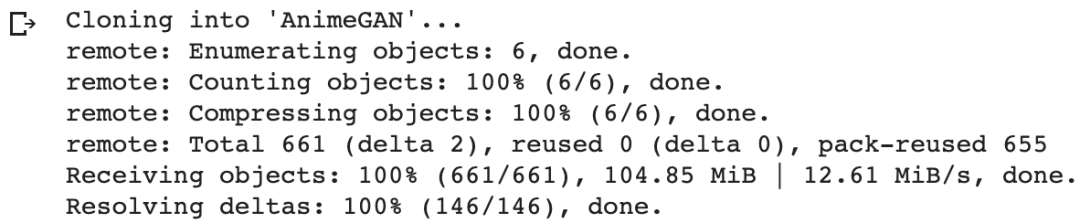

!git clone https://github.com/TachibanaYoshino/AnimeGAN

import os

os.chdir('AnimeGAN')

print(os.getcwd())

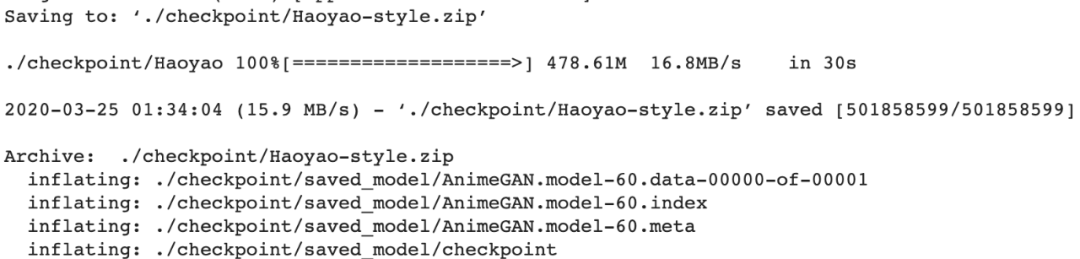

URL=https://github.com/TachibanaYoshino/AnimeGAN/releases/download/Haoyao-style_V1.0/Haoyao-style.zip

ZIP_FILE=./checkpoint/Haoyao-style.zip

TARGET_DIR=./checkpoint/saved_model

mkdir -p ./checkpoint

wget -N $URL -O $ZIP_FILE

mkdir -p $TARGET_DIR

unzip $ZIP_FILE -d $TARGET_DIR

rm $ZIP_FILE

DatesetURL=https://github.com/TachibanaYoshino/AnimeGAN/releases/download/dataset-1/dataset.zip

ZIP_FILE=./dataset.zip

TARGET_DIR=./dataset

rm -rf dataset

wget -N $DatesetURL -O $ZIP_FILE

unzip $ZIP_FILE -d $TARGET_DIR

rm $ZIP_FILE

VGG_FILE=./vgg19_weight/vgg19.npy

wget --load-cookies /tmp/cookies.txt "https://docs.google.com/uc?export=download&confirm=$(wget --quiet --save-cookies /tmp/cookies.txt --keep-session-cookies --no-check-certificate 'https://docs.google.com/uc?export=download&id=1U5HCRpZWAbDVLipNoF8t0ZHpwCRX7kdF' -O- | sed -rn 's/.*confirm=([0-9A-Za-z_]+).*/\1\n/p')&id=1U5HCRpZWAbDVLipNoF8t0ZHpwCRX7kdF" -O $VGG_FILE && rm -rf /tmp/cookies.txt

!bash download_staffs.sh

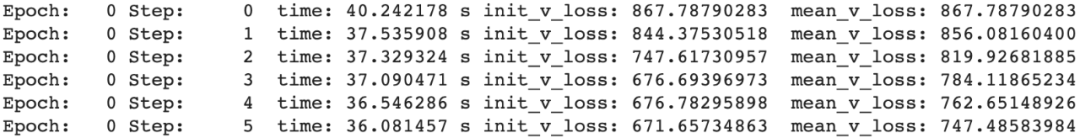

!python main.py --phase train --dataset Hayao --epoch 101 --init_epoch 1

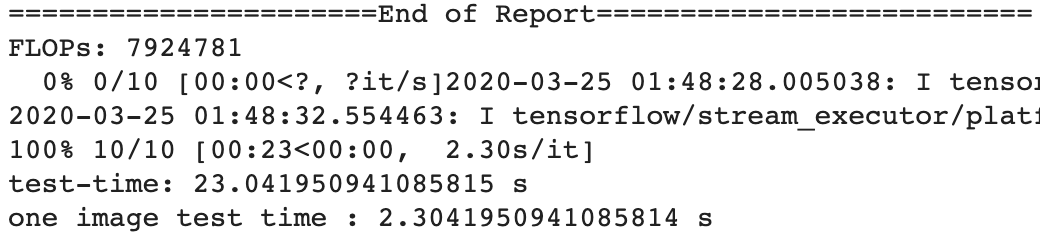

!python test.py --checkpoint_dir checkpoint/saved_model --test_dir dataset/test/real --style_name H

登录查看更多

相关内容

专知会员服务

27+阅读 · 2019年8月10日

Arxiv

11+阅读 · 2018年12月8日

Arxiv

3+阅读 · 2018年5月6日

Arxiv

5+阅读 · 2017年11月24日