堪比Focal Loss!解决目标检测中样本不平衡的无采样方法

点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文授权转载自:机器学习算法工程师

作者:白 将 | 编辑:田 旭

01

概述

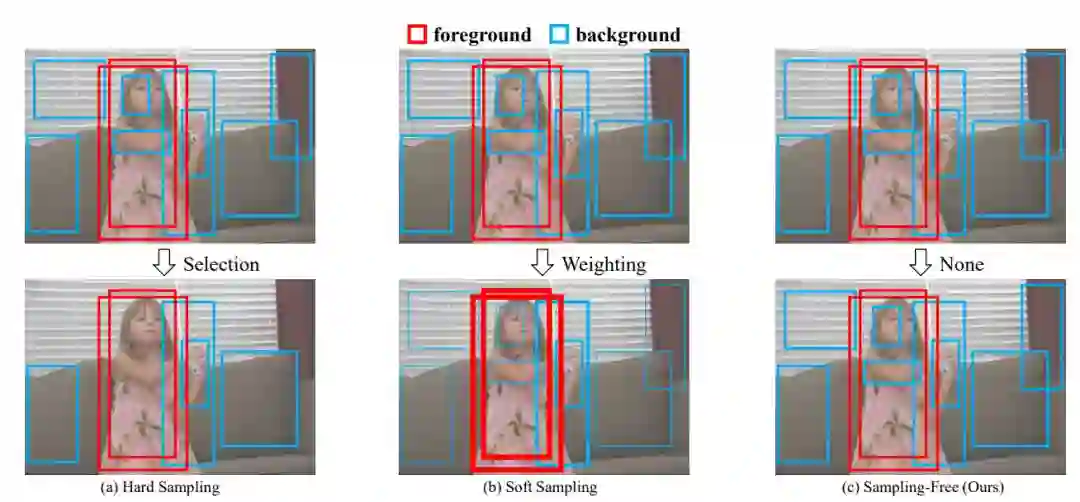

训练目标检测模型的一个难点是样本不均衡,特别是正负样本比例严重失衡。目前解决这类问题主要是两种方案(见综述Imbalance Problems in Object Detection: A Review):一是hard sampling方法,从所有样本中选择一定量的正样本和负样本,只有被选择的样本才计算loss,一般会倾向选择一些难负例样本,比如OHEM;另外一类方法是soft sampling方法,选择所有样本计算loss,但是不同的样本赋给不同的权重值,比如focal loss。这些基于采样的策略虽然有效,但是需要超参数调节。这里,我们介绍的论文是Is Sampling Heuristics Necessary in Training Deep Object Detectors?,论文提出了一种无采样方案,此方案与前面两种方法的对比如下:

图1 三类方法对比

无采样方法使用所有的样本进行训练,下面我们具体来看它如何训练出比较好的检测效果,它的策略非常简单。

02

从RetinaNet和Focal loss说起

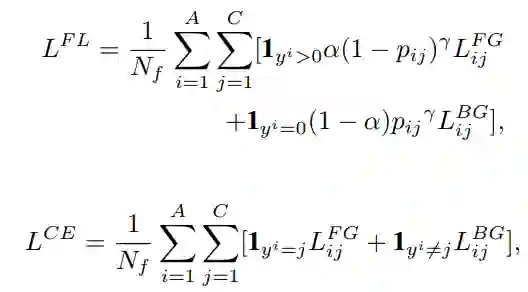

表示focal loss,而

表示focal loss,而

表示普通交叉熵。

表示普通交叉熵。

表示的是对第

表示的是对第

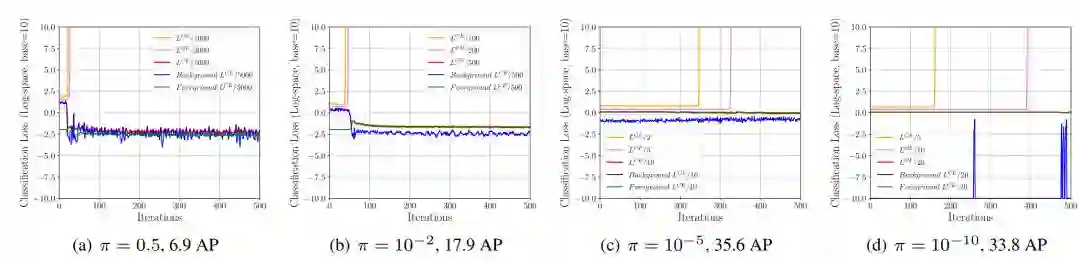

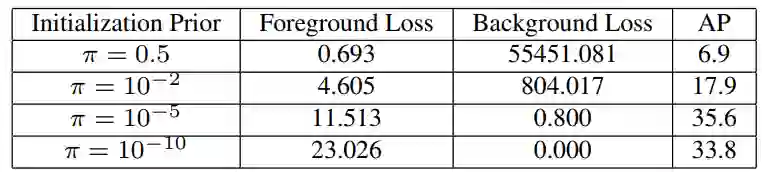

对于focal loss其实就是在交叉熵基础上为不同样本分配权重。对于RetinaNet-FL,比较容易训练并取得很好的效果。那么,对于RetinaNet-None,如果只是按同样的设置训练,会发现分类的梯度很快爆炸,如图2a所示,当我们尝试减少分类loss的权重直到除以5000才可以解决梯度爆炸,但是最终的效果很差,AP值仅为6.9。我们来分析这个问题,首先由于负样本太多,模型训练刚开始负样本的loss会很大,而且不稳定,所以很容易出现梯度爆炸。然后我们可以通过降低分类权重避免梯度爆炸,但是从loss曲线上看,分类loss会从一个较大的值迅速降为一个极小值,后面就在此附近来回震荡,这说明模型的分类loss很快被负样本所主导,模型倾向于预测负样本,所以最终模型效果依然很差。这是一个进退难题。

图2 分类损失的迭代曲线

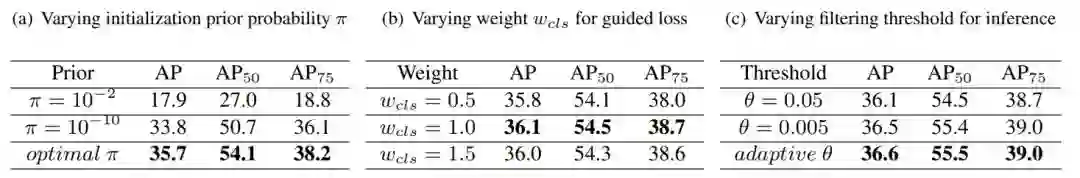

其实梯度容易爆炸的一个原因在于模型初始化策略,一般情况下我们会倾向让初始化的模型对于各类的预测是相同概率的,但是对于我们这个正负样本极度不平衡问题,这其实是非常不利的,因为负样本的loss会很大。所以RetinaNet论文中建议在对分类分支初始化时,对负样本设置一个先验概率值

RetinaNet中采用的

这说明只要适当调整模型的初始化以及loss,采用普通交叉熵是可以达到与focal loss类似的效果的。这是此论文最重要的发现,据此给出了无采样的训练机制,主要包括三点,让我们一一道来。

03

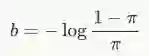

最优bias初始化

前面已经说到,分类分支的初始化对模型训练很关键,这里我们理论分析最优的 如何确定。

假定数据集中共有

如何确定。

假定数据集中共有

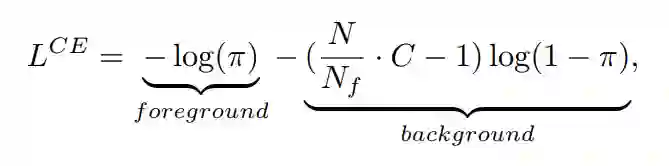

是接近的,那么分类loss就可以大致估算出来:

是接近的,那么分类loss就可以大致估算出来:

,我们可以计算出正负例的分类loss,如下表所示:

,我们可以计算出正负例的分类loss,如下表所示:

在前面的分析中,我们发现

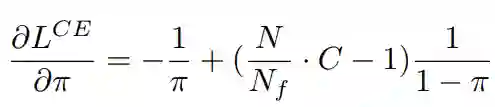

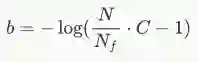

基于上面的分析,最优的设置应该是要使整体loss最低,我们可以求导数来确定

为

为

,此时

,此时

为1.113e-5,和我们的实验值是吻合的。

为1.113e-5,和我们的实验值是吻合的。

04

Guided Loss

05

类别自适应阈值

前面已经提到,RetinaNet-None会出现置信度偏移现象,我们可以采用较低的阈值来进一步提升模型效果,但是其实对每个类别,我们可以采用不同的过滤阈值。这里提出一种基于训练样本的类别自适应阈值(class-adaptive threshold):

06

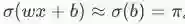

实验效果

从表中可以看到,采用无采样方法的模型相比baseline均有一定的提升,这说明这一机制不仅限于理论分析,在实际中确实可以取得较好的效果。

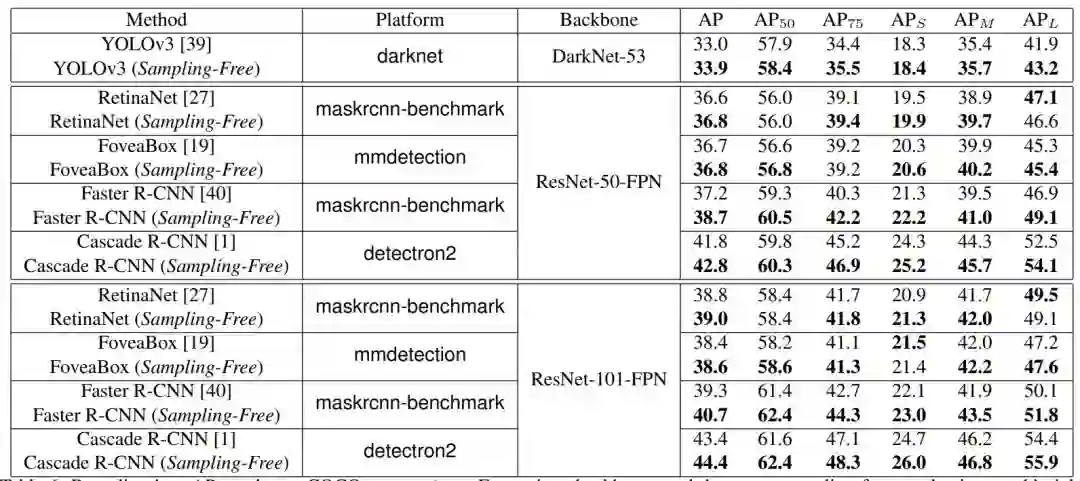

另外,作者也分别实验分析了三种策略,如下表所示:

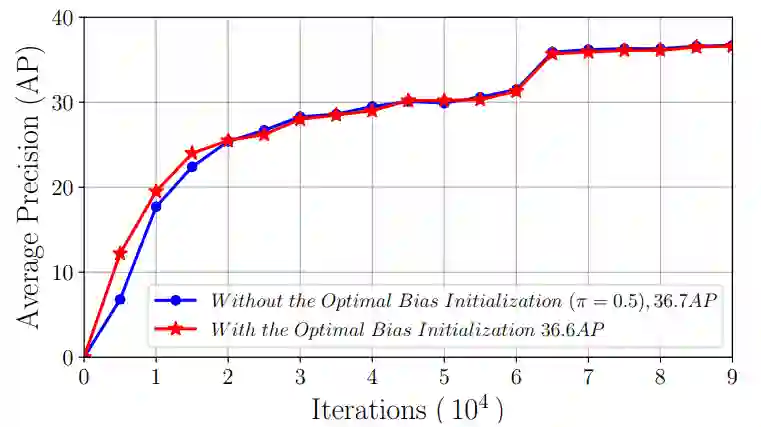

另外一点是,前两种策略应该是有一定的互补性质的,比如都是适当降低分类loss来避免梯度爆炸的问题。这里作者比较了第一策略的采用与否对第二策略guided loss的影响,结果如下图所示:

这里可以看到只要有了guided loss,第一策略对最终模型效果的影响是微乎其微的。这也很容易理解,最早的实验我们发现最重要的是要降低分类loss,两个策略可以起到同样的效果。不过从收敛曲线上可以看到,加入第一策略,收敛速度稍微更快一些,所以还是推荐加入第一策略。

07

小结

正负样本不平衡一直以来是目标检测中比较头疼的问题,这篇论文的主要贡献是分析了这个问题对训练的影响,并给出了可以解决该问题的无采样方法,思路还是非常清晰的,看起来也是行之有效。

参考

Is Sampling Heuristics Necessary in Training Deep Object Detectors?

Imbalance Problems in Object Detection: A Review

Focal Loss for Dense Object Detection

重磅!CVer-目标检测交流群已成立

扫码可添加CVer助手,可申请加入CVer竞赛交流群,同时可申请加入CVer大群和细分方向群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索等群。一定要备注:研究方向+地点+学校/公司+昵称(如目标检测+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加群

▲长按关注我们

麻烦给我一个在看!