CSIG-机器学习中的加速一阶优化算法系列讲座第三讲圆满结束

优化算法是机器学习的重要组成部分,但是传统的优化算法并不完全适用于机器学习,因为通常来说机器学习模型的参数维度很高或涉及的样本数巨大,这使得一阶优化算法在机器学习中占据主流地位。

为了在应用中推广加速一阶优化算法,中国图象图形学学会与浙江师范大学数理医学院、浙江师范大学数学与计算机科学学院、西安科技大学数学与统计学院共同主办了“CSIG-机器学习中的加速一阶优化算法系列讲座”,由中国图象图形学学会机器视觉专委会承办,主讲专家为中国图象图形学学会机器视觉专委会主任林宙辰教授。本次系列讲座分为六讲,从2022年6月17号起,每周五晚8-9点举行。

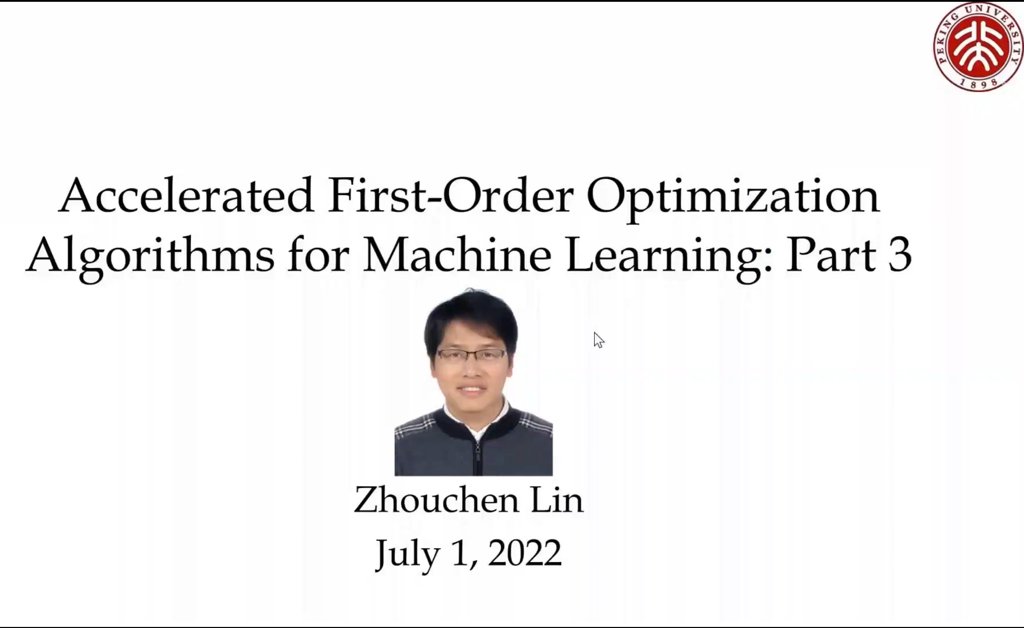

在6月17号和24号第一次和第二次讲座取得巨大成功后。7月1号晚上8点,林宙辰教授在线上做了本次系列讲座的第三讲:有约束凸优化中的加速算法,特别针对线性等式约束优化问题中的加速算法进行了详细深入的讲解。本次讲座十分受关注,讲座直播由腾讯会议和第三方蔻享直播同时进行。

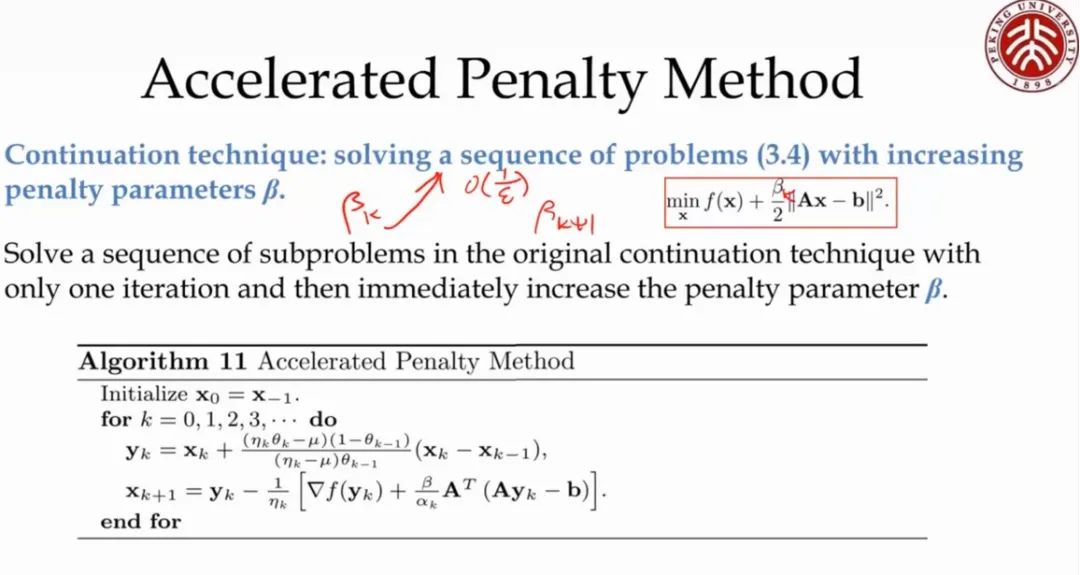

林宙辰教授首先介绍了经典的惩罚法求解线性等式约束凸优化问题的加速算法,结合Nesterov一阶加速方法讲解了加速惩罚算法的实现。

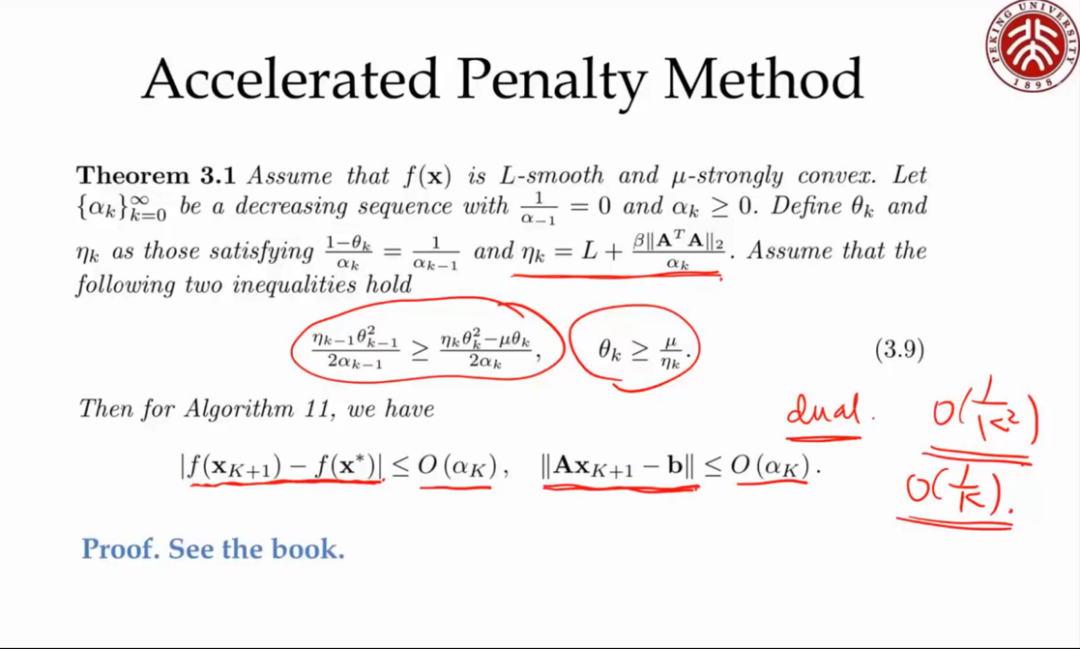

林宙辰教授进一步详细讲解了惩罚法一阶加速算法的收敛速度证明,并对证明中的关键性步骤进行了推导和演示。

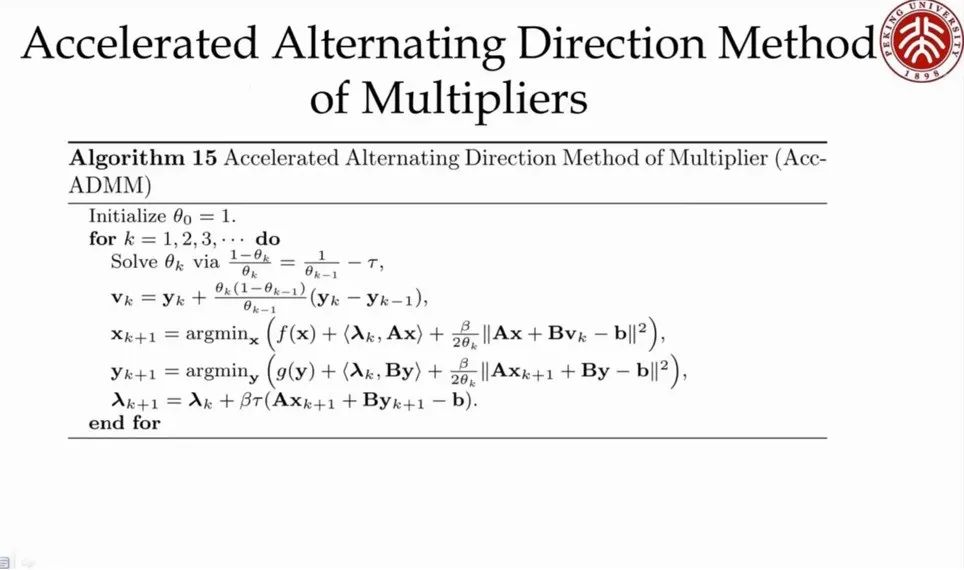

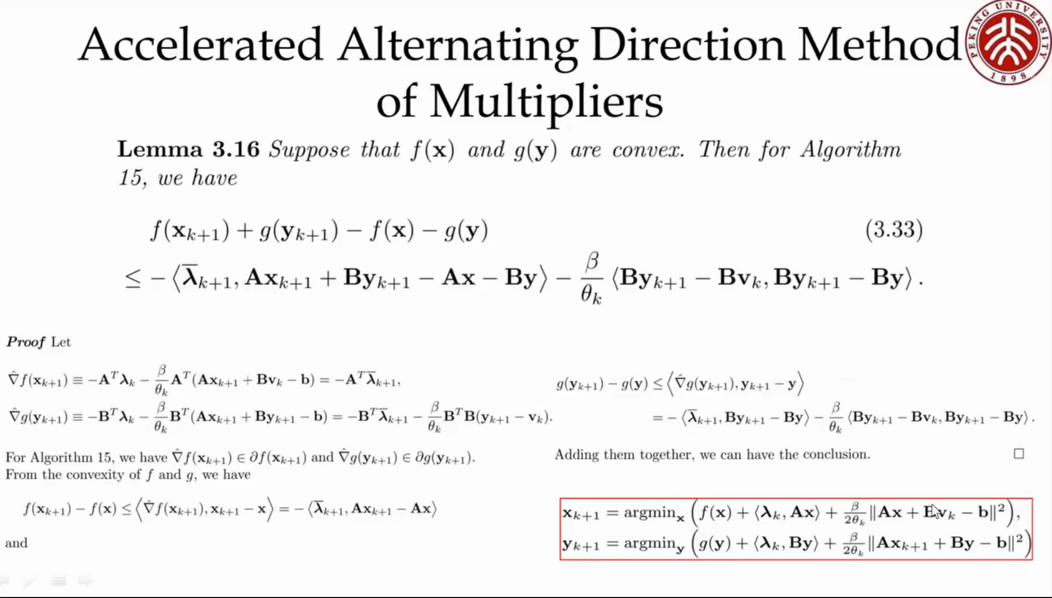

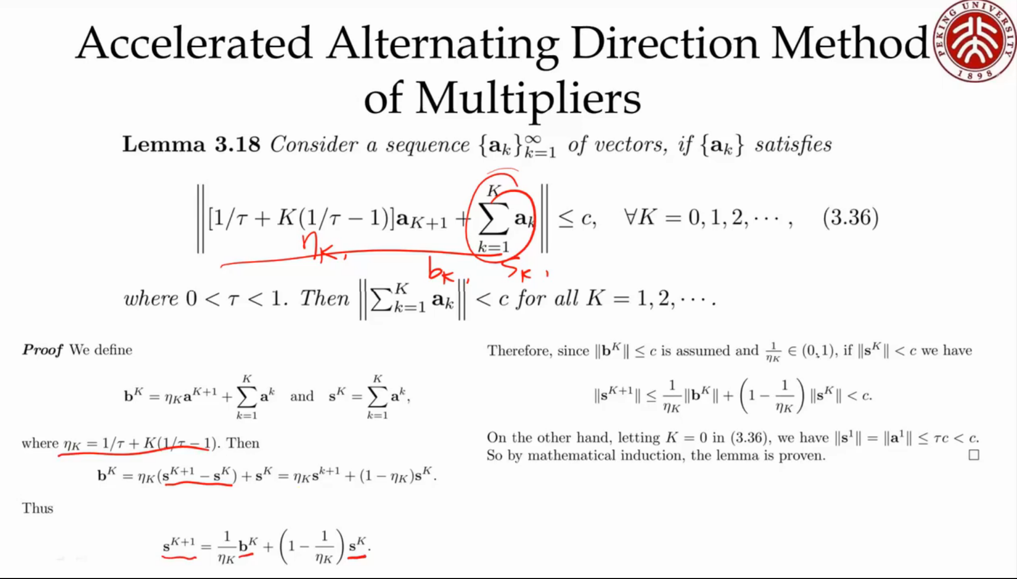

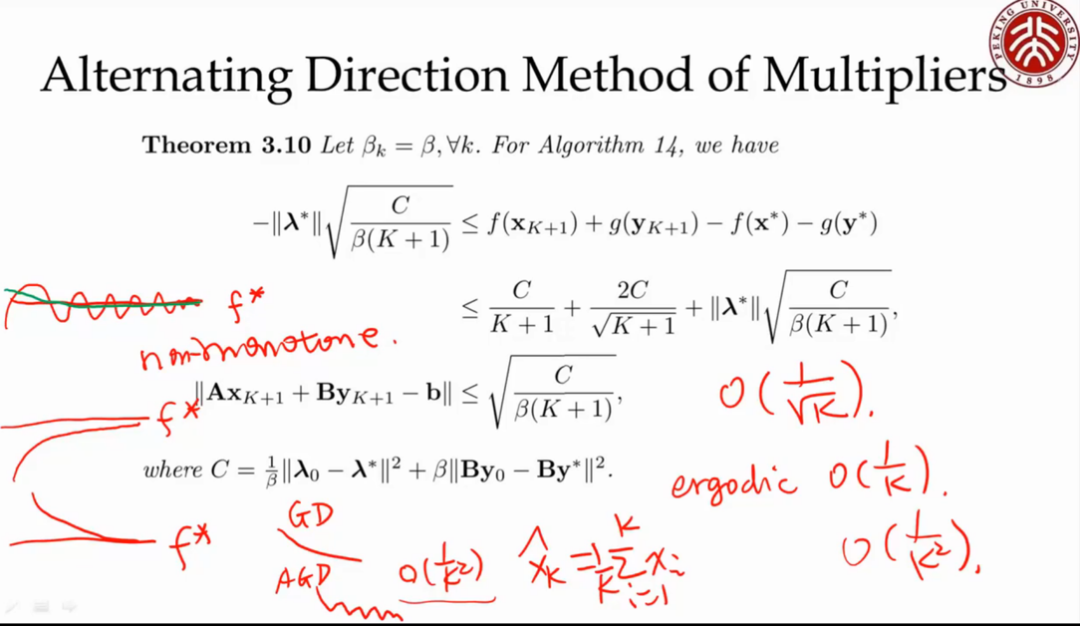

接下来,林宙辰教授进一步针对求解线性等式约束的凸优化问题的交替方向法(ADMM)讲解了相应的一阶加速算法,着重介绍了ADMM加速算法的设计思路以及算法收敛性证明中的关键步骤和引理。

最后,林宙辰教授又讲解了加速ADMM算法从经典ADMM的

演讲结束后,参加线上讲座的同学和老师踊跃提问,林宙辰教授耐心回答了的每个问题。整个讲座生动有趣,内容丰富,原定一个小时的讲座时间延长到近一个半小时。

图为林宙辰教授专著《机器学习中的加速一阶优化算法》的英文版和中文版,以及刚出版的新书《Alternating Direction Method of Multipliers for Machine Learning》

本系列讲座线上直播信息为:

-

腾讯会议: https://meeting.tencent.com/dm/0hyM7yHN76Bv 会议ID: 721-6788-2449 -

蔻享同步直播: https://www.koushare.com/lives/room/095757

下一次讲座时间为7月8日晚20:00-21:00,敬请期待!