【重温经典】吴恩达机器学习课程学习笔记七:Logistic回归

【导读】前一段时间,专知内容组推出了春节充电系列:李宏毅2017机器学习课程学习笔记,反响热烈,由此可见,大家对人工智能、机器学习的系列课程非常感兴趣,近期,专知内容组推出吴恩达老师的机器学习课程笔记系列,重温机器学习经典课程,希望大家会喜欢。

【重温经典】吴恩达机器学习课程学习笔记二:无监督学习(unsupervised learning)

【重温经典】吴恩达机器学习课程学习笔记三:监督学习模型以及代价函数的介绍

【重温经典】吴恩达机器学习课程学习笔记六:特征处理与多项式拟合

吴恩达机器学习课程系列视频链接:

http://study.163.com/course/courseMain.htm?courseId=1004570029

吴恩达课程学习笔记七:Logistic回归

1、 Logistic回归是一种分类算法

在前面的总结里,介绍了垃圾邮件的分类,以及判断是否为恶性肿瘤的问题。这类问题有一个共同的特点,即输出或预测都可以用是或否来表示,也就是可以用离散值1和0来表示输出。

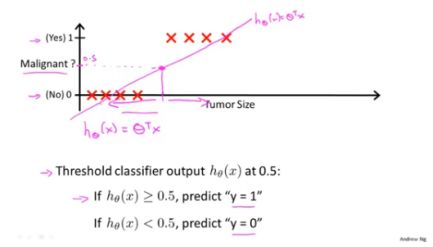

继续来看一下判断是否为恶性肿瘤的例子,假设有数据集的分布如下,可以利用线性函数来拟合。例如设置阈值为0.5,当输出值(y)大于等于0.5的时候,归类为1。在如下的数据集上结果似乎不错。

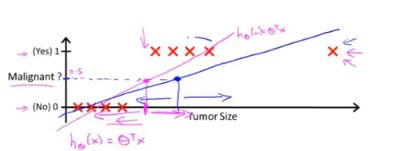

如果在数据集上在添加一个如下图最右边的点,这时拟合的线性函数就可能变成蓝色线所示,同样在阈值设置为0.5时,就会有一些点不必要的被错判。这时线性拟合显示出来它极大的缺陷。即对于分类问题,线性回归并不是一个好的算法。

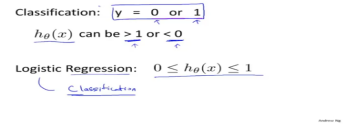

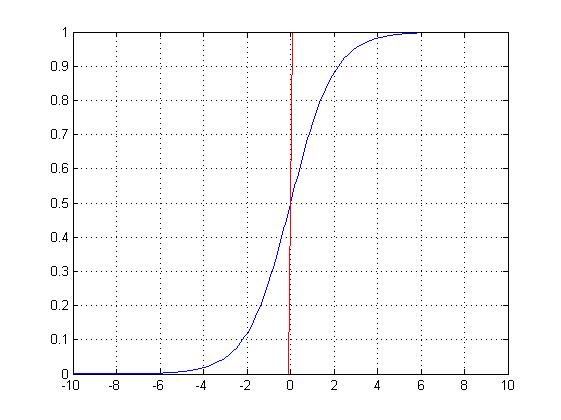

还有一点需要注意,本例中的输出y只在0和1取值,但是用线性拟合,输出值可能会远大于1或远小于0。所以接下来将说明一些关于logistic回归算法的知识,它可以将输出值(预测值)的范围限制在0到1之间。

注意:虽然这里提到了回归,但是logistic是一个分类算法。

2、 假设表示

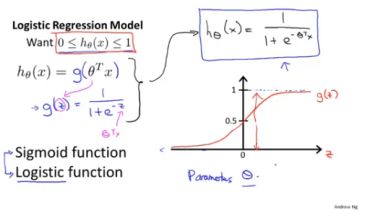

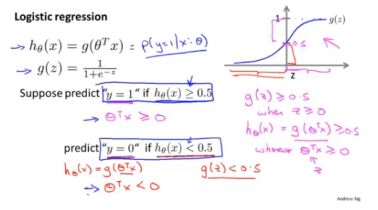

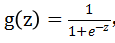

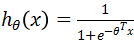

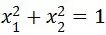

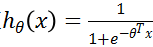

为了使输出值(预测值)的范围在0到1,对

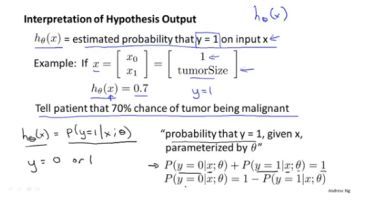

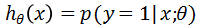

假设函数的意义:

由上可知假设函数的范围为0到1,很自然地想到概率。换言之,如果我们对于某一组输入,得到=0.7,即意味着该肿瘤为恶性肿瘤的概率为0.7。用数学表达为

接下来介绍一下决策边界,它能很好的告诉我们Logistic回归的假设函数在计算什么。

3、 决策边界

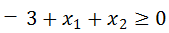

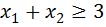

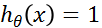

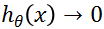

如下图所示,当

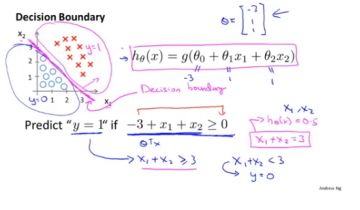

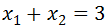

假设有如下左上方的数据集,我们通过某种方式已经求得了参数

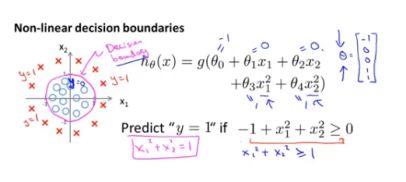

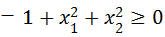

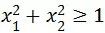

对于如下更为复杂的数据集,同样可以利用logistic回归,但是g()函数的对象将不是简单的线性组合,而是多项式函数。假设我们通过某种方式求得参数分别为[-1,0,0,1,1],则要使预测y=1,可得

综上可知,给定了参数,决策边界也就确定了。

4、 代价函数

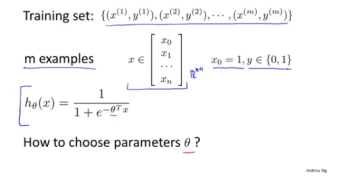

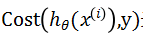

如下,有m组数据,每组数据有n个特征,输出值(类别)为0或1。该如何确定参数向量

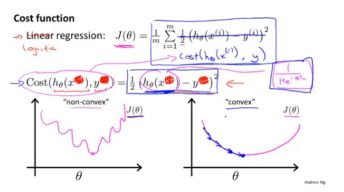

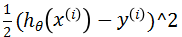

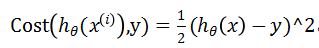

如下,在线性回归时,曾定义代价函数如下,现在用

我们知道

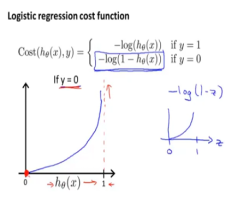

由于上述的问题,定义logistic回归的代价函数如下:

1、 当y=1时,只有当

2、 当y=0时与y=1类似。

后面的总结中会将单组数据的代价函数扩展到整个数据集上,对logistic回归的代价函数简化并使用梯度下降算法。

参考链接:

http://study.163.com/course/courseMain.htm?courseId=1004570029

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“NGML2018” 就可以获取 吴恩达机器学习课程下载链接~

-END-

专 · 知

人工智能领域主题知识资料查看获取:【专知荟萃】人工智能领域26个主题知识资料全集(入门/进阶/论文/综述/视频/专家等)

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请扫一扫如下二维码关注我们的公众号,获取人工智能的专业知识!

请加专知小助手微信(Rancho_Fang),加入专知主题人工智能群交流!加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

投稿&广告&商务合作:fangquanyi@gmail.com

点击“阅读原文”,使用专知