GNN、RL强势崛起,CNN初现疲态?这是ICLR 2021最全论文主题分析

极市导读

ICLR 2021 会议的 Rebuttal 环节已经结束,最终接收结果也将在下月正式公布。日前,有开发者从 ICLR 2021 OpenReview 网页抓取了论文数据,并做了论文高频词、论文得分分布情况等信息的可视化呈现。 >>加入极市CV技术交流群,走在计算机视觉的最前沿

ICLR,全称为 International Conference on Learning Representations,国际学习表征会议。自 2013 年开始每年举办一次,2021 年将举办第九届会议。该会议被认为是深度学习领域的顶级会议之一,它与 CVPR、ACL、NeurIPS 等学术会议一样,被 CCF 评选为一类会议。

ICLR 的创始人包括深度学习三大巨头之二的 Yoshua Bengio 和 Yann LeCun。与其他顶会一样,该会议旨在为深度学习提供一个专业化的交流平台。数据的应用表征对机器学习的性能有着重要的影响,表征学习对于计算机视觉、语音处理、自然语言处理等多个领域都起着至关重要的作用,ICLR 旨在打造这一领域交流研究的平台。

ICLR 2021 将于 2021 年 5 月 4 日至 6 月 8 日以线上形式举办。初审结果已于 11 月 11 日公布,此次会议共收到论文投稿 3013 篇,其中有 856 篇是 NeurIPS 2020 Rejection 之后再提交的。

目前,ICLR 2021 的论文 rebuttal 阶段也已经结束。有开发者从 ICLR 2021 OpenReview 网页抓取了本次大会的论文数据,并做了可视化呈现。该项目统计了论文高频词、论文得分分布情况等信息。

项目地址:https://github.com/evanzd/ICLR2021-OpenReviewData

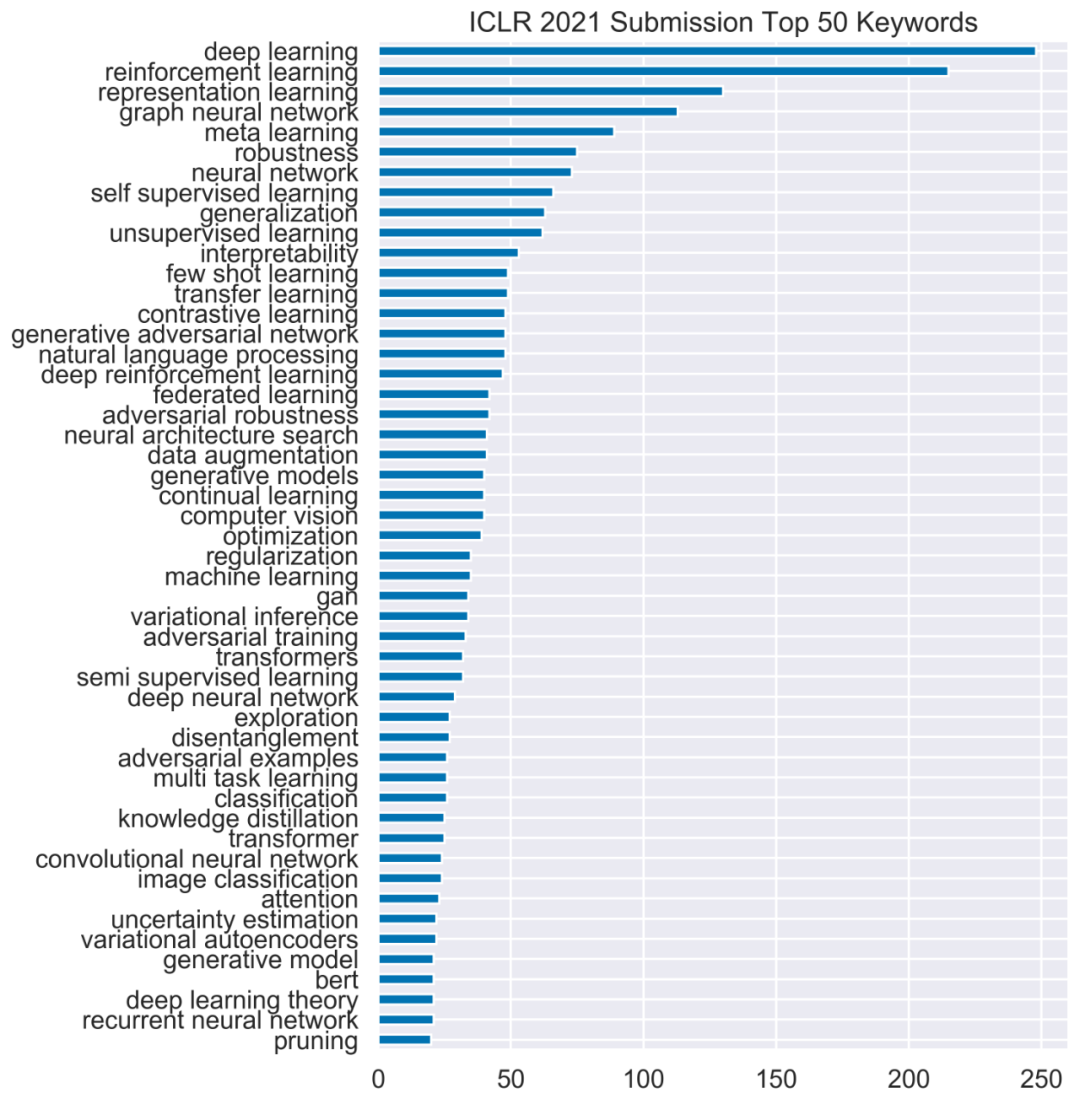

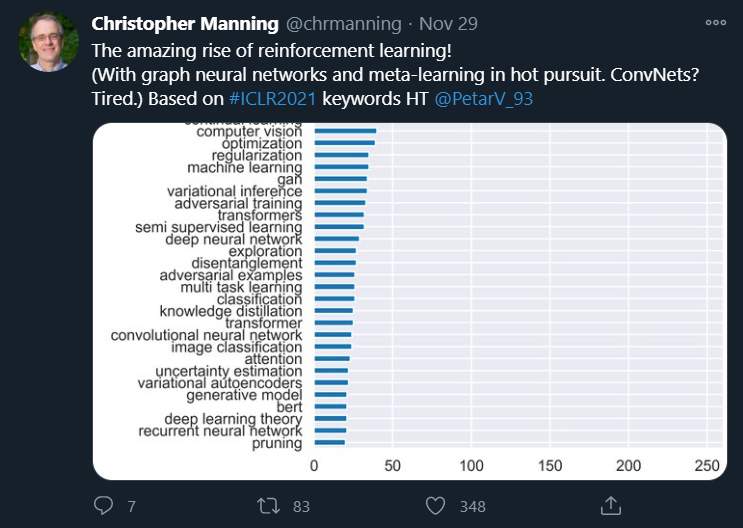

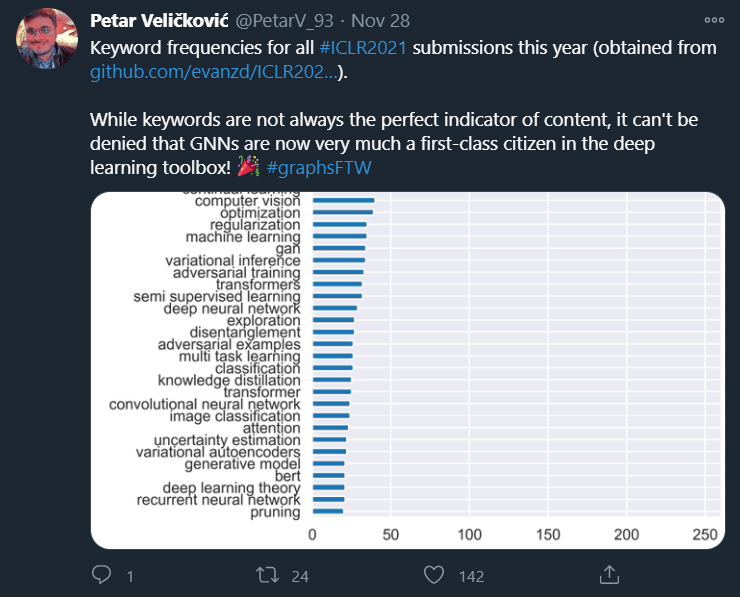

关键词频率

下图列举了提交论文中出现频率排名前 50 的关键词,与往年一样,深度学习、强化学习、表征学习、图神经网络都是非常热门的话题。但与去年的统计数据相比,卷积神经网络(convolutional neural network)的热度骤降,「元学习」、「表征学习」、「图神经网络」的热度均有上升。

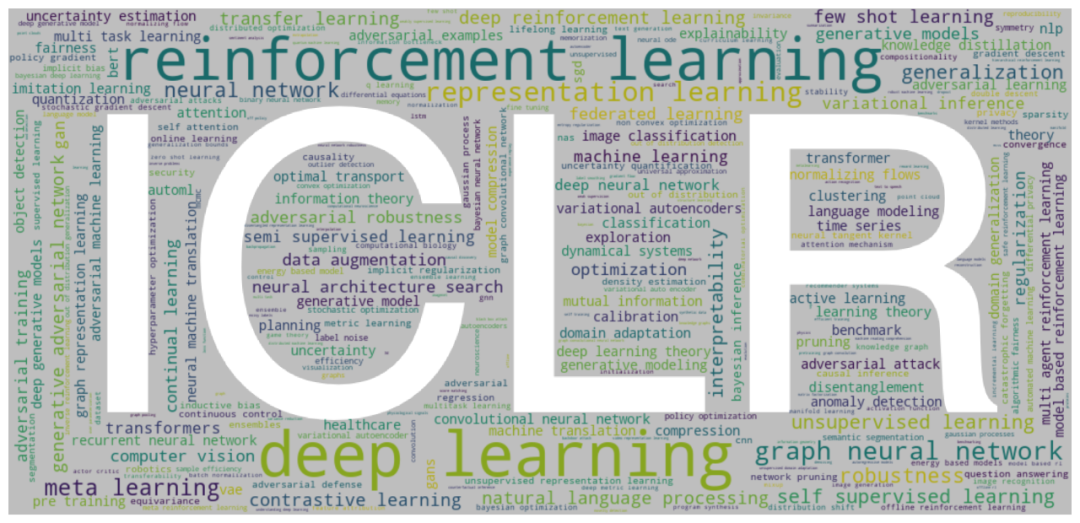

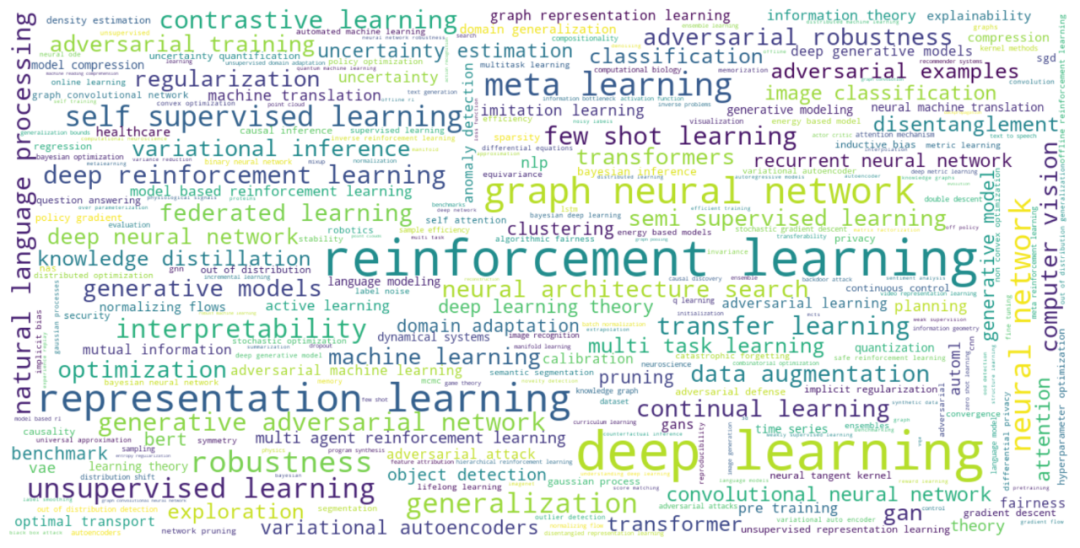

由提交论文关键词组成的词云更加直观地展示了不同研究方向的热门程度:

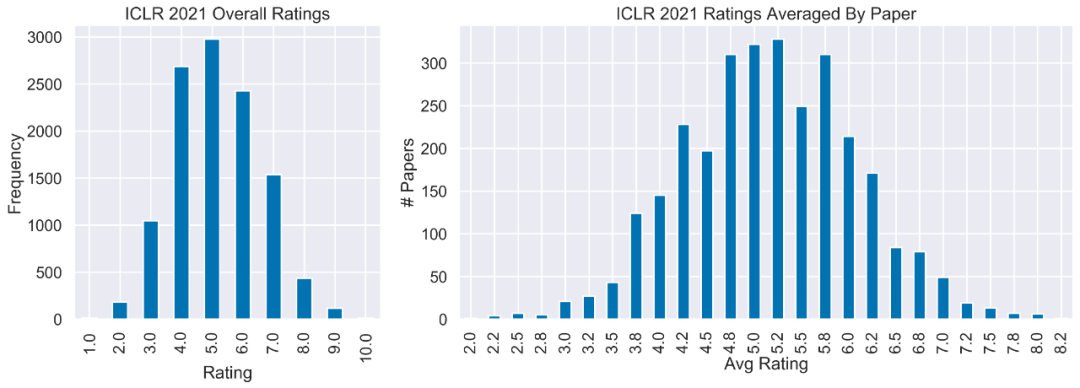

论文得分分布情况

今年 ICLR 的论文评审得分集中在 5 分左右,平均值为 5.169。

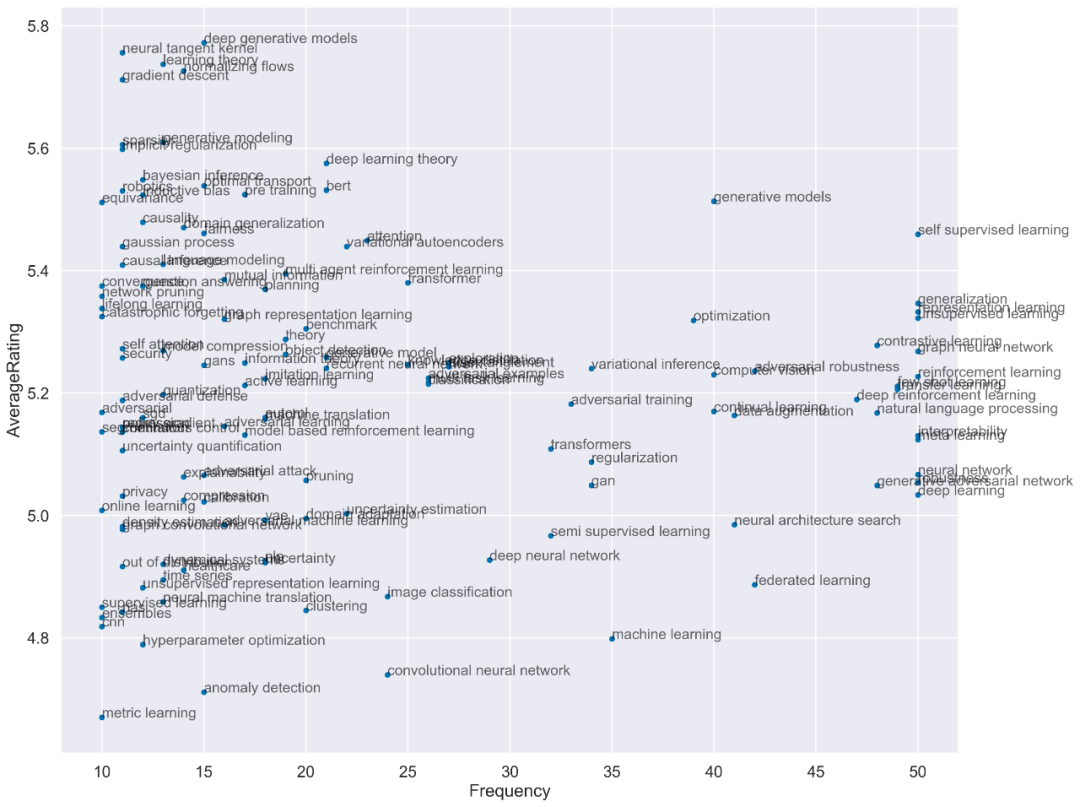

关键词 vs 得分

项目作者还对论文平均得分和关键词频率进行了统计。结果显示,如果论文作者希望尽可能地获得高评分,或许 ta 应该使用「深度生成模型」(deep generative models)、「归一化流」(normalizing flows)、「神经正切核」(neural tangent kernel)、「梯度下降法」(gradient descent)等关键词。

有趣的是,在名为「国际学习表征会议」的 ICLR 大会中,「表征学习」这一关键词的频率仅位于第三位,前两名的位置被「深度学习」和「强化学习」牢牢占据。

看完统计结果以后,斯坦福大学教授 Christopher Manning 表示:「强化学习惊人地崛起了!但卷积神经网络已现疲态。」

观察近年来的统计结果,「图神经网络(GNN)」的热度正在逐年攀升。DeepMind 高级研究科学家 PetarVeličković直言:「不可否认的是,图神经网络已经位于深度学习工具箱中的第一阶梯。」

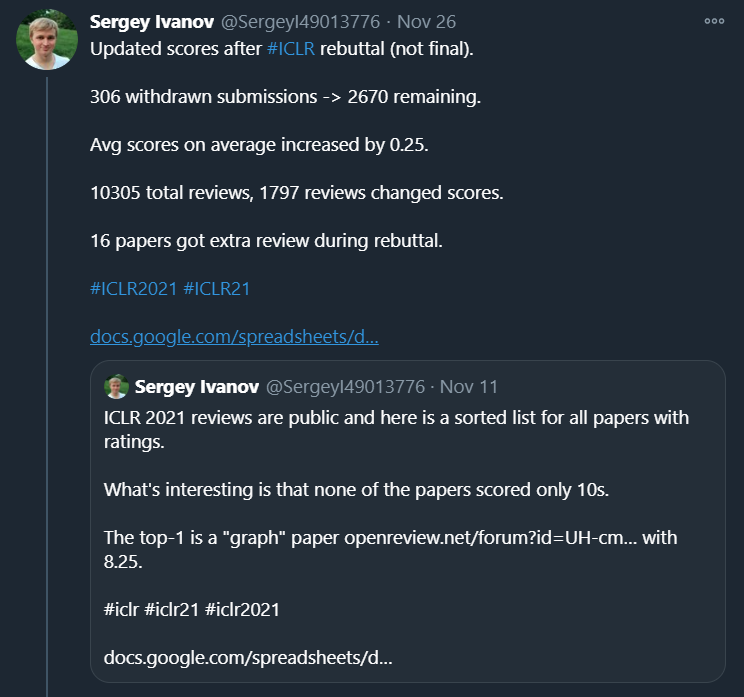

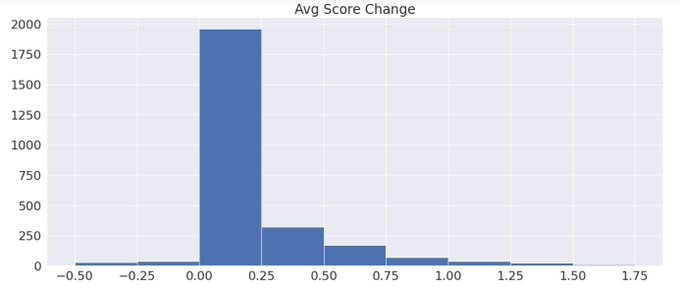

在 Rebuttal 环节之后,Criteo AI Lab 研究科学家 Sergey Ivanov 在自己的推特上展示了论文评分变化的统计结果:

-

306 篇论文撤回了提交,现剩余 2670 篇;

-

论文的平均得分提高了 0.25;

-

总共有 10305 条评审意见,有 1797 条评分发生了变化;

-

在 Rebuttal 环节中,有 16 篇论文得到了额外的评审意见。

ICLR 2021 Rebuttal 环节后论文得分变化情况。

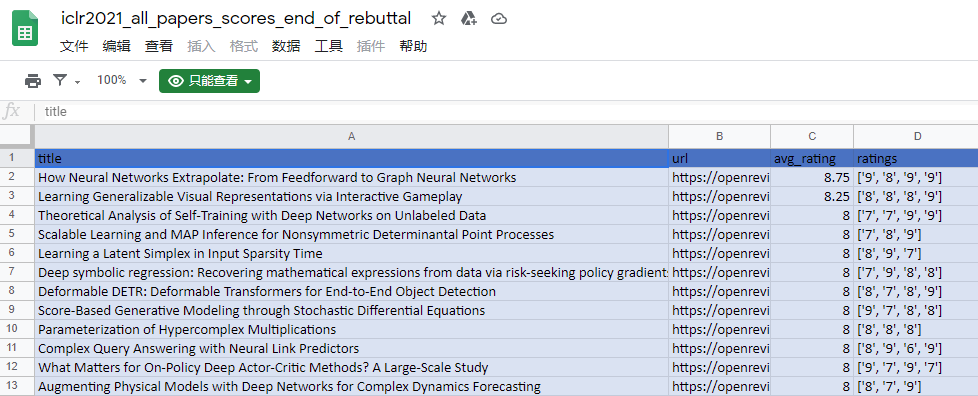

从目前 OpenReview 的结果来看,这一届的 ICLR 没有满分论文,8 分以上的论文总共有 12 篇:

ICLR 2021 的最终接收结果预计在下月公布,但你可以在上述评审得分统计文档中查看自己感兴趣的论文。

论文查看地址:https://docs.google.com/spreadsheets/d/1fsXrKwKtoghQTPhgnCveRfn9GTsSVvoVRvEOaK9Eqp8/edit#gid=1229227255

推荐阅读