【泡泡一分钟】基于动态障碍物遮挡的最佳视点跟踪与恢复研究(3dv-23)

每天一分钟,带你读遍机器人顶级会议文章

标题:Best Viewpoint Tracking for Camera Mounted on robot Arm with Dynamic Obstacles

作者:Christos Maniatis,Marcelo Saval-Calvo,Radim Tylecek

来源:3dv 2017 ( International Conference on 3D Vision)

播音员:丸子

编译:金明 周平

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

在计算机视觉领域的处理环节有一个关键性的步骤,就是需要在动态环境中找到传感器的适当位置来感知目标点,例如装配生产线、视频监视、医疗操作记录等,很多情况下,我们希望对事物的变化或操作过程有一个类似视频的详细记录,比如医生在手术时可以借此对照和反馈找到最佳的手术位置,由于医生手、工具等位置的变化,相机的相对位置也需要动态变化,这样也就最大限度地避免了遮挡的可视性。

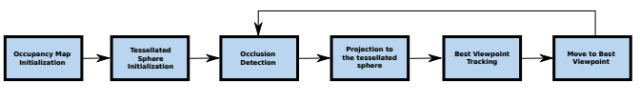

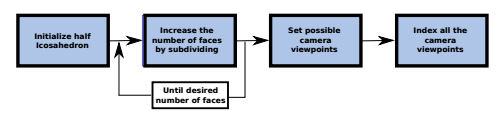

本文提出了一种在动态目标遮挡下的最佳视点恢复方法,很好的解决了计算机视觉领域的三维建模或场景最佳映射的问题。图1、图2分别为它的基本方案和线半球的初始化方案。

图1:所提出的方法的方案。

图2:线半球初始化方案。

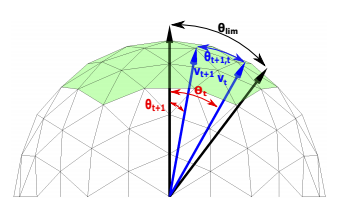

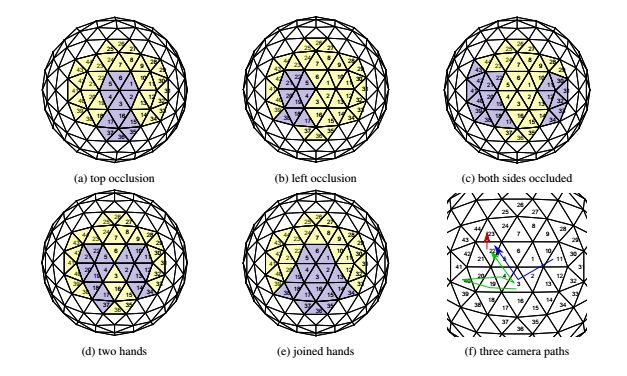

作者重点研究了动态障碍物遮挡目标点情况下的动态视点选择和静态传感器感知,它的思路是根据给定对象的位置来调整摄像机位置,这是一种基于三维场景表示的最佳视点跟踪算法,该算法的核心思想是通过处理动态和静态元素来阻断靶点。相对于传统的NBV,本文主要论证了如何保持一个最佳收视角度的问题,其中的最优性条件包括可见性和摄像机的运动项数据。图3为镶嵌半球(圆顶)两相机提供的电流状态。

图3:镶嵌半球(圆顶)两相机带来的电流状态。

考虑到障碍物的遮挡、当前和下一步视点之间的距离、视点的质量和关节约束(机械臂关节的距离或限制)等因素,作者将研究对象设定为了一个虚拟的半球面中心覆盖的场景,通过建模,不断评估最佳视点来求得最优方案,该方案已在8种不同的场景序列上进行了验证,具有良好的动态性能。

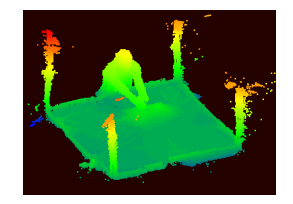

图4:深度传感器捕获的高度着色的融合点云。

图5:有障碍物的动态场景。

Abstract

The problem of finding a next best viewpoint for 3D modeling or scene mapping has been explored in computer vision over the last decade. This paper tackles a similar problem, but with different characteristics. It proposes a method for dynamic next best viewpoint recovery of a target point while avoiding possible occlusions. Since the environment can change, the method has to iteratively find the next best view with a global understanding of the free and occupied parts.

We model the problem as a set of possible viewpoints which correspond to the centers of the facets of a virtual tessellated hemisphere covering the scene. Taking into account occlusions, distances between current and future viewpoints, quality of the viewpoint and joint constraints (robot arm joint distances or limits), we evaluate the next best viewpoint. The proposal has been evaluated on 8 different scenarios with different occlusions and a short 3D video sequence to validate its dynamic performance.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

在【泡泡机器人SLAM】公众号(paopaorobot_slam)中回复关键字“BVTC”,即可获取本文下载链接。

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com