【泡泡一分钟】对于结构特征相关性使用LSTMs进行基于图像的定位(ICCV2017-61)

每天一分钟,带你读遍机器人顶级会议文章

标题:Image-based localization using LSTMs for structured feature correlation

作者:F. Walch, C. Hazirbas, L. Leal-Taix, T. Sattler, S. Hilsenbeck, D. Cremers

来源:ICCV 2017 ( IEEE International Conference on Computer Vision)

播音员:Amy

编译:张建 周平(66)

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

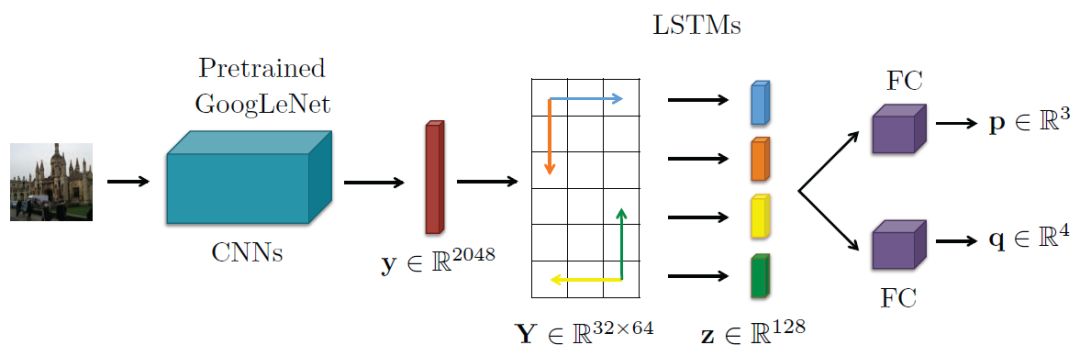

在这项工作中,我们针对于室内和室外场景相机位姿的回归,提出了一种新的CNN+LSTM架构。

对于具有运动模糊和光照变化鲁棒性的定位,CNN允许我们学习其恰当的特征表示。我们利用在CNN上输出的,在特征向量上起到减少结构维度作用的LSTM单元,对定位性能进行了大幅提高。我们对于基于CNN和基于SIFT的定位方法进行了大量的定量比较,它们显示了各自的弱点和优势。

此外,我们提供了一个新的大型室内数据集,其中包含来自激光扫描的准确地面实况。室内和室外公共数据集上的实验结果表明,我们的方法优于现有的深度架构,并且可以在不良的条件下定位图像,例如,在大多数无纹理表面的存在下,其中经典的基于SIFT的方法会失败。

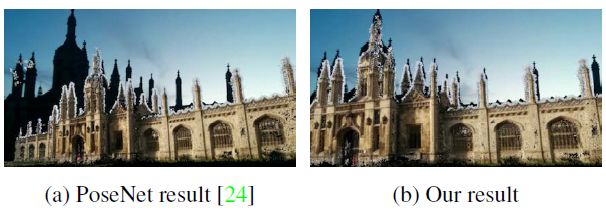

图1:我们的方法实现了准确的基于图像的户外定位,即使是在那些其他深度架构会失败的不良照明条件下。

图2:本文提出的位姿回归LSTM网络的体系结构。

图3:来自我们的TUM-LSI数据集的示例图像。在每个捕捉位置,我们提供了一组六个高分辨率广角图片,拍摄在五个不同的水平方向和一个向上的方向。

图4:类型激活地图被叠加在一个输入的King’s College图像上作为一个热地图。红色区域表示网络认为对位姿回归重要的图像部分。可视化显示了网络如何聚焦于独特的建筑元素。

Abstract

In this work we propose a new CNN+LSTM architecture for camera pose regression for indoor and outdoor scenes. CNNs allow us to learn suitable feature representations for localization that are robust against motion blur and illumination changes. We make use of LSTM units on the CNN output, which play the role of a structured dimensionality reduction on the feature vector, leading to drastic improvements in localization performance. We provide extensive quantitative comparison of CNN-based and SIFT-based localization methods, showing the weaknesses and strengths of each. Furthermore, we present a new large-scale indoor dataset with accurate ground truth from a laser scanner. Experimental results on both indoor and outdoor public datasets show our method outperforms existing deep architectures, and can localize images in hard conditions, e.g., in the presence of mostly textureless surfaces, where classic SIFT-based methods fail.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com