平均每30秒,推特上就有一条攻击黑人女性记者和政客的推文

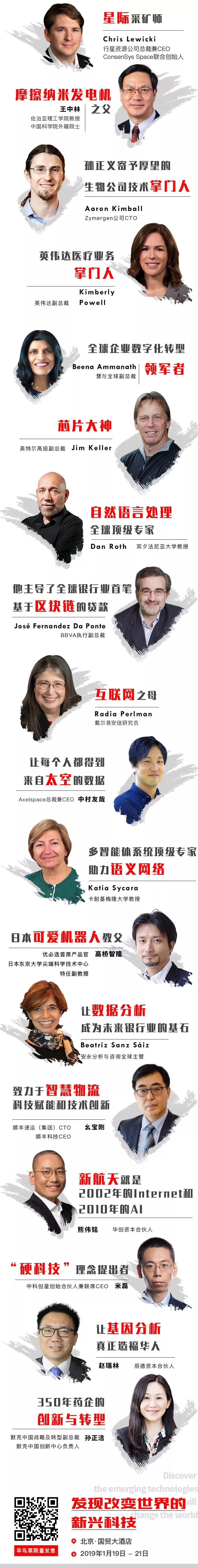

点击上图小程序,参与全球新兴科技峰会

推特可能有毒!近年来,出现在这一网站上的恶意攻击和骚扰令许多人极为不满,尤其是女性和少数族裔,然而目前网站上的自动识别和信息拦截还不太精准可靠,这是由于就目前人工智能所取得的进展来看,机器还不能真正做到对人类交流做出有意义的回应。比如,一些信息虽然披着几个正面的关键字的外衣,却可能是在冷嘲热讽,而人工智能通常很难把这类辱骂性的信息识别出来。

(来源:麻省理工科技评论)

一项新的研究使用了机器学习技术,以便对推特上骚扰信息的范围做出更加精准的判定。该技术研究分析证实了此前许多人的猜测:在这一平台上,女性以及少数族裔记者和政治家们面对的辱骂性言论数量惊人。

这项研究是由国际特赦组织联合加拿大公司 ElementAI 共同开展的。研究显示,在带有辱骂性言论或者是“模棱两可”的推文中,黑人女记者和政客被提及的可能性比同等职业的白人女性多出 84%。

“这真让人恼火”,ElementAI 公司伦敦分部的研究主管朱利安·考尼比斯(Julien Cornebise)说,“这些女性在社会运行中扮演着重要的角色”。ElementAI 公司伦敦分部主要致力于机器学习的人道主义应用。

ElementAI 的研究人员首次使用了一种机器学习工具来识别辱骂性的推文,这与之前用来筛选垃圾信息的工具类似。之后,研究人员将预先分好类的推文和没有提前看过的推文混在一起,交给志愿者进行分类,识别出来的带有辱骂性的推文就用来训练深度学习网络。据考尼比斯所说,这样训练出来的成果就是,系统在识别辱骂性信息方面更加精确了。

这一项目主要针对的是发送给政客和记者的推文,在研究当中,来自 150 个国家的 6500 名志愿者,在 2017 年英国和美国发送给 778 名女性政客和记者的 228000 条推文中,识别出带有攻击性的推文。

这项研究调查了辱骂女性政客和记者的推文,这些女性有的来自英国议会,有的是美国国会和参议院的成员,而女记者有的就职于英国报社,比如《每日邮报》、《盖尔登》、《卫报》、《粉色新闻》和《太阳报》,以及美国的《纽约时报》和新闻网站 Breitbart。

研究发现,在这段时间里,778 名女性收到了 110 万条辱骂性推文——相当于每 30 秒就有一条。研究还显示,在所有发给女性的推文中,有 7.1% 的推文是带有攻击性的言论。这项研究背后的研究人员发布了一款名叫 Troll Patrol 的工具,用来测试推文内容是否构成侮辱或骚扰。

尽管深度学习在现有的识别辱骂性信息的方法中算是一大进步,但研究人员警示,未来机器学习或者人工智能想要一直识别骚扰信息,还是不够的。考尼比斯表示,虽然这一工具经常表现得像人类操作一样优秀,但也会犯错误。他说:“就目前来看,未来还是需要一些人为的判断。”

推特在其平台监管方面的不作为饱受诟病,在国际特赦组织致力于这一项目的米莱娜·马林(Milena Marin)表示,推特公司在其监管政策方面应该更加透明。

马林说:“Troll Patrol 并非是要监管推特公司,或者强制其删除内容”,不过她警告:“推特公司必须将其如何使用机器学习检测辱骂性信息进行说明,并将其依赖的算法技术信息公之于众”。

对此,推特的法律顾问维贾雅·加德(Vijaya Gadde)作出回应,就针对定义辱骂性言论这一问题上,他曾在一次声明中指出:“为将内容分类,我会对‘模棱两可’的内容进行进一步讨论”,“我们会致力于制定全球适用的规则,并且在这一过程中,将咨询公众作为重要部分”。

-End-

在科技发展越来越超乎普通人想象的年代,我们迫切地需要一场巅峰对话来总结过去,指引未来。2019 年 1 月 19 - 21 日,EmTech China 全球新兴科技峰会,超过 30 位全球科技“掌舵人”将亲临北京,为你展开前沿技术的壮丽蓝图,为你解读技术背后的未来价值!

点击上图小程序,参与全球新兴科技峰会