CVPR 2020(Oral) | 中科院等提出BNM:标签不充分下的判别性与多样性约束方法

点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文作者:Spaceman

https://zhuanlan.zhihu.com/p/141530386

本文已由原作者授权,不得擅自二次转载

本文主要详细解读CVPR 2020 Oral文章:《Towards Discriminability and Diversity:Batch Nuclear-norm Maximization under Label Insufficient Situations》。这篇文章探讨了在标签不充分情形下的深度学习训练(比如unsupervised domain adaptation, semi-supervised),并且用十分简洁的形式约束了预测的判别性和多样性。

论文链接:https://arxiv.org/abs/2003.12237

1. Motivation

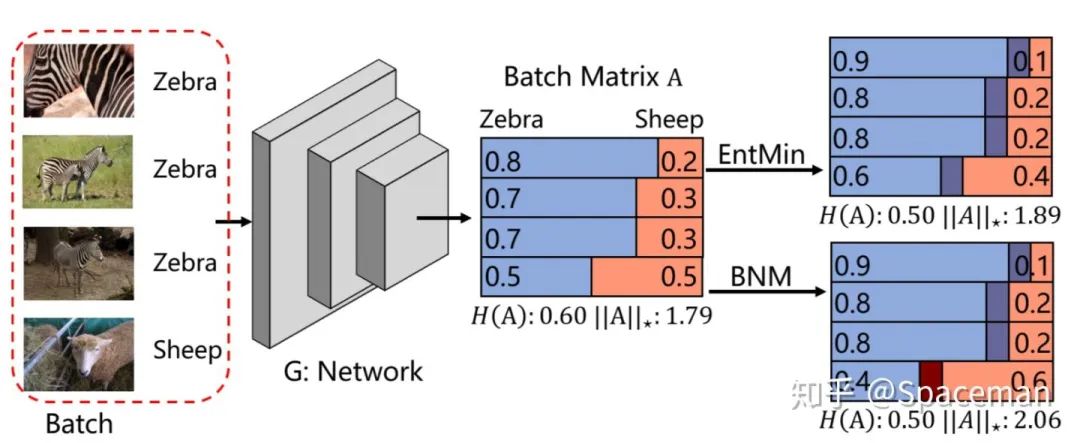

当模型直接应用于无标签的数据时,其预测的判别性(Discriminability)

往往会很差。为了提升模型预测的判别性,一类常见做法是约束模型对无监督数据的预测的熵。熵越小,表明模型预测的判别性越强(当预测为one-hot向量,熵最小)。然而这类方法的缺点是对minority categories不友好:这是因为,为了保证无监督数据的预测的判别性,它可能把minority categories的样本推向majority categories去。这样就无法保证模型预测的多样性(Diversity)。

因此,基于以上的分析,本文对模型的预测进行约束,使得其同时具有:

判别性:可近似表达为预测的确定性;

多样性:可近似表达为预测的类别数目多,避免坍缩于majority categories。

2. Method

2.1 用F-norm约束判别性

假设模型对一个Batch数据的预测矩阵为

那么用熵约束判别性可以表达为:

文章指出约束A的 F-norm (Frobenius-norm)最大,也可以约束模型预测判别性:

文章证明了,A的 F-norm 和 H(A) 具有严格相反的单调性,并且A的 F-norm的最大值与H(A)的最小值的取值相同。证明过程作者放在了补充材料里,目前尚未公开。我自己私下也证明了一下,受限于篇幅,这里暂不展开讲。

特别地,

可以看出取最大值的条件是A的每一行都是one-hot向量,与熵最小的取等条件相同。

2.2 用矩阵秩约束多样性

由于每个Batch的数据都是随机采样的,那么每个Batch的类别的期望应是稳定的。注意到这个性质,本文通过约束A的秩最大,来约束多样性。这样可以避免模型的预测坍缩到majority category。这一点很直观不展开说明。

矩阵的秩直接是很难优化的,这是一个NP-Hard问题。这里约束A的Nuclear-norm

2.3 Batch Nuclear-norm Maximization

为了同时能约束判别性与多样性,我们发现

其中D=min(B, C)。这表明

因此约束

3. 应用

该方法 Batch Nuclear-norm Maximization(BNM),可以用于三种标签不充分的情景:unsupervised domain adaptation, semi-supervised learning, unsupervised domain recognition。

我们假设有Labeled domain

那么最后整体的loss为:

4. 实验

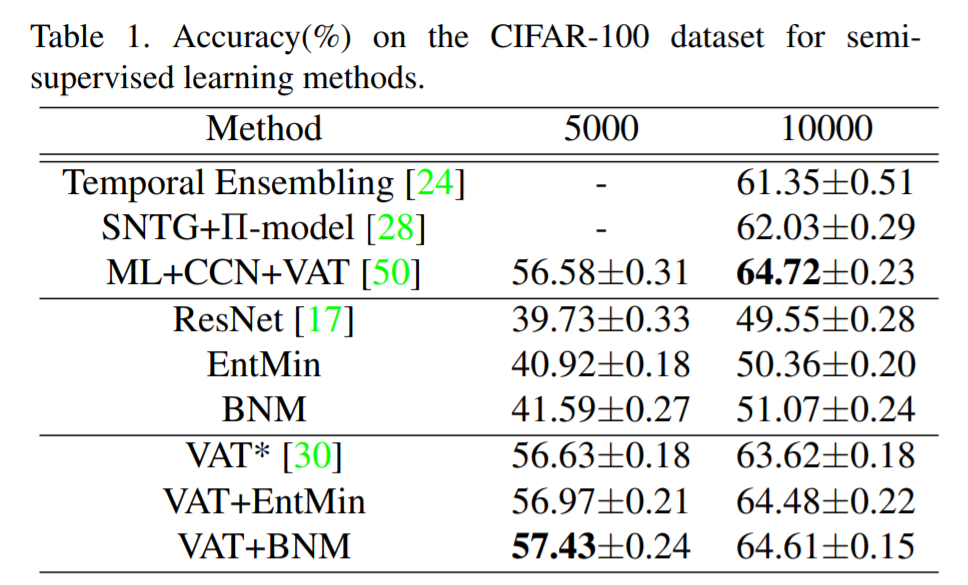

Semi-supervised learning

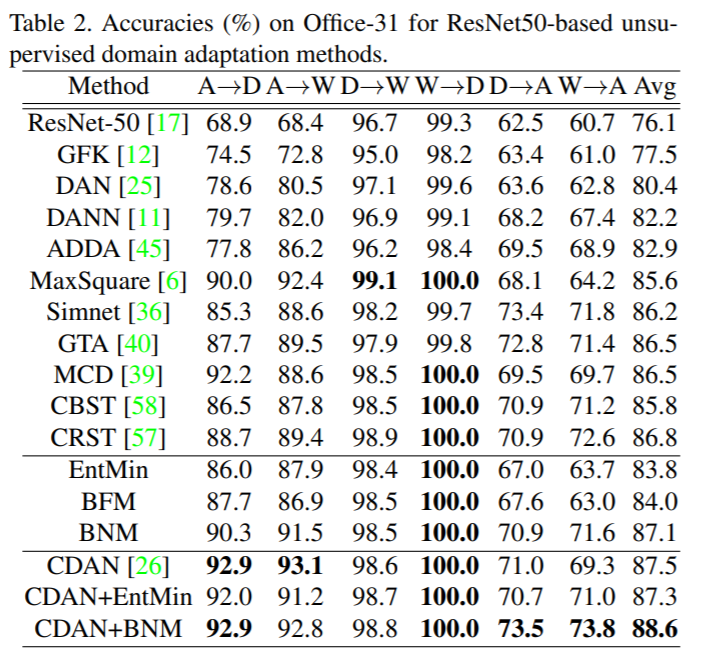

Unsupervised domain adaptation

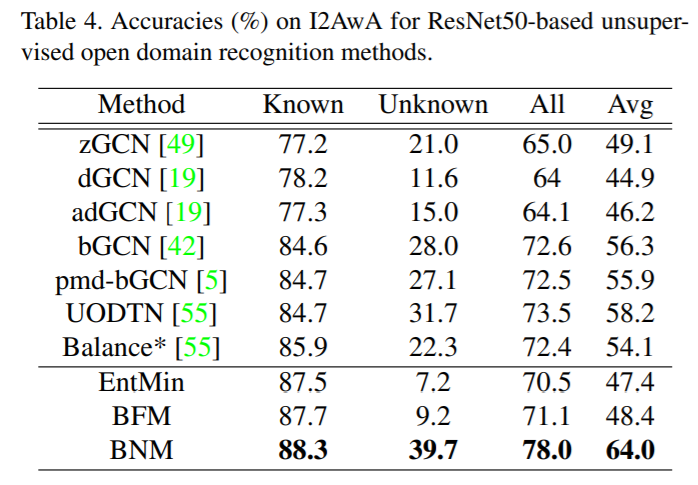

Unsupervised domain recognition

论文下载

在CVer公众号后台回复:BNM,即可下载本论文

重磅!CVer论文写作与投稿 交流群已成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满1800+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI/NIPS等)、顶刊(IJCV/TPAMI/TIP等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

请给CVer一个在看!