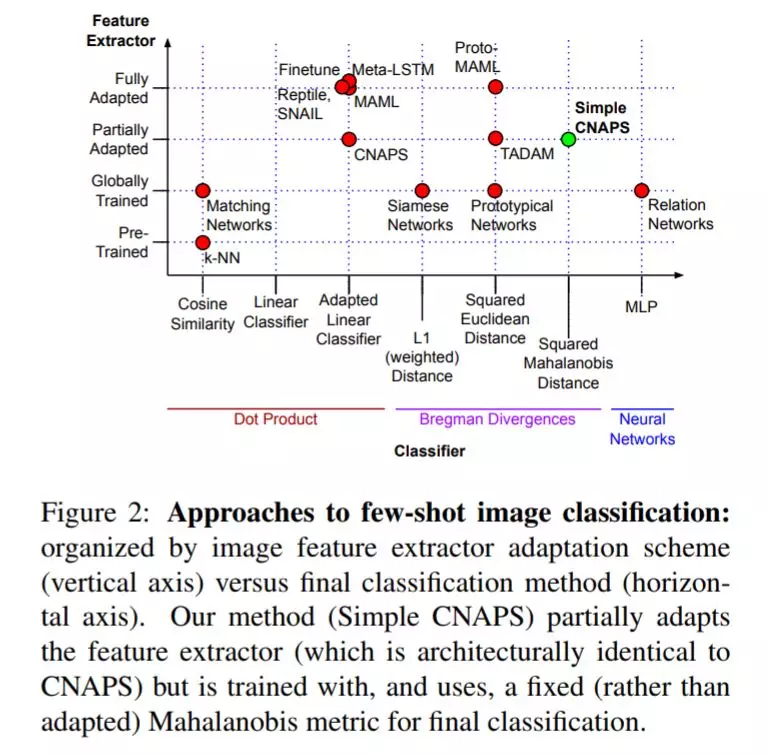

小样本学习是计算机视觉中的一项基本任务,它带来了减轻对详尽标记数据需求的希望。到目前为止,大多数小样本学习方法都集中在日益复杂的神经特征提取器和分类器适应策略,以及任务定义本身的细化。在这篇论文中,我们探讨了一个假设,即一个简单的基于类协方差的距离度量,即马氏距离,被采用到一个最先进的小样本学习方法(CNAPS)中,它本身可以导致显著的性能改进。我们还发现,学习自适应特征提取器是可能的,它允许从非常少的样本中对该度量所需的高维特征协方差进行有用的估计。我们的工作结果是一个新的“简单的CNAPS”架构,它比CNAPS少了9.2%的可训练参数,并且在标准的小样本图像分类基准数据集上比现有的技术水平高了6.1%。

成为VIP会员查看完整内容

相关内容

Arxiv

21+阅读 · 2018年12月25日