本研究探讨人工智能(AI)在决策过程中不断演变的角色,聚焦AI赋能技术如何与人类决策者互动及其影响。AI系统正加速融入商业管理至信息系统等各行业,或辅助或替代人类判断。现有文献强调AI融入生活与工作带来的变革潜力与挑战:以ChatGPT为代表的大语言模型凭借数据驱动洞察、效率提升与决策一致性等优势被广泛应用,但研究亦揭示需深入理解的领域——AI复制或放大人类偏见的风险、自主决策的伦理影响、人机交互的复杂性。尽管AI辅助、增强或替代人类决策已获广泛关注,但通过提示工程与情境应用赋予AI的角色如何影响决策结果、行为模式与建议生成,学界仍缺乏深入探索。

本论文包含四项研究,探讨角色定义与目标设定对AI决策行为的影响,揭示精确定义AI角色如何在不同情境中塑造决策结果与人类决策流程。

研究1 通过系统性文献综述,论证机器学习与AI工具(如ChatGPT)结合提升文献分析效率与深度的有效性。研究识别AI整合关键领域,揭示研究空白,指出高影响力期刊与主题,为未来研究绘制路线图。该研究强调跨学科方法对全面理解与发挥AI潜力、应对伦理复杂性的重要性。

研究2 采用"人在回路"(HITL)框架分析AI赋能招聘流程,通过某国际招聘公司18个月质性案例研究,揭示AI工具、招聘专员与寻源分析师协作塑造招聘结果的合作模式。研究表明:AI系统实施需平衡效率与伦理及人本考量,人类判断、监督与适应力不可或缺;组织领导力、方案适应性与人类自主权是成功关键要素。

研究3 通过系列实验探究AI系统(以ChatGPT为例)被赋予的角色如何影响信息系统(IS)语境下的决策结果。研究发现:当ChatGPT被赋予人类角色时,其决策行为高度复现人类偏见;而作为AI角色时则表现出更高一致性与客观性。研究揭示提示工程对引导AI系统符合预期决策流程的重要性——无论是模拟人类判断还是提升决策客观效率。

研究4 探索AI系统中的"算法厌恶"现象,测试GPT类模型在不同版本与温度参数下对人工建议与算法输入的响应差异。研究发现:GPT模型表现出类似人类的算法厌恶倾向,更偏好人工建议,但其表现形式与人类存在差异。该研究将算法厌恶概念扩展至AI系统,强调理解AI如何处理人机建议对设计决策支持系统的重要性,确保AI既能独立运作又能与人类协作。

总体贡献

本研究在四方面深化对AI决策角色的理解:

- 方法论创新:引入结合AI工具与机器学习的计算文献综述方法,识别商业管理领域趋势、空白与高影响力期刊;

- 人机协作洞见:通过招聘案例实证HITL原则,强调人类赋权、自主权与持续适应对有效协作的关键作用;

- 角色效应验证:证明大语言模型角色设定显著影响决策行为——模拟人类角色时复现偏见,AI角色时更趋理性;

- 理论边界拓展:将算法厌恶延伸至AI系统,揭示AI对人机建议的差异化处理机制。

综上,这些研究为理解AI与人类决策者动态互动提供洞见,强调情境与角色设定对优化AI决策贡献的重要性,为未来探索AI融入更复杂重大决策场景奠定基础。

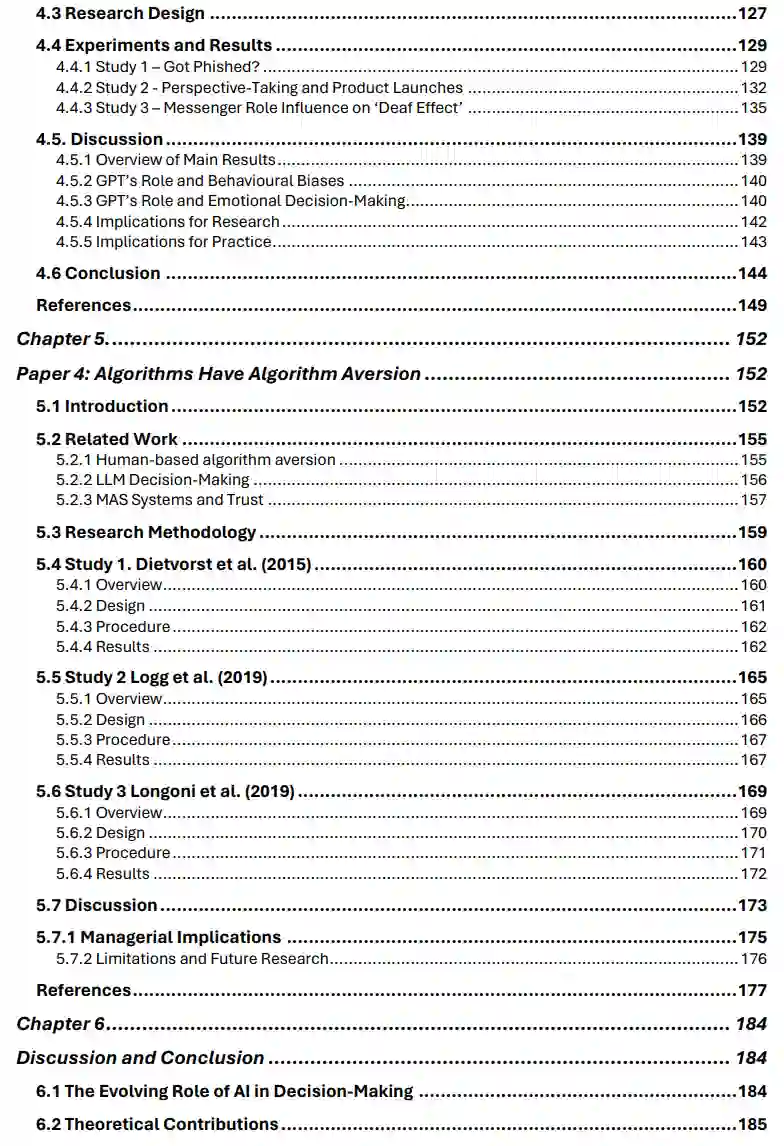

表1.1 研究综述

| 研究编号 | 研究重点 | 研究路径、理论基础与方法论 | 主要发现 | 理论贡献 | 实践贡献 |

|---|---|---|---|---|---|

| 研究1 | 商业与管理学者如何应对AI在组织中的兴起?研究热点与空白领域为何? | 采用结构化主题建模与机器学习方法进行系统性文献综述(CLR),结合ChatGPT辅助分析 | - 识别44个AI研究热点(如客户营销、AI伦理) - 揭示体育、应急响应与智慧城市等领域的空白 |

提出"计算文献综述"方法论,结合AI工具提升文献分析效率 | 指导研究者锁定高影响力期刊,优化文献检索路径 |

| 研究2 | AI赋能的招聘决策中如何平衡效率与伦理?人在回路(HITL)原则如何应用? | 对国际招聘机构开展18个月质性案例研究,基于社会技术系统理论与HITL框架 | - 发现协作型HITL配置模式 - 揭示行政负担加重、权力重构等挑战 |

拓展HITL理论在AI招聘场景的应用 | 提出AI招聘实施指南:强效领导力、系统适应性与人本考量 |

| 研究3 | ChatGPT在信息系统中多大程度能复现人类决策行为?角色设定如何影响决策输出? | 通过提示工程实验,测试ChatGPT在不同角色设定(人类/AI)下的决策行为 | - 人类角色设定下复现决策偏见 - AI角色设定下展现更高客观性 |

提出"角色中心决策框架",揭示大语言模型角色工程对决策的影响机制 | 为提示工程提供设计准则,优化AI决策支持系统的角色配置策略 |

| 研究4 | AI系统是否存在算法厌恶?GPT模型对人类建议与算法输入的响应差异如何? | 复现经典算法厌恶实验范式,测试GPT不同版本(3.5/4.0)在多种温度参数下对建议来源的偏好 | - GPT表现出类人算法厌恶倾向 - 对人工建议的偏好强度与温度参数呈负相关 |

首次将算法厌恶理论拓展至AI系统,建立"元算法厌恶"概念 | 为AI协同决策系统设计提供新视角,优化人机建议权重分配机制 |