国际机器学习会议 ICML(International Conference on Machine Learning),是全球范围内人工智能领域的顶级学术会议之一,由国际机器学习学会(IMLS)举办,与 NeurIPS、ICLR 并列为 AI 三大顶会。本届 ICML 为第四十二届,于 7 月 13-19 日在加拿大温哥华举行。

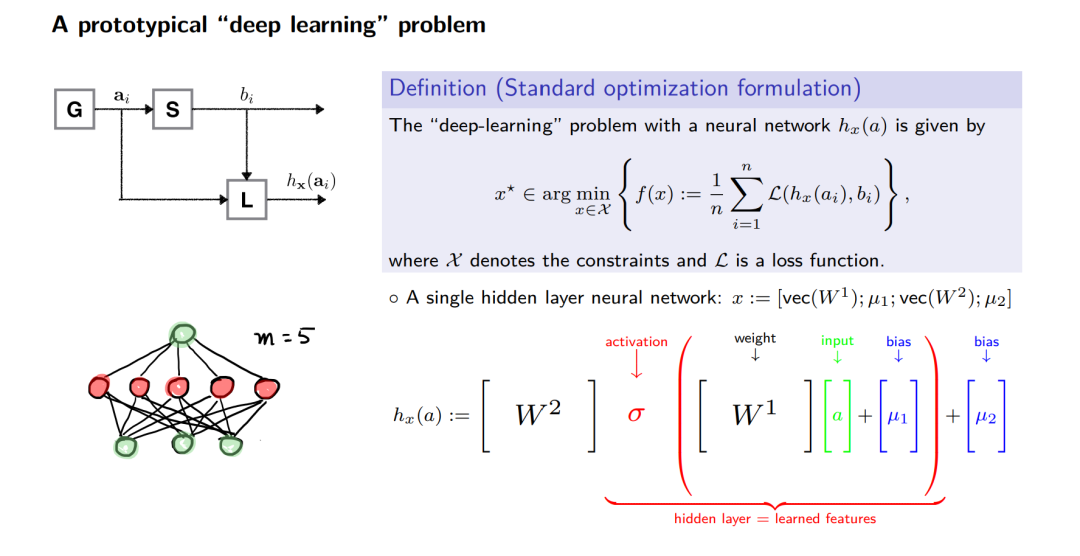

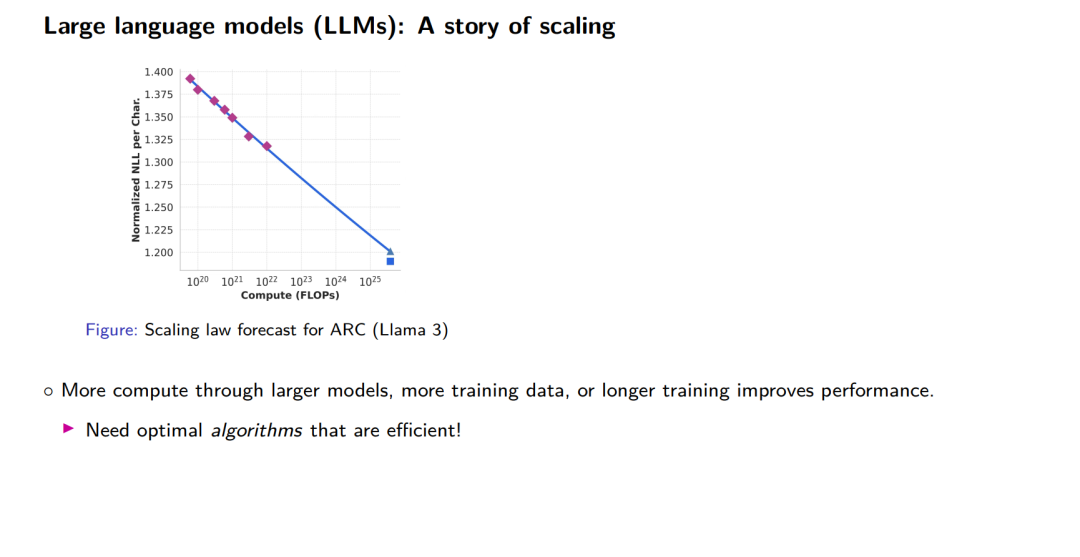

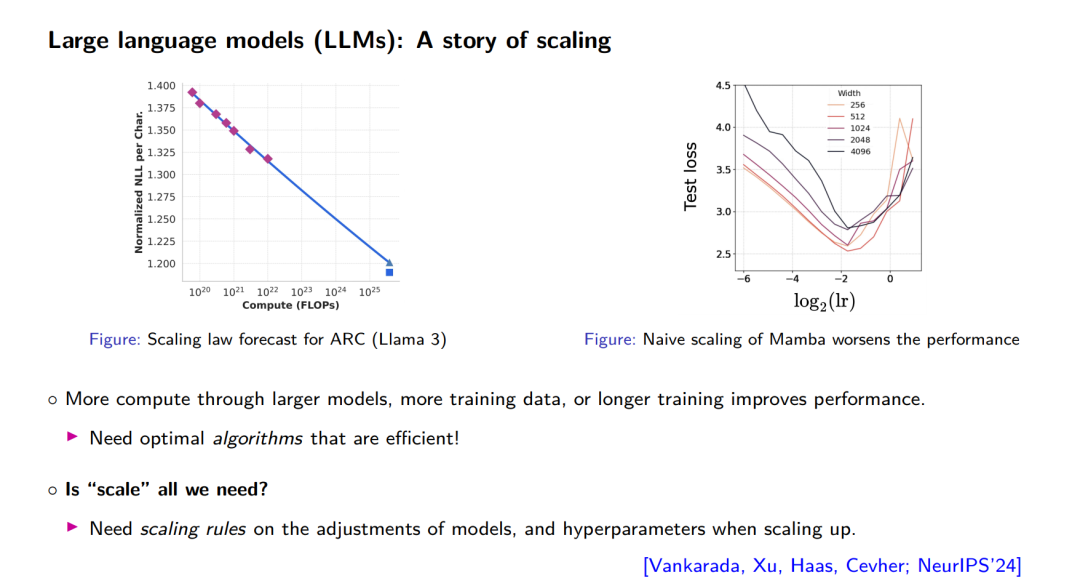

今年的 ICML 大会共获得 12107 篇有效论文投稿,其中 3260 篇被接收,接收比例为 26.9%。相比 2024 年的 9653 篇投稿数量持续大幅增长,展示了 AI 领域的火热。 来自亚马逊研究人员Leena Chennuru Vankadara · Volkan Cevher 深度学习的变革性影响的核心概念是规模——涵盖了数据和计算资源,以及它们与神经网络架构的相互作用。 然而,规模带来了关键挑战,例如训练过程中的不稳定性增加和模型特定调优的高昂成本。鉴于训练这些模型所需的大量资源,制定基于严格理论研究的高置信度扩展假设变得至关重要。教程的第一部分将概述深度学习扩展理论的重大进展,涵盖其历史基础、最近的突破以及对大规模模型训练的实际意义。 为了弥合理论与实践之间的差距,教程还探讨了扩展的另一个关键数学组成部分:深度学习中常用的数值求解算法,这些算法涵盖了从视觉到语言模型等多个领域。我们将这些算法统一在一个共同的主模板下,使其基础原理更加透明。通过这种方式,我们揭示了通过在线学习适应平滑结构与通过非欧几里得范数利用优化几何之间的相互作用。 我们的阐述不仅仅停留在构建更大模型上——它强调战略性的扩展,提供了有望推动该领域发展的洞察,同时节省资源。

成为VIP会员查看完整内容

相关内容

Arxiv

10+阅读 · 2018年3月20日