论文名称:Combining Self-Training and Self-Supervised Learningfor Unsupervised Disfluency Detection 论文作者:王少磊,王重元,车万翔,刘挺 原创作者:王少磊 论文链接:http://ir.hit.edu.cn/~slwang/emnlp2020.pdf

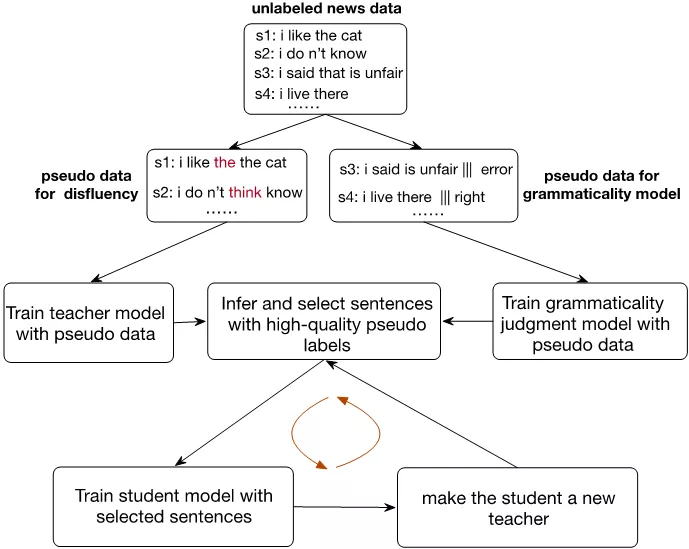

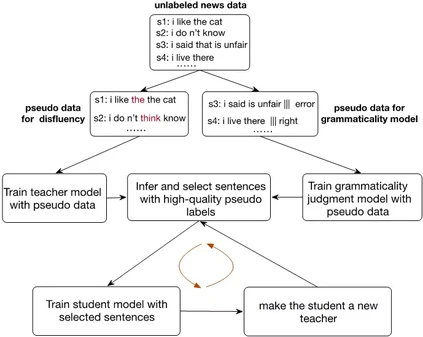

摘要:文本顺滑(Disfluency Detection)的目的是删除自动语音识别(ASR)结果中的不顺滑的词,从而得到更自然和通顺的句子。目前大部分在文本顺滑(Disfluency Detection)任务上的工作都严重依赖人工标注数据。在本工作中,我们首次尝试用无监督的方法来解决文本顺滑问题。我们通过结合自训练(self-training)和自监督(self-supervised)两种方法,在不采用任何有标注训练数据的情况下,取得了跟目前最好的有监督方法接近的效果。

成为VIP会员查看完整内容