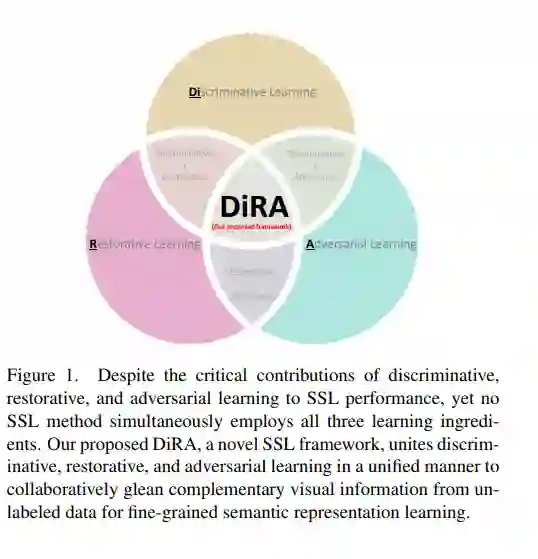

判别学习、恢复学习和对抗性学习已被证明对计算机视觉和医学成像中的自监督学习方案有益。然而,现有的努力,忽略了它们在三元设置中相互之间的协同作用,我们认为,这可以显著地有利于深度语义表示学习。为了实现这一愿景,我们开发了DiRA,这是第一个将判别学习、恢复学习和对抗学习统一起来的框架,以协作的方式从未标记的医学图像中收集互补的视觉信息,用于细粒度语义表示学习。我们的广泛实验表明,DiRA (1) 鼓励三种学习成分之间的协作学习,从而在器官、疾病和模态中产生更一般化的表征; (2) 优于完全监督的ImageNet模型,并在小数据领域增强鲁棒性,减少多个医学成像应用程序的注释成本; (3) 学习细粒度语义表示,仅通过图像级标注即可实现病灶的准确定位 ;(4) 增强了最先进的修复方法,揭示了DiRA是统一表征学习的一般机制。所有代码和预训练的模型都可以

在https://github.com/JLiangLab/DiRA上找到

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2022年6月7日