合成孔径雷达(SAR)图像中基于人类的目标检测是复杂的、技术性的、费力的、缓慢的,但时间很关键,是机器学习(ML)的完美应用。训练一个用于目标检测的ML网络需要非常大的图像数据集,这些数据集中嵌入了准确和精确标记的目标。不幸的是,不存在这样的SAR数据集。因此,本文提出一种方法,通过结合两个现有的数据集来合成宽视场(FOV)SAR图像: SAMPLE,由真实和合成的单物体芯片组成,以及MSTAR杂波,由真实的宽视场SAR图像组成。合成目标使用基于阈值的分割从SAMPLE中提取,然后再与MSTAR杂波中的斑块进行α-混合。为了验证新的合成方法,使用一个简单的卷积神经网络(CNN)创建了单个物体芯片并进行了分类;针对测量的SAMPLE子集进行测试。还开发了一种新颖的技术来研究深层的训练活动。拟议的数据增强技术使测量的SAR图像分类的准确性增加了17%。这一改进表明,来自分割和混合的任何残余伪影都不会对ML产生负面影响,这对于未来在广域SAR合成中的使用是很有希望的。

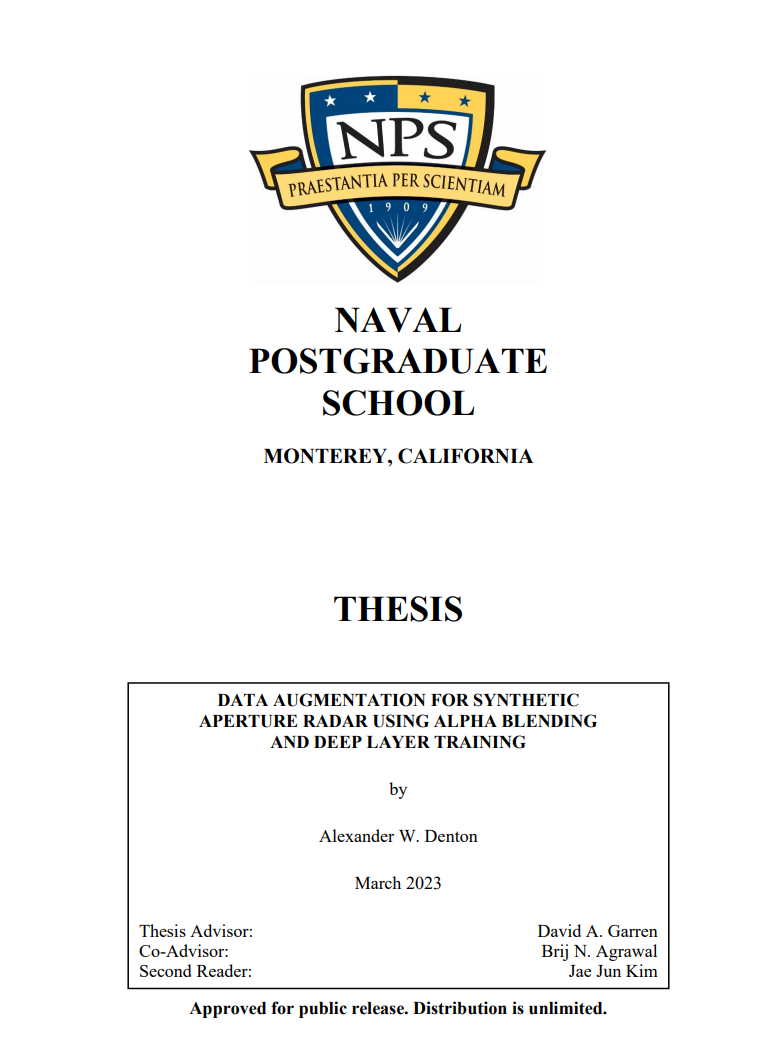

"在MSTAR数据收集期间拍摄的M1的EO图像(a,c)和同一车辆的真实CAD模型(b,d)从两个角度进行了比较。请注意,即使是小的细节,如火炮的位置、舱门和车辆侧面的电缆,在两张图像之间也很一致。提供CAD模型的颜色是为了识别零件组装,并不表示任何影响电磁模拟的具体属性" [10]。

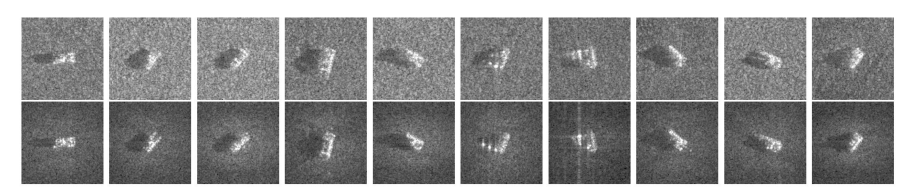

"SAMPLE数据集中每个飞行器的一个图像的例子。测量的MSTAR图像在最上面一行,相应的合成图像在最下面一行....,我们看到诸如阴影、方向和相对回波幅度等细节都很一致"[10]。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2023年6月16日

UniViLM: A Unified Video and Language Pre-Training Model for Multimodal Understanding and Generation

Arxiv

19+阅读 · 2020年2月15日