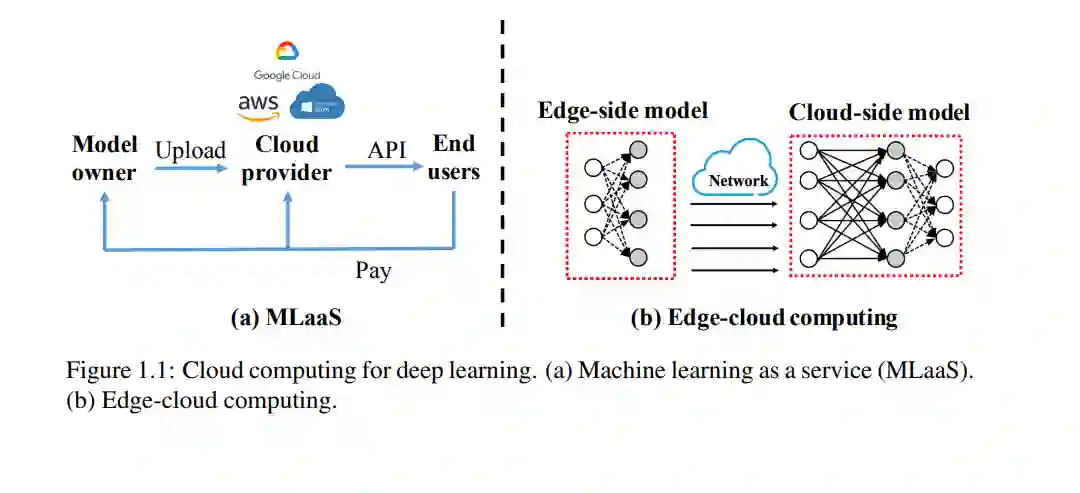

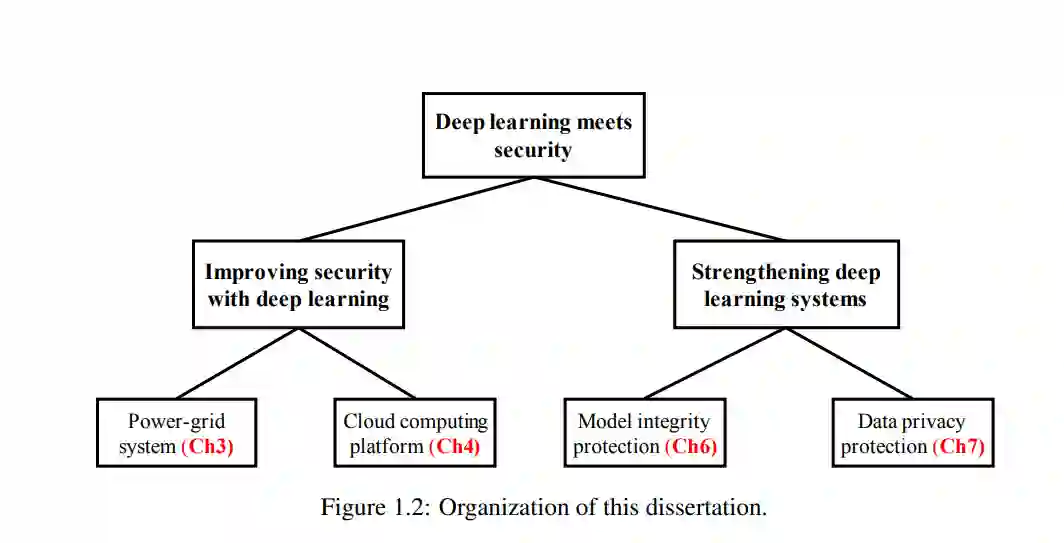

**近年来,深度学习在许多领域得到了快速发展。这些成功启发了在安全领域使用深度学习。**然而,当深度学习遇到安全性时,至少有两个主要挑战。首先,攻击数据的可用性是个问题。在有限的攻击数据下构建一个良好的模型是具有挑战性的。其次,深度学习系统本身容易受到各种攻击,这在使用深度学习提高计算机系统安全性时带来了新的问题。为了解决第一个挑战,本文展示了如何使用深度学习技术来提高有限或没有攻击数据的计算机系统的安全性。为了解决第二个挑战,我们展示了如何保护深度学习系统的安全性和隐私性。 **具体而言,在本文的第一部分中,我们考虑了一个没有攻击数据的实际场景,即异常检测。**本文提出了一种新的方法——重构误差分布(RED),用于实时异常检测。本文的关键见解是,计算机系统的正常行为可以通过时间深度学习模型捕获。偏离正常行为表示异常。实验表明,所提方法可以在电网控制器系统和通用云计算服务器中实时、高精度地检测攻击。论文的第二部分主要研究深度学习的安全与隐私保护问题。在机器学习即服务(MLaaS)系统中,可以通过一种精心设计的输入,即敏感样本,动态检查云中的深度学习模型的完整性。在另一个场景中,例如边缘-云系统中的分布式学习,我们证明了云中的攻击者可以在攻击者能力不断减弱的情况下高保真地重构边缘设备的输入数据。本文还提出了一种新的防御方法来应对这些攻击。 综上所述,我们希望本文的工作能为利用深度学习提高安全性提供启发,并有助于提高深度学习系统的安全性。

成为VIP会员查看完整内容

相关内容

普林斯顿大学,又译

普林斯敦大学,常被直接称为

普林斯顿,是美国一所私立研究型大学,现为八所常青藤学校之一,绰号为老虎。

Arxiv

17+阅读 · 2023年1月18日